Clear Sky Science · sv

Bedömning av risk för bias i kliniska prövningar med stora språkmodeller och ROBUST-RCT: en genomförbarhetsstudie

Varför detta är viktigt för patienter och läkare

Modern medicin förlitar sig på kliniska prövningar för att avgöra vilka behandlingar som fungerar, men även väl utformade studier kan vara missvisande om de är partiska. Att noggrant granska varje prövning för dolda problem är ett långsamt och komplicerat arbete som kan fördröja uppdateringar av medicinska riktlinjer i åratal. Denna studie undersöker om stora språkmodeller—avancerade AI-system som läser och analyserar text—kan hjälpa människor att snabbare och mer konsekvent bedöma hur trovärdiga kliniska prövningar är, med hjälp av ett nyare och enklare verktyg kallat ROBUST-RCT.

Hur prövningskvalitet bedöms i dag

Kliniska prövningar kallas ofta guldsstandard, men de kan ändå förvrängas av designfel, bristfällig rapportering eller selektiv analys. För att upptäcka dessa problem använder granskare vanligtvis Cochrane’s Risk of Bias 2 (RoB 2) checklistan. Trots sin stringens är RoB 2 notoriskt tidskrävande, svår att tillämpa även för experter och ger endast måttlig överensstämmelse mellan olika granskare. Samtidigt ökar antalet publicerade prövningar varje år, men antalet studier som faktiskt tas in i systematiska översikter har inte hängt med, och många översikter är redan föråldrade vid publicering. Denna växande klyfta har väckt intresse för enklare verktyg och teknisk hjälp från AI.

Ett nytt verktyg och en roll för AI

ROBUST-RCT är ett nyligen utvecklat alternativ till RoB 2. Istället för att försöka fånga alla tänkbara källor till bias fokuserar det på sex kärnfrågor som både är vanliga och starkt kopplade till förvrängda behandlingseffekter. Verktyget utformades av epidemiologer för att hitta en balans mellan enkelhet och vetenskaplig stringens, och det testades för användbarhet med yngre granskare. Eftersom ROBUST-RCT är nyare och mindre välkänd än RoB 2 såg författarna en möjlighet: kombinera denna förenklade checklista med stora språkmodeller för att se om AI på ett tillförlitligt sätt skulle kunna assistera i bedömningen av prövningsbias tillsammans med mänskliga granskare.

Vad forskarna faktiskt testade

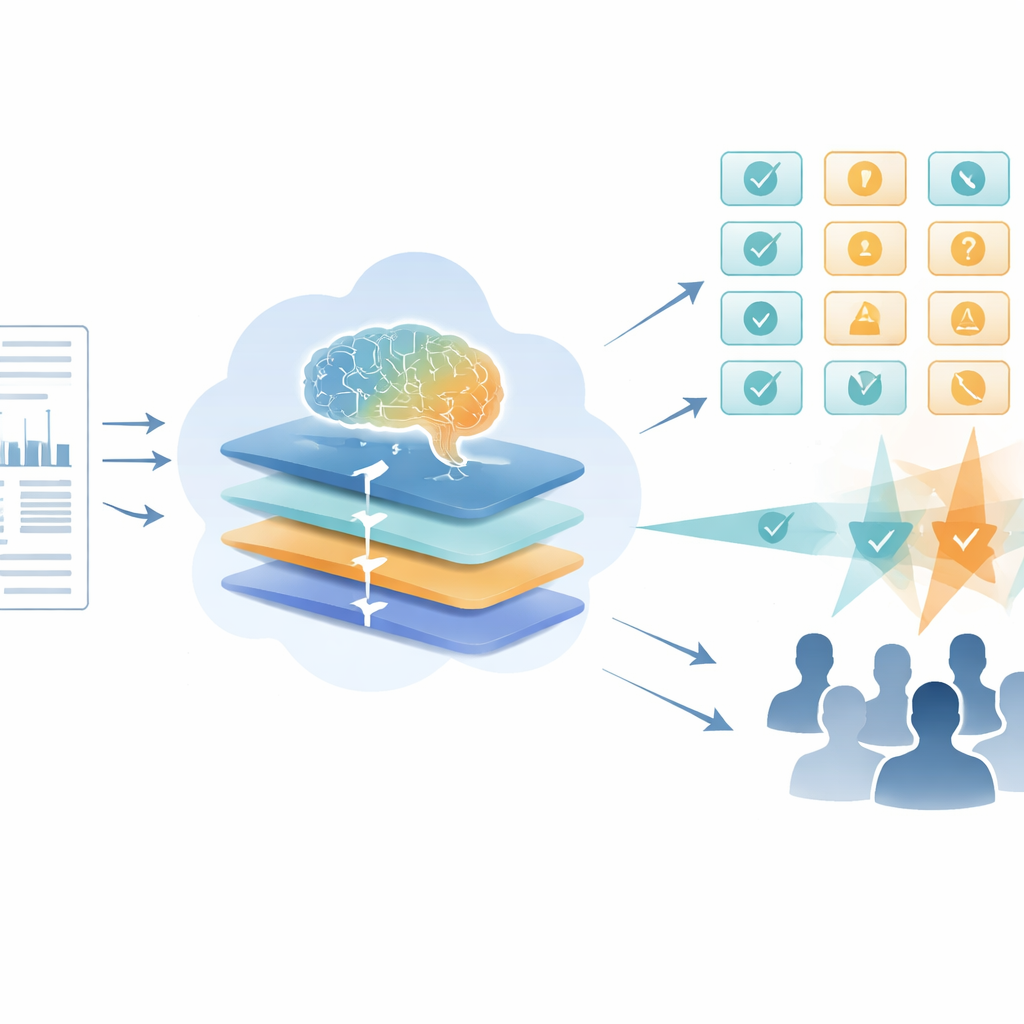

Teamet valde slumpmässigt ut 20 läkemedelsprövningar indexerade i PubMed Central och hamnade efter exklusioner på 9 randomiserade kontrollerade prövningar för detaljerad analys. Tre tidigt karriärsmedicinska forskare använde självständigt ROBUST-RCT-manualen för att bedöma varje prövnings primära utfall och löste sedan eventuella meningsskiljaktigheter i konsensusmöten. Parallellt gavs fyra olika stora språkmodeller—GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 och Qwen3-235B-A22B—fulla prövnings-PDF:er plus en detaljerad steg-för-steg-instruktion om hur ROBUST-RCT ska tillämpas. Huvudfrågan var: hur väl matchade varje AIs slutliga bedömningar den mänskliga konsensusen över verktygets sex huvudpunkter?

Hur väl AIs överensstämde med människor

För att kvantifiera överensstämmelsen använde författarna en statistik som kallas Gwet’s AC2, vilken förbättrar de mer välkända Kappa-måtten och hanterar ojämna betygsmönster bättre. I 54 parade människa–AI-jämförelser uppnådde tre av de fyra modellerna åtminstone ”måttlig” tillförlitlighet när den mätningen gjordes probabilistiskt, vilket betyder att deras bedömningar ofta liknade den mänskliga konsensusen och att stora meningsskiljaktigheter var relativt sällsynta. Gemini 2.5 Pro Preview presterade bäst (AC2 0,69), följd av Qwen3-235B-A22B (0,65) och GPT-4-turbo (0,60). DeepSeek-R1 var svagast (0,46) och tenderade att bedöma prövningar som mer partiska än människorna gjorde, möjligtvis eftersom den förlitade sig på textutdrag och inte fullt ut kunde använda tabeller och figurer. Anmärkningsvärt var att när författarna tittade enbart på de mänskliga granskarna före deras diskussion hade dessa en egen överensstämmelse (Fleiss’ Kappa 0,49) som liknande vad som rapporterats för det äldre RoB 2-verktyget.

Vad detta betyder för framtida evidensöversikter

Trots det lilla stickprovet visar denna genomförbarhetsstudie att flera nuvarande stora språkmodeller kan nå åtminstone måttlig överensstämmelse med mänskliga granskare vid tillämpning av ROBUST-RCT, ett enklare verktyg för att bedöma risk för bias i kliniska prövningar. I praktiken skulle sådana modeller så småningom kunna fungera som en ”tredje granskare” för att avgöra oenigheter, flagga troliga fel eller förhandsgranska studier så att mänskliga experter kan fokusera på de mest komplexa eller omstridda fallen. Författarna betonar att AI inte kommer att ersätta mänskligt omdöme och att etiska frågor—såsom dataskydd, träning på upphovsrättsskyddat material och risken för överberoende av automatiska verktyg—måste hanteras. Ändå antyder resultaten att noggrant vägledd AI kan hjälpa till att hålla systematiska översikter mer uppdaterade, vilket gör att kliniker och riktlinjegrupper kan ägna mindre tid åt teknisk poängsättning och mer tid åt att tolka vad helheten av bevisen betyder för patientvård.

Citering: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Nyckelord: risk för bias, kliniska prövningar, systematiska översikter, stora språkmodeller, evidensbaserad medicin