Clear Sky Science · ru

Оценка риска смещения в клинических испытаниях с помощью больших языковых моделей и ROBUST-RCT: исследование выполнимости

Почему это важно для пациентов и врачей

Современная медицина опирается на клинические исследования при решении, какие методы лечения эффективны, но даже хорошо спроектированные исследования могут вводить в заблуждение из‑за смещения. Тщательная проверка каждого исследования на скрытые проблемы — медленная и сложная работа, которая может задерживать обновление медицинских рекомендаций на годы. В этом исследовании рассматривается, могут ли большие языковые модели — продвинутые ИИ‑системы для чтения и анализа текста — помочь людям быстрее и последовательнее оценивать надежность клинических испытаний, используя новый, более простой инструмент ROBUST-RCT.

Как сегодня оценивают качество испытаний

Клинические испытания часто называют «золотым стандартом», но и они могут искажаться из‑за ошибок в дизайне, плохой отчетности или селективного анализа. Чтобы выявлять такие проблемы, рецензенты обычно используют чек‑лист Cochrane Risk of Bias 2 (RoB 2). Несмотря на строгость, RoB 2 известно тем, что его применение занимает много времени, с ним сложно работать даже экспертам, и он обеспечивает лишь умеренное согласие между разными рецензентами. Одновременно ежегодно публикуется всё больше испытаний, тогда как число исследований, попадающих в систематические обзоры, отстает, и многие обзоры уже устаревают к моменту публикации. Этот разрыв стимулирует интерес к более простым инструментам и к технологической поддержке со стороны ИИ.

Новый инструмент и роль ИИ

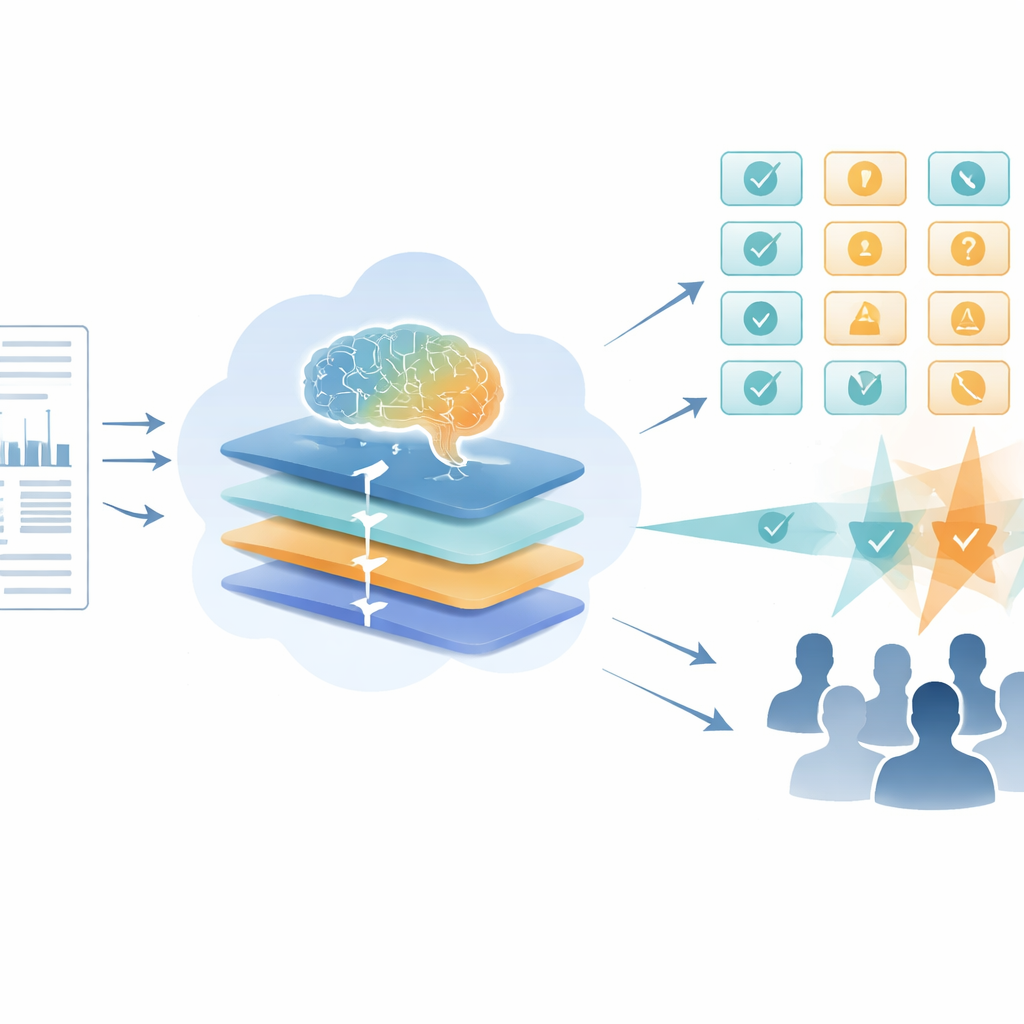

ROBUST-RCT — недавно разработанная альтернатива RoB 2. Вместо попытки охватить все возможные источники смещения, он фокусируется на шести ключевых пунктах, которые часто встречаются и тесно связаны с искажением оценок эффективности лечения. Инструмент создан эпидемиологами, чтобы найти баланс между простотой и научной строгостью, и был протестирован на удобстве использования младшими рецензентами. Поскольку ROBUST-RCT новее и менее знаком, чем RoB 2, авторы увидели возможность: сочетать этот упрощённый чек‑лист с большими языковыми моделями, чтобы выяснить, сможет ли ИИ надежно помогать в оценке смещения испытаний вместе с людьми.

Что конкретно проверяли исследователи

Команда случайным образом отобрала 20 исследований лекарственных средств из PubMed Central и после исключений оставила 9 рандомизированных контролируемых испытаний для детального анализа. Три начинающих медицинских исследователя независимо друг от друга использовали руководство ROBUST-RCT для оценки первичного исхода каждого исследования, после чего разрешали расхождения на консенсусных встречах. Параллельно четырём различным большим языковым моделям — GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 и Qwen3-235B-A22B — предоставляли полные PDF испытаний и подробную пошаговую инструкцию по применению ROBUST-RCT. Ключевой вопрос заключался в том, насколько близки итоговые оценки каждой модели к человеческому консенсусу по шести основным пунктам инструмента?

Насколько ИИ согласовались с людьми

Для количественной оценки согласия авторы использовали статистику Gwet’s AC2, которая улучшает знакомые показатели Каппы и лучше справляется с неравномерностью распределения оценок. В 54 парных сравнениях человек–ИИ три из четырёх моделей достигли по меньшей мере «умеренной» надежности при вероятностном бенчмаркинге, то есть их оценки часто совпадали с человеческим консенсусом и крупные расхождения встречались относительно редко. Лучше всех себя показала Gemini 2.5 Pro Preview (AC2 = 0,69), за ней следовали Qwen3-235B-A22B (0,65) и GPT-4-turbo (0,60). DeepSeek-R1 оказался слабее всех (0,46) и склонен был оценивать исследования как более смещённые, чем люди, возможно из‑за того, что полагался только на извлечение текста и не мог полностью использовать таблицы и иллюстрации. Примечательно, что при анализе только независимых оценок людей до совместного обсуждения их согласие (Kappa Флейсса = 0,49) было сопоставимо с тем, что сообщали для старого инструмента RoB 2.

Что это значит для будущих систематических обзоров

Несмотря на небольшой объём выборки, это пилотное исследование показывает, что несколько современных больших языковых моделей могут достигать по меньшей мере умеренного согласия с рецензентами при применении ROBUST-RCT — более простого инструмента оценки риска смещения в клинических испытаниях. На практике такие модели в будущем могут выступать в роли «третьего рецензента» для разрешения ничьих, отмечать вероятные ошибки или предварительно отсевать исследования, чтобы эксперты‑люди могли сосредоточиться на самых сложных или спорных случаях. Авторы подчёркивают, что ИИ не заменит человеческого суждения, а также указывают на необходимость решения этических вопросов — таких как конфиденциальность данных, обучение на материалах с авторским правом и риск чрезмерного доверия автоматизированным инструментам. Тем не менее результаты указывают на то, что при аккуратном использовании ИИ можно помочь поддерживать систематические обзоры в актуальном состоянии, позволяя клиницистам и экспертным панелям тратить меньше времени на техническую оценку и больше — на интерпретацию того, что совокупность доказательств означает для ухода за пациентами.

Цитирование: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Ключевые слова: риск смещения, клинические испытания, систематические обзоры, большие языковые модели, медицина, основанная на доказательствах