Clear Sky Science · tr

Klinik araştırmaların önyargı riskinin büyük dil modelleri ve ROBUST-RCT ile değerlendirilmesi: bir fizibilite çalışması

Hastalar ve hekimler için bunun önemi

Modern tıp, hangi tedavilerin etkili olduğuna karar vermek için klinik araştırmalara dayanır; ancak iyi tasarlanmış çalışmalar bile önyargı taşıyorsa yanıltıcı olabilir. Her çalışmayı gizli sorunlar açısından dikkatle incelemek yavaş ve karmaşık bir iştir; bu da güncellenmiş tıbbi kılavuzların yıllarca gecikmesine yol açabilir. Bu çalışma, gelişmiş metin okuma ve analiz yeteneğine sahip büyük dil modellerinin—insanlarla birlikte—daha hızlı ve tutarlı şekilde klinik araştırmaların güvenilirliğini değerlendirip değerlendiremeyeceğini, daha yeni ve daha basit bir araç olan ROBUST-RCT kullanarak araştırıyor.

Bugün çalışma kalitesi nasıl değerlendirilir

Klinik çalışmalar sıklıkla altın standart olarak adlandırılır; yine de tasarım kusurları, yetersiz raporlama veya seçici analiz gibi faktörlerle çarpıtılabilirler. Bu sorunları tespit etmek için değerlendiriciler genellikle Cochrane’ın Risk of Bias 2 (RoB 2) kontrol listesini kullanır. RoB 2 titiz olmakla birlikte zaman alıcıdır, uzmanlar için bile uygulaması zordur ve farklı değerlendiriciler arasında uzlaşma sadece orta düzeydedir. Öte yandan her yıl yayımlanan çalışma sayısı artarken, sistematik derlemelere dahil edilen çalışma sayısı aynı hızda artmıyor ve birçok derleme yayımlandığında zaten güncelliğini yitirmiş oluyor. Bu büyüyen uçurum, daha kullanışlı araçlara ve yapay zekâ gibi teknolojik yardıma ilgi uyandırdı.

Yeni bir araç ve yapay zekânın rolü

ROBUST-RCT, RoB 2’ye alternatif olarak yakın zamanda geliştirilmiş bir araçtır. Olası her önyargı kaynağını yakalamaya çalışmak yerine, hem yaygın hem de tedavi etkilerini çarpıtmayla güçlü bir şekilde ilişkili altı temel öğeye odaklanır. Araç, epidemiyologlar tarafından sadelik ile bilimsel titizlik arasında bir denge gözetilerek tasarlandı ve genç değerlendiricilerle kullanılabilirliği test edildi. ROBUST-RCT, RoB 2’den daha yeni ve daha az tanınmış olduğundan, yazarlar burada bir fırsat gördüler: bu sadeleştirilmiş kontrol listesini büyük dil modelleriyle birleştirip yapay zekânın insan değerlendiricilere güvenilir şekilde yardımcı olup olamayacağını incelemek.

Araştırmacıların aslında neyi test ettiği

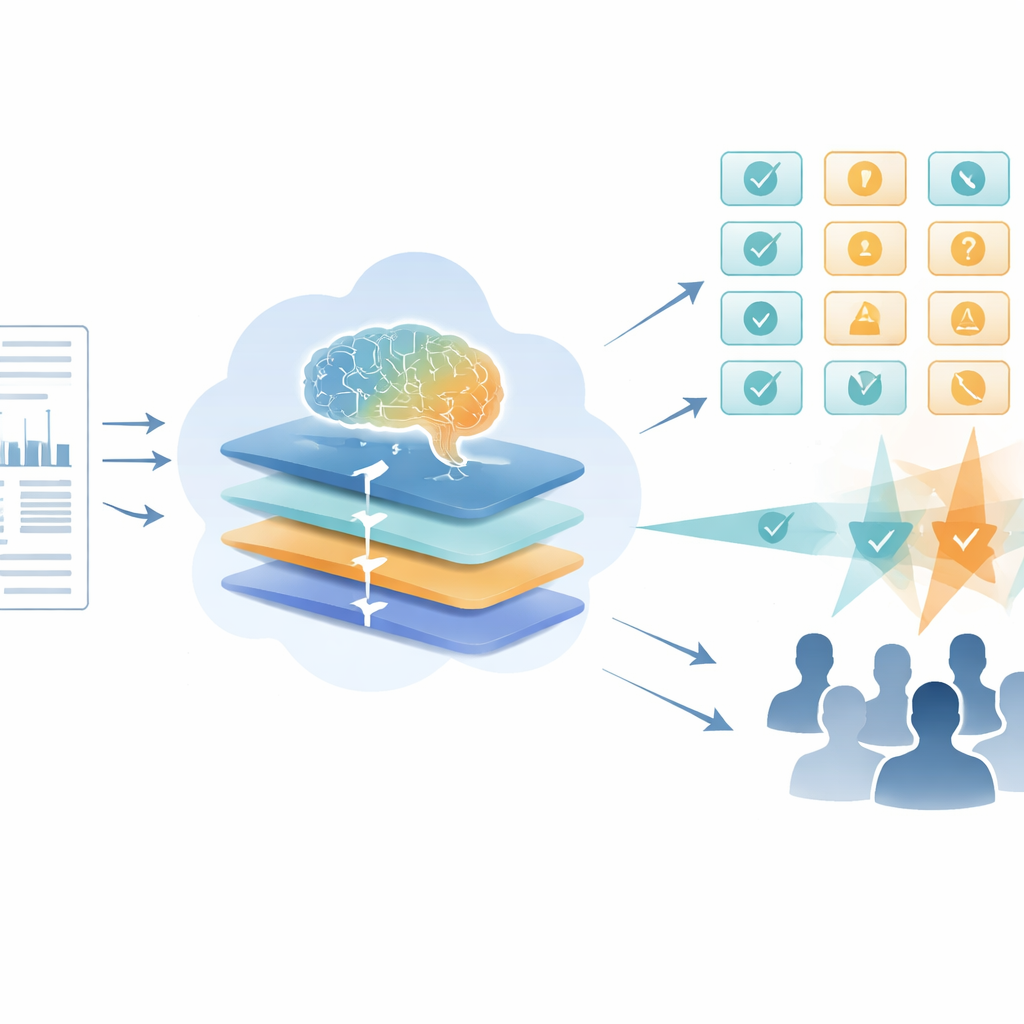

Araştırma ekibi PubMed Central’da indekslenmiş 20 ilaç çalışmasını rastgele seçti ve dışlamalardan sonra ayrıntılı analiz için 9 randomize kontrollü çalışmayla çalıştı. Üç erken kariyer tıp araştırıcısı, her çalışmanın birincil sonucunu ROBUST-RCT el kitabını kullanarak bağımsız şekilde puanladı ve sonra görüş ayrılıklarını uzlaşma toplantılarında çözdü. Paralel olarak, GPT-4-turbo, Gemini 2.5 Pro Preview, DeepSeek-R1 ve Qwen3-235B-A22B olmak üzere dört farklı büyük dil modeline tam çalışma PDF’leri ile ROBUST-RCT’nin nasıl uygulanacağını adım adım açıklayan ayrıntılı bir talimat istemi verildi. Temel soru şuydu: her bir yapay zekânın nihai puanlamaları, aracın altı ana öğesi açısından insan uzlaşmasıyla ne kadar örtüşüyordu?

Yapay zekâların insanlarla uyumu ne düzeydeydi

Uyumu nicelleştirmek için yazarlar Gwet’in AC2 istatistiğini kullandı; bu istatistik daha tanıdık Kappa skorlarına kıyasla iyileştirmeler sunar ve düzensiz puanlama dağılımlarını daha iyi ele alır. 54 eşleştirilmiş insan–yapay zekâ karşılaştırması boyunca dört modelden üçü, olasılıksal olarak kıyaslandığında en az “orta” düzeyde güvenilirlik elde etti; yani puanlamaları sıklıkla insan uzlaşmasıyla benzerdi ve büyük anlaşmazlıklar nispeten nadirdi. En iyi performansı Gemini 2.5 Pro Preview gösterdi (AC2 = 0,69), bunu Qwen3-235B-A22B (0,65) ve GPT-4-turbo (0,60) izledi. DeepSeek-R1 en zayıf (0,46) çıktı ve insanlara göre daha önyargılı puanlama eğilimindeydi; bunun nedeni muhtemelen yalnızca metin çıkarımına dayanması ve tablolar ile şekilleri tam olarak kullanamamasıydı. Dikkate değer olarak, yazarlar sadece tartışma öncesi insan değerlendiricilere baktıklarında, onların kendi uyumları (Fleiss’in Kappa’sı 0,49) eskiden bildirilen RoB 2 aracıyla benzer düzeydeydi.

Gelecekteki kanıt derlemeleri için bunun anlamı

Küçük örneklem büyüklüğüne rağmen bu fizibilite çalışması, mevcut bazı büyük dil modellerinin ROBUST-RCT uygularken insan değerlendiricilerle en azından orta düzeyde uzlaşma sağlayabileceğini gösteriyor; ROBUST-RCT klinik çalışmalar için daha basit bir önyargı riski aracıdır. Uygulamada bu tür modeller nihayetinde bir “üçüncü değerlendirici” olarak eşitlik bozmak, muhtemel hataları işaretlemek veya insan uzmanların en karmaşık ya da tartışmalı vakalara odaklanabilmesi için çalışmaların ön taramasını yapmak üzere hizmet edebilir. Yazarlar, yapay zekânın insan yargısını ikame etmeyeceğini ve veri gizliliği, telifli materyal üzerinde eğitim ve otomatik araçlara aşırı güvenme riski gibi etik konuların ele alınması gerektiğini vurguluyor. Yine de bulgular, dikkatle yönlendirilen yapay zekânın sistematik derlemelerin güncel tutulmasına yardımcı olabileceğini ve hekimlerin ile kılavuz panellerinin teknik puanlamaya daha az, kanıtların bütününün hasta bakımına ne anlama geldiğini yorumlamaya daha fazla zaman ayırmasını sağlayabileceğini öne sürüyor.

Atıf: Vidor, P.R., Casiraghi, Y., de Souza, A.M. et al. Assessing the risk of bias of clinical trials with large language models and ROBUST-RCT: a feasibility study. Sci Rep 16, 13723 (2026). https://doi.org/10.1038/s41598-026-44303-z

Anahtar kelimeler: önyargı riski, klinik çalışmalar, sistematik derlemeler, büyük dil modelleri, kanıta dayalı tıp