Clear Sky Science · zh

数学透明 AI:基于 Transformer 的大语言模型用于数学实体关系抽取及可解释 AI

将文字题转化为数据为何重要

许多人还记得在数学课上为文字题挣扎的经历:关于芒果、队伍或巧克力包的故事,表面上看是生活情境,实际上隐含着方程。计算机处理这些题目更为困难,因为它们必须识别出哪些数字参与其中以及这些数字之间如何相互关联。本文展示了现代语言技术如何读取此类日常数学叙述,推断出隐藏的运算——加法、除法,甚至平方根——并且最关键的是解释它得出该结论的原因。其结果是朝着更智能、更透明的教育和科研工具迈出的一步。

从叙述到结构化数学

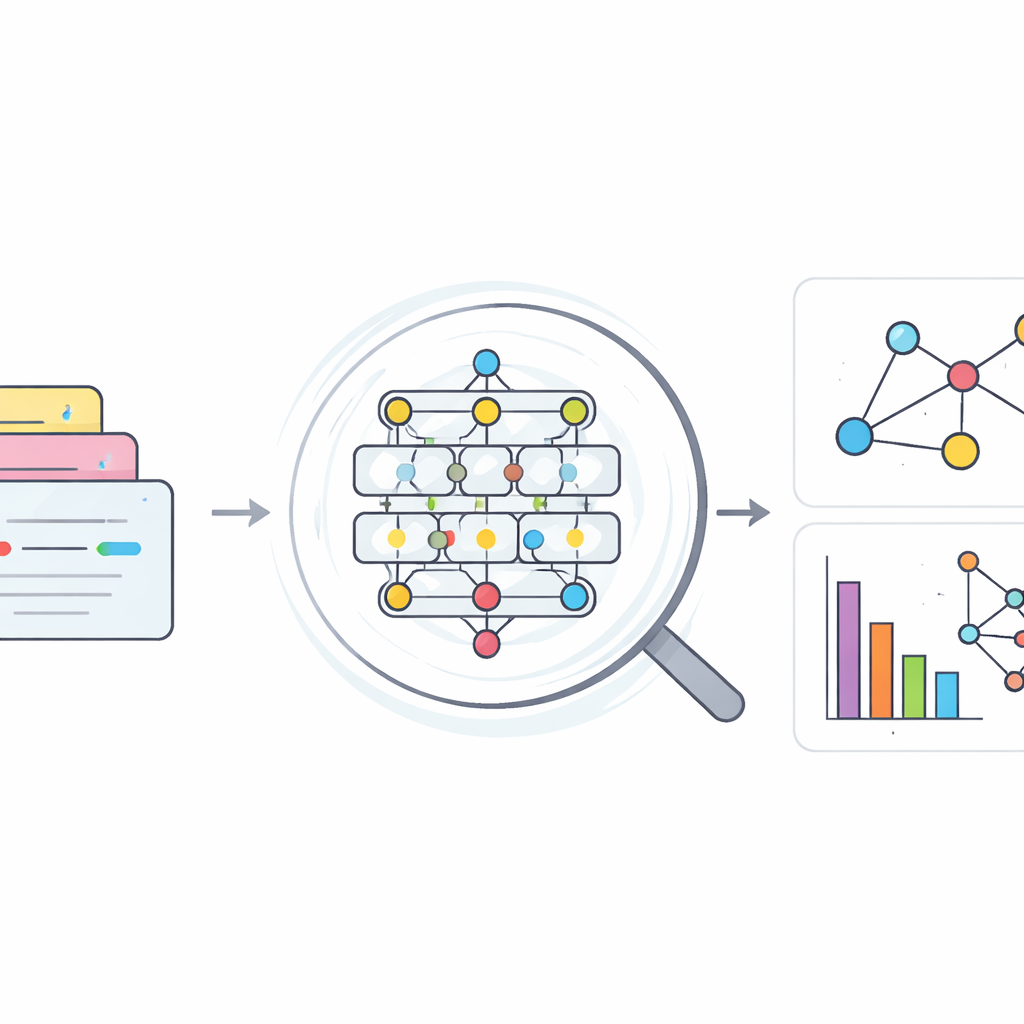

本研究的核心观点是:每个数学文字题都可以看作一个由“实体”和“链接”构成的小型网络。实体是数量(例如“十二个芒果”或“三个孩子”),链接则是连接这些实体的运算(例如除法、加法或开平方)。作者将这些问题视为“实体—关系”任务:数字为实体,运算是它们之间的关系。把凌乱的句子转化为这种简单结构后,计算机可以更接近人类在求解前内部组织问题的方式。这一结构也可为检索工具、知识地图和理解教科书或研究文章中数学文本的自动助手提供支持。

构建日常数学叙述的数据集

为了训练一个能识别这些关系的人工智能系统,研究首先需要示例。作者通过合并两份先前的孟加拉语和英语数学文本集合,组建了一个新数据集。从这些来源中,他们挑选出英文句子,并将像“五千零四十”这样的数字短语作为单一的数学实体仔细标注,而不是分散的词语。每个问题都与其对应的方程配对,将两个关键数量之间的关系标注为六种基本运算之一:加法、减法、乘法、除法、阶乘或平方根。去重、清理无关符号,并通过去停用词和词形还原等步骤简化语言后,最终数据集包含 3,284 条带有明确实体和关系标注的不同数学陈述。

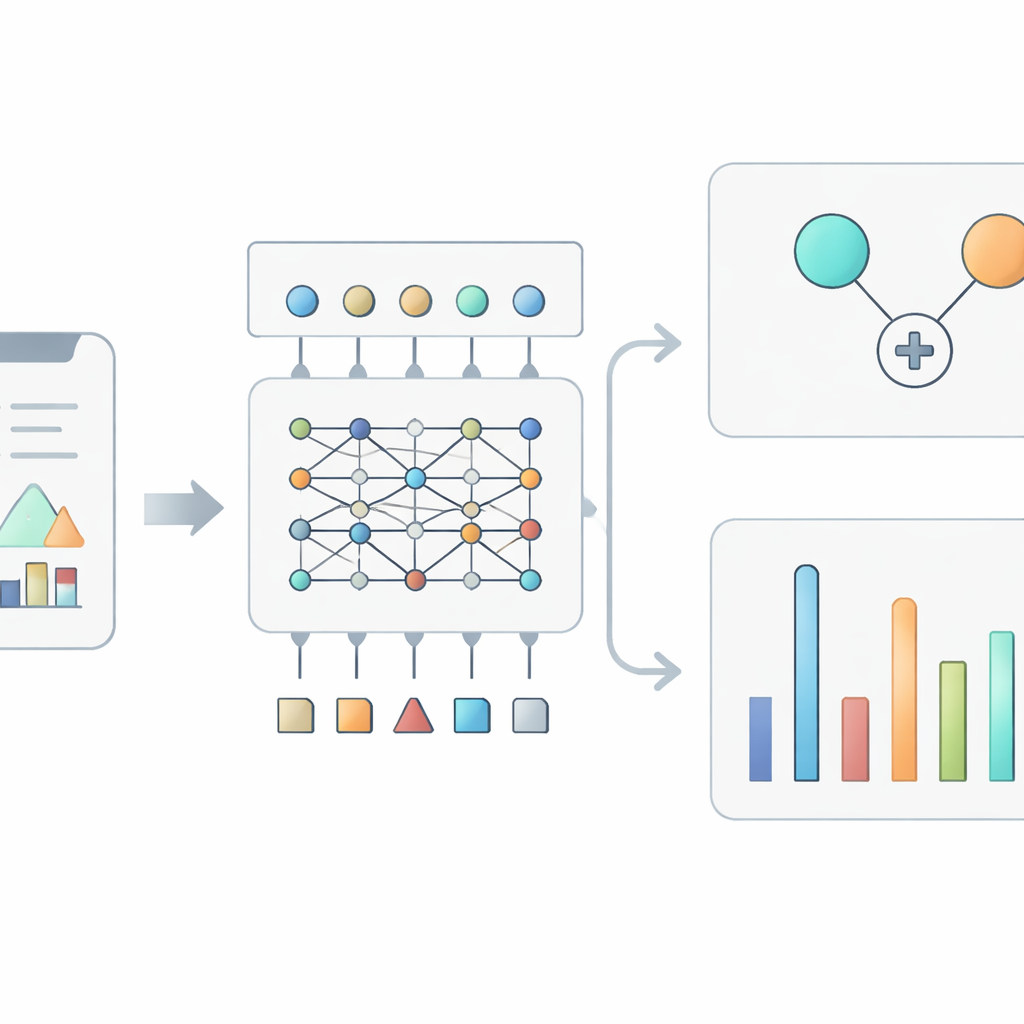

教 Transformer 阅读数学题

数据集准备就绪后,下一步是测试强大的基于 Transformer 的语言模型——即改变了现代自然语言处理领域的一类模型。评估的候选模型包括:BERT、ELECTRA、RoBERTa、ALBERT、DistilBERT 和 XLNet。每个模型接收清理后的文本并进行微调,使其输出不是问题的完整解答,而仅仅是连接两个主要数量的关系类型。评估使用了常见的指标,如在保留测试集上的准确率和 F1 分数。BERT 脱颖而出,几乎在所有情况下都能正确识别关系,准确率达到 99.39%。学习曲线显示模型稳定改进且未出现过拟合,混淆矩阵仅显示少数混淆,主要出现在相似运算之间,例如加法与减法或除法与乘法之间的混淆。

用解释打开黑箱

在 AI 系统用于支持学习或研究时,仅有高准确率还不够。用户需要理解某个预测为何会被做出。为此,作者将可解释 AI 中流行的方法 SHAP 应用于训练好的 BERT 模型。SHAP 为句子中的每个词分配一个贡献分值,反映该词在多大程度上推动模型倾向于或远离某一特定运算。通过将未见过的数学问题输入 SHAP 解释器,研究产生了可视化结果,其中有助判断的词以正向高亮显示,而误导性的词则朝相反方向拉动。例如,“divided(除)”、“equally(平均地)”和“each(每)”等词强烈支持除法预测,而不指向除法的上下文词会降低该信心。在大量示例中,分析显示模型更依赖指示运算的关键词,而非原始数字本身,这与人类在理解题目时寻找诸如“总共”、“从……中”或“平方根”等线索的做法相呼应。

这对未来数学工具的意义

通俗来说,这项工作证明了现代语言模型可以被训练来阅读简短的数学叙述,并几乎完美地识别将数字联系在一起的核心运算,同时以人类可读的方式展示其推理过程。通过将精心构建的数据集、强大的 Transformer 模型与基于 SHAP 的解释相结合,研究提供了一个透明的框架,用于将叙述型数学问题转化为结构化的关系。这种方法可以支撑未来不仅会解题、还能够标出关键短语、支持数学文本自动校验并为学生与研究者构建丰富可导航的数学知识地图的系统。

引用: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

关键词: 数学应用题, Transformer 语言模型, 可解释 AI, 实体关系抽取, SHAP 解释