Clear Sky Science · ja

数学の透明なAI:XAIを用いた数学的実体関係抽出のためのトランスフォーマー系大規模言語モデル

文章題をデータ化することが重要な理由

多くの人が算数の授業で文章題に苦労した記憶を持っています:マンゴーの数やチーム、チョコレートの包みなどの物語の中に方程式が隠れている問題です。コンピュータにとってこれらはさらに難しく、どの数が関与していて、それらがどのように結びつくかを認識しなければなりません。本論文は、現代の言語技術がこうした日常的な数学の物語を読み、隠れた演算(加算、除算、あるいは平方根など)を特定し、そして何よりその結論に至った理由を説明できることを示します。その成果は、教育や科学的作業のためのより賢く透明なツールに向けた一歩です。

物語から構造化された数学へ

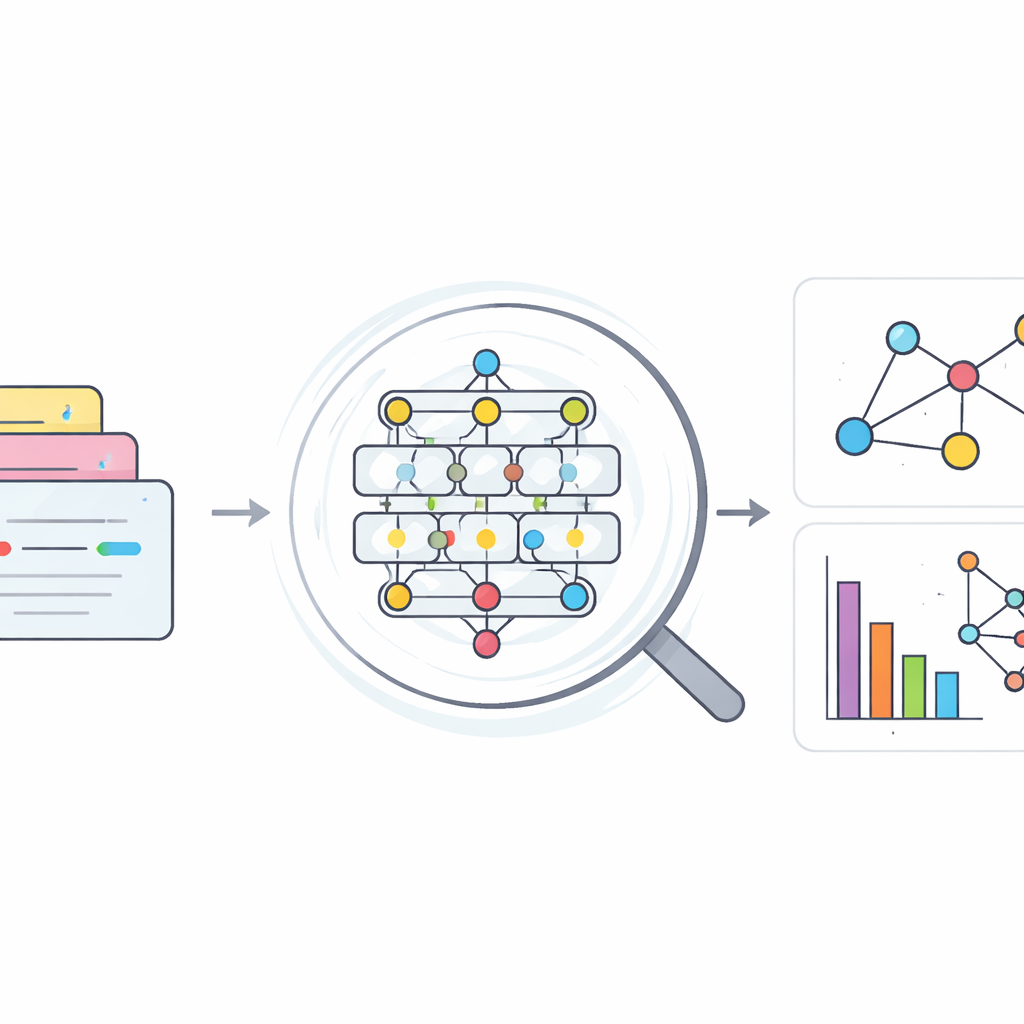

本研究の核心は、各文章題を「もの」と「つながり」の小さなネットワークとして捉えるという考え方です。「もの」は量(「12個のマンゴー」や「3人の子ども」のような)であり、「つながり」はそれらを結ぶ演算(割り算、加算、平方根を取るなど)です。著者はこれらの問題を「実体–関係」タスクとして扱います:数は実体であり、演算がそれらの間の関係です。乱れた文章をこの単純な構造に変換することで、コンピュータは人間が問題を解く前に内部でどのように整理するかに近づくことができます。この構造は検索ツール、ナレッジマップ、教科書や研究論文の数学テキストを理解する自動支援ツールにも応用できます。

日常的な数学物語のデータセット構築

これらの関係を識別するAIを訓練するには、まず例が必要でした。著者はバングラ語と英語の既存コレクションを組み合わせ、新しいデータセットを組み上げました。そこから英語の文を選び、「五千四十」のような数詞句を単なる散在する単語ではなく単一の数学的実体として丁寧に同定しました。各問題は対応する方程式と照合され、二つの主要な量の関係を加算・減算・乗算・除算・階乗・平方根の6つの基本演算のいずれかにラベル付けしました。重複除去や余分な記号のクリーニング、ストップワード除去やレンマ化などによる言語の単純化を経て、最終的なデータセットは3,284件の明確にマークされた実体と関係を含む異なる数学表現を収めました。

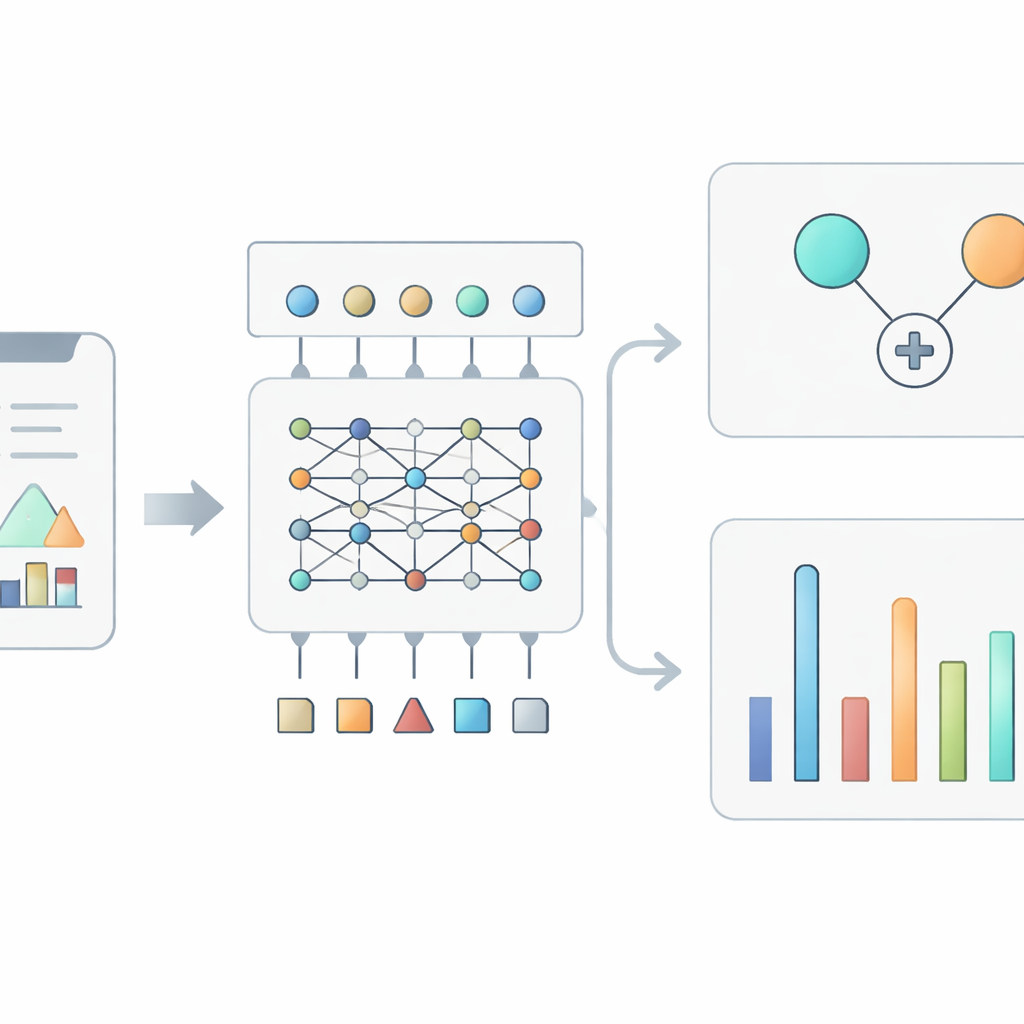

トランスフォーマーに文章題を読ませる

データセットの準備が整うと、次は強力なトランスフォーマー系言語モデルを試す段階です。これは現代の自然言語処理を変えたのと同じ系統のモデル群です。評価対象としてBERT、ELECTRA、RoBERTa、ALBERT、DistilBERT、XLNetが挙げられました。各モデルには前処理済みのテキストが与えられ、出力は問題の完全な解ではなく、二つの主要量を結ぶ関係の種類になるようファインチューニングされました。評価は保持したテストデータ上での精度やF1スコアなどの一般的な指標を用いて行いました。BERTが際立って優れ、ほぼすべてのケースで関係を正しく特定し、精度は99.39%に達しました。学習曲線は過学習なく安定的に改善していることを示し、混同行列では加算と減算や除算と乗算のように類似した演算間での小さな取り違えがわずかに見られるだけでした。

説明でブラックボックスを開く

高い精度だけでは、AIシステムが学習や研究を支援する際に十分とは言えません。利用者は特定の予測がなぜ行われたかを理解する必要があります。これに対処するため、著者は説明可能なAIで広く用いられる手法であるSHAPを学習済みBERTモデルに適用しました。SHAPは文中の各単語に対して、その単語が特定の演算に対してモデルをどれだけ押し上げるかあるいは押し下げるかを示す寄与スコアを割り当てます。未知の文章題をSHAP説明器に通すことで、有益な語が正方向に強く輝き、誤解を招く語が反対方向に引っ張るような可視化を生成しました。例えば「divided(割られる)」「equally(等しく)」「each(それぞれ)」のような語は除算予測を強く支持する一方、除算を示さない文脈語はその確信度を下げます。多数の例を通しての解析は、モデルが生の数値そのものよりも演算を示す語により依存していることを示し、問題を解釈する際に人間が「合計」「から」「平方根」などの手がかりをざっと探すのと類似した挙動を反映していました。

今後の数学ツールにとっての意味

平たく言えば、本研究は現代の言語モデルが短い数学物語を読み、数を結びつける核となる演算をほぼ完全に識別すると同時に、その推論過程を人間にも読み取れる形で示せることを実証しました。入念なデータセット構築、強力なトランスフォーマーモデル、SHAPに基づく説明を組み合わせることで、記述的な文章題を構造化された関係に変換する透明な枠組みを提供します。このアプローチは、問題を解くだけでなく重要なフレーズを強調表示したり、数学テキストの自動チェックを支援したり、学生や研究者のための豊かで探索可能な数学知識マップを構築したりする将来のシステムの基盤となり得ます。

引用: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

キーワード: 算数文章題, トランスフォーマーベース言語モデル, 説明可能なAI, 実体関係抽出, SHAPによる説明