Clear Sky Science · ar

الذكاء الاصطناعي الشفاف للرياضيات: نماذج لغوية كبيرة قائمة على الترانسفورمر لاستخراج علاقات الكيانات الرياضية مع تفسير قابل للشرح

لماذا تحويل مسائل الكلمات إلى بيانات مهم

يتذكر الكثير منا الصعوبة مع مسائل الكلمات في صف الرياضيات: قصص عن منجا، فرق، أو عبوات شوكولاتة التي تصف معادلات ضمنياً. تواجه الحواسيب هذه المسائل بصعوبة أكبر، لأنها يجب أن تتعرّف أي الأرقام معنية وكيف ترتبط. تُظهر هذه الورقة كيف يمكن لتقنية اللغة الحديثة أن تقرأ مثل هذه القصص الرياضية اليومية، وتستنتج العملية المخفية — جمع، قسمة، أو حتى جذور تربيعية — والأهم من ذلك، تشرح لماذا توصلت إلى هذا الاستنتاج. النتيجة هي خطوة نحو أدوات أكثر ذكاءً وشفافية للتعليم والعمل العلمي.

من القصص إلى رياضيات منظمة

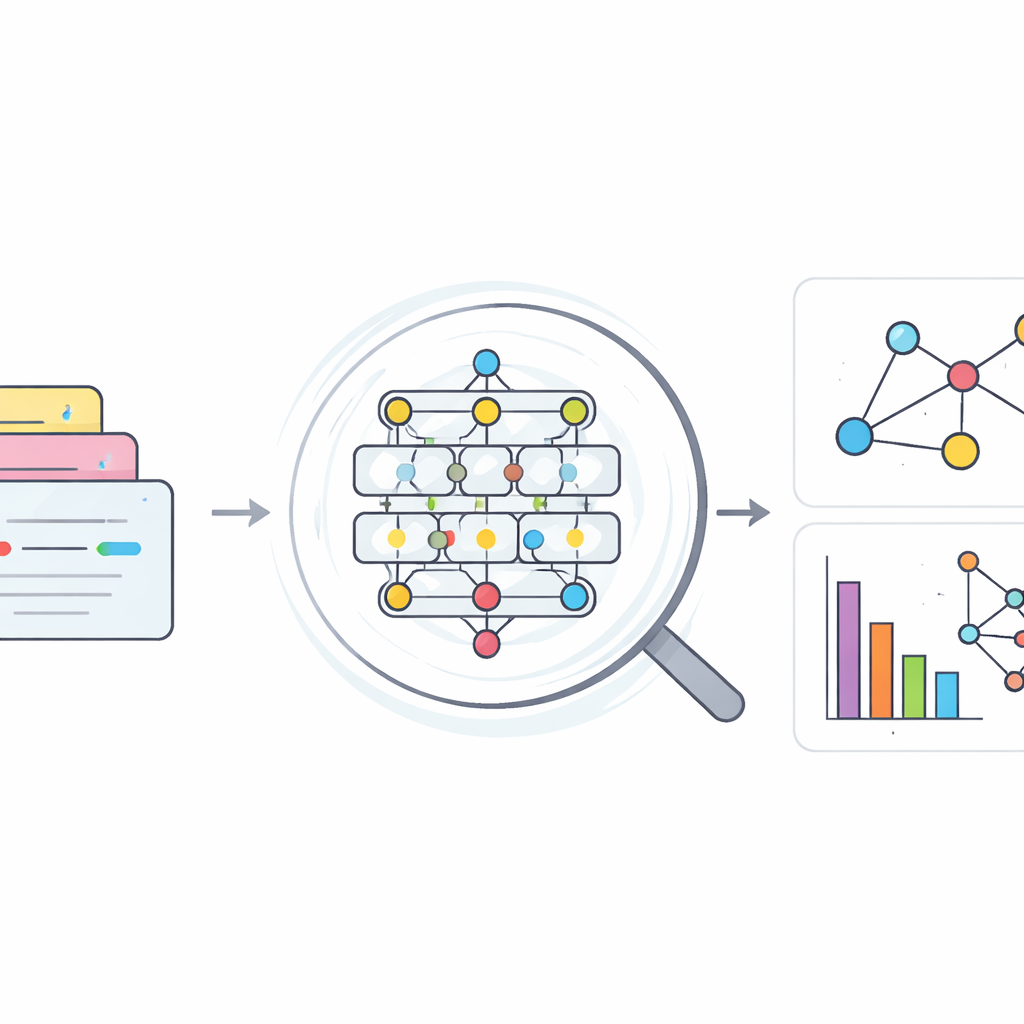

في جوهر هذه الدراسة توجد فكرة مفادها أن كل مسألة كلمات رياضية يمكن رؤيتها كشبكة صغيرة من «كيانات» و«روابط». الكيانات هي الكميات (مثل «اثنا عشر منجاة» أو «ثلاثة أطفال»)، والرابط هو العملية التي تربطها (مثل القسمة، الجمع، أو أخذ الجذر التربيعي). يتعامل المؤلف مع هذه المسائل كمهمة «كيان–علاقة»: الأعداد هي كيانات، والعملية هي العلاقة بينهما. بتحويل الجمل الفوضوية إلى هذا البنية البسيطة، يمكن للحواسيب الاقتراب من الطريقة التي ينظم بها البشر المسألة داخلياً قبل حلها. يمكن لهذه البنية أيضاً تشغيل أدوات بحث، خرائط معرفية، ومساعدين تلقائيين يفهمون النصوص الرياضية في الكتب المدرسية أو المقالات البحثية.

بناء مجموعة بيانات من قصص الرياضيات اليومية

لتدريب نظام ذكاء اصطناعي على التعرف على هذه العلاقات، احتاجت الدراسة أولاً أمثلة. جمع المؤلف مجموعة بيانات جديدة بدمج مجموعتين سابقتين من نصوص رياضية بالبنغالية والإنجليزية. من هذه المصادر، اختاروا جمل إنجليزية وحددوا بعناية عبارات الأعداد مثل «خمسة آلاف وأربعون» كوحدة رياضية واحدة، وليس كلمات متفرقة. تم مطابقة كل مسألة مع معادلتها المقابلة لوضع علامة على العلاقة بين كميتين أساسيتين كواحدة من ست عمليات أساسية: الجمع، الطرح، الضرب، القسمة، العامل المضاعف (الفاكتر، factorial)، أو الجذر التربيعي. بعد إزالة التكرارات، وتنظيف الرموز الشاردة، وتبسيط اللغة عبر خطوات مثل إزالة كلمات الوقف والتشكيل إلى أصل الكلمات، احتوت مجموعة البيانات النهائية على 3,284 عبارة رياضية مميزة مع كيانات وعلاقات معنونة بوضوح.

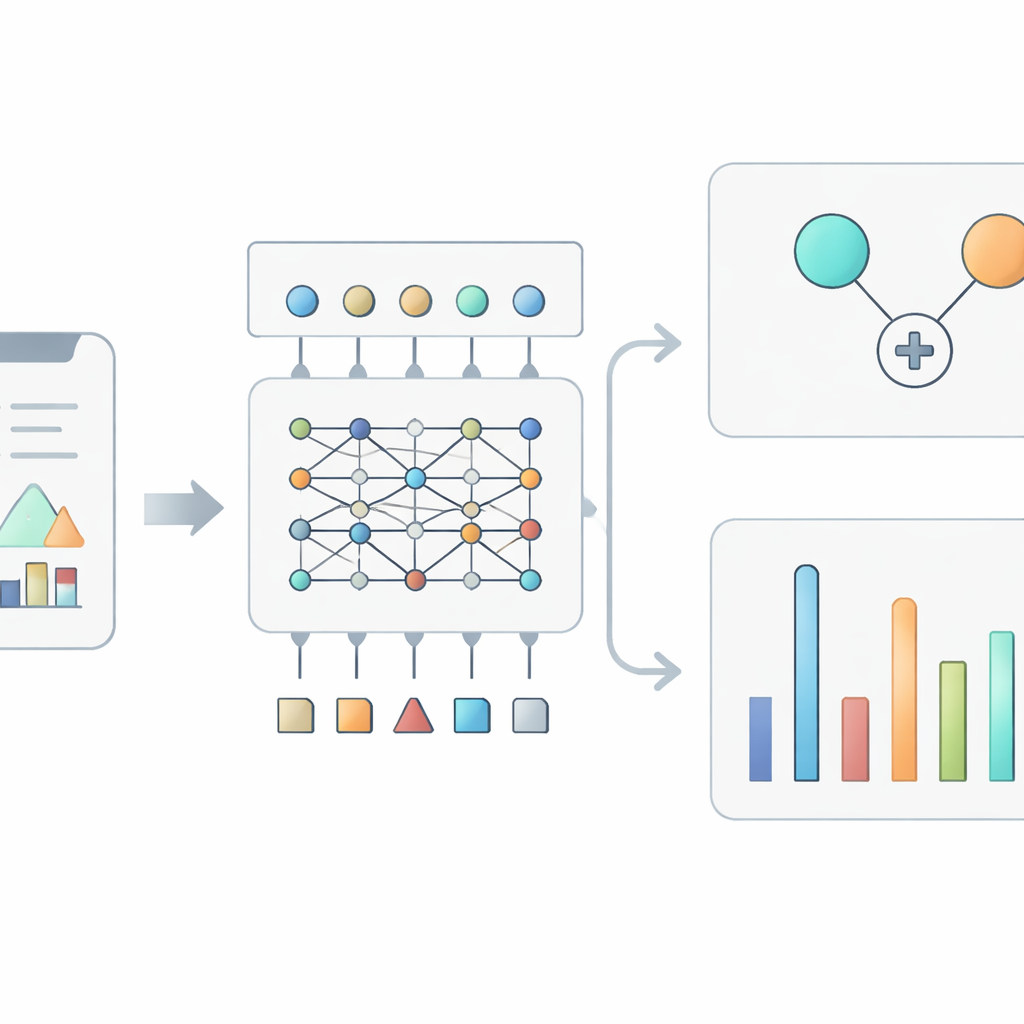

تعليم الترانسفورمر لقراءة مسائل الرياضيات

مع تجهيز مجموعة البيانات، كانت الخطوة التالية اختبار نماذج لغوية قوية قائمة على الترانسفورمر — نفس عائلة النماذج التي غيّرت معالجة اللغة الطبيعية الحديثة. تم تقييم عدة مرشحين: BERT وELECTRA وRoBERTa وALBERT وDistilBERT وXLNet. تلقى كل نموذج النص المنظف وتم تعديل أدائه بدقة بحيث لا ينتج حلا كاملا للمسألة، بل نوع العلاقة التي تربط الكميتين الرئيسيتين. استخدمت التقييم مقاييس شائعة مثل الدقة ومعدلات F1 على بيانات اختبار محجوزة. برز BERT كالفائز الواضح، مع تحديد العلاقة بشكل صحيح في معظم الحالات، بدقة بلغت 99.39%. أظهرت منحنيات التعلم أن النموذج تحسن بثبات دون فرط التكيّف، وكشف مصفوفة الارتباك عن عدد قليل فقط من الأخطاء، معظمها بين عمليات متشابهة مثل الجمع والطرح أو القسمة والضرب.

فتح الصندوق الأسود عبر التفسيرات

الدقة العالية وحدها لا تكفي عندما يُتوقع من أنظمة الذكاء الاصطناعي دعم التعلم أو البحث. يحتاج المستخدمون إلى فهم سبب صدور توقع معين. للتعامل مع ذلك، طبق المؤلف SHAP، وهي طريقة شائعة من مجال الذكاء القابل للتفسير، على نموذج BERT المدرب. تُسند SHAP لكل كلمة في الجملة درجة مساهمة تعكس مقدار ما تدفعه الكلمة النموذج نحو أو بعيداً عن عملية معينة. عبر تغذية مسكلات رياضية غير مرئية إلى مفسر SHAP، أنتجت الدراسة تصورات حيث تتوهج الكلمات المساعدة بشكل إيجابي وتجر الكلمات المضللة في الاتجاه المعاكس. على سبيل المثال، تدعم كلمات مثل «مقسم»، «بشكل متساوٍ»، و«لكل» توقع القسمة بقوة، بينما تقلل الكلمات السياقية التي لا تشير إلى القسمة من هذا الثقة. عبر العديد من الأمثلة، أظهر التحليل أن النموذج اعتمد أكثر على الكلمات المؤشرة للعملية منه على الأرقام الخام نفسها، وهو ما يعكس كيفية مسح البشر للبحث عن دلائل مثل «المجموع»، «من»، أو «الجذر التربيعي» عند تفسير المسألة.

ما يعنيه هذا لأدوات الرياضيات المستقبلية

بعبارات بسيطة، تُظهر هذه العمل أن نموذجاً لغوياً حديثاً يمكن تدريبه لقراءة قصص رياضية قصيرة وتحديد العملية الأساسية التي تربط الأرقام معاً تقريباً بشكل مثالي، مع عرض سبب ذلك بطريقة مفهومة للبشر. من خلال الجمع بين بناء مجموعة بيانات بعناية، نموذج ترانسفورمر قوي، وتفسيرات قائمة على SHAP، تقدم الدراسة إطاراً شفافاً لتحويل المسائل السردية إلى علاقات منظمة. قد يقوم هذا النهج بدعم أنظمة مستقبلية لا تكتفي بحل المسائل، بل تبرز أيضاً العبارات الرئيسية المهمة، وتدعم التدقيق التلقائي للنصوص الرياضية، وتبني خرائط معرفية غنية وقابلة للتنقل للطلاب والباحثين على حد سواء.

الاستشهاد: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

الكلمات المفتاحية: مسائل الكلمات الرياضية, نماذج لغوية ترانسفورمر, الذكاء القابل للتفسير, استخراج علاقات الكيانات, تفسيرات SHAP