Clear Sky Science · nl

Transparante AI voor wiskunde: transformer-gebaseerde grote taalmodellen voor het extraheren van relaties tussen wiskundige entiteiten met XAI

Waarom het omzetten van woordproblemen naar data ertoe doet

Velen van ons herinneren zich het worstelen met woordproblemen op school: verhaaltjes over mango’s, teams of zakjes chocolade die in feite vergelijkingen beschrijven. Voor computers zijn deze problemen nog moeilijker, omdat ze moeten herkennen welke getallen betrokken zijn en hoe die met elkaar verbonden zijn. Dit artikel toont aan hoe moderne taaltechnologie zulke alledaagse wiskundeverhalen kan lezen, de verborgen bewerking kan bepalen — optellen, delen of zelfs worteltrekken — en, belangrijk, kan uitleggen waarom die conclusie is getrokken. Het resultaat is een stap richting slimmere, meer transparante hulpmiddelen voor onderwijs en wetenschappelijk werk.

Van verhalend naar gestructureerd wiskunde

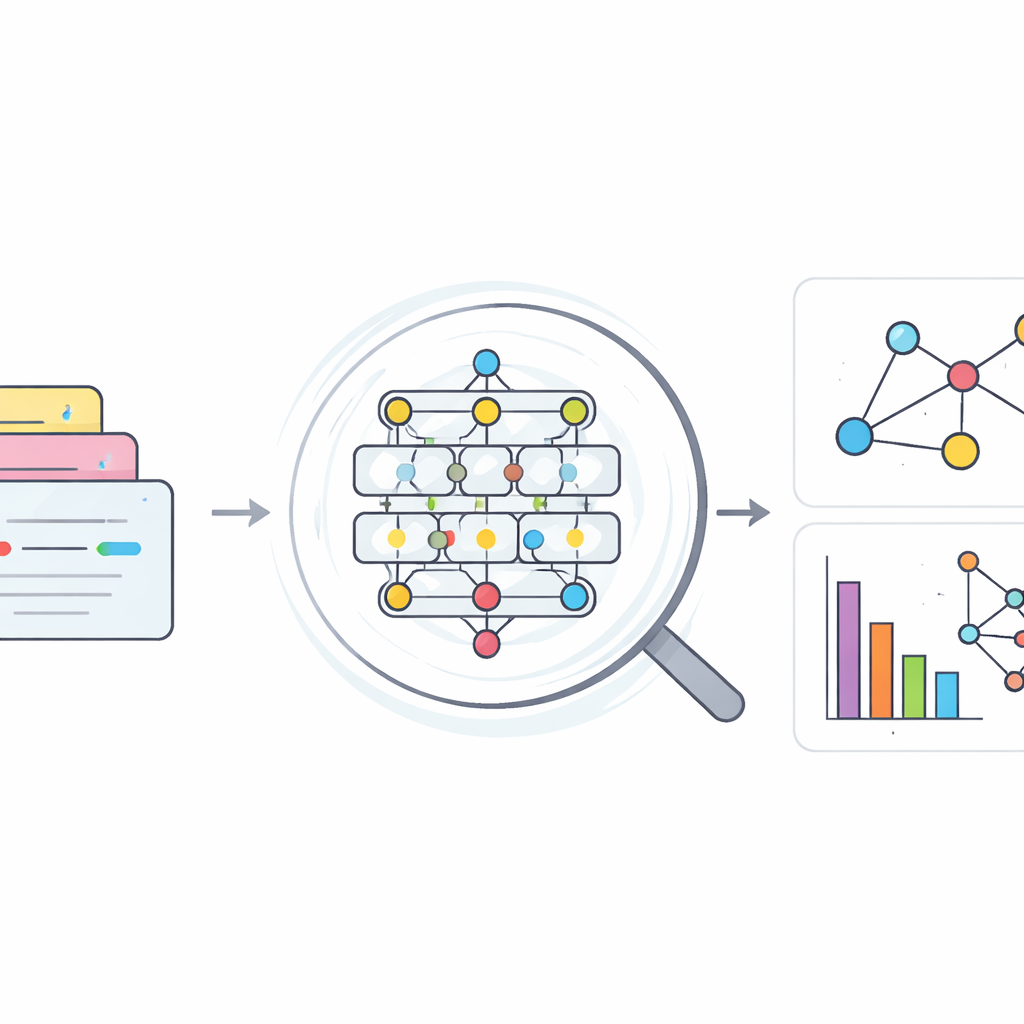

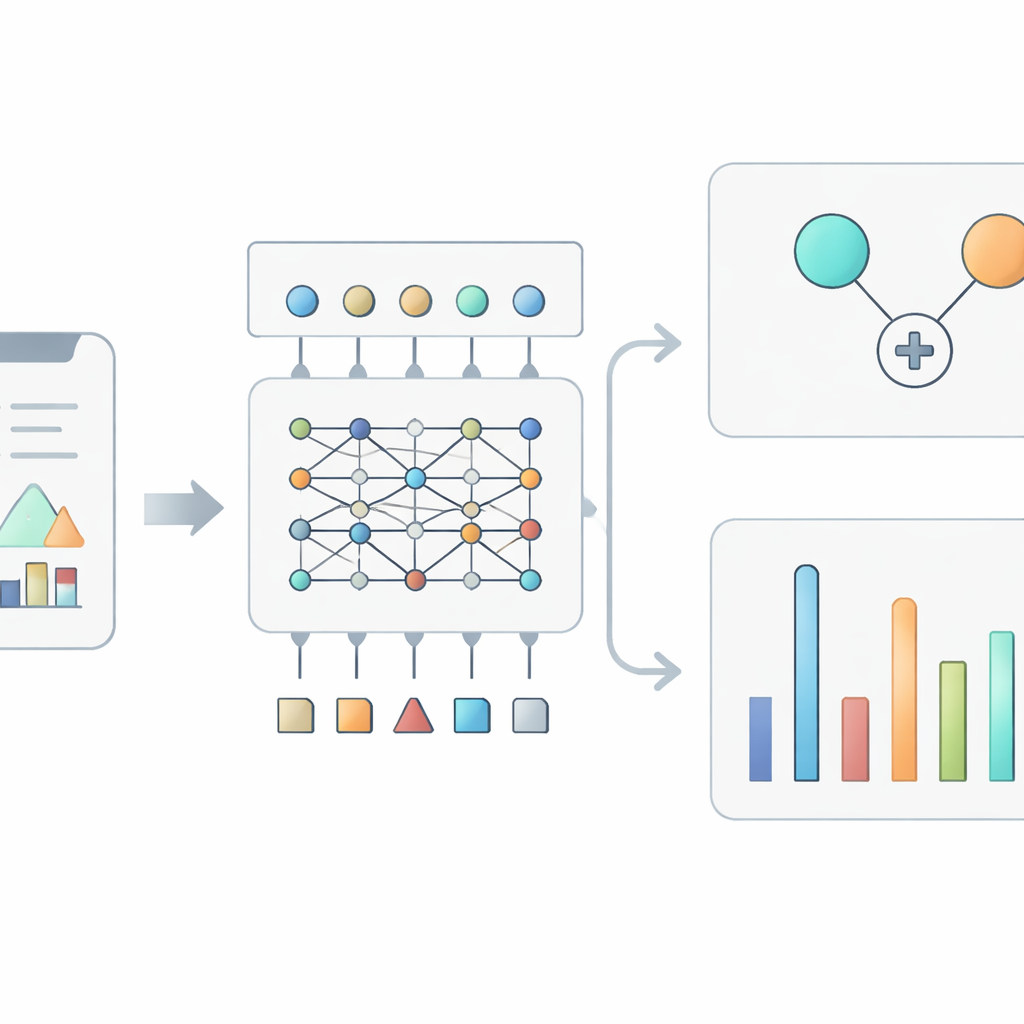

Centraal in deze studie staat het idee dat elk wiskundig woordprobleem kan worden gezien als een klein netwerk van “dingen” en “verbindingen”. De dingen zijn de grootheden (zoals “twaalf mango’s” of “drie kinderen”), en de verbinding is de bewerking die ze koppelt (zoals delen, optellen of worteltrekken). De auteur behandelt deze problemen als een taak van “entiteit–relatie”: de getallen zijn entiteiten en de bewerking is de relatie daartussen. Door rommelige zinnen in deze eenvoudige structuur om te zetten, kunnen computers dichterbij komen hoe mensen een wiskundeprobleem intern ordenen voordat ze het oplossen. Deze structuur kan ook zoektools, kenniskaarten en automatische assistenten aandrijven die wiskundige tekst in leerboeken of wetenschappelijke artikelen begrijpen.

Het opbouwen van een dataset van alledaagse wiskundeverhalen

Om een kunstmatige intelligentiesysteem te trainen om deze relaties te herkennen, had de studie eerst voorbeelden nodig. De auteur stelde een nieuwe dataset samen door twee eerdere verzamelingen van Bangla- en Engelstalige wiskundige teksten te combineren. Uit deze bronnen selecteerden ze Engelse zinnen en identificeerden zorgvuldig cijferuitdrukkingen zoals “vijfduizend en veertig” als één enkele wiskundige entiteit, niet slechts verspreide woorden. Elk probleem werd gekoppeld aan de bijbehorende vergelijking om de relatie tussen twee sleutelgrootheden te labelen als een van zes basisbewerkingen: optellen, aftrekken, vermenigvuldigen, delen, faculteit of worteltrekken. Na het verwijderen van duplicaten, het opschonen van vreemde symbolen en het vereenvoudigen van de taal door stappen zoals stopwoordverwijdering en lemmatisering, bevatte de uiteindelijke dataset 3.284 onderscheidende wiskundige uitspraken met duidelijk gemarkeerde entiteiten en relaties.

Transformers leren wiskundeproblemen lezen

Met de dataset gereed was de volgende stap het testen van krachtige transformer-gebaseerde taalmodellen — dezelfde modelfamilie die de moderne natuurlijke taalverwerking heeft veranderd. Verschillende kandidaten werden geëvalueerd: BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT en XLNet. Elk model kreeg de opgeschoonde tekst en werd fijngestemd zodat de output geen volledige oplossing van het probleem was, maar eenvoudigweg het type relatie dat de twee belangrijkste grootheden verbindt. De evaluatie gebruikte gangbare maatstaven zoals nauwkeurigheid en F1-scores op apart gehouden testdata. BERT bleek duidelijk de beste, en identificeerde bijna altijd juist de relatie, met een nauwkeurigheid van 99,39%. De leercurves toonden dat het model gestaag verbeterde zonder overfitting, en een verwarringsmatrix liet slechts een handvol verwisselingen zien, voornamelijk tussen vergelijkbare bewerkingen zoals optellen en aftrekken of delen en vermenigvuldigen.

De zwarte doos openen met verklaringen

Hoge nauwkeurigheid alleen is niet voldoende wanneer AI-systemen bedoeld zijn om leren of onderzoek te ondersteunen. Gebruikers moeten begrijpen waarom een bepaalde voorspelling is gedaan. Om dit aan te pakken paste de auteur SHAP toe, een veelgebruikte methode uit uitlegbare AI, op het getrainde BERT-model. SHAP kent elk woord in een zin een bijdragen-score toe die aangeeft hoeveel het het model naar of weg van een specifieke bewerking duwt. Door onzichtbare wiskundeproblemen door een SHAP-explainer te voeren, produceerde de studie visualisaties waarbij behulpzame woorden positief oplichten en misleidende woorden in de tegengestelde richting trekken. Woorden zoals “gedeeld”, “gelijk” en “elk” ondersteunen bijvoorbeeld sterk een delingsvoorspelling, terwijl contextwoorden die niet op delen wijzen dat vertrouwen verminderen. Over veel voorbeelden heen toonde de analyse dat het model meer leunde op bewerkingsindicatoren dan op de ruwe getallen zelf, wat weerspiegelt hoe mensen naar aanwijzingen scannen zoals “totaal”, “van” of “wortel” bij het interpreteren van een probleem.

Wat dit betekent voor toekomstige wiskundehulpmiddelen

In eenvoudige bewoordingen laat dit werk zien dat een modern taalmodel getraind kan worden om korte wiskundeverhalen te lezen en vrijwel perfect de kernbewerking te identificeren die de getallen verbindt, terwijl het ook zijn redenering op een voor mensen leesbare manier toont. Door zorgvuldige datasetconstructie, een sterk transformer-model en SHAP-gebaseerde verklaringen te combineren, biedt de studie een transparant kader om verhalende wiskundeproblemen om te zetten in gestructureerde relaties. Deze benadering kan de basis vormen voor toekomstige systemen die niet alleen problemen oplossen, maar ook de sleutelzinnen markeren die ertoe doen, geautomatiseerde controle van wiskundige teksten ondersteunen en rijke, navigeerbare kaarten van wiskundige kennis bouwen voor studenten en onderzoekers.

Bronvermelding: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Trefwoorden: woordproblemen in wiskunde, transformer-taalmodellen, uitlegbare AI, extractie van entiteit-relaties, SHAP-verklaringen