Clear Sky Science · de

Transparente KI für Mathematik: transformer-basierte Large Language Models zur Extraktion mathematischer Entitätsbeziehungen mit XAI

Warum die Umwandlung von Textaufgaben in Daten wichtig ist

Viele von uns erinnern sich daran, wie schwer Textaufgaben im Mathematikunterricht fallen: Geschichten über Mangos, Teams oder Schachteln Pralinen, die in Wahrheit Gleichungen beschreiben. Für Computer sind diese Aufgaben noch schwieriger, weil sie erkennen müssen, welche Zahlen relevant sind und wie sie zusammenhängen. Diese Arbeit zeigt, wie moderne Sprachtechnologie solche alltäglichen Mathegeschichten lesen, die zugrundeliegende Operation — Addition, Division oder sogar Quadratwurzeln — erkennen und vor allem erklären kann, warum sie zu dieser Schlussfolgerung gelangt. Das Ergebnis ist ein Schritt hin zu intelligenteren, transparenteren Werkzeugen für Bildung und wissenschaftliche Arbeit.

Von Geschichten zu strukturierter Mathematik

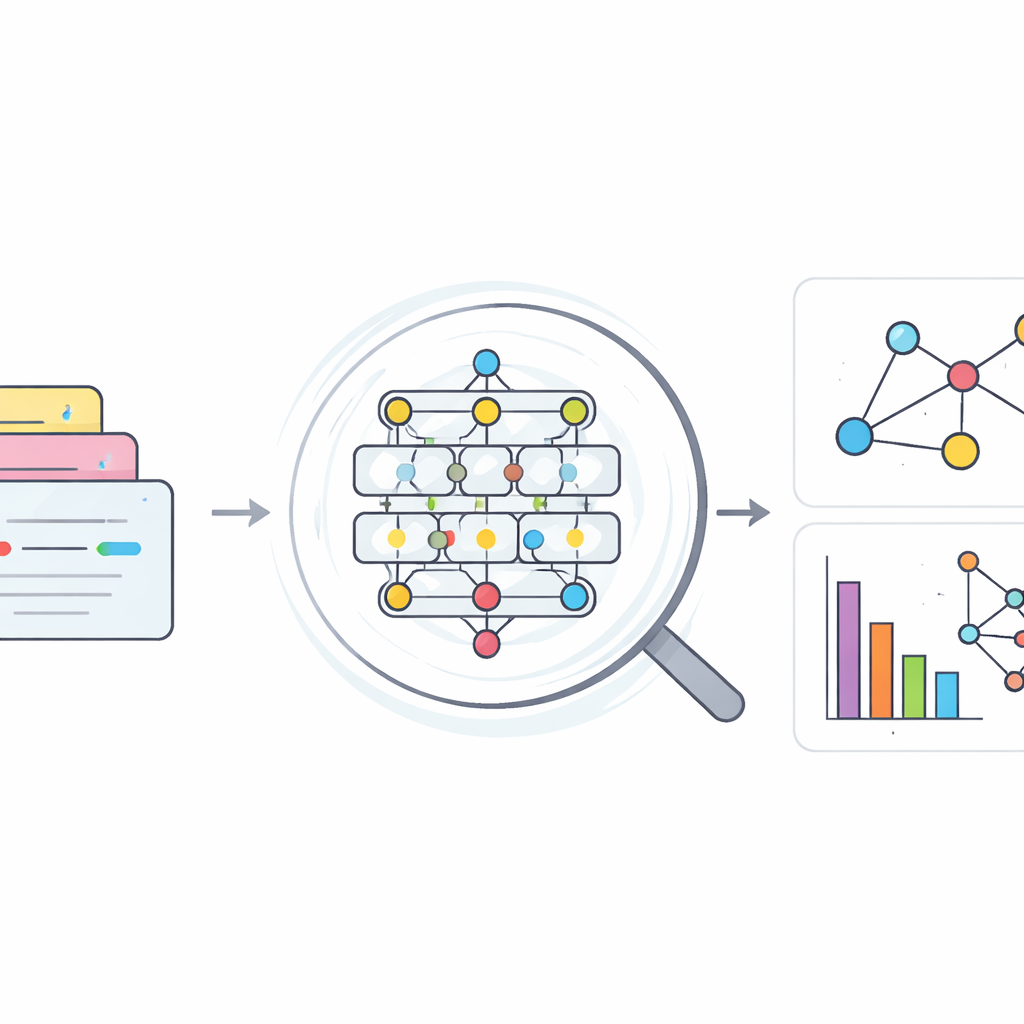

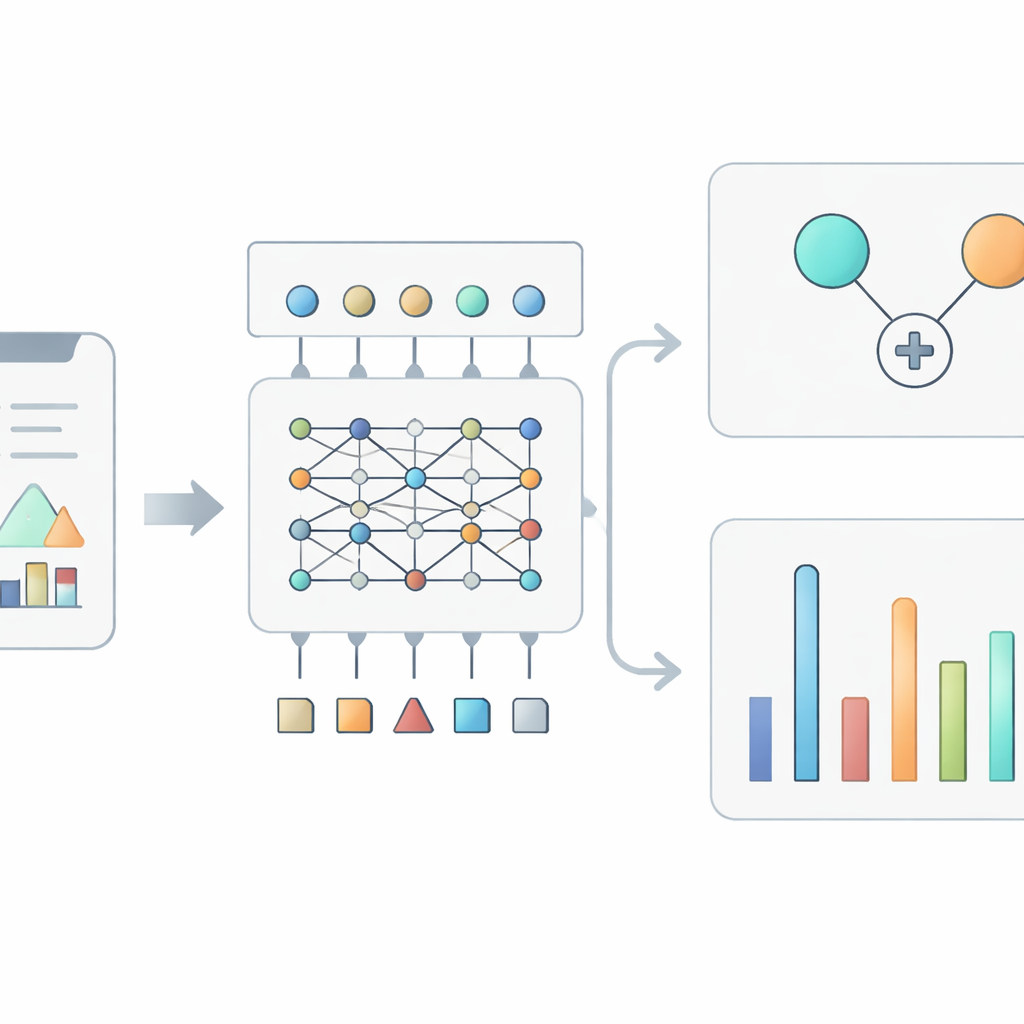

Im Zentrum dieser Studie steht die Idee, dass jede Textaufgabe als kleines Netzwerk von „Dingen“ und „Verbindungen“ betrachtet werden kann. Die Dinge sind die Größen (wie „zwölf Mangos“ oder „drei Kinder“), die Verbindung ist die Operation, die sie verknüpft (etwa Teilen, Addieren oder Ziehen der Quadratwurzel). Der Autor behandelt diese Aufgaben als eine Entitäts–Beziehungs-Aufgabe: die Zahlen sind Entitäten und die Operation ist die Beziehung zwischen ihnen. Indem man unordentliche Sätze in diese einfache Struktur überführt, können Computer dem näherkommen, wie Menschen ein mathematisches Problem innerlich organisieren, bevor sie es lösen. Diese Struktur kann zudem Suchwerkzeuge, Wissenslandkarten und automatische Hilfen antreiben, die mathematischen Text in Lehrbüchern oder Forschungsartikeln verstehen.

Aufbau eines Datensatzes aus alltäglichen Mathegeschichten

Um ein KI-System zu trainieren, diese Beziehungen zu erkennen, benötigte die Studie zunächst Beispiele. Der Autor stellte einen neuen Datensatz zusammen, indem er zwei frühere Sammlungen von bengalischen und englischen mathematischen Texten kombinierte. Aus diesen Quellen wählte er englische Sätze aus und identifizierte sorgfältig Zahlphrasen wie „five thousand and forty“ als einzelne mathematische Entitäten, nicht nur als verstreute Wörter. Jede Aufgabe wurde mit der zugehörigen Gleichung abgeglichen, um die Beziehung zwischen zwei Schlüsselgrößen als eine von sechs Grundoperationen zu kennzeichnen: Addition, Subtraktion, Multiplikation, Division, Fakultät oder Quadratwurzel. Nach dem Entfernen von Duplikaten, Bereinigen von Störzeichen und Vereinfachen der Sprache durch Schritte wie Stopwort-Entfernung und Lemmatisierung enthielt der endgültige Datensatz 3.284 eindeutige Mathe-Aussagen mit klar markierten Entitäten und Beziehungen.

Transformern beibringen, Matheaufgaben zu lesen

Mit vorbereitetem Datensatz war der nächste Schritt, leistungsfähige transformer-basierte Sprachmodelle zu testen — dieselbe Modellfamilie, die die moderne Verarbeitung natürlicher Sprache revolutioniert hat. Mehrere Kandidaten wurden evaluiert: BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT und XLNet. Jedes Modell erhielt den bereinigten Text und wurde so feinjustiert, dass seine Ausgabe keine vollständige Lösung darstellte, sondern lediglich den Typ der Beziehung zwischen den beiden Hauptgrößen. Bewertet wurde mit gebräuchlichen Metriken wie Genauigkeit und F1-Werten auf einem separaten Testdatensatz. BERT erwies sich als klarer Sieger und identifizierte die Beziehung in nahezu jedem Fall korrekt, mit einer Genauigkeit von 99,39 %. Die Lernkurven zeigten, dass das Modell stetig besser wurde, ohne zu überfitten, und eine Konfusionsmatrix offenbarte nur eine Handvoll Verwechslungen, meist zwischen ähnlichen Operationen wie Addition und Subtraktion oder Division und Multiplikation.

Die Blackbox mit Erklärungen öffnen

Hohe Genauigkeit allein reicht nicht aus, wenn KI-Systeme Lernende oder Forschende unterstützen sollen. Nutzer müssen verstehen, warum eine bestimmte Vorhersage getroffen wurde. Um dem begegnen, wandte der Autor SHAP an, eine verbreitete Methode aus der erklärbaren KI, auf das trainierte BERT-Modell. SHAP weist jedem Wort in einem Satz einen Beitragsscore zu, der widerspiegelt, wie sehr es das Modell in Richtung einer konkreten Operation zieht bzw. davon wegdrückt. Indem unbekannte Matheaufgaben durch einen SHAP-Erklärer geführt wurden, erzeugte die Studie Visualisierungen, in denen hilfreiche Wörter positiv hervorgehoben sind und irreführende Wörter in die entgegengesetzte Richtung ziehen. Worte wie „divided“, „equally“ und „each“ unterstützen beispielsweise stark eine Division-Vorhersage, während kontextuelle Wörter, die nicht auf Division hinweisen, diese Wahrscheinlichkeit verringern.Über viele Beispiele hinweg zeigte die Analyse, dass das Modell sich mehr an operationsanzeigenden Wörtern orientierte als an den reinen Zahlen selbst — ähnlich wie Menschen nach Hinweisen wie „total“, „from“ oder „square root“ suchen, wenn sie eine Aufgabe interpretieren.

Was das für künftige Mathe-Werkzeuge bedeutet

Einfach gesagt demonstriert diese Arbeit, dass ein modernes Sprachmodell darauf trainiert werden kann, kurze Mathegeschichten zu lesen und nahezu perfekt die Kernoperation zu identifizieren, die die Zahlen verbindet, und zugleich seine Schlussfolgerung in menschenlesbarer Form darzustellen. Durch die Kombination sorgfältiger Datensatzkonstruktion, eines starken Transformer-Modells und SHAP-basierter Erklärungen bietet die Studie einen transparenten Rahmen, um narrative Matheaufgaben in strukturierte Beziehungen zu überführen. Dieser Ansatz könnte künftige Systeme tragen, die nicht nur Probleme lösen, sondern auch die relevanten Phrasen hervorheben, die automatische Überprüfung mathematischer Texte unterstützen und reichhaltige, navigierbare Wissenslandkarten der Mathematik für Lernende und Forschende aufbauen.

Zitation: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Schlüsselwörter: Mathe-Textaufgaben, Transformer-Sprachmodelle, erklärbare KI, Entitätsbeziehungs-Extraktion, SHAP-Erklärungen