Clear Sky Science · fr

IA transparente pour les mathématiques : modèles de langage de grande taille basés sur des transformers pour l’extraction des relations entre entités mathématiques avec XAI

Pourquoi convertir les problèmes en texte en données importe

Beaucoup d’entre nous se souviennent d’avoir peiné sur des problèmes en phrases en cours de maths : des histoires de mangues, d’équipes ou de paquets de chocolats qui décrivent en réalité des équations. Les ordinateurs trouvent ces exercices encore plus difficiles, car ils doivent identifier quels nombres interviennent et comment ils sont liés. Cet article montre comment les technologies linguistiques modernes peuvent lire ces récits mathématiques quotidiens, déduire l’opération sous-jacente — addition, division, voire racine carrée — et, surtout, expliquer pourquoi elles en sont arrivées à cette conclusion. Le résultat est une avancée vers des outils pédagogiques et scientifiques plus intelligents et transparents.

Des histoires vers une structure mathématique

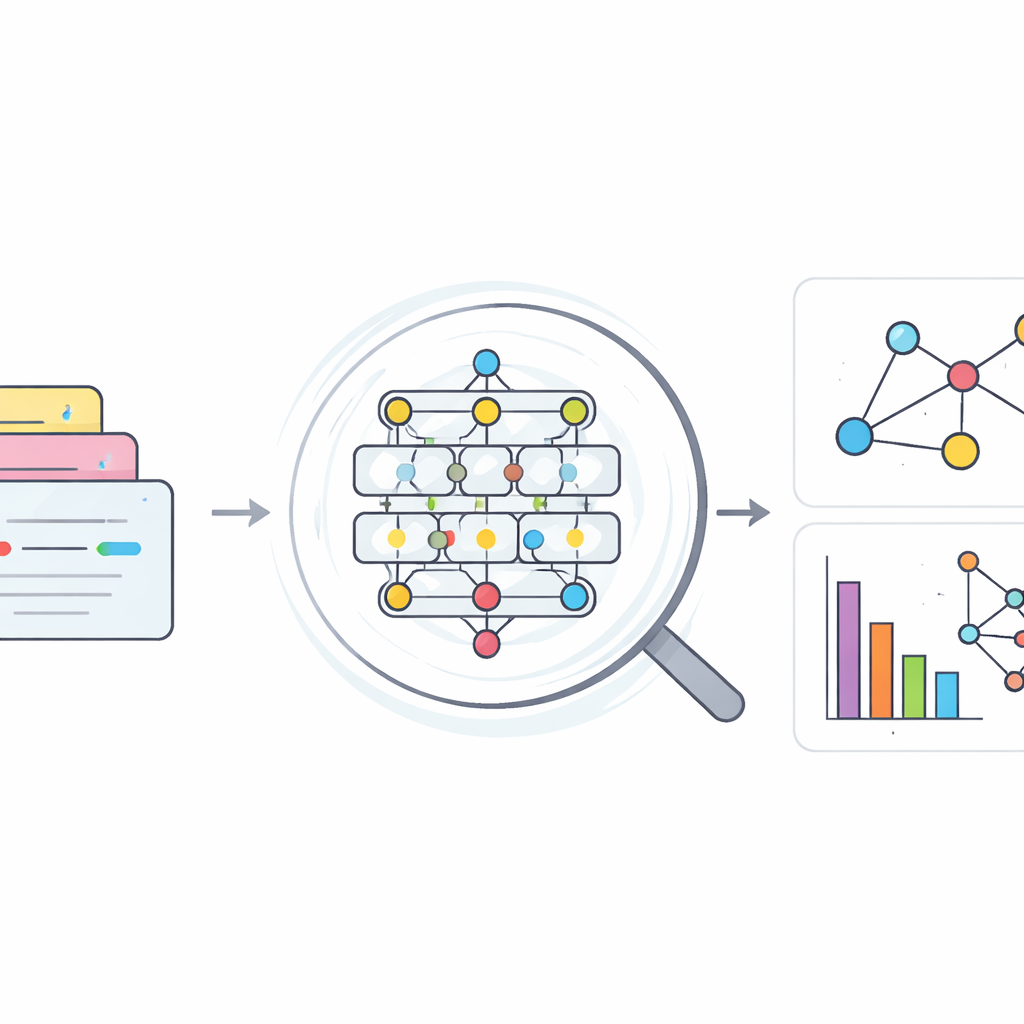

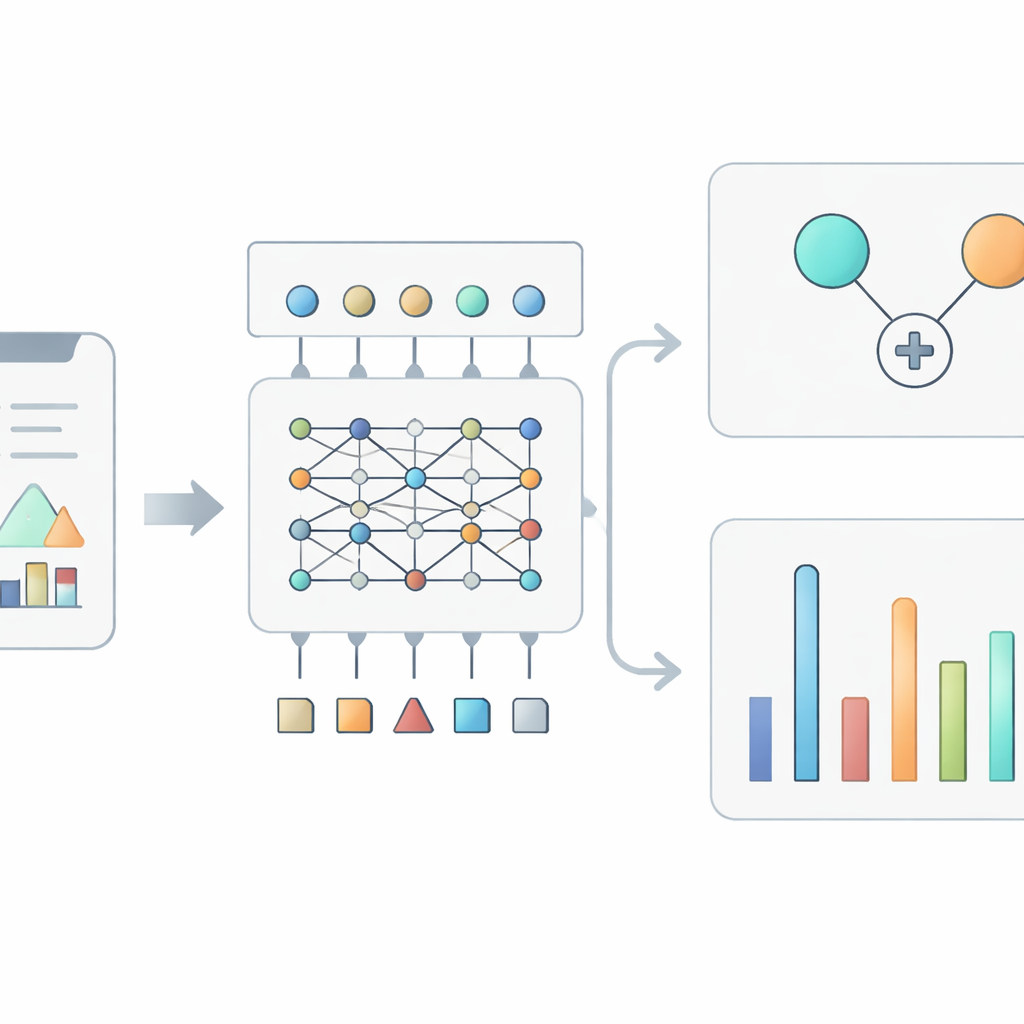

Au cœur de cette étude se trouve l’idée que chaque problème en phrases peut être vu comme un petit réseau de « choses » et de « liens ». Les choses sont les quantités (comme « douze mangues » ou « trois enfants »), et le lien est l’opération qui les relie (par exemple diviser, additionner ou extraire une racine carrée). L’auteur traite ces problèmes comme une tâche d’« entité–relation » : les nombres sont des entités et l’opération est la relation entre elles. En transformant des phrases désordonnées en cette structure simple, les machines se rapprochent de la façon dont les humains organisent mentalement un problème avant de le résoudre. Cette structure peut aussi alimenter des outils de recherche, des cartes de connaissances et des assistants automatiques capables de comprendre le texte mathématique dans les manuels ou les articles de recherche.

Constituer un jeu de données de récits mathématiques courants

Pour entraîner un système d’intelligence artificielle à reconnaître ces relations, l’étude avait d’abord besoin d’exemples. L’auteur a assemblé un nouveau jeu de données en combinant deux collections antérieures de textes mathématiques en bengali et en anglais. À partir de ces sources, il a sélectionné des phrases en anglais et identifié avec soin des syntagmes numériques comme « cinq mille quarante » en tant qu’entités mathématiques uniques, et non comme des mots dispersés. Chaque problème a été associé à son équation correspondante pour étiqueter la relation entre deux quantités clés comme l’une des six opérations de base : addition, soustraction, multiplication, division, factorielle ou racine carrée. Après suppression des doublons, nettoyage des symboles parasites et simplification du langage par des étapes telles que la suppression des mots vides et la lemmatisation, le jeu de données final contenait 3 284 énoncés mathématiques distincts avec des entités et relations clairement marquées.

Apprendre aux transformers à lire les problèmes mathématiques

Une fois le jeu de données prêt, l’étape suivante était de tester de puissants modèles de langage basés sur des transformers — la même famille de modèles qui a transformé le traitement automatique du langage naturel. Plusieurs modèles ont été évalués : BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT et XLNet. Chaque modèle a reçu le texte nettoyé et a été affiné de sorte que sa sortie ne soit pas la solution complète du problème, mais simplement le type de relation reliant les deux quantités principales. L’évaluation a utilisé des mesures courantes telles que l’exactitude et le score F1 sur des données de test mises de côté. BERT est apparu comme le gagnant net, identifiant correctement la relation dans presque tous les cas, avec une exactitude de 99,39 %. Les courbes d’apprentissage ont montré une amélioration régulière sans surapprentissage, et une matrice de confusion n’a révélé que quelques confusions, principalement entre des opérations proches comme addition et soustraction ou division et multiplication.

Ouvrir la boîte noire grâce aux explications

Une forte exactitude ne suffit pas lorsque des systèmes d’IA sont supposés soutenir l’apprentissage ou la recherche. Les utilisateurs doivent comprendre pourquoi une prédiction a été faite. Pour répondre à cela, l’auteur a appliqué SHAP, une méthode populaire d’IA explicable, au modèle BERT entraîné. SHAP attribue à chaque mot d’une phrase un score de contribution qui reflète dans quelle mesure il pousse le modèle vers ou loin d’une opération donnée. En soumettant des problèmes mathématiques inconnus à un explainer SHAP, l’étude a produit des visualisations où les mots utiles apparaissent positivement en évidence et les mots trompeurs exercent un effet inverse. Par exemple, des mots comme « divided », « equally » et « each » soutiennent fortement une prédiction de division, tandis que des mots contextuels qui n’indiquent pas la division diminuent cette confiance. Sur de nombreux exemples, l’analyse a montré que le modèle s’appuyait davantage sur les mots signalant l’opération que sur les nombres eux‑mêmes, reflétant la façon dont les humains cherchent des indices comme « total », « from » ou « square root » lorsqu’ils interprètent un problème.

Ce que cela signifie pour les futurs outils mathématiques

En termes simples, ce travail démontre qu’un modèle de langage moderne peut être entraîné à lire de courts récits mathématiques et identifier presque parfaitement l’opération centrale qui relie les nombres, tout en montrant son raisonnement de façon compréhensible par l’humain. En combinant une construction soignée du jeu de données, un modèle transformer performant et des explications basées sur SHAP, l’étude propose un cadre transparent pour transformer des problèmes narratifs en relations structurées. Cette approche pourrait soutenir des systèmes futurs qui non seulement résolvent des problèmes, mais mettent aussi en évidence les expressions clés, facilitent la vérification automatique de textes mathématiques et construisent des cartes riches et navigables du savoir mathématique pour les étudiants et les chercheurs.

Citation: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Mots-clés: problèmes mathématiques textuels, modèles de langage transformer, IA explicable, extraction de relations d'entités, explications SHAP