Clear Sky Science · sv

Transparent AI for mathematics: transformer-baserade stora språkmodeller för extraktion av relationsdata mellan matematiska enheter med XAI

Varför det spelar roll att omvandla textuppgifter till data

Många av oss minns att vi kämpade med textuppgifter i mattan: historier om mangofrukter, lag eller chokladaskar som i själva verket beskriver ekvationer. Datorer har ännu svårare för sådana uppgifter eftersom de måste identifiera vilka tal som ingår och hur de hänger ihop. Denna artikel visar hur modern språkteknik kan läsa sådana vardagliga matematiska berättelser, avgöra den underliggande operationen—addition, division eller till och med kvadratroten—och, vilket är avgörande, förklara varför den kom fram till den slutsatsen. Resultatet är ett steg mot smartare, mer transparenta verktyg för undervisning och vetenskapligt arbete.

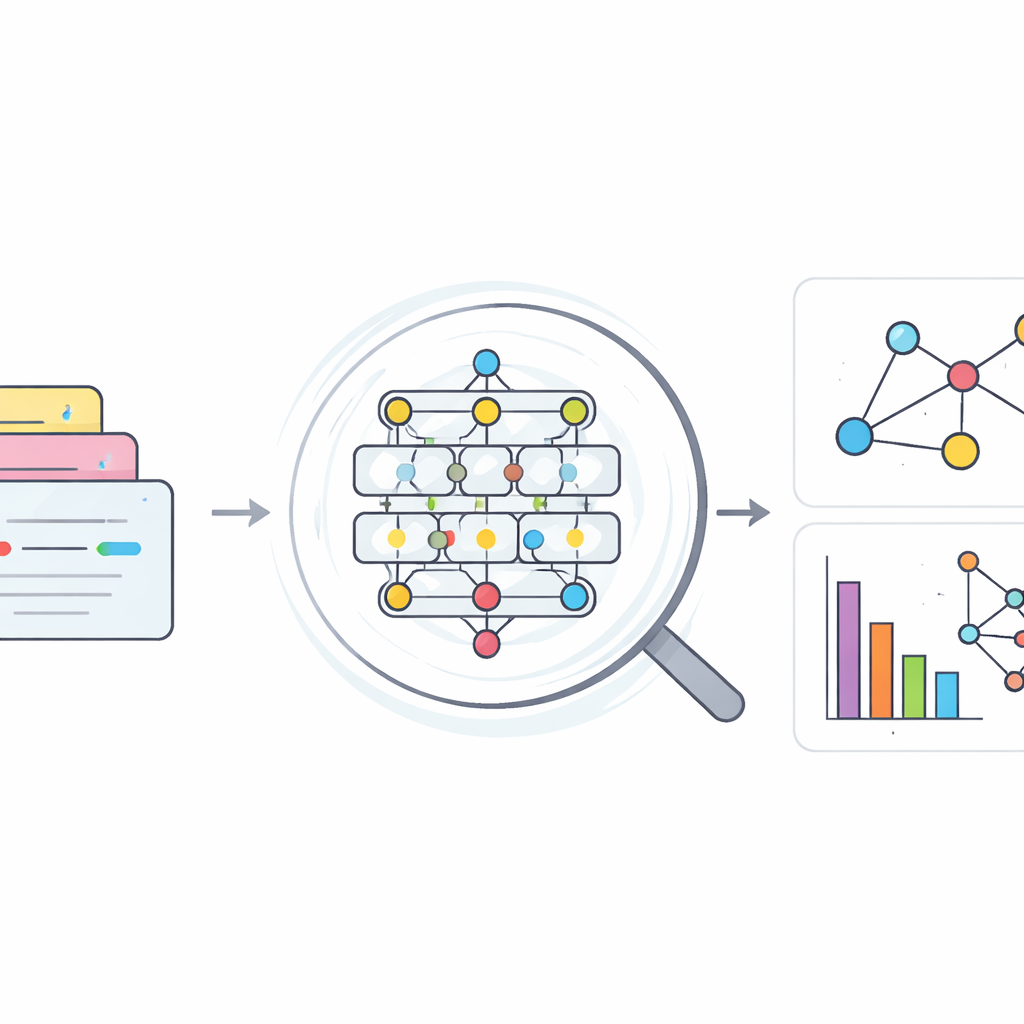

Från berättelser till strukturerad matematik

I kärnan av denna studie finns idén att varje matematisk textuppgift kan ses som ett litet nätverk av ”saker” och ”länkar”. Sakerna är mängderna (som ”tolv mango” eller ”tre barn”) och länken är operationen som förbinder dem (såsom division, addition eller att ta kvadratroten). Författaren behandlar dessa uppgifter som en uppgift i ”enhet–relation”: talen är enheterna och operationen är relationen mellan dem. Genom att omvandla röriga meningar till denna enkla struktur kan datorer närma sig hur människor internt organiserar ett matematiskt problem innan de löser det. Denna struktur kan också driva sökverktyg, kunskapskartor och automatiska hjälpmedel som förstår matematisk text i läroböcker eller vetenskapliga artiklar.

Bygga en datamängd av vardagliga matematikberättelser

För att träna ett AI-system att känna igen dessa relationer behövde studien först exempel. Författaren satte samman en ny datamängd genom att kombinera två tidigare samlingar av bangla- och engelskspråkiga matematiska texter. Från dessa källor valdes engelska meningar ut och talfraser som ”fem tusen och fyrtio” identifierades noggrant som enskilda matematiska enheter, inte bara utspridda ord. Varje uppgift matchades med sin motsvarande ekvation för att märka relationen mellan två nyckelmängder som en av sex grundläggande operationer: addition, subtraktion, multiplikation, division, fakultet eller kvadratroten. Efter att ha tagit bort dubbletter, rensat bort lösa symboler och förenklat språket genom steg som borttagning av stoppord och lemmatisering innehöll slutligen datamängden 3 284 distinkta matematiska satser med tydligt markerade enheter och relationer.

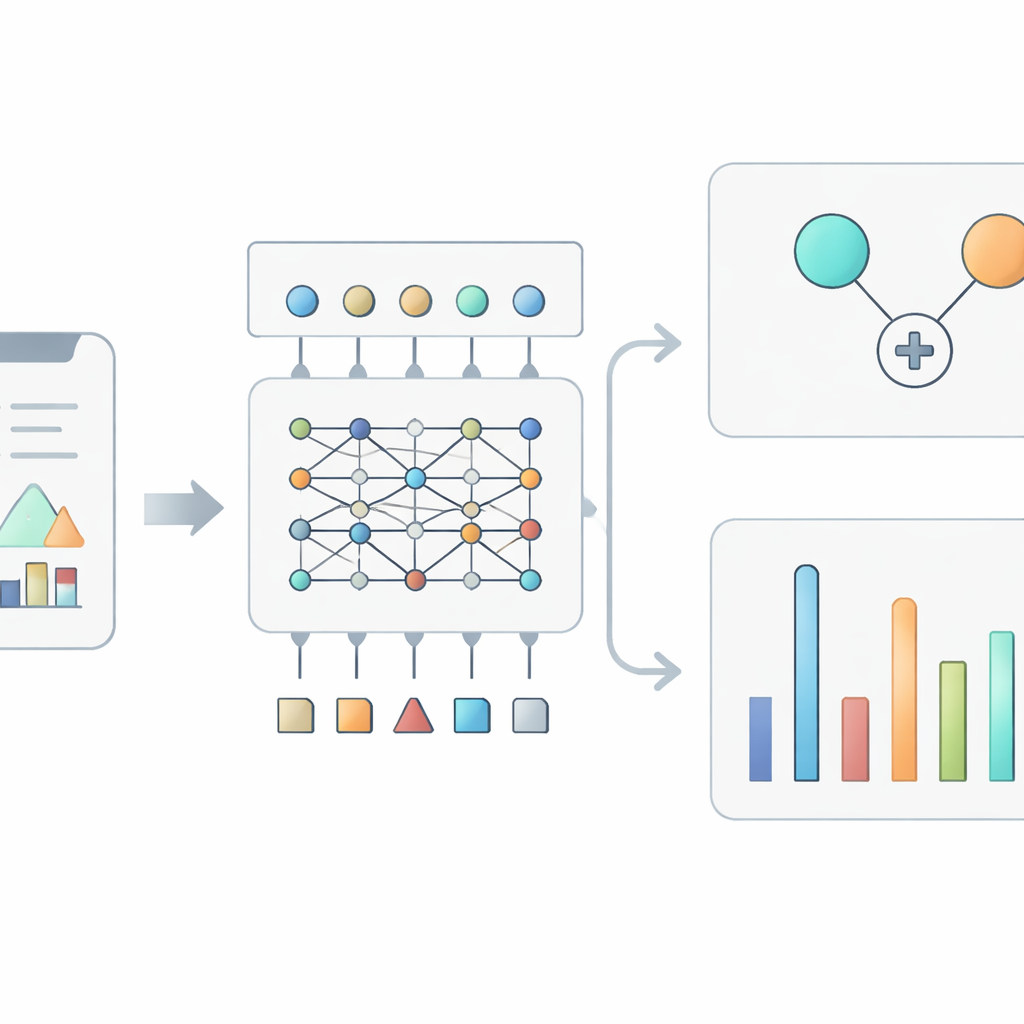

Lära transformers att läsa matematiska problem

Med datamängden förberedd var nästa steg att testa kraftfulla transformerbaserade språkmodeller—samma familj av modeller som har förändrat modern naturlig språkbehandling. Flera kandidater utvärderades: BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT och XLNet. Varje modell fick den rensade texten och finjusterades så att dess utsignal inte var en fullständig lösning på problemet, utan helt enkelt typen av relation som kopplar de två huvudsakliga mängderna. Utvärdering använde vanliga mått såsom noggrannhet och F1-poäng på hållna testdata. BERT framstod som en klar vinnare och identifierade relationen korrekt i nästan varje fall med en noggrannhet på 99,39 %. Inlärningskurvorna visade att modellen förbättrades stadigt utan överanpassning, och en förväxlingsmatris visade bara ett fåtal förväxlingar, mestadels mellan liknande operationer som addition och subtraktion eller division och multiplikation.

Öppna svart lådan med förklaringar

Hög noggrannhet räcker inte när AI-system förväntas stödja lärande eller forskning. Användare behöver förstå varför en viss prediktion gjordes. För att hantera detta applicerade författaren SHAP, en populär metod inom förklarbar AI, på den tränade BERT-modellen. SHAP tilldelar varje ord i en mening en bidragspoäng som speglar hur mycket det skjuter modellen mot eller bort från en specifik operation. Genom att föra osedda matematiska problem genom en SHAP-förklarare producerade studien visualiseringar där hjälpsamma ord lyser positivt och vilseledande ord drar i motsatt riktning. Till exempel stödjer ord som ”delat”, ”lika” och ”varje” starkt en divisionsprediktion, medan kontextord som inte pekar på division minskar det förtroendet. Över många exempel visade analysen att modellen förlitade sig mer på operation-indikerande ord än på själva talen, vilket speglar hur människor snabbt söker efter ledtrådar som ”totalt”, ”från” eller ”kvadratrot” när de tolkar ett problem.

Vad detta innebär för framtida matematikverktyg

Enkelt uttryckt visar detta arbete att en modern språkmodell kan tränas att läsa korta matematikberättelser och nästan perfekt identifiera den centrala operationen som binder talen, samtidigt som den visar sin slutledning på ett människoläsbart sätt. Genom att kombinera noggrann datamängdskonstruktion, en stark transformer-modell och SHAP-baserade förklaringar erbjuder studien ett transparent ramverk för att omvandla narrativa matematikproblem till strukturerade relationer. Detta tillvägagångssätt skulle kunna ligga till grund för framtida system som inte bara löser problem, utan också markerar de nyckelfraser som är viktiga, stödjer automatisk kontroll av matematisk text och bygger rika, navigerbara kartor över matematikkunskap för studenter och forskare.

Citering: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Nyckelord: matematiska textuppgifter, transformer-språkmodeller, förklarbar AI, extraktion av enhetsrelationer, SHAP-förklaringar