Clear Sky Science · ru

Прозрачный ИИ для математики: большие трансформерные языковые модели для извлечения отношений между математическими сущностями с XAI

Почему важно превращать словесные задачи в данные

Многие из нас помнят, как мучились со словесными задачами на уроках математики: истории про манго, команды или пакеты конфет, которые на самом деле описывают уравнения. Для компьютеров такие задачи ещё сложнее, потому что нужно определить, какие числа задействованы и как они связаны. В этой статье показано, как современные языковые технологии умеют читать такие повседневные математические рассказы, выяснять скрытую операцию — сложение, деление или даже извлечение квадратного корня — и, что важно, объяснять, почему был сделан такой вывод. Результат — шаг к более умным и прозрачным инструментам для образования и научной работы.

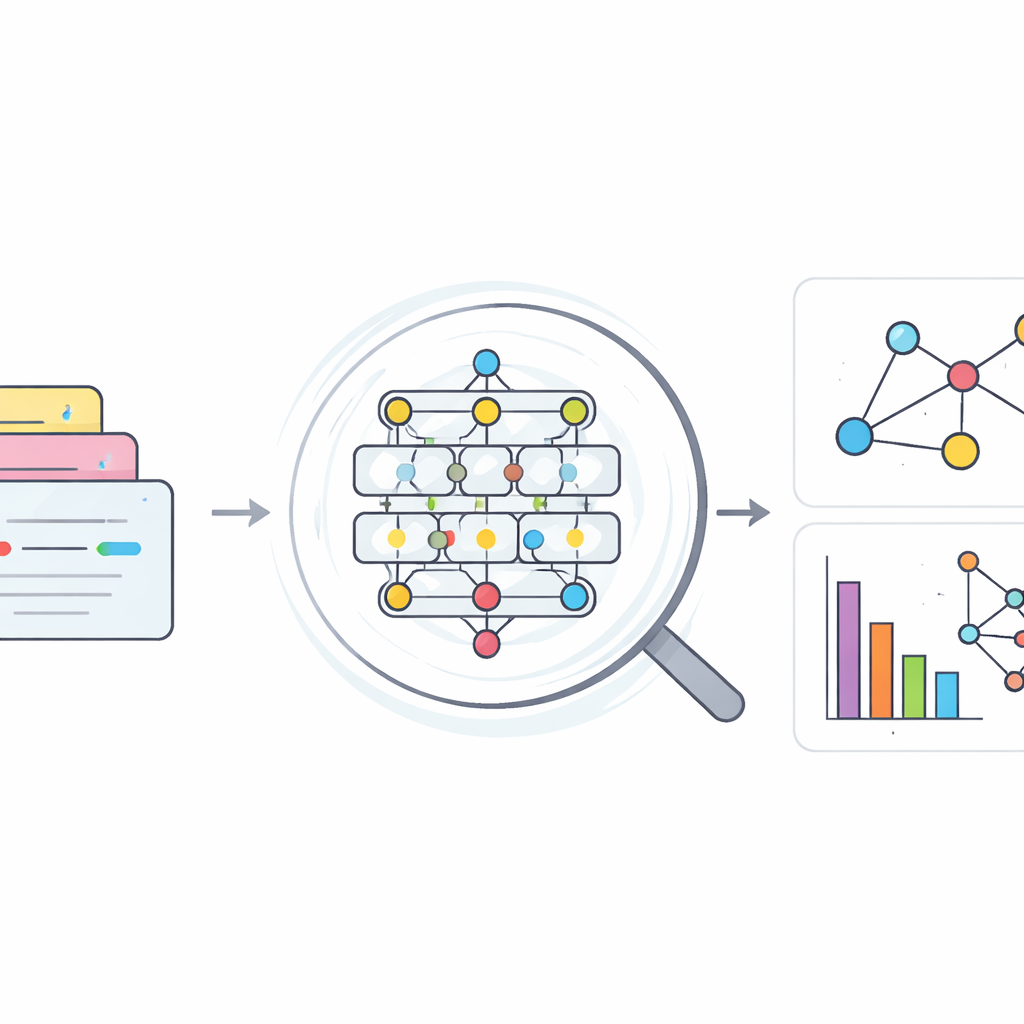

От рассказов к структурированной математике

В основе исследования лежит идея, что каждую словесную математическую задачу можно представить в виде небольшой сети «сущностей» и «связей». Сущности — это величины (например, «двенадцать манго» или «трое детей»), а связь — операция, которая их соединяет (например, деление, сложение или извлечение квадратного корня). Автор рассматривает эти задачи как задачу «entity–relationship»: числа — это сущности, а операция — отношение между ними. Превращая беспорядочные предложения в такую простую структуру, компьютеры приближаются к тому, как люди мысленно организуют задачу перед её решением. Такая структура также может питать инструменты поиска, карты знаний и автоматических помощников, которые понимают математические тексты в учебниках или научных статьях.

Создание набора данных из повседневных математических рассказов

Чтобы обучить систему распознавать эти отношения, в исследовании сначала потребовались примеры. Автор собрал новый набор данных, объединив два более ранних корпуса бенгальских и английских математических текстов. Из этих источников были отобраны английские предложения, в которых внимательно выделялись числовые фразы вроде «five thousand and forty» как единые математические сущности, а не как разрозненные слова. Каждая задача была сопоставлена с соответствующим уравнением, чтобы пометить отношение между двумя ключевыми величинами как одну из шести базовых операций: сложение, вычитание, умножение, деление, факториал или квадратный корень. После удаления дубликатов, очистки случайных символов и упрощения языка с помощью таких шагов, как удаление стоп-слов и лемматизация, итоговый набор данных содержал 3284 различных математических утверждения с четко отмеченными сущностями и отношениями.

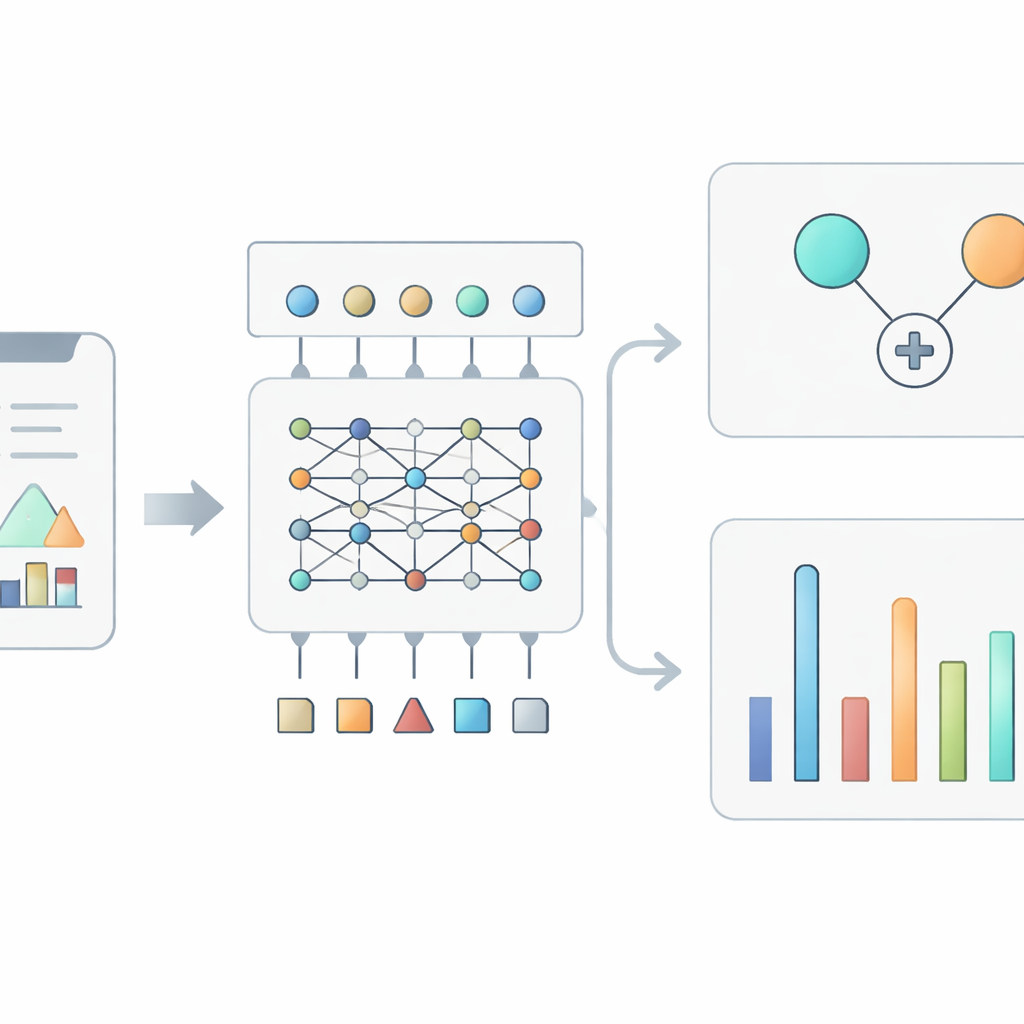

Обучение трансформеров чтению математических задач

После подготовки набора данных следующим шагом стало тестирование мощных трансформерных языковых моделей — того же семейства моделей, которое преобразило современную обработку естественного языка. Были оценены несколько претендентов: BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT и XLNet. Каждая модель получала очищенный текст и тонко настраивалась так, чтобы её выходом не было полное решение задачи, а лишь тип отношения, связывающего две основные величины. Оценка проводилась с использованием распространённых метрик, таких как точность и F1 на отложенной тестовой выборке. BERT показал явное превосходство, правильно определяя отношение почти во всех случаях, с точностью 99,39%. Кривые обучения показали, что модель стабильно улучшалась без переобучения, а матрица ошибок выявила лишь несколько смешений, в основном между схожими операциями, такими как сложение и вычитание или деление и умножение.

Открывая «чёрный ящик» через объяснения

Высокая точность сама по себе недостаточна, когда от систем ИИ ожидается поддержка обучения или исследований. Пользователям нужно понимать, почему было сделано то или иное предсказание. Чтобы решить эту проблему, автор применил SHAP, популярный метод объяснимого ИИ, к обученной модели BERT. SHAP присваивает каждому слову в предложении вклад, который отражает, насколько оно склоняет модель в сторону или против конкретной операции. Пропуская неизвестные задачи через SHAP-объяснитель, исследование получило визуализации, где полезные слова выделяются положительно, а вводящие в заблуждение — тянут в обратную сторону. Например, слова типа «divided», «equally» и «each» сильно поддерживают предсказание деления, тогда как контекстные слова, не указывающие на деление, понижают эту уверенность. Во многих примерах анализ показал, что модель опирается больше на слова, указывающие на операцию, чем на сами числа, что отражает человеческую стратегию поиска подсказок вроде «total», «from» или «square root» при интерпретации задачи.

Что это значит для будущих математических инструментов

Проще говоря, эта работа демонстрирует, что современную языковую модель можно обучить читать короткие математические рассказы и почти идеально определять ключевую операцию, связывающую числа, при этом показывая своё рассуждение в удобной для человека форме. Сочетая тщательное построение набора данных, мощную трансформерную модель и объяснения на основе SHAP, исследование предлагает прозрачную схему преобразования повествовательных математических задач в структурированные отношения. Такой подход может лечь в основу будущих систем, которые не только решают задачи, но и выделяют ключевые фразы, поддерживают автоматическую проверку математических текстов и создают богатые, удобные для навигации карты математических знаний для учащихся и исследователей.

Цитирование: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Ключевые слова: словесные математические задачи, трансформерные языковые модели, объяснимый ИИ, извлечение отношений сущностей, объяснения SHAP