Clear Sky Science · pl

Przezroczyste AI dla matematyki: oparte na transformatorach duże modele językowe do ekstrakcji relacji między jednostkami matematycznymi z XAI

Dlaczego zamiana zadań tekstowych w dane ma znaczenie

Wielu z nas pamięta zmagania z zadaniami tekstowymi na lekcjach matematyki: opowieści o mango, zespołach czy paczkach czekoladek, które w istocie opisują równania. Dla komputerów takie zadania są jeszcze trudniejsze, ponieważ muszą rozpoznać, które liczby występują i jak są ze sobą powiązane. Artykuł pokazuje, jak nowoczesne technologie językowe potrafią odczytać takie codzienne matematyczne historie, określić ukrytą operację — dodawanie, dzielenie czy nawet pierwiastkowanie — i, co kluczowe, wyjaśnić, dlaczego doszły do takiego wniosku. To krok w stronę inteligentniejszych, bardziej przejrzystych narzędzi dla edukacji i pracy naukowej.

Z opowieści do uporządkowanej matematyki

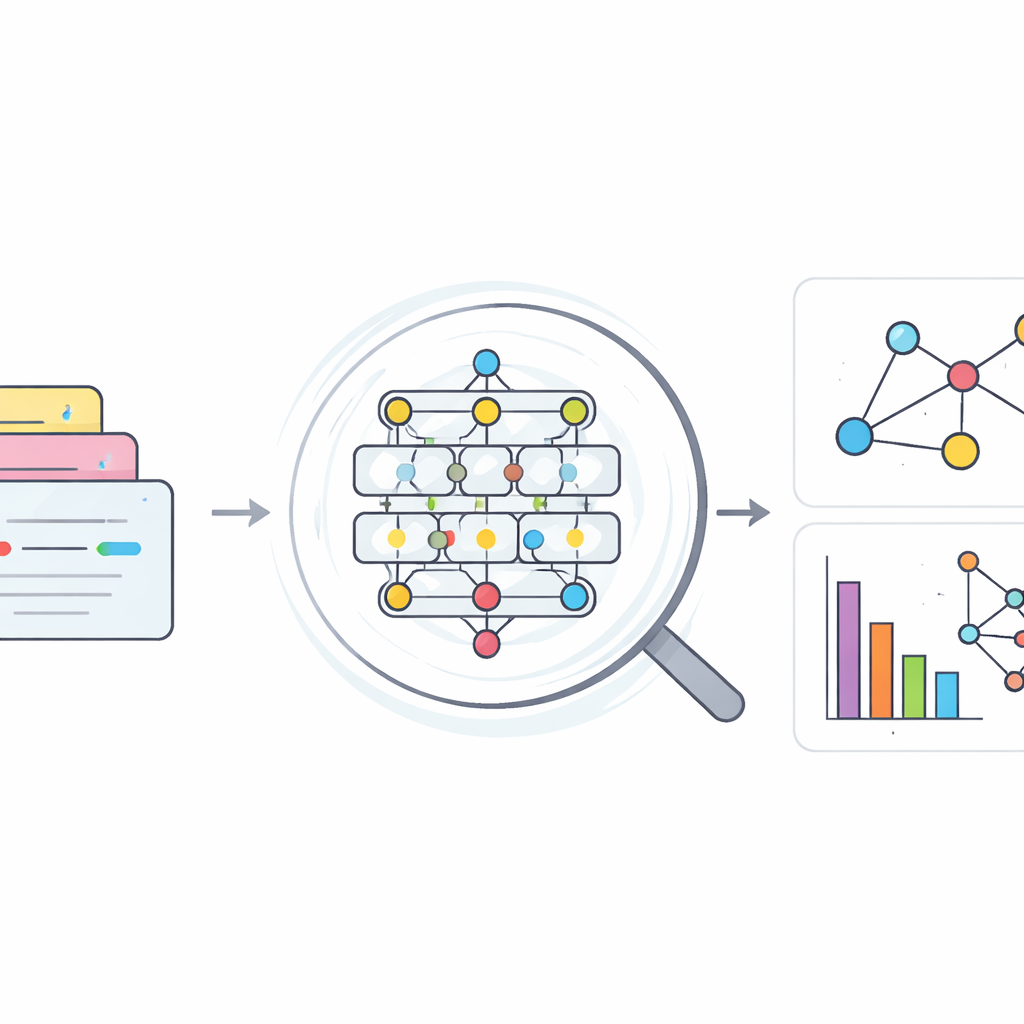

Istotą badania jest pomysł, że każde zadanie tekstowe można potraktować jako małą sieć „rzeczy” i „powiązań”. „Rzeczy” to ilości (jak „dwanaście mango” czy „troje dzieci”), a powiązanie to operacja łącząca je ze sobą (na przykład dzielenie, dodawanie czy pierwiastek kwadratowy). Autor traktuje te zadania jako zadanie typu „encja–relacja”: liczby są encjami, a operacja — relacją między nimi. Przekształcając niesforne zdania w tę prostą strukturę, komputery zbliżają się do sposobu, w jaki ludzie wewnętrznie organizują problem matematyczny przed jego rozwiązaniem. Taka struktura może też zasilać narzędzia wyszukujące, mapy wiedzy i automatyczne asystenty rozumiejące teksty matematyczne w podręcznikach czy artykułach naukowych.

Budowanie zbioru danych codziennych historii matematycznych

Aby nauczyć system sztucznej inteligencji rozpoznawania tych relacji, najpierw potrzebne były przykłady. Autor zebrał nowy zbiór danych, łącząc dwie wcześniejsze kolekcje tekstów matematycznych w języku bangla i angielskim. Z tych źródeł wybrano zdania w języku angielskim i starannie zidentyfikowano frazy liczbowe, takie jak „five thousand and forty”, jako pojedyncze encje matematyczne, a nie rozproszone słowa. Każde zadanie sparowano z odpowiadającym mu równaniem, aby oznakować relację między dwiema kluczowymi ilościami jako jedną z sześciu podstawowych operacji: dodawanie, odejmowanie, mnożenie, dzielenie, silnia lub pierwiastek kwadratowy. Po usunięciu duplikatów, oczyszczeniu zbędnych symboli i uproszczeniu języka przez kroki takie jak usuwanie stop‑słów i lematyzacja, końcowy zbiór danych zawierał 3 284 odrębne zdania matematyczne z wyraźnie oznaczonymi encjami i relacjami.

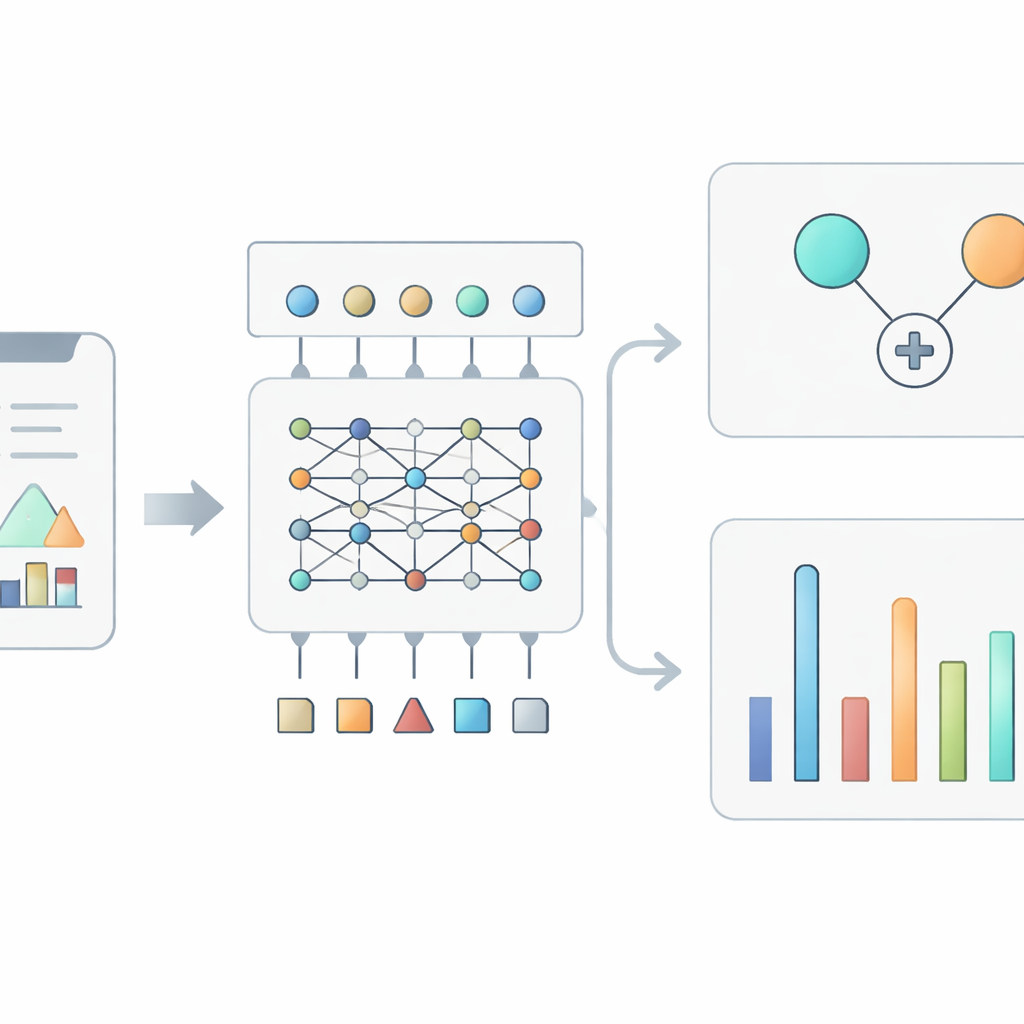

Nauczanie transformatorów czytania zadań matematycznych

Gdy zbiór danych był gotowy, kolejnym krokiem było przetestowanie potężnych modeli językowych opartych na transformatorach — tej samej rodziny modeli, która zrewolucjonizowała współczesne przetwarzanie języka naturalnego. Oceniono kilka kandydatów: BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT i XLNet. Każdy model otrzymał oczyszczony tekst i został dopasowany (fine‑tuned), tak aby jego wyjście nie było pełnym rozwiązaniem zadania, lecz jedynie typ relacji łączącej dwie główne ilości. Ewaluacja używała powszechnych miar, takich jak dokładność i miary F1 na wydzielonym zbiorze testowym. BERT okazał się jednoznacznym zwycięzcą, poprawnie identyfikując relację w niemal wszystkich przypadkach, z dokładnością 99,39%. Krzywe uczenia wykazały, że model poprawiał się stabilnie bez przeuczenia, a macierz pomyłek ujawniła tylko garstkę pomyłek, głównie między podobnymi operacjami, takimi jak dodawanie i odejmowanie czy dzielenie i mnożenie.

Otwieranie czarnej skrzynki za pomocą wyjaśnień

Wysoka dokładność to za mało, gdy systemy AI mają wspierać naukę lub badania. Użytkownicy muszą rozumieć, dlaczego podjęto daną prognozę. Aby to umożliwić, autor zastosował SHAP, popularną metodę z obszaru wyjaśnialnej AI, do wytrenowanego modelu BERT. SHAP przypisuje każdemu słowu w zdaniu współczynnik wkładu, który odzwierciedla, jak bardzo przesuwa on model w kierunku lub w opozycji do konkretnej operacji. Przepuszczając niewidziane dotąd zadania przez eksplainer SHAP, badanie wygenerowało wizualizacje, gdzie pomocne słowa świecą pozytywnie, a mylące ciągną w przeciwnym kierunku. Na przykład słowa takie jak „divided”, „equally” i „each” silnie wspierają przewidywanie dzielenia, podczas gdy pozostałe słowa kontekstowe, które nie wskazują na dzielenie, obniżają to przekonanie. W wielu przykładach analiza pokazała, że model w większym stopniu polegał na słowach wskazujących operację niż na samych surowych liczbach, co odzwierciedla sposób, w jaki ludzie szukają wskazówek, takich jak „total”, „from” czy „square root” przy interpretacji zadania.

Co to oznacza dla przyszłych narzędzi matematycznych

Mówiąc prosto, praca pokazuje, że nowoczesny model językowy można wytrenować do czytania krótkich matematycznych opowieści i niemal doskonale identyfikować zasadniczą operację łączącą liczby, jednocześnie ujawniając swoje rozumowanie w czytelny dla człowieka sposób. Łącząc staranną konstrukcję zbioru danych, silny model transformatorowy i objaśnienia oparte na SHAP, badanie proponuje przejrzyste ramy zamiany narracyjnych zadań matematycznych w uporządkowane relacje. Podejście to może stać się podstawą przyszłych systemów, które nie tylko rozwiązują zadania, ale także wskazują kluczowe frazy, wspierają automatyczną weryfikację tekstów matematycznych i budują rozbudowane, nawigowalne mapy wiedzy matematycznej dla uczniów i badaczy.

Cytowanie: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Słowa kluczowe: zadania tekstowe z matematyki, modele językowe oparte na transformatorach, wyjaśnialna sztuczna inteligencja, ekstrakcja relacji między jednostkami, objaśnienia SHAP