Clear Sky Science · tr

Matematik için şeffaf Yapay Zeka: XAI ile matematiksel varlık ilişki çıkarımı için dönüştürücü tabanlı büyük dil modelleri

Kelime problemlerini veriye dönüştürmenin önemi

Birçoğumuz matematik dersinde mango, takım veya çikolata paketleri gibi hikâyelerle anlatılan kelime problemlerinde zorlandığımızı hatırlarız: gerçekte denklemleri tanımlayan küçük öyküler. Bilgisayarlar için bu problemler daha da zordur çünkü hangi sayıların yer aldığını ve bunların nasıl bağlı olduğunu tanımlamaları gerekir. Bu makale, modern dil teknolojisinin bu tür günlük matematik hikâyelerini okuyup gizli işlemi—toplama, bölme veya hatta karekök alma—bulabileceğini ve özellikle de bu sonuca neden ulaştığını açıklayabileceğini gösteriyor. Sonuç, eğitim ve bilimsel işler için daha akıllı, daha şeffaf araçlara doğru atılmış bir adımdır.

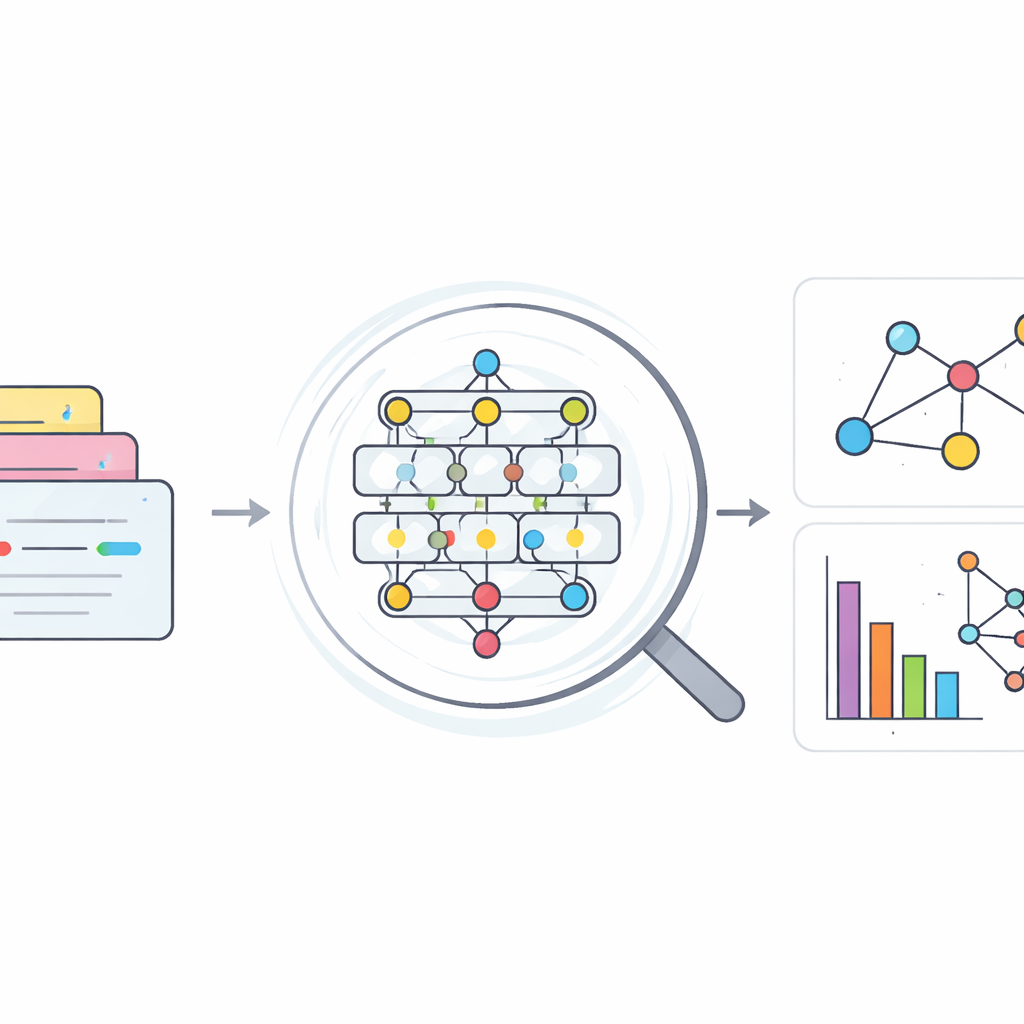

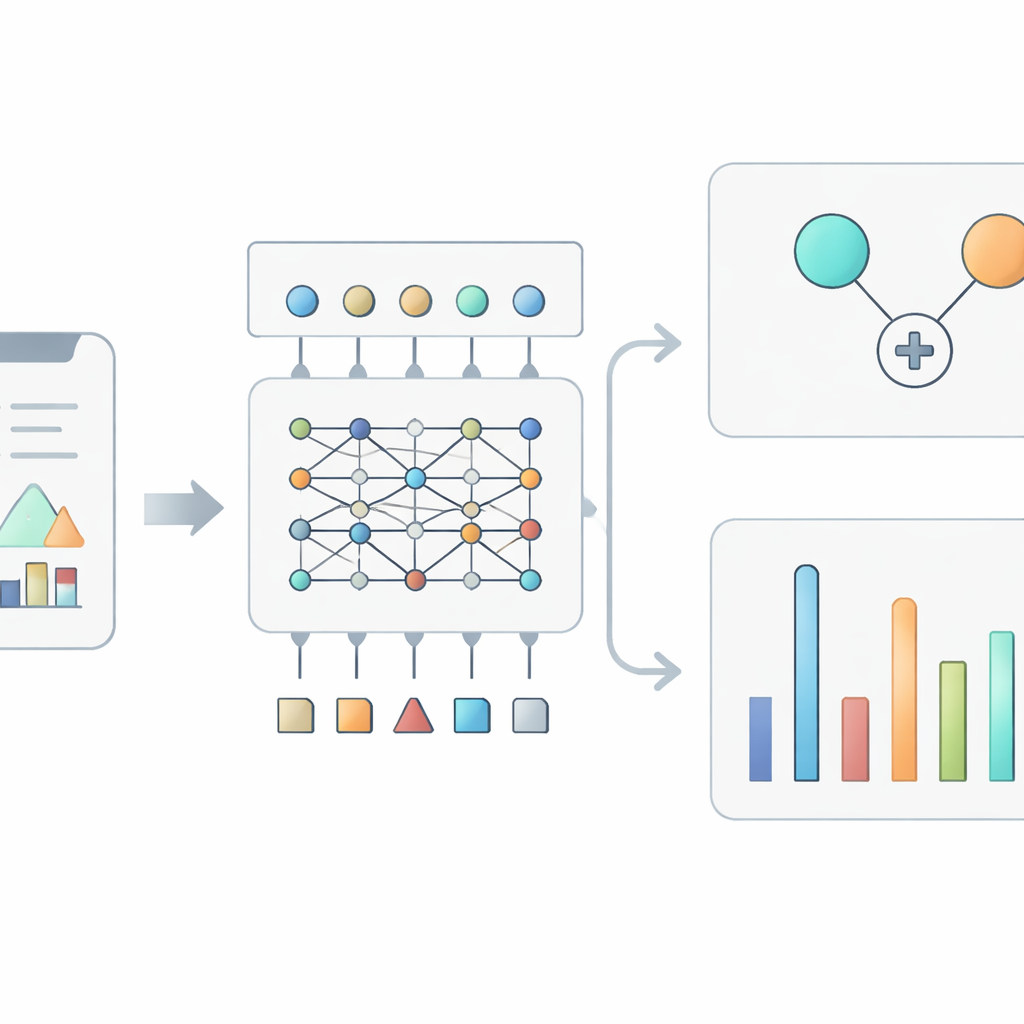

Hikâyelerden yapılandırılmış matematiğe

Bu çalışmanın merkezinde her bir matematik kelime probleminin küçük bir "varlık" ve "ilişki" ağından oluştuğu fikri vardır. Varlıklar miktarlardır (örneğin "on iki mango" veya "üç çocuk"), ilişki ise onları bağlayan işlemdir (bölme, toplama veya karekök alma gibi). Yazar bu problemleri bir "varlık–ilişki" görevi olarak ele alır: sayılar varlıklardır ve işlem bunlar arasındaki ilişkidir. Dağınık cümleleri bu basit yapıya dönüştürerek bilgisayarlar, insanların bir matematik problemini çözmeden önce zihninde nasıl organize ettiğine daha da yaklaşabilir. Bu yapı ayrıca ders kitaplarındaki veya araştırma makalelerindeki matematiksel metinleri anlayan arama araçları, bilgi haritaları ve otomatik yardımcılar için de altyapı sağlayabilir.

Günlük matematik hikâyelerinden bir veri kümesi oluşturmak

Bir yapay zekâ sistemini bu ilişkileri tanıyacak şekilde eğitmek için çalışma önce örneklere ihtiyaç duydu. Yazar, Bangla ve İngilizce matematik metinlerinin iki önceki koleksiyonunu birleştirerek yeni bir veri kümesi oluşturdu. Bu kaynaklardan İngilizce cümleler seçildi ve "beş bin kırk" gibi sayı ifadeleri tek bir matematiksel varlık olarak dikkatle belirlendi; yalnızca dağınık kelimeler olarak değil. Her problem, iki temel miktar arasındaki ilişkiyi altı temel işlemden biri olarak etiketlemek için karşılık gelen denklemle eşleştirildi: toplama, çıkarma, çarpma, bölme, faktoriyel veya karekök. Yinelenenler kaldırıldıktan, yabancı semboller temizlendikten ve durma kelimelerinin kaldırılması ile lemmatizasyon gibi adımlarla dil basitleştirildikten sonra nihai veri kümesi açıkça işaretlenmiş varlıklar ve ilişkiler içeren 3.284 ayrı matematiksel ifadeden oluştu.

Dönüştürücülere matematik problemleri okutmak

Veri kümesi hazırlandıktan sonra bir sonraki adım, modern doğal dil işlemede devrim yaratan aynı model ailesi olan güçlü dönüştürücü tabanlı dil modellerini test etmekti. Birkaç aday değerlendirildi: BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT ve XLNet. Her modele temizlenmiş metin verildi ve çıktı olarak problemin tam çözümü değil, iki ana miktarı bağlayan ilişki türü verilecek şekilde ince ayar yapıldı. Değerlendirme, ayrılmış test verileri üzerinde doğruluk ve F1 puanları gibi yaygın ölçütlerle yapıldı. BERT net bir kazanan olarak ortaya çıktı ve ilişkileri neredeyse her durumda doğru tanımlayarak %99,39 doğruluk elde etti. Öğrenme eğrileri modelin aşırı uyum göstermeden sürekli olarak iyileştiğini gösterdi ve bir karışıklık matrisi, çoğunlukla toplama-çıkarma veya bölme-çarpma gibi benzer işlemler arasında yalnızca birkaç karışıklık olduğunu ortaya koydu.

Siyah kutuyu açıklamalarla açmak

Yüksek doğruluk tek başına, yapay zekâ sistemlerinden öğrenme veya araştırma desteği beklendiğinde yeterli değildir. Kullanıcılar belirli bir tahminin neden yapıldığını anlamalıdır. Bunu ele almak için yazar, eğitilmiş BERT modeline açıklanabilir yapay zekâ alanında popüler bir yöntem olan SHAP uyguladı. SHAP, bir cümledeki her kelimeye, modelin belirli bir işleme doğru ya da ondan uzaklaşmasını ne kadar etkilediğini yansıtan bir katkı skoru atar. Görülmemiş matematik problemleri SHAP açıklayıcısına verildiğinde, çalışmada yardımcı sözcüklerin olumlu şekilde parladığı ve yanıltıcı olanların ters yönde çektiği görselleştirmeler üretildi. Örneğin "bölünmüş", "eşit" ve "her" gibi kelimeler bölme tahminini güçlü biçimde desteklerken, bölmeyi işaret etmeyen bağlamsal kelimeler bu güveni azaltıyor. Birçok örnekte yapılan analiz, modelin ham sayılardan çok işlemi işaret eden kelimelere daha fazla dayandığını gösterdi; bu, insanların bir problemi yorumlarken "toplam", "-den" veya "karekök" gibi ipuçlarını aramasına benzer.

Geleceğin matematik araçları için anlamı

Basitçe söylemek gerekirse, bu çalışma modern bir dil modelinin kısa matematik hikâyelerini okuyacak ve sayıları birbirine bağlayan temel işlemi neredeyse kusursuz şekilde tanımlayacak şekilde eğitilebileceğini ve aynı zamanda insan tarafından okunabilir bir biçimde akıl yürütmesini gösterebileceğini kanıtlıyor. Titiz veri kümesi oluşturma, güçlü bir dönüştürücü modeli ve SHAP tabanlı açıklamaların birleştirilmesiyle çalışma, anlatısal matematik problemlerini yapılandırılmış ilişkilere dönüştürmek için şeffaf bir çerçeve sunuyor. Bu yaklaşım, yalnızca problemleri çözen değil, aynı zamanda önemli ifadeleri vurgulayan, matematiksel metinlerin otomatik kontrolünü destekleyen ve öğrenciler ile araştırmacılar için zengin, gezilebilir matematik bilgi haritaları inşa eden gelecekteki sistemlerin temelini oluşturabilir.

Atıf: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Anahtar kelimeler: matematik kelime problemleri, dönüştürücü dil modelleri, açıklanabilir yapay zeka, varlık ilişki çıkarımı, SHAP açıklamaları