Clear Sky Science · it

IA trasparente per la matematica: modelli linguistici di grandi dimensioni basati su transformer per l'estrazione di relazioni tra entità matematiche con XAI

Perché trasformare i problemi in forma testuale in dati è importante

Molti di noi ricordano le difficoltà con i problemi in forma testuale a scuola: storie su mango, squadre o pacchetti di cioccolatini che in realtà descrivono equazioni. Per i computer questi problemi sono ancora più difficili, perché devono riconoscere quali numeri sono coinvolti e come sono collegati. Questo articolo mostra come le moderne tecnologie linguistiche possano leggere queste storie quotidiane, identificare l'operazione nascosta — addizione, divisione o anche radice quadrata — e, cosa cruciale, spiegare perché si è giunti a quella conclusione. Il risultato è un passo verso strumenti più intelligenti e trasparenti per l'istruzione e il lavoro scientifico.

Dalle storie alla matematica strutturata

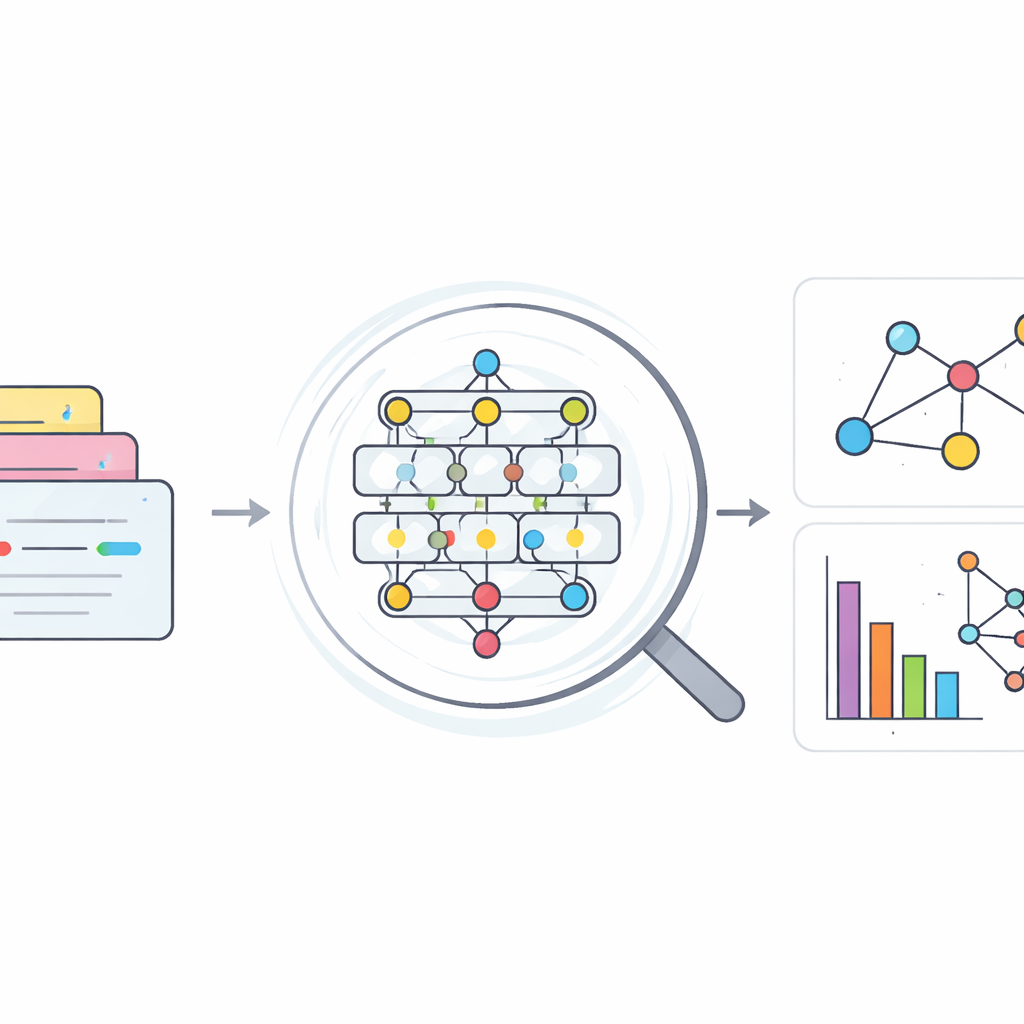

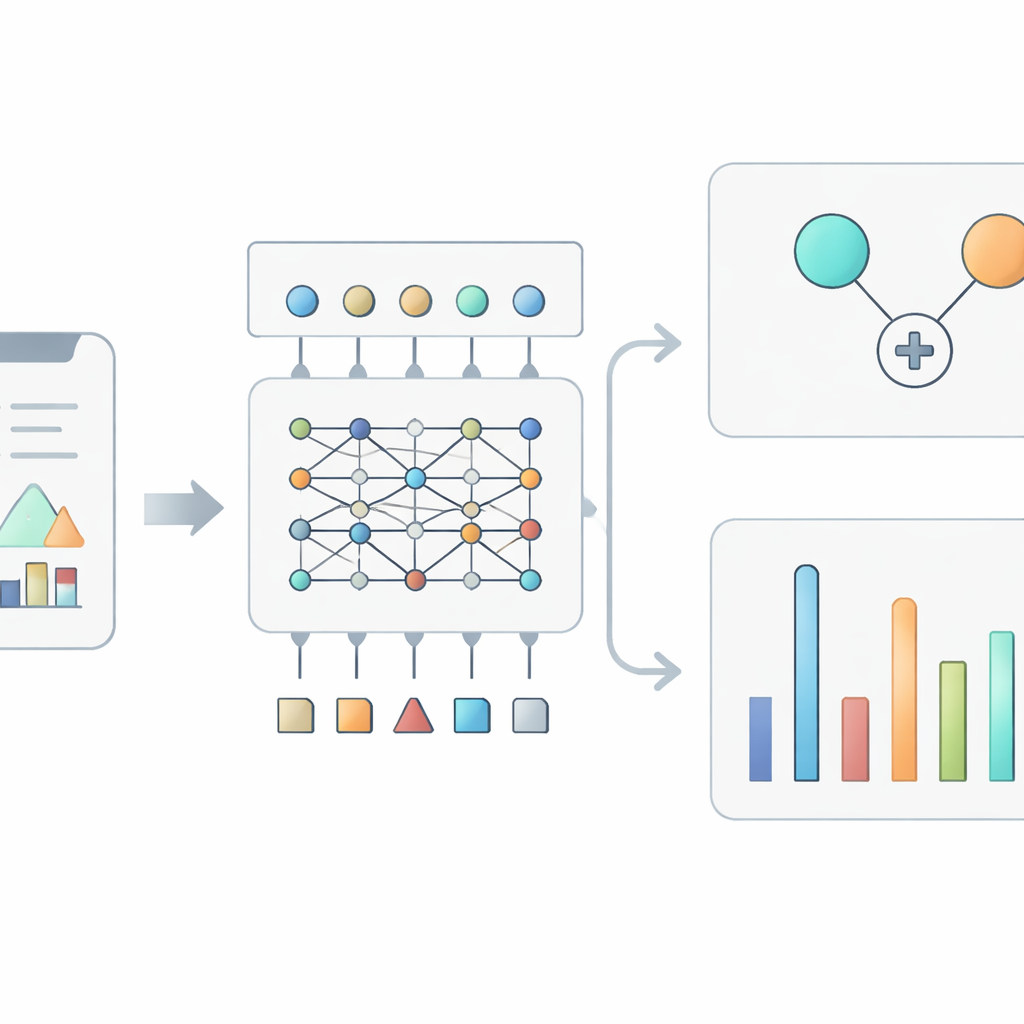

Al centro di questo studio c'è l'idea che ogni problema matematico in forma testuale possa essere visto come una piccola rete di «cose» e «collegamenti». Le cose sono le quantità (come «dodici mango» o «tre bambini»), e il collegamento è l'operazione che le unisce (come dividere, sommare o estrarre una radice quadrata). L'autore considera questi problemi come un compito di «entità–relazione»: i numeri sono entità e l'operazione è la relazione tra di esse. Trasformando frasi disordinate in questa struttura semplice, i computer possono avvicinarsi a come gli esseri umani organizzano internamente un problema matematico prima di risolverlo. Questa struttura può anche alimentare strumenti di ricerca, mappe di conoscenza e assistenti automatici che comprendono testi matematici in libri di testo o articoli di ricerca.

Costruire un dataset di storie matematiche quotidiane

Per addestrare un sistema di intelligenza artificiale a riconoscere queste relazioni, lo studio ha prima avuto bisogno di esempi. L'autore ha assemblato un nuovo dataset combinando due raccolte precedenti di testi matematici in bangla e inglese. Da queste fonti sono state selezionate frasi in inglese e sono state accuratamente identificate le locuzioni numeriche come «cinquemilaquaranta» considerate come singole entità matematiche, non semplici parole sparse. Ogni problema è stato associato alla sua equazione corrispondente per etichettare la relazione tra due quantità chiave come una delle sei operazioni di base: addizione, sottrazione, moltiplicazione, divisione, fattoriale o radice quadrata. Dopo aver rimosso duplicati, ripulito simboli estranei e semplificato il linguaggio tramite passaggi come la rimozione di stop-word e la lemmatizzazione, il dataset finale conteneva 3.284 enunciati matematici distinti con entità e relazioni chiaramente contrassegnate.

Insegnare ai transformer a leggere i problemi matematici

Con il dataset pronto, il passo successivo è stato testare potenti modelli linguistici basati su transformer — la stessa famiglia di modelli che ha trasformato l'elaborazione del linguaggio naturale moderna. Sono stati valutati diversi candidati: BERT, ELECTRA, RoBERTa, ALBERT, DistilBERT e XLNet. A ciascun modello è stato fornito il testo pulito e sono stati fine-tuned in modo che l'output non fosse una soluzione completa del problema, ma semplicemente il tipo di relazione che collega le due quantità principali. La valutazione ha usato misure comuni come accuratezza e punteggi F1 sui dati di test tenuti da parte. BERT è emerso come il chiaro vincitore, identificando correttamente la relazione nella quasi totalità dei casi, con un'accuratezza del 99,39%. Le curve di apprendimento hanno mostrato che il modello migliorava costantemente senza overfitting, e una matrice di confusione ha rivelato solo una manciata di errori, per lo più tra operazioni simili come addizione e sottrazione o divisione e moltiplicazione.

Aprire la scatola nera con spiegazioni

Un'alta accuratezza da sola non basta quando i sistemi di IA sono destinati a supportare l'apprendimento o la ricerca. Gli utenti devono capire perché è stata fatta una determinata previsione. Per affrontare questo aspetto, l'autore ha applicato SHAP, un metodo noto dell'IA spiegabile, al modello BERT addestrato. SHAP assegna a ogni parola in una frase un punteggio di contributo che riflette quanto essa spinga il modello verso o contro una specifica operazione. Alimentando problemi matematici non visti attraverso un explainer SHAP, lo studio ha prodotto visualizzazioni in cui le parole utili risplendono positivamente e quelle fuorvianti spingono nella direzione opposta. Ad esempio, parole come «diviso», «equamente» e «ciascuno» supportano fortemente una previsione di divisione, mentre termini contestuali che non indicano divisione diminuiscono tale fiducia. In molti esempi l'analisi ha mostrato che il modello si basava più su parole indicanti l'operazione che sui numeri grezzi stessi, rispecchiando come gli esseri umani scorrono alla ricerca di indizi come «totale», «da» o «radice quadrata» quando interpretano un problema.

Cosa significa questo per gli strumenti matematici futuri

In termini semplici, questo lavoro dimostra che un moderno modello linguistico può essere addestrato a leggere brevi storie matematiche e identificare quasi perfettamente l'operazione centrale che lega i numeri, mostrando allo stesso tempo il suo ragionamento in modo comprensibile all'uomo. Combinando una costruzione accurata del dataset, un solido modello transformer e spiegazioni basate su SHAP, lo studio propone un quadro trasparente per trasformare problemi matematici narrativi in relazioni strutturate. Questo approccio potrebbe sostenere sistemi futuri che non solo risolvono problemi, ma evidenziano anche le frasi chiave, supportano il controllo automatico di testi matematici e costruiscono mappe ricche e navigabili della conoscenza matematica per studenti e ricercatori.»

Citazione: Aurpa, T.T. Transparent AI for mathematics: transformer-based large language models for mathematical entity relationship extraction with XAI. Sci Rep 16, 13038 (2026). https://doi.org/10.1038/s41598-026-43507-7

Parole chiave: problemi matematici in forma testuale, modelli linguistici transformer, intelligenza artificiale spiegabile, estrazione di relazioni tra entità, spiegazioni SHAP