Clear Sky Science · zh

基于集成的类激活映射框架 MetaCAM 提升模型可解释性

理解 AI 决策内部过程为何重要

现代人工智能能够以超越人类的准确率检测肿瘤、识别人脸并对照片进行分类,但常常无法解释其作出特定决策的原因。这种“黑箱”行为在医疗或自动驾驶等高风险场景中令人不安,因为人们需要知道图像的哪些部分真正影响了预测。本文提出了 MetaCAM,一种将多种现有可视化技术组合成单一、更清晰图像的方法,旨在让图像识别神经网络的关注点更透明、更值得信赖。

机器如何展示它们“看”到了什么

卷积神经网络是图像识别的主力,通过多层处理图像并输出诸如“猫”或“肿瘤”之类的标签。类激活映射(CAM)就是为了解剖这些网络而发明的。CAM 将热图覆盖在原始图像上,突出对所选预测贡献最大的区域。多年来出现了许多 CAM 变体,它们在使用梯度、特征图或图像扰动来估计重要性方面各不相同。然而,它们的性能并不一致:对某一张图像、某一类别或某一模型表现良好的方法,可能对另一种情况效果很差,而且并没有关于哪种 CAM“最好”的普遍共识。

一种团队式方法以获得更清晰的热图

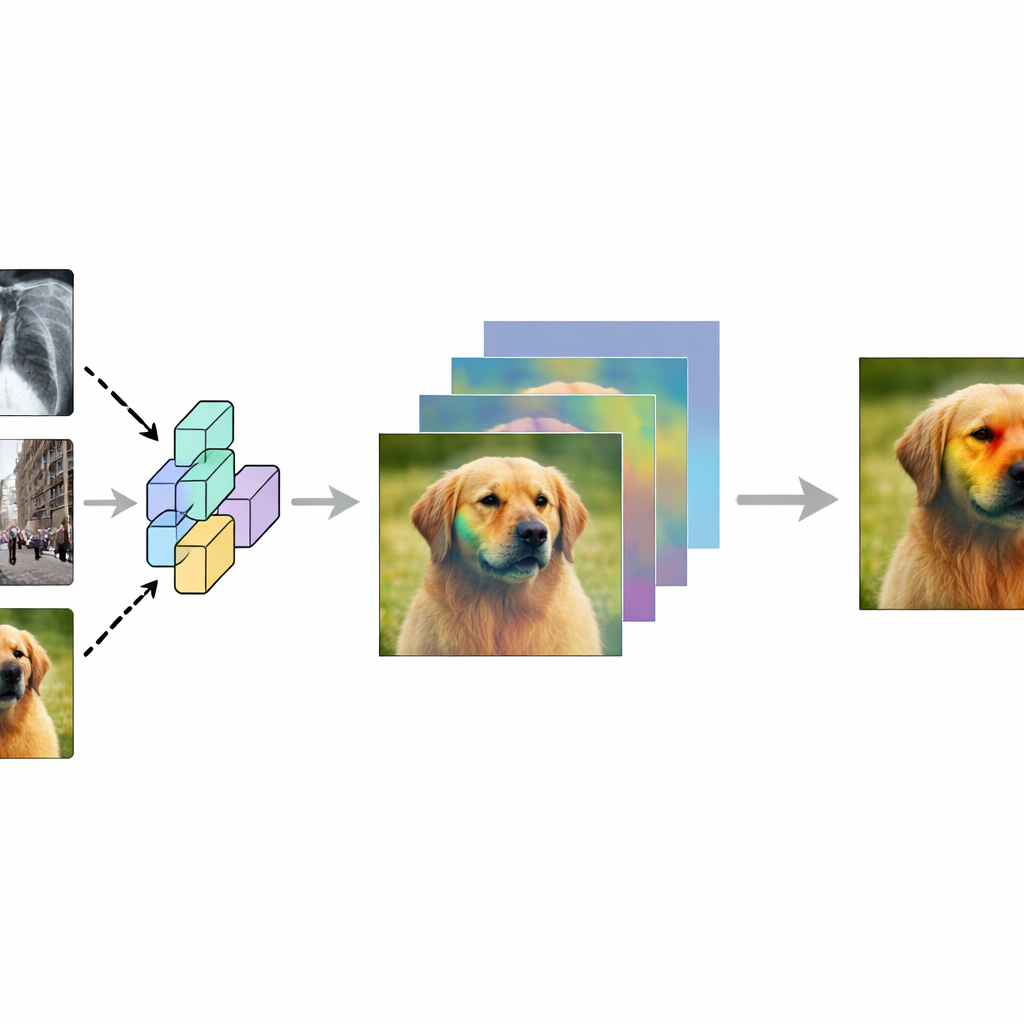

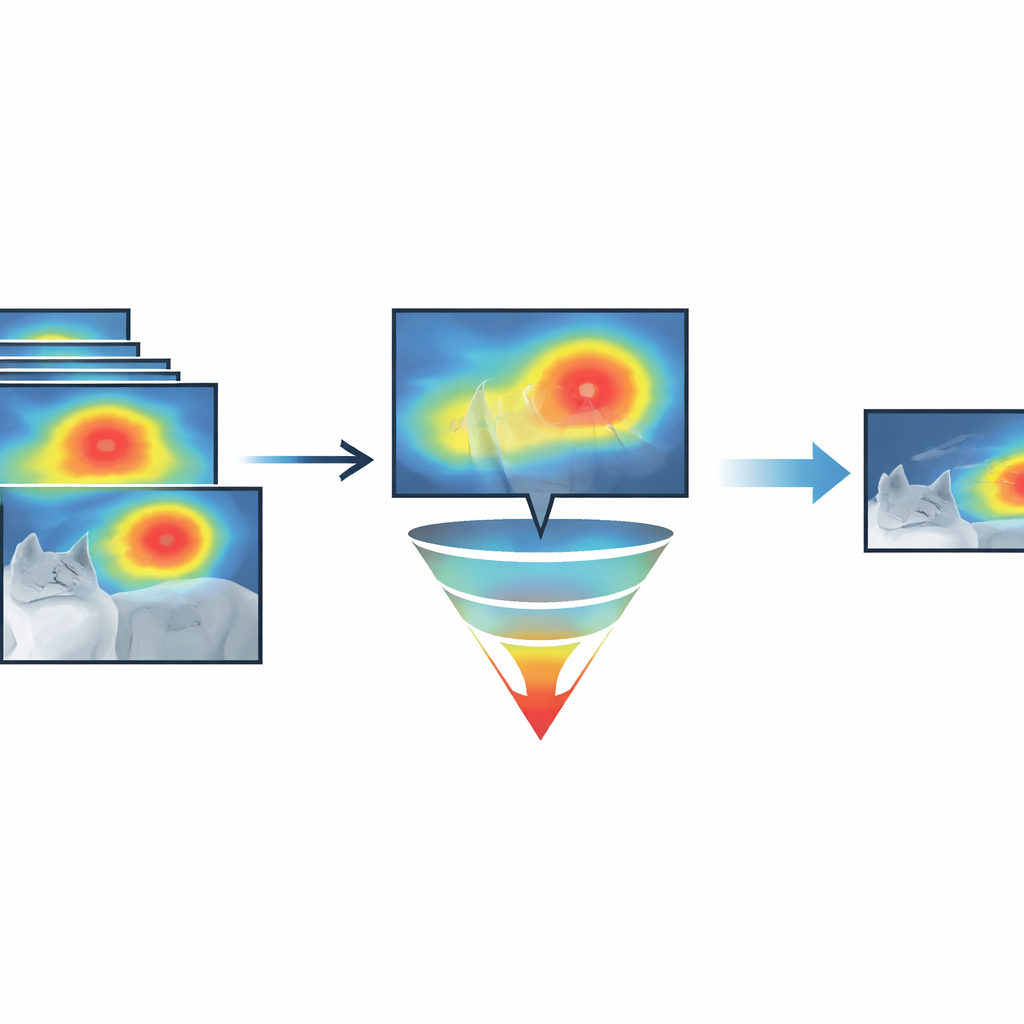

作者提出 MetaCAM,将不同的 CAM 方法视为委员会成员而非竞争对手。MetaCAM 不依赖单一热图,而是先使用多种技术(包括基于梯度的方法、基于扰动的方法,以及像 FullGrad 这样的相关工具)为同一图像和目标类别生成若干张热图。然后寻找共识:那些在多种方法中反复被突出显示的像素被视为更可靠。通过只保留在集成中获得最多、最一致关注的前若干百分比像素,MetaCAM 生成的精炼热图更少受到任何单一方法怪异或失效的影响。

只挑选最有说服力的像素

一个关键创新是“自适应阈值化”,用于决定保留多少最活跃的像素。作者并不是始终固定地保留例如前 30% 像素,而是系统地测试不同的截断阈值,并选择在这些像素被轻度模糊处理时最能反映网络预测变化的阈值。他们依赖一种称为 Remove and Debias(ROAD)的定量测试,该测试衡量在最“重要”像素被扰动时模型置信度下降的程度,以及在最不重要像素被扰动时模型变化的幅度。通过扫描多个阈值,MetaCAM 找到能够在真正关键区域与大体无关区域之间产生最强分离度的水平,同样的思路也可以单独用于提升各个 CAM 方法的表现。

发现哪些方法有帮助——以及哪些出人意料地有帮助

为了弄清哪些成分能让 MetaCAM 达到最佳效果,研究人员进行了大规模实验,在不同组合中开启或关闭若干 CAM 方法。借助高性能计算,他们在许多图像、类别和神经网络架构上评估了 64 种此类组合。随后他们引入了一个称为累积残差效应(Cumulative Residual Effect)的汇总统计量,用以衡量每个方法组相对于实验中位数是倾向于提高还是降低性能。令人惊讶的是,即便是“差”或带噪声的热图——例如经常突出错误对象的 CAM,或由随机噪声生成的图——有时也能改善 MetaCAM,因为它们的存在迫使共识集中于多种方法一致认同的像素,从而减少了其他位置的虚假高亮。

这对更安全、更透明的 AI 意味着什么

在各种测试图像和模型上,结合自适应阈值化的 MetaCAM 在 ROAD 指标下始终优于所有单一可视化方法。实际而言,其热图更精确地标注了真正驱动网络决策的区域,同时滤除了许多单方法热图中存在的杂乱和误导。在医学影像、自动驾驶或生物识别筛查等领域——在这些领域中理解系统为何说“是”或“否”可能与答案本身同样重要——MetaCAM 提供了一个更稳定、基于证据的窗口来审视 AI 推理,帮助专家在将模型投入实际应用前判断其是否关注正确的特征。

引用: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

关键词: 可解释的人工智能, 类激活图, 深度学习, 模型可解释性, 集成方法