Clear Sky Science · fr

MetaCAM, cadre d’interprétation par cartes d’activation en ensemble, améliore l’explicabilité des modèles

Pourquoi il est important de voir l’intérieur des décisions d’une IA

L’intelligence artificielle moderne peut détecter des tumeurs, reconnaître des visages et classer des photos avec une précision surhumaine, mais elle n’est souvent pas capable d’expliquer pourquoi elle a pris une décision particulière. Ce comportement de « boîte noire » est préoccupant dans des contextes à enjeux élevés, comme la médecine ou la conduite autonome, où il est nécessaire de savoir quelles parties d’une image ont réellement influencé une prédiction. Cet article présente MetaCAM, une nouvelle méthode qui combine de nombreuses techniques de visualisation existantes en une image unique et plus claire de ce que regarde un réseau neuronal de reconnaissance d’images, dans le but de rendre les décisions de l’IA plus transparentes et dignes de confiance.

Comment les machines montrent ce qu’elles « regardent »

Les réseaux neuronaux convolutionnels, piliers de la reconnaissance d’images, traitent les images à travers de nombreuses couches puis renvoient une étiquette comme « chat » ou « tumeur ». Les cartes d’activation de classe (CAM) ont été conçues pour nous permettre de jeter un œil à l’intérieur de ces réseaux. Une CAM superpose une carte thermique sur l’image originale, mettant en évidence les régions qui ont le plus contribué à une prédiction donnée. Au fil des ans, de nombreuses variantes de CAM sont apparues, différant par la façon dont elles utilisent les gradients, les cartes de caractéristiques ou les perturbations d’image pour estimer l’importance. Leur performance reste toutefois inégale : une méthode qui fonctionne bien pour une image, une classe ou un modèle peut être médiocre pour un autre, et il n’existe pas de consensus universel sur la « meilleure » CAM.

Une approche collective pour des cartes thermiques plus nettes

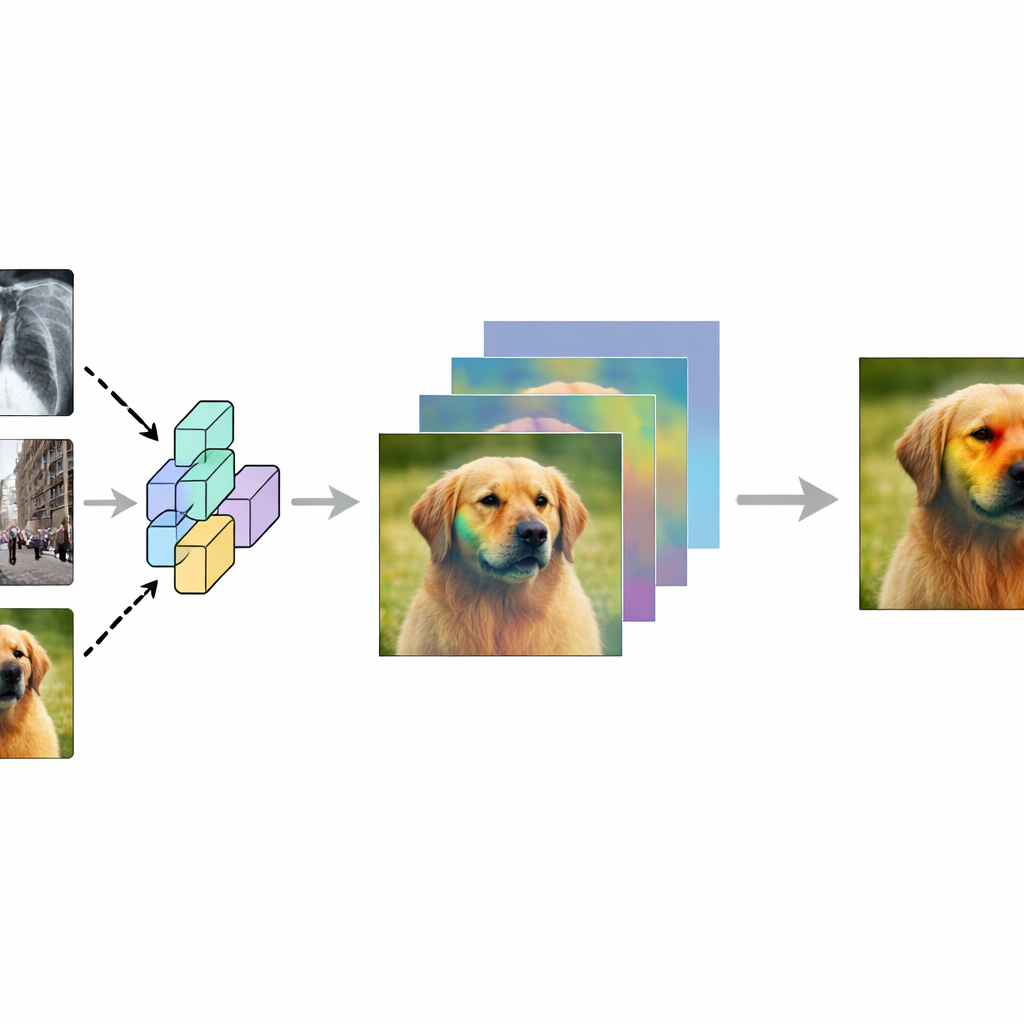

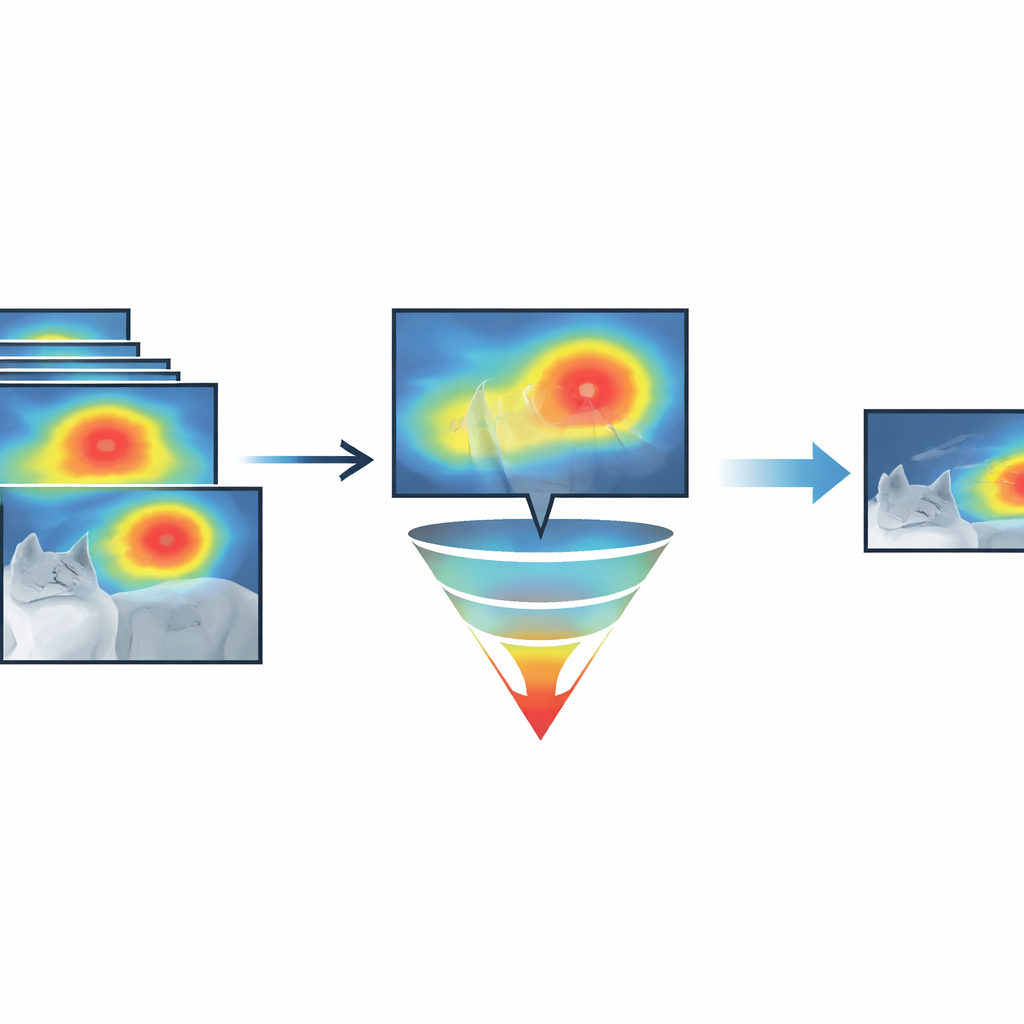

Les auteurs proposent MetaCAM, qui considère les différentes méthodes de CAM comme les membres d’un comité plutôt que comme des rivales. Plutôt que de faire confiance à une seule carte thermique, MetaCAM commence par générer plusieurs cartes pour la même image et la même classe cible en employant des techniques diverses, y compris des méthodes basées sur les gradients, des méthodes par perturbation, et même des outils apparentés comme FullGrad. Il recherche ensuite un consensus : les pixels mis en évidence de façon répétée par plusieurs méthodes sont considérés comme plus fiables. En ne conservant que le pourcentage maximal de pixels qui reçoivent l’attention la plus forte et la plus cohérente à travers l’ensemble, MetaCAM produit une carte affinée moins influencée par les bizarreries ou les échecs d’une méthode unique.

Ne garder que les pixels les plus convaincants

L’une des innovations clés est le « seuillage adaptatif », qui décide combien des pixels les plus actifs doivent être conservés. Plutôt que de toujours mettre en avant, par exemple, les 30 % de pixels les plus actifs, les auteurs testent systématiquement différents seuils et choisissent celui qui correspond le mieux à la façon dont les prédictions du réseau changent lorsque ces pixels sont légèrement floutés. Ils s’appuient sur un test quantitatif appelé Remove and Debias (ROAD), qui mesure dans quelle mesure la confiance du modèle chute lorsque ses pixels les plus « importants » sont perturbés et dans quelle moindre mesure elle change lorsque les pixels les moins importants sont altérés. En balayant de nombreux seuils, MetaCAM trouve le niveau qui offre la meilleure séparation entre les régions réellement cruciales et celles largement non pertinentes ; la même idée peut aussi affiner des méthodes CAM individuelles.

Dépister les méthodes utiles — et celles qui, surprenamment, aident

Pour comprendre quels ingrédients produisent le meilleur MetaCAM, les chercheurs ont mené des expériences à grande échelle qui activaient ou désactivaient des groupes de méthodes CAM selon différentes combinaisons. À l’aide de calcul haute performance, ils ont évalué 64 combinaisons sur de nombreuses images, classes et architectures de réseaux neuronaux. Ils ont ensuite introduit une statistique résumée appelée Effet Résiduel Cumulé, qui capture dans quelle mesure chaque groupe tend à augmenter ou diminuer la performance par rapport à l’expérience médiane. De manière surprenante, même des cartes « mauvaises » ou bruyantes — comme une CAM qui met souvent en avant le mauvais objet, ou une carte générée à partir d’un bruit aléatoire — peuvent parfois améliorer MetaCAM, car leur présence contraint le consensus à se resserrer autour des pixels sur lesquels plusieurs méthodes s’accordent, réduisant ainsi les mises en évidence erronées ailleurs.

Ce que cela signifie pour une IA plus sûre et plus transparente

Sur une grande variété d’images et de modèles testés, MetaCAM, avec seuillage adaptatif, a systématiquement surpassé toutes les méthodes de visualisation individuelles selon la métrique ROAD. Concrètement, ses cartes thermiques marquent plus précisément les régions qui pilotent réellement la décision d’un réseau, tout en filtrant une grande partie du désordre et de la désinformation présents dans les cartes mono‑méthode. Pour des domaines comme l’imagerie médicale, les véhicules autonomes ou le contrôle biométrique — où comprendre pourquoi un système a répondu « oui » ou « non » peut être aussi important que la réponse elle‑même — MetaCAM offre une fenêtre plus stable et fondée sur des preuves sur le raisonnement de l’IA, aidant les experts à juger si un modèle se concentre sur les bonnes caractéristiques avant de lui faire confiance dans le monde réel.

Citation: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Mots-clés: IA explicable, cartes d’activation de classe, apprentissage profond, interprétabilité des modèles, méthodes d’ensemble