Clear Sky Science · de

MetaCAM als ensemblebasiertes Class‑Activation‑Mapping‑Framework verbessert die Erklärbarkeit von Modellen

Warum es wichtig ist, in KI‑Entscheidungen hineinzusehen

Moderne künstliche Intelligenz kann Tumore erkennen, Gesichter identifizieren und Fotos mit übermenschlicher Genauigkeit klassifizieren, erklärt aber oft nicht, warum sie zu einer bestimmten Entscheidung gekommen ist. Dieses „Black‑Box“-Verhalten ist in risikoreichen Bereichen wie der Medizin oder beim autonomen Fahren problematisch, wo Menschen wissen müssen, welche Bildbereiche eine Vorhersage tatsächlich beeinflusst haben. Dieser Artikel stellt MetaCAM vor, eine neue Methode, die viele bestehende Visualisierungstechniken zu einem klareren Gesamtbild kombiniert, um transparenter und vertrauenswürdiger darzustellen, worauf ein bildverarbeitendes neuronales Netz achtet.

Wie Maschinen zeigen, worauf sie „schauen“

Convolutional Neural Networks, die Arbeitspferde der Bilderkennung, verarbeiten Bilder über viele Schichten und geben dann ein Label wie „Katze“ oder „Tumor“ aus. Class Activation Maps (CAMs) wurden entwickelt, um einen Blick in diese Netze zu ermöglichen. Ein CAM legt eine Heatmap über das Originalbild, die Regionen hervorhebt, die am stärksten zu einer gewählten Vorhersage beigetragen haben. Im Laufe der Zeit sind viele CAM‑Varianten entstanden, die sich darin unterscheiden, wie sie Gradienten, Feature‑Maps oder Bildperturbationen zur Abschätzung der Relevanz nutzen. Ihre Leistung ist jedoch inkonsistent: Eine Methode, die für ein bestimmtes Bild, eine Klasse oder ein Modell gut funktioniert, kann bei einem anderen schlechter abschneiden, und es gibt keine allgemeine Einigkeit darüber, welcher CAM‑Ansatz „der beste“ ist.

Ein Teamansatz für klarere Heatmaps

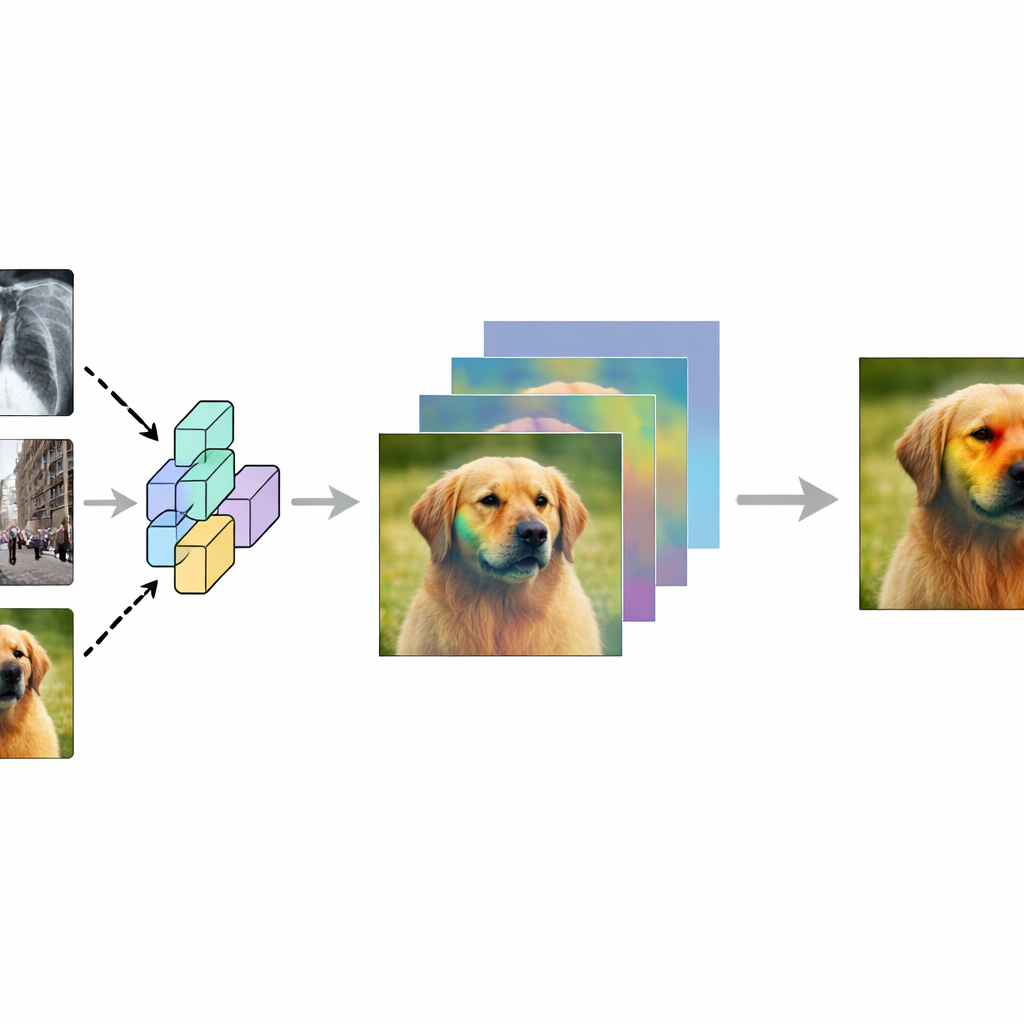

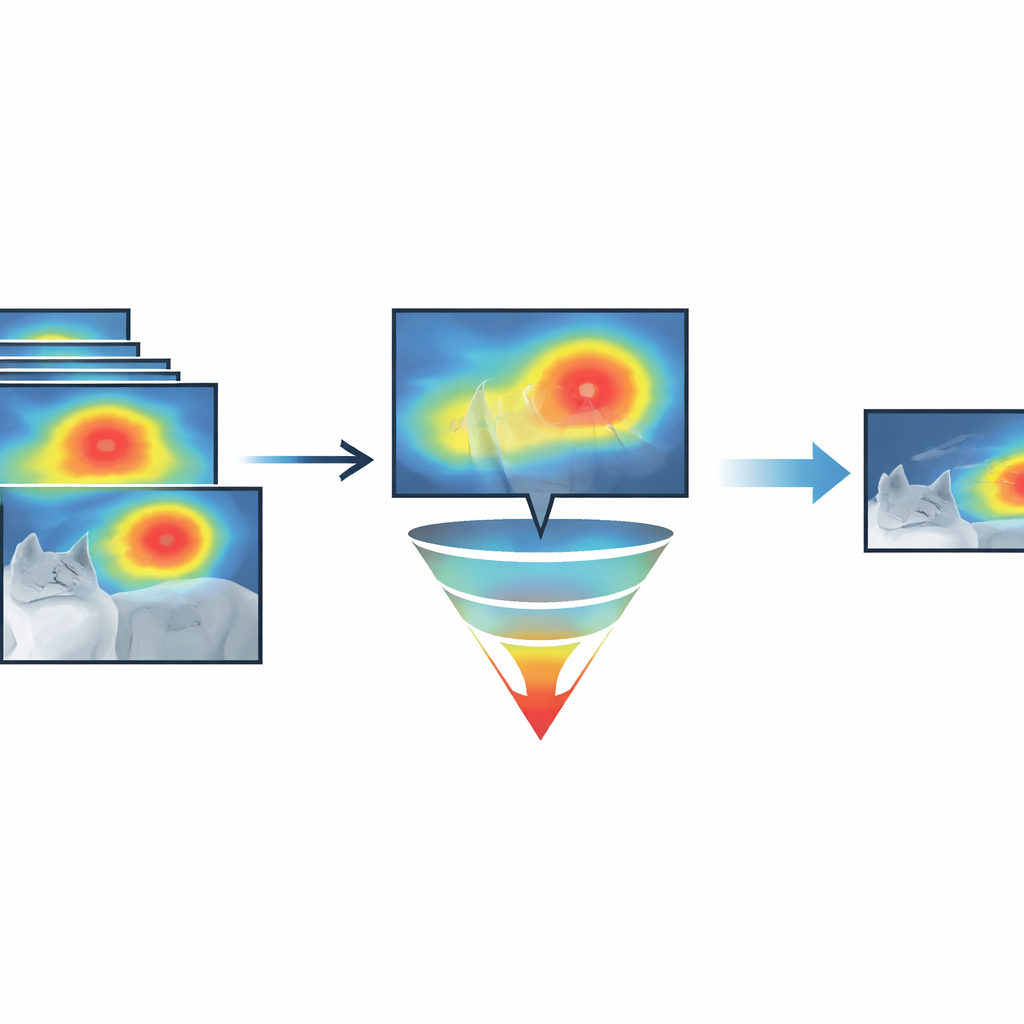

Die Autoren schlagen MetaCAM vor, das verschiedene CAM‑Methoden eher wie Mitglieder eines Gremiums denn als Rivalen behandelt. Anstatt einer einzigen Heatmap zu vertrauen, erzeugt MetaCAM zunächst mehrere Karten für dasselbe Bild und die Zielklasse mit unterschiedlichen Techniken, darunter gradientenbasierte Methoden, perturbationsbasierte Verfahren und verwandte Werkzeuge wie FullGrad. Anschließend sucht es nach Konsens: Pixel, die wiederholt von verschiedenen Methoden hervorgehoben werden, gelten als zuverlässiger. Indem nur der obere Prozentsatz der Pixel beibehalten wird, die über das Ensemble hinweg die stärkste und konsistenteste Aufmerksamkeit erhalten, erzeugt MetaCAM eine verfeinerte Heatmap, die weniger von den Eigenheiten oder Ausfällen einzelner Methoden beeinflusst ist.

Nur die überzeugendsten Pixel auswählen

Eine wichtige Innovation ist das „adaptive Thresholding“, das entscheidet, wie viele der aktivsten Pixel erhalten bleiben. Anstatt immer beispielsweise die obersten 30 Prozent der Pixel hervorzuheben, testen die Autoren systematisch verschiedene Schwellenwerte und wählen denjenigen, der am besten dazu passt, wie sich die Netzvorhersagen ändern, wenn diese Pixel sanft verwischt werden. Sie stützen sich auf einen quantitativen Test namens Remove and Debias (ROAD), der misst, wie stark das Vertrauen des Modells abnimmt, wenn seine wichtigsten Pixel perturbiert werden, und wie wenig es sich ändert, wenn die am wenigsten wichtigen Pixel gestört werden. Durch das Durchsuchen vieler Schwellenwerte findet MetaCAM das Niveau, das die stärkste Trennung zwischen wirklich entscheidenden und weitgehend irrelevanten Regionen liefert; dieselbe Idee kann auch einzelne CAM‑Methoden für sich verbessern.

Welche Methoden helfen — und welche überraschend nützlich sind

Um zu verstehen, welche Bestandteile das beste MetaCAM ergeben, führten die Forscher groß angelegte Experimente durch, in denen Gruppen von CAM‑Methoden in verschiedenen Kombinationen ein- oder ausgeschaltet wurden. Mit Hochleistungsrechnern bewerteten sie 64 solcher Kombinationen über viele Bilder, Klassen und Netzwerkarchitekturen hinweg. Anschließend führten sie eine zusammenfassende Kennzahl namens Cumulative Residual Effect ein, die erfasst, wie sehr jede Gruppe die Leistung im Vergleich zum Medianexperiment tendenziell erhöht oder verringert. Überraschenderweise können sogar „schlechte“ oder rauschende Karten — etwa ein CAM, das oft das falsche Objekt hervorhebt, oder eine Karte aus zufälligem Rauschen — MetaCAM manchmal verbessern, weil ihre Präsenz den Konsens dazu zwingt, sich auf Pixel zu konzentrieren, die mehrere Methoden übereinstimmend hervorheben, wodurch falsche Hervorhebungen anderswo reduziert werden.

Was das für sicherere, transparentere KI bedeutet

Über eine große Vielfalt von Testbildern und Modellen hinweg übertraf MetaCAM mit adaptivem Thresholding konstant alle einzelnen Visualisierungsmethoden nach der ROAD‑Metrik. Praktisch bedeutet das, dass seine Heatmaps die Bereiche präziser markieren, die tatsächlich die Entscheidung eines Netzes antreiben, während viel vom Durcheinander und der Irreführung einzelner Methoden herausgefiltert wird. Für Bereiche wie medizinische Bildgebung, autonome Fahrzeuge oder biometrische Prüfungen — in denen das Verständnis, warum ein System „ja“ oder „nein“ sagt, genauso wichtig sein kann wie die Antwort selbst — bietet MetaCAM ein stabileres, evidenzbasiertes Fenster in die KI‑Begründung und hilft Expertinnen und Experten zu beurteilen, ob ein Modell auf die richtigen Merkmale fokussiert, bevor sie ihm im realen Einsatz vertrauen.

Zitation: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Schlüsselwörter: erklärbare KI, Class Activation Maps, Deep Learning, Modellinterpretierbarkeit, Ensemble‑Methoden