Clear Sky Science · ja

メタCAM:アンサンブル型クラス活性化マッピングフレームワークがモデルの説明性を向上させる

AIの判断内部を可視化する重要性

現代の人工知能は腫瘍の検出、人物認識、画像分類などで人間を上回る精度を示しますが、なぜ特定の判断に至ったのかを説明できないことが少なくありません。この「ブラックボックス」的な振る舞いは、医療や自動運転のような高リスク領域では問題になります。人は予測に影響を与えた画像の領域を知る必要があるからです。本論文はMetaCAMを提案します。既存の多数の可視化手法を組み合わせて、画像認識ニューラルネットワークが何を注視しているのかをより明確に示す手法であり、AIの判断を透明で信頼できるものにすることを目指します。

機械はどうやって「見ている」場所を示すか

画像認識の主役である畳み込みニューラルネットワークは、画像を多数の層で処理して「猫」や「腫瘍」といったラベルを出力します。クラス活性化マップ(CAM)はこの内部をのぞくために考案されました。CAMは元の画像にヒートマップを重ね、ある予測に大きく寄与した領域を強調表示します。これまでに多くのCAM派生法が提案され、勾配や特徴マップ、画像摂動の使い方が異なる方法が存在します。しかし、手法ごとの性能は一貫しておらず、ある画像・クラス・モデルで有効な手法が別では不十分になることがあり、どのCAMが「最良」か合意が得られていません。

より明瞭なヒートマップのためのチームアプローチ

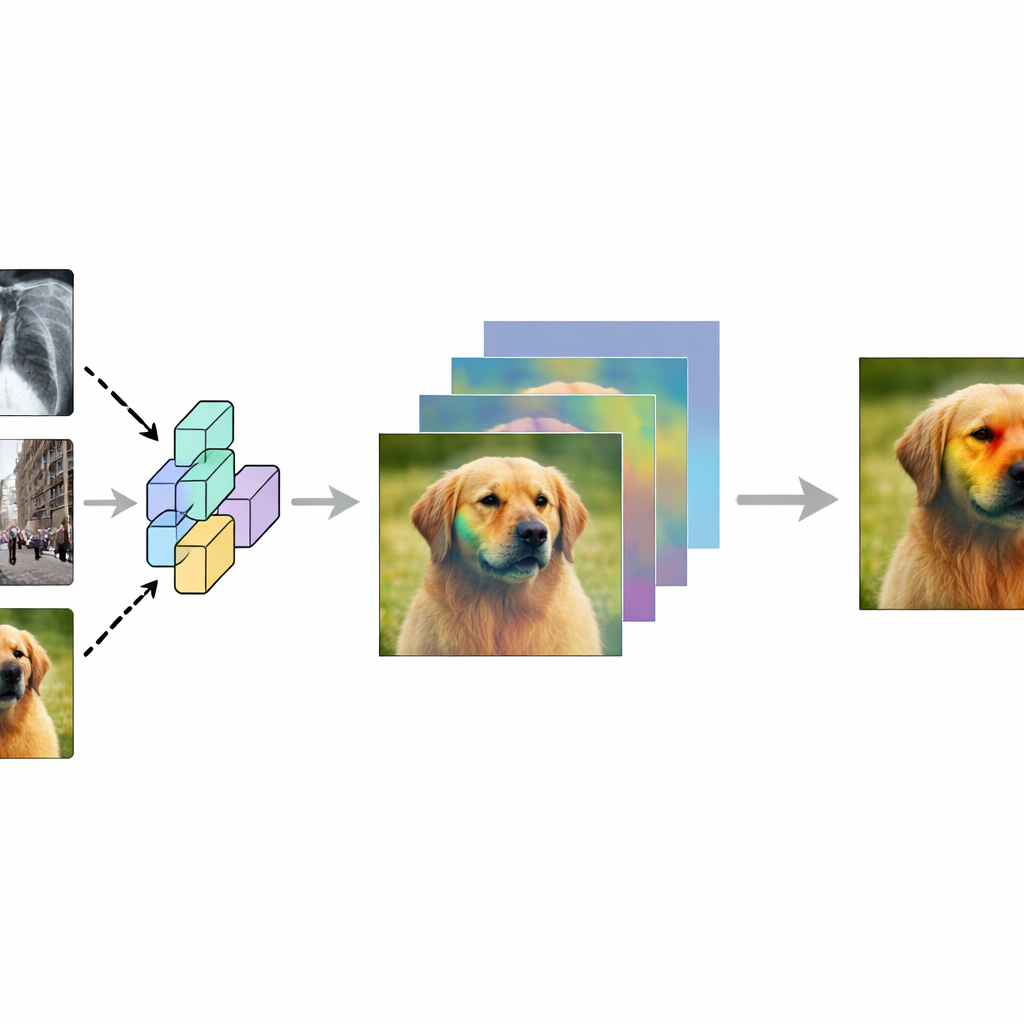

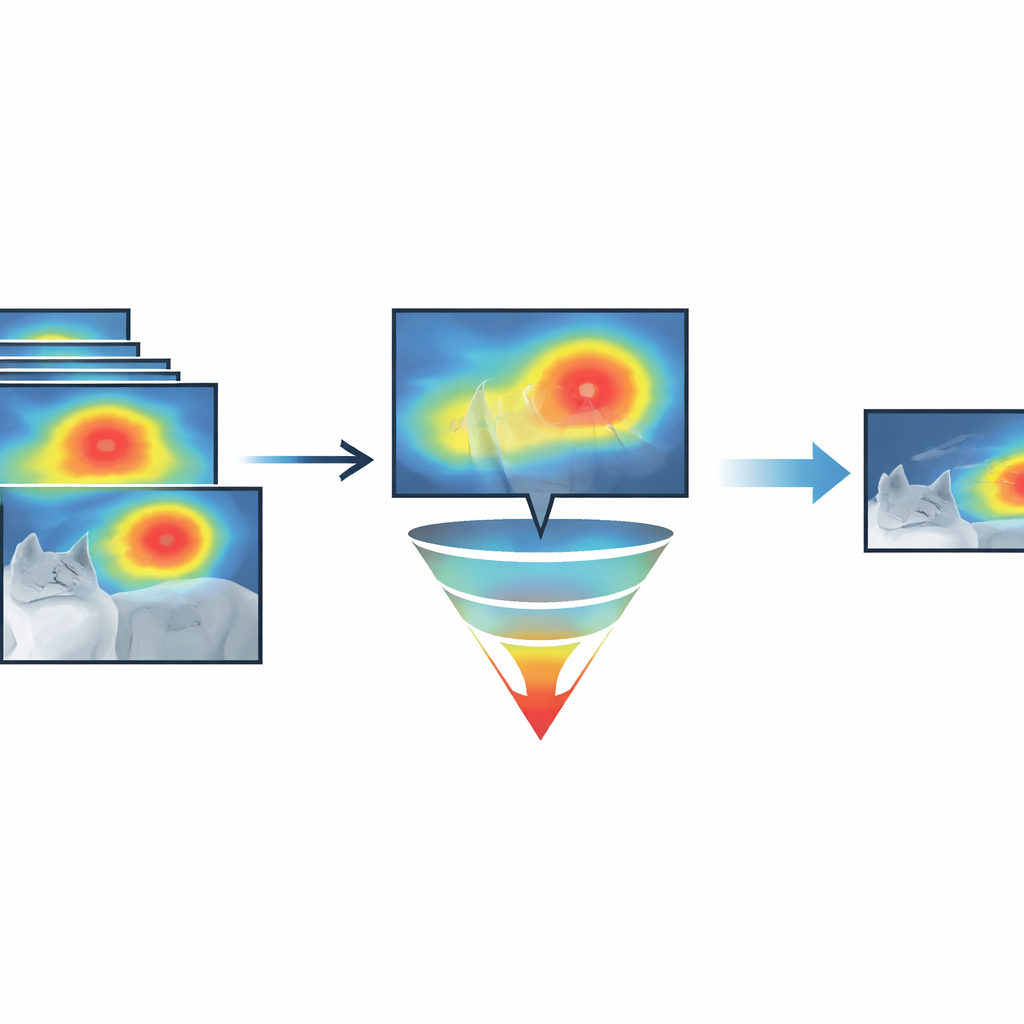

著者らはMetaCAMを提案し、異なるCAM手法をライバルではなく委員会の構成員のように扱います。単一のヒートマップを信用する代わりに、MetaCAMはまず同じ画像と対象クラスに対して勾配ベース手法、摂動ベース手法、FullGradのような関連手法を含む多様な技術で複数のマップを生成します。次にコンセンサスを探します:複数手法で繰り返し強調されるピクセルはより信頼できると見なします。アンサンブル全体で一貫して最も強い注目を受けた上位のピクセルのみを残すことで、MetaCAMは個々の手法の特異性や失敗に左右されにくい洗練されたヒートマップを生成します。

最も説得力のあるピクセルだけを選ぶ

重要な革新は「適応的閾値設定」であり、どの程度のアクティブなピクセルを残すかを決めます。常に例えば上位30%のピクセルを強調するのではなく、著者らは異なるカットオフを系統的にテストし、それらのピクセルをぼかしたときにネットワークの予測がどのように変化するかと最もよく一致する閾値を選びます。彼らはRemove and Debias(ROAD)という定量的検査を用います。これは、モデルの最も「重要」とされるピクセルを摂動したときに確信度がどれだけ低下するか、最も重要でないピクセルを摂動したときにどれだけ変化が小さいかを測定するものです。多数の閾値を走査することで、MetaCAMは本当に重要な領域とほとんど無関係な領域の間で最も強い分離を与えるレベルを見つけます。この考えは個々のCAM手法の改善にも応用できます。

どの手法が役に立ち、驚くべき貢献をするかの発見

最適なMetaCAMの構成要素を理解するため、研究者らは大規模な実験を行い、様々な組み合わせでCAM手法のオン/オフを切り替えました。高性能コンピューティングを用いて、多数の画像・クラス・ニューラルネットワークアーキテクチャに対して64の組み合わせを評価しました。次にCumulative Residual Effectという要約統計量を導入し、各グループが中央値実験に対して性能をどれだけ上げ下げする傾向があるかを捉えました。驚くべきことに、しばしば誤った物体を強調するような「悪い」ノイズの多いマップやランダムノイズから作ったマップですら、MetaCAMを改善することがありました。なぜならそれらの存在が、複数手法が一致するピクセルにコンセンサスを集中させ、他の箇所の偽の強調を減らすからです。

より安全で透明なAIへの意味

多様なテスト画像とモデルにわたり、適応的閾値設定を伴うMetaCAMはROAD指標において一貫して個々の可視化手法を上回りました。実務的には、そのヒートマップはネットワークの判断を実際に駆動する領域をより正確に示し、単一手法のマップに見られる雑音や誤導を大幅に除去します。医用画像、自律走行、バイオメトリクスなどの分野では、システムが「はい」あるいは「いいえ」と答えた理由を理解することが結果と同じくらい重要となる場合があり、MetaCAMはAIの推論をより安定的かつ証拠に基づいて可視化する窓を提供し、実運用でモデルを信頼する前に専門家がモデルが正しい特徴に注目しているかを判断する手助けをします。

引用: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

キーワード: 説明可能なAI, クラス活性化マップ, ディープラーニング, モデルの解釈可能性, アンサンブル手法