Clear Sky Science · nl

MetaCAM als een op ensemble gebaseerde class activation mapping‑framework verbetert de uitlegbaarheid van modellen

Waarom het inzicht in AI‑beslissingen telt

Moderne kunstmatige intelligentie kan tumoren opsporen, gezichten herkennen en foto’s classificeren met bovenmenselijke nauwkeurigheid, maar kan vaak niet uitleggen waarom een bepaalde beslissing is genomen. Dit “black box”-gedrag is zorgwekkend in situaties met hoge inzet, zoals de geneeskunde of zelfrijdende auto’s, waar men moet weten welke delen van een afbeelding daadwerkelijk invloed hadden op een voorspelling. Dit artikel introduceert MetaCAM, een nieuwe manier om veel bestaande visualisatietechnieken te combineren tot één duidelijker beeld van waar een beeldherkennings‑neuraal netwerk naar kijkt, met als doel AI‑beslissingen transparanter en betrouwbaarder te maken.

Hoe machines laten zien waar ze "naar kijken"

Convolutionele neurale netwerken, de werkpaarden van beeldherkenning, verwerken afbeeldingen via vele lagen en geven vervolgens een label zoals “kat” of “tumor”. Class Activation Maps (CAMs) zijn ontwikkeld zodat we in deze netwerken kunnen kijken. Een CAM legt een heatmap over de originele afbeelding en markeert regio’s die het meest bijdroegen aan een bepaalde voorspelling. Door de jaren heen zijn er veel CAM‑varianten ontstaan, die verschillen in hoe ze gebruikmaken van gradients, feature maps of beeldperturbaties om belangrijkheid te schatten. Hun prestaties zijn echter inconsistent: een methode die goed werkt voor één afbeelding, klasse of model kan slecht presteren voor een ander, en er bestaat geen universele overeenstemming over welke CAM het “beste” is.

Een teamaanpak voor helderdere heatmaps

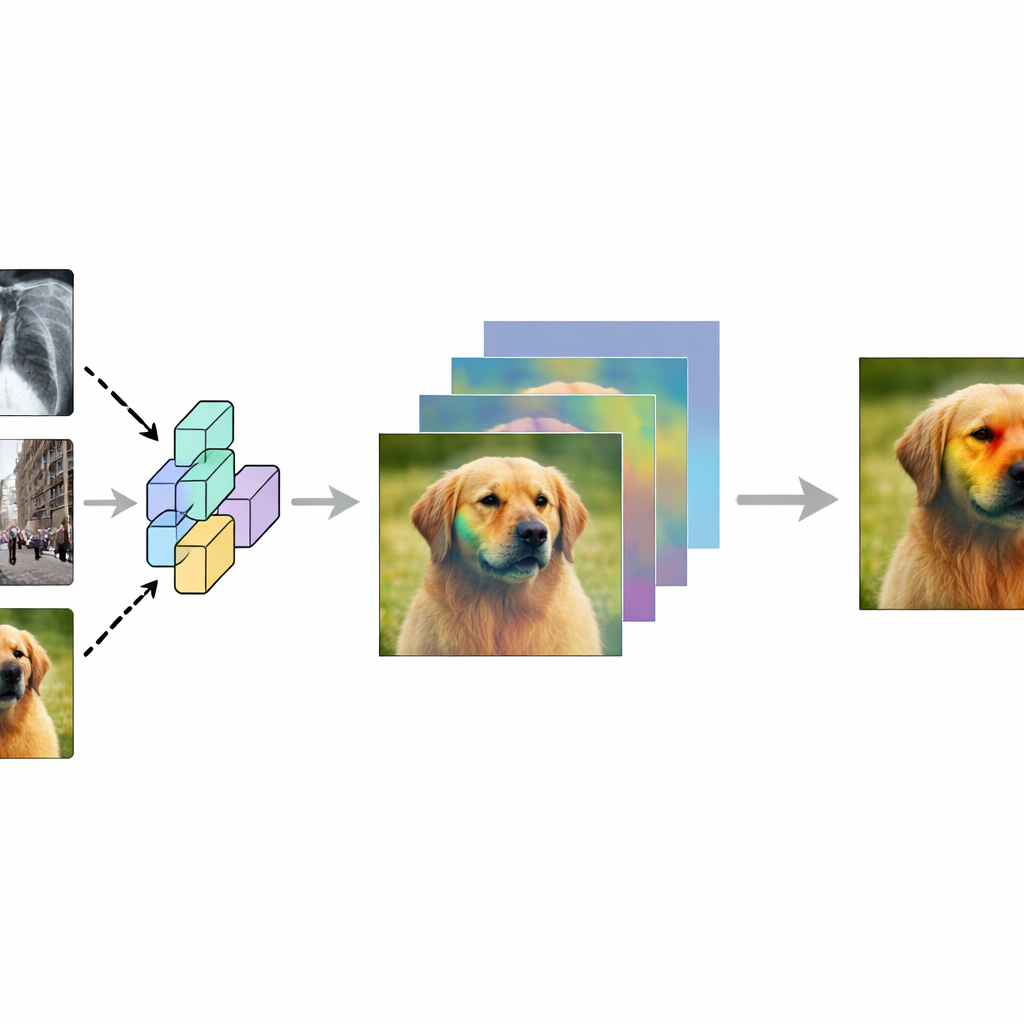

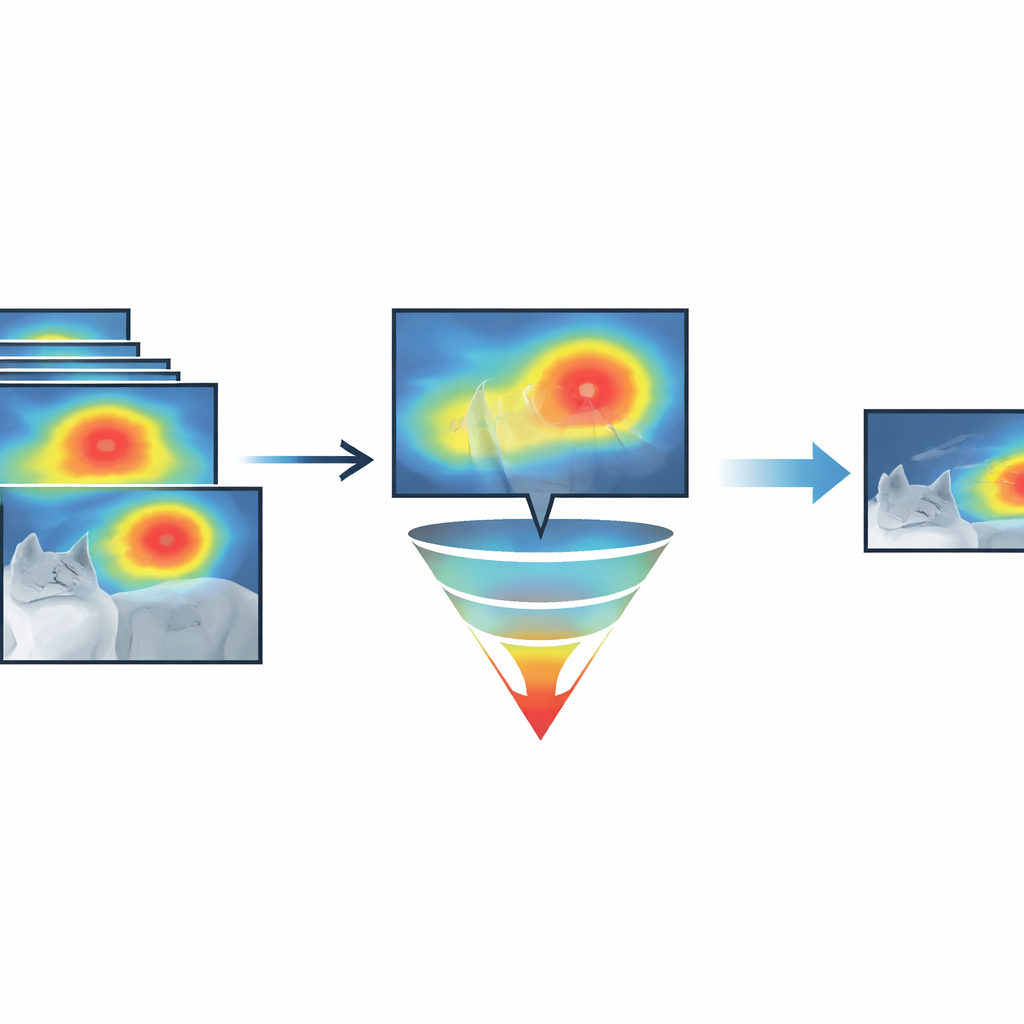

De auteurs stellen MetaCAM voor, dat verschillende CAM‑methoden behandelt als leden van een commissie in plaats van concurrenten. In plaats van op één heatmap te vertrouwen, genereert MetaCAM meerdere kaarten voor dezelfde afbeelding en doelklasse met diverse technieken, waaronder gradient‑gebaseerde methoden, perturbatiegebaseerde methoden en gerelateerde hulpmiddelen zoals FullGrad. Daarna zoekt het naar consensus: pixels die herhaaldelijk door meerdere methoden worden gemarkeerd worden als betrouwbaarder gezien. Door alleen het bovenste percentage pixels te behouden die de sterkste, meest consistente aandacht over het ensemble krijgen, produceert MetaCAM een verfijnde heatmap die minder wordt beïnvloed door eigenaardigheden of mislukkingen van één enkele methode.

Alleen de meest overtuigende pixels kiezen

Een kerninnovatie is “adaptieve drempelbepaling”, die beslist hoeveel van de meest actieve pixels behouden moeten blijven. In plaats van altijd bijvoorbeeld de top 30 procent van pixels te markeren, testen de auteurs systematisch verschillende cutoffwaarden en kiezen ze degene die het beste overeenkomt met hoe de netwerkvoorspellingen veranderen als die pixels zachtjes worden vervaagd. Ze vertrouwen op een kwantitatieve test genaamd Remove and Debias (ROAD), die meet hoeveel het vertrouwen van het model daalt wanneer de meest “belangrijke” pixels worden verstoord en hoe weinig het verandert wanneer de minst belangrijke pixels worden verstoord. Door over veel drempels te scannen, vindt MetaCAM het niveau dat de sterkste scheiding geeft tussen werkelijk cruciale en grotendeels irrelevante regio’s, en ditzelfde idee kan ook individuele CAM‑methoden op zichzelf verscherpen.

Ontdekken welke methoden helpen — en welke verrassend genoeg ook

Om te begrijpen welke ingrediënten de beste MetaCAM opleveren, voerden de onderzoekers grootschalige experimenten uit waarin groepen CAM‑methoden in verschillende combinaties aan- of uitgezet werden. Met behulp van high‑performance computing evalueerden ze 64 dergelijke combinaties over vele afbeeldingen, klassen en neurale netwerkarchitecturen. Vervolgens introduceerden ze een samenvattende statistiek genaamd het Cumulative Residual Effect, die vastlegt in welke mate elke groep de prestatie boven of onder de mediaan van de experimenten brengt. Verrassend genoeg kunnen zelfs “slechte” of rumoerige kaarten — zoals een CAM die vaak het verkeerde object benadrukt, of een kaart gemaakt van willekeurige ruis — soms MetaCAM verbeteren, omdat hun aanwezigheid de consensus dwingt zich te concentreren op pixels waar meerdere methoden het over eens zijn, waardoor spookachtige markeringen elders verminderen.

Wat dit betekent voor veiliger, transparantere AI

Over een breed scala aan testafbeeldingen en modellen presteerde MetaCAM, met adaptieve drempelbepaling, consequent beter dan alle individuele visualisatiemethoden volgens de ROAD‑metric. In praktische termen markeren de heatmaps nauwkeuriger de regio’s die daadwerkelijk de beslissing van een netwerk aansturen, terwijl veel van de rommel en misleiding die in kaarten van één methode voorkomt wordt weggefilterd. Voor domeinen zoals medische beeldvorming, autonome voertuigen of biometrische screening — waar het begrijpen waarom een systeem “ja” of “nee” zei net zo belangrijk kan zijn als het antwoord zelf — biedt MetaCAM een stabieler, op bewijs gebaseerd venster in AI‑redenering, waardoor experts kunnen beoordelen of een model zich op de juiste kenmerken richt voordat ze het in de echte wereld vertrouwen.

Bronvermelding: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Trefwoorden: verklaarbare AI, class activation maps, deep learning, modelinterpretatie, ensemblemethoden