Clear Sky Science · es

MetaCAM como marco de mapeo de activación de clase basado en ensambles mejora la explicabilidad del modelo

Por qué importa ver el interior de las decisiones de la IA

La inteligencia artificial moderna puede detectar tumores, reconocer rostros y clasificar imágenes con precisión sobrehumana, pero a menudo no puede explicar por qué tomó una decisión determinada. Este comportamiento de “caja negra” resulta preocupante en entornos de alto riesgo como la medicina o los vehículos autónomos, donde las personas necesitan saber qué partes de una imagen influyeron realmente en una predicción. Este artículo presenta MetaCAM, una nueva forma de combinar muchas técnicas de visualización existentes en una única imagen más clara de lo que una red neuronal de reconocimiento de imágenes está observando, con el objetivo de hacer las decisiones de la IA más transparentes y confiables.

Cómo muestran las máquinas lo que “miran”

Las redes neuronales convolucionales, pilares del reconocimiento de imágenes, procesan fotografías a través de muchas capas y luego generan una etiqueta como “gato” o “tumor”. Los Mapas de Activación de Clase (CAM) se crearon para poder asomarnos dentro de estas redes. Un CAM superpone un mapa de calor sobre la imagen original, destacando las regiones que más contribuyeron a una predicción elegida. A lo largo de los años han surgido muchas variantes de CAM, que difieren en cómo usan gradientes, mapas de características o perturbaciones de la imagen para estimar la importancia. Sin embargo, su rendimiento es inconsistente: un método que funciona bien para una imagen, clase o modelo puede fallar en otro, y no existe un consenso universal sobre qué CAM es el “mejor”.

Un enfoque en equipo para mapas de calor más claros

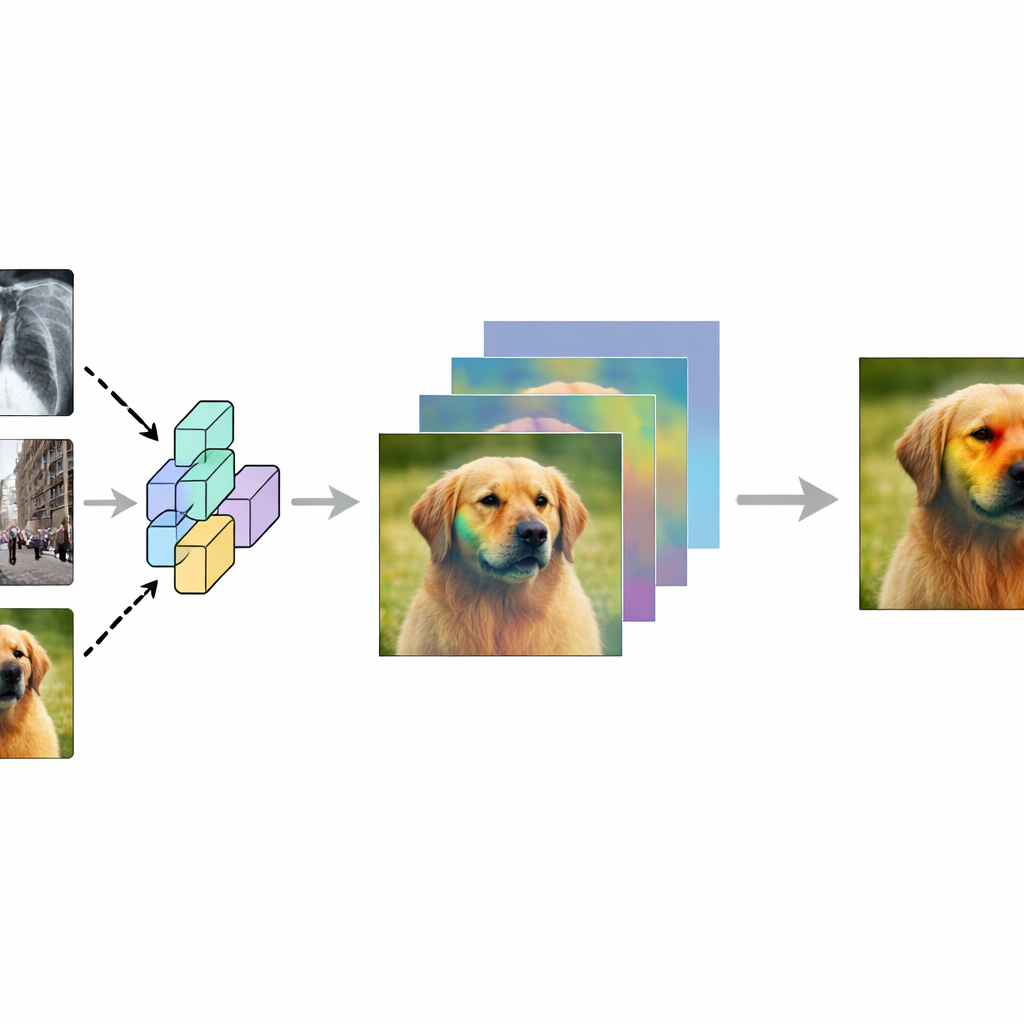

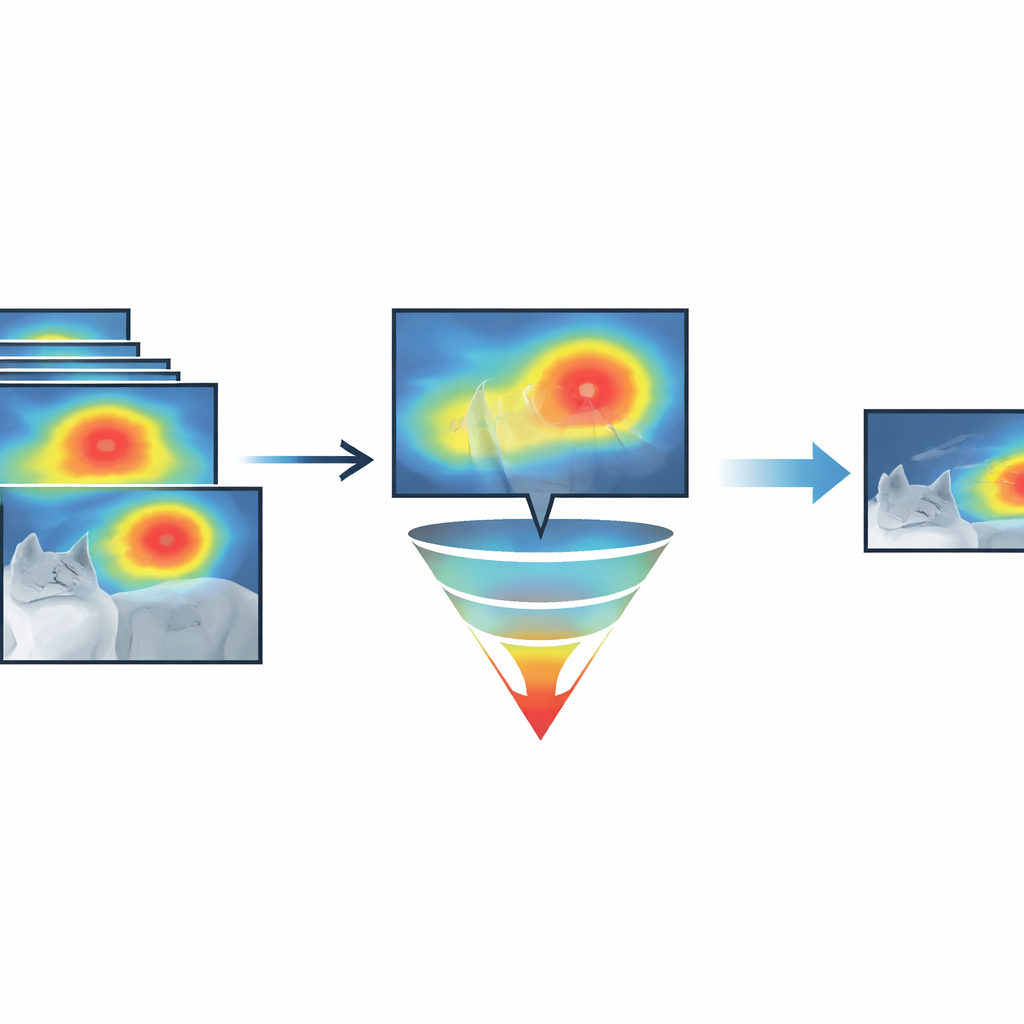

Los autores proponen MetaCAM, que trata a los distintos métodos de CAM como miembros de un comité en lugar de rivales. En lugar de confiar en un solo mapa de calor, MetaCAM comienza generando varios mapas para la misma imagen y clase objetivo usando técnicas diversas, incluidos métodos basados en gradientes, en perturbaciones e incluso herramientas relacionadas como FullGrad. Luego busca consenso: los píxeles que se resaltan repetidamente entre los métodos se consideran más fiables. Al conservar solo el porcentaje superior de píxeles que reciben la atención más fuerte y consistente en el ensamble, MetaCAM produce un mapa de calor refinado que está menos influido por las particularidades o fallos de cualquier método individual.

Seleccionar solo los píxeles más convincentes

Una innovación clave es el “umbral adaptativo”, que decide cuántos de los píxeles más activos conservar. En lugar de resaltar siempre, por ejemplo, el 30 por ciento superior de píxeles, los autores prueban sistemáticamente distintos cortes y eligen el que mejor coincide con cómo cambian las predicciones de la red cuando esos píxeles se difuminan suavemente. Se basan en una prueba cuantitativa llamada Remove and Debias (ROAD), que mide cuánto cae la confianza del modelo cuando se perturban sus píxeles más “importantes” y cuánto cambia cuando se alteran los menos importantes. Al explorar muchos umbrales, MetaCAM encuentra el nivel que ofrece la separación más fuerte entre regiones realmente cruciales y regiones en gran medida irrelevantes, y esta misma idea también puede afinar los métodos CAM individuales por sí solos.

Descubrir qué métodos ayudan — y cuáles sorprendentemente lo hacen

Para entender qué ingredientes hacen el mejor MetaCAM, los investigadores realizaron experimentos a gran escala que activaron o desactivaron grupos de métodos CAM en diferentes combinaciones. Usando computación de alto rendimiento, evaluaron 64 combinaciones de este tipo a lo largo de muchas imágenes, clases y arquitecturas neuronales. Luego introdujeron una estadística resumen llamada Efecto Residual Acumulado, que captura cuánto tiende cada grupo a aumentar o disminuir el rendimiento respecto a la mediana de los experimentos. Sorprendentemente, incluso mapas “malos” o ruidosos —como un CAM que con frecuencia resalta el objeto equivocado, o un mapa generado a partir de ruido aleatorio— pueden a veces mejorar MetaCAM, porque su presencia obliga al consenso a concentrarse en los píxeles en los que varios métodos coinciden, reduciendo los resaltados espurios en otras zonas.

Qué implica esto para una IA más segura y transparente

En una amplia variedad de imágenes de prueba y modelos, MetaCAM, con umbral adaptativo, superó de forma consistente a todos los métodos de visualización individuales según la métrica ROAD. En términos prácticos, sus mapas de calor señalan con mayor precisión las regiones que realmente impulsan la decisión de una red, al tiempo que filtran gran parte del ruido y la desorientación que se ve en mapas de un solo método. Para campos como la imagen médica, los vehículos autónomos o la verificación biométrica —donde entender por qué un sistema dijo “sí” o “no” puede ser tan importante como la propia respuesta—, MetaCAM ofrece una ventana más estable y basada en evidencia al razonamiento de la IA, ayudando a los expertos a juzgar si un modelo se está centrando en las características correctas antes de confiar en él en el mundo real.

Cita: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Palabras clave: IA explicable, mapas de activación de clase, aprendizaje profundo, interpretabilidad de modelos, métodos de ensamble