Clear Sky Science · pt

MetaCAM como uma estrutura de mapeamento de ativação de classe baseada em ensemble melhora a explicabilidade do modelo

Por que ver o interior das decisões de IA importa

A inteligência artificial moderna pode detectar tumores, reconhecer rostos e classificar fotos com precisão acima da humana, mas frequentemente não consegue explicar por que chegou a uma determinada decisão. Esse comportamento de “caixa preta” é preocupante em contextos de alto risco, como medicina ou veículos autônomos, onde as pessoas precisam saber quais partes de uma imagem realmente influenciaram uma predição. Este artigo apresenta o MetaCAM, uma nova maneira de combinar várias técnicas de visualização existentes em uma única imagem mais clara do que uma rede neural de reconhecimento de imagens está olhando, com o objetivo de tornar as decisões de IA mais transparentes e confiáveis.

Como as máquinas mostram o que “observam”

Redes neurais convolucionais, o pilar do reconhecimento de imagens, processam fotos por diversas camadas e então produzem um rótulo como “gato” ou “tumor”. Os Mapas de Ativação de Classe (CAMs) foram criados para que pudéssemos espiar essas redes. Um CAM sobrepõe um mapa de calor à imagem original, destacando regiões que mais contribuíram para uma predição escolhida. Ao longo dos anos surgiram muitas variantes de CAM, que divergem em como usam gradientes, mapas de característica ou perturbações da imagem para estimar importância. Porém, seu desempenho é inconsistente: um método que funciona bem para uma imagem, classe ou modelo pode ter desempenho ruim em outro, e não há consenso universal sobre qual CAM é “melhor”.

Uma abordagem de equipe para mapas de calor mais claros

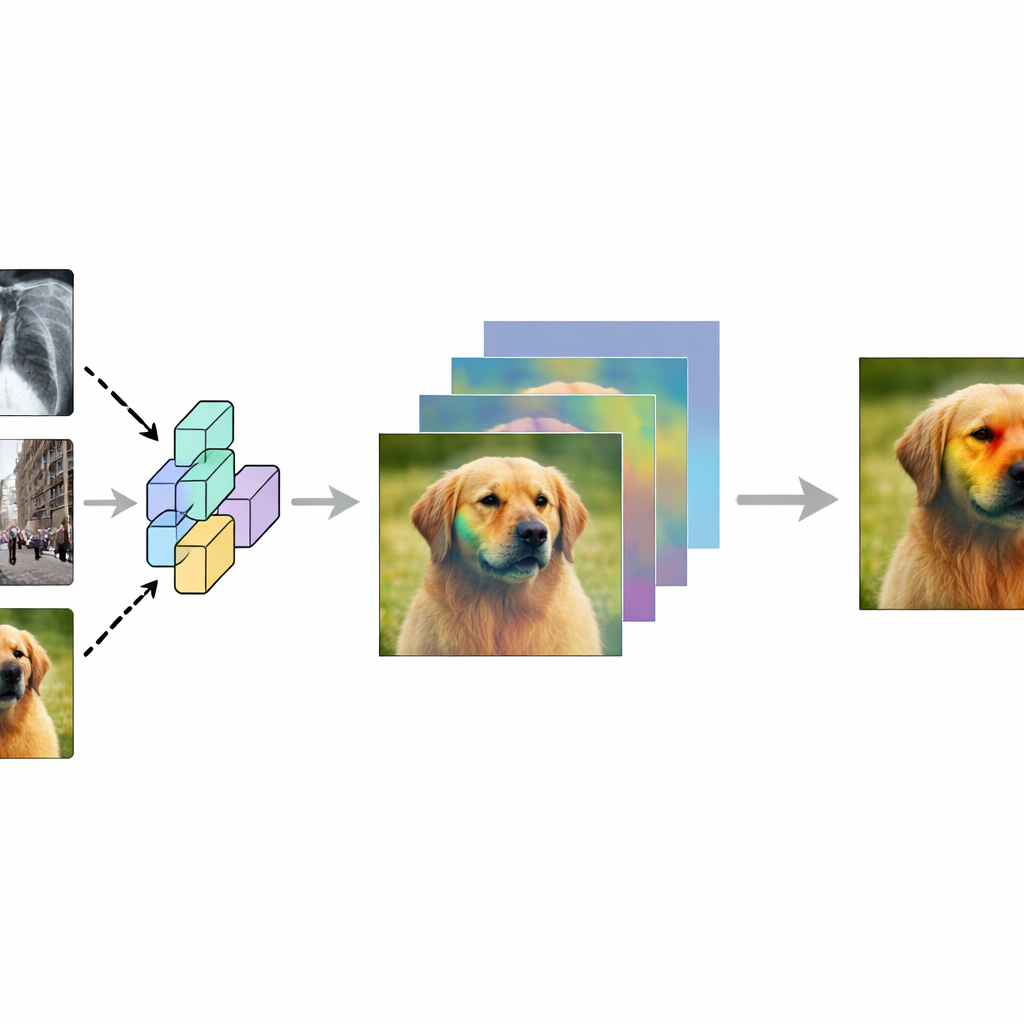

Os autores propõem o MetaCAM, que trata diferentes métodos CAM como membros de um comitê em vez de rivais. Em vez de confiar num único mapa de calor, o MetaCAM começa gerando vários mapas para a mesma imagem e classe alvo usando técnicas diversas, incluindo métodos baseados em gradiente, métodos baseados em perturbação e até ferramentas relacionadas como o FullGrad. Em seguida, busca-se um consenso: pixels que são repetidamente destacados por vários métodos são considerados mais confiáveis. Mantendo apenas a porcentagem superior de pixels que recebem a atenção mais forte e consistente através do ensemble, o MetaCAM produz um mapa de calor refinado que é menos influenciado pelas peculiaridades ou falhas de qualquer método isolado.

Selecionando apenas os pixels mais convincentes

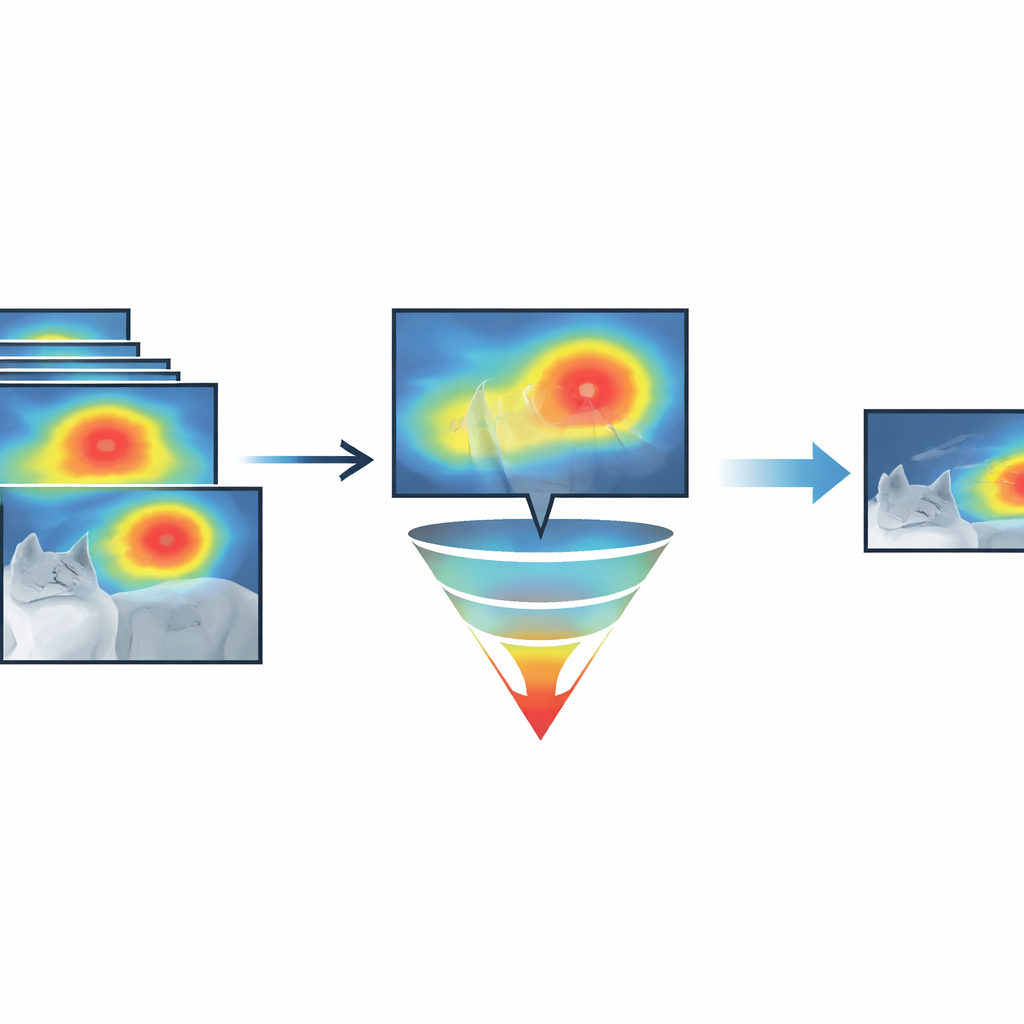

Uma inovação chave é o “limiar adaptativo”, que decide quantos dos pixels mais ativos devem ser mantidos. Em vez de sempre destacar, por exemplo, os 30% superiores dos pixels, os autores testam sistematicamente diferentes cortes e escolhem aquele que melhor corresponde a como as predições da rede mudam quando esses pixels são suavemente desfocados. Eles se apoiam em um teste quantitativo chamado Remove and Debias (ROAD), que mede quanto a confiança do modelo cai quando seus pixels mais “importantes” são perturbados e quanto ela muda quando os pixels menos importantes são alterados. Ao escanear diversos limiares, o MetaCAM encontra o nível que proporciona a separação mais forte entre regiões realmente cruciais e regiões em grande parte irrelevantes, e essa mesma ideia também pode afiar métodos CAM individuais isoladamente.

Descobrindo quais métodos ajudam — e quais surpreendentemente ajudam

Para entender quais ingredientes produzem o melhor MetaCAM, os pesquisadores executaram experimentos em larga escala que ligaram ou desligaram grupos de métodos CAM em diferentes combinações. Usando computação de alto desempenho, eles avaliaram 64 combinações desse tipo ao longo de muitas imagens, classes e arquiteturas de rede neural. Em seguida, introduziram uma estatística resumo chamada Efeito Residual Cumulativo, que captura quanto cada grupo tende a elevar ou reduzir o desempenho em relação ao experimento mediano. Surpreendentemente, mesmo mapas “ruins” ou ruidosos — como um CAM que frequentemente destaca o objeto errado, ou um mapa gerado a partir de ruído aleatório — podem às vezes melhorar o MetaCAM, porque sua presença força o consenso a se estreitar em torno dos pixels sobre os quais vários métodos concordam, reduzindo destaques espúrios em outros lugares.

O que isso significa para uma IA mais segura e transparente

Em uma grande variedade de imagens de teste e modelos, o MetaCAM, com limiar adaptativo, consistentemente superou todos os métodos de visualização individuais segundo a métrica ROAD. Em termos práticos, seus mapas de calor marcam com mais precisão as regiões que realmente impulsionam a decisão de uma rede, enquanto filtram grande parte da desordem e da desinformação vistas em mapas de método único. Para áreas como imagem médica, veículos autônomos ou triagem biométrica — onde entender por que um sistema disse “sim” ou “não” pode ser tão importante quanto a própria resposta — o MetaCAM oferece uma janela mais estável e baseada em evidências sobre o raciocínio da IA, ajudando especialistas a julgar se um modelo está focando nas características corretas antes de confiá‑lo no mundo real.

Citação: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Palavras-chave: IA explicável, mapas de ativação de classe, aprendizado profundo, interpretabilidade de modelos, métodos ensemble