Clear Sky Science · sv

MetaCAM som ett ensemblebaserat klassaktiveringskartläggningsramverk förbättrar modellförklarbarhet

Varför det är viktigt att se inuti AIs beslut

Modern artificiell intelligens kan upptäcka tumörer, känna igen ansikten och klassificera bilder med övermänsklig noggrannhet, men kan ofta inte förklara varför den kom fram till ett visst beslut. Detta ”svarta låda”-beteende är oroande i situations där insatserna är höga, till exempel inom medicin eller självkörande bilar, där människor behöver veta vilka delar av en bild som faktiskt påverkade en förutsägelse. I den här artikeln introduceras MetaCAM, ett nytt sätt att kombinera många befintliga visualiseringstekniker till en enda, tydligare bild av vad ett bildigenkännande neuralt nätverk tittar på, med målet att göra AI-beslut mer transparenta och pålitliga.

Hur maskiner visar vad de ”tittar på”

Konvolutionella neurala nätverk, arbetsmössen inom bildigenkänning, bearbetar bilder genom många lager och returnerar sedan en etikett som till exempel ”katt” eller ”tumör.” Class Activation Maps (CAMs) skapades för att vi ska kunna kika in i dessa nätverk. En CAM lägger en värmekarta ovanpå originalbilden och framhäver regioner som bidrog mest till en vald förutsägelse. Under åren har många CAM-varianter dykt upp, som skiljer sig i hur de använder gradienter, feature-mappar eller bildstörningar för att uppskatta betydelse. Deras prestanda är dock inkonsekvent: en metod som fungerar bra för en bild, klass eller modell kan prestera dåligt för en annan, och det finns ingen universell enighet om vilken CAM som är ”bäst.”

En lagstrategi för tydligare värmekartor

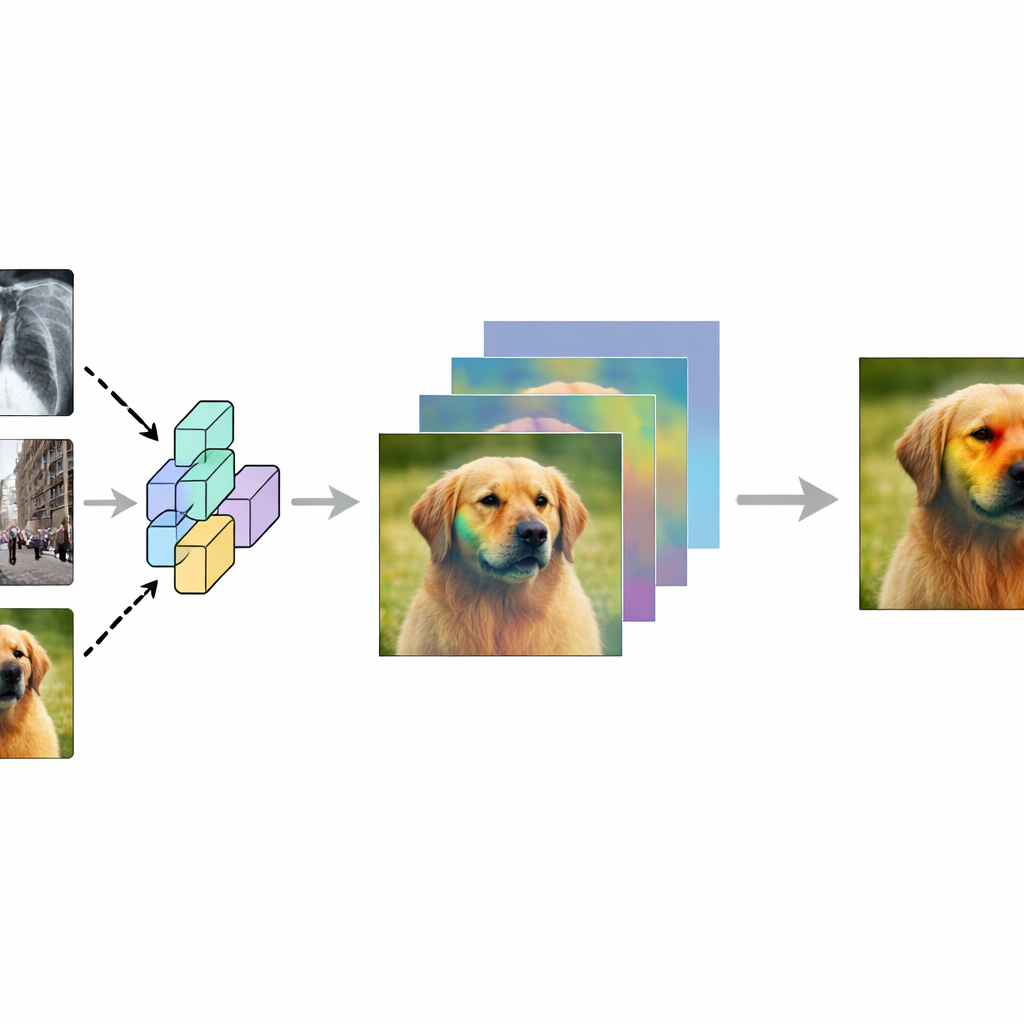

Författarna föreslår MetaCAM, som behandlar olika CAM-metoder som medlemmar i en kommitté snarare än rivaler. I stället för att lita på en enda värmekarta börjar MetaCAM med att generera flera kartor för samma bild och målklass med hjälp av olika tekniker, inklusive gradientbaserade metoder, perturbationsbaserade metoder och till och med närliggande verktyg som FullGrad. Därefter söker den konsensus: pixlar som upprepade gånger framhävs över metoder betraktas som mer tillförlitliga. Genom att behålla endast den översta procentandelen pixlar som får starkast och mest konsekvent uppmärksamhet över ensemblen producerar MetaCAM en förfinad värmekarta som påverkas mindre av egenheter eller fel i någon enskild metod.

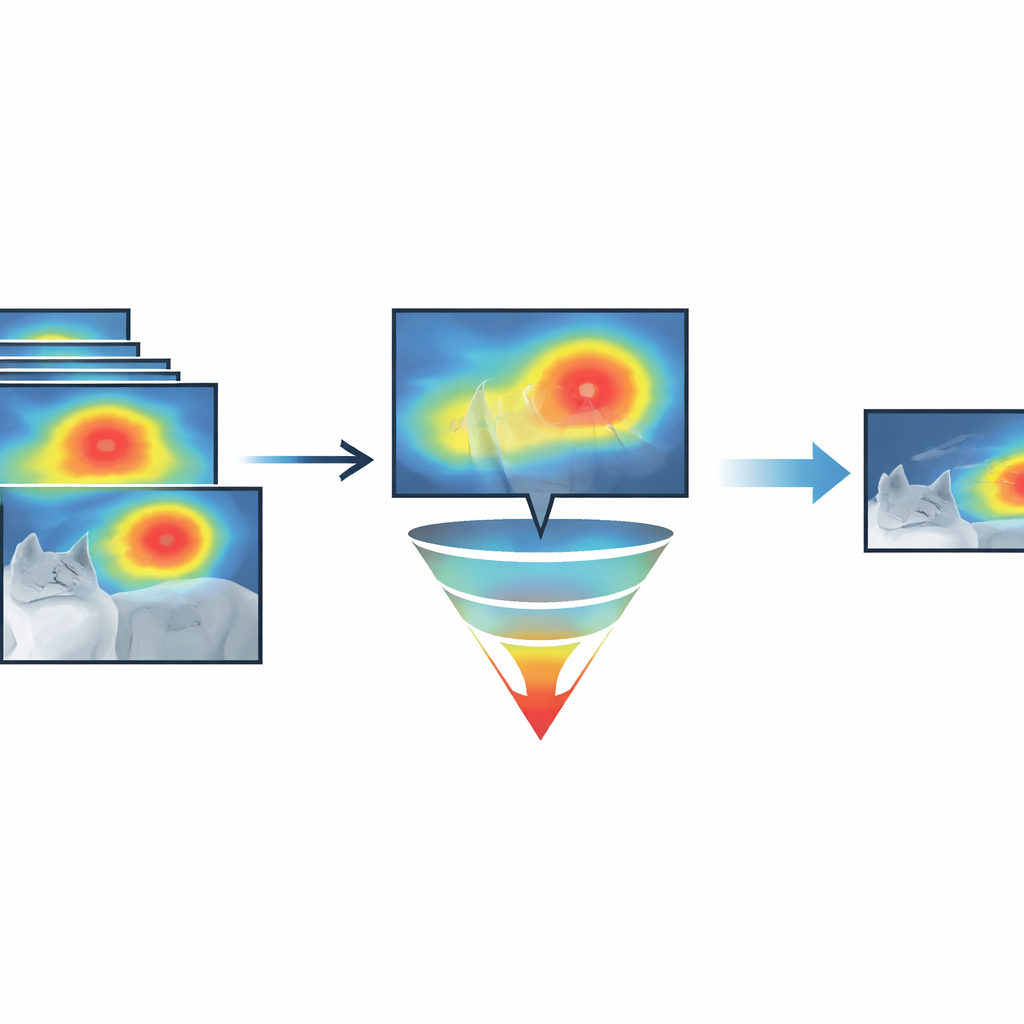

Välja endast de mest övertygande pixlarna

En nyckelinnovation är ”adaptiv tröskling”, som bestämmer hur många av de mest aktiva pixlarna som ska behållas. I stället för alltid att markera exempelvis de översta 30 procenten av pixlarna testar författarna systematiskt olika gränsvärden och väljer det som bäst matchar hur nätverkets förutsägelser förändras när dessa pixlar försiktigt suddas ut. De förlitar sig på ett kvantitativt test kallat Remove and Debias (ROAD), som mäter hur mycket modellens förtroende sjunker när dess mest ”viktiga” pixlar störs och hur lite det förändras när de minst viktiga pixlarna störs. Genom att skanna över många trösklar hittar MetaCAM den nivå som ger den starkaste separationen mellan verkligt avgörande och i stort sett irrelevanta regioner, och samma idé kan också skärpa individuella CAM-metoder på egen hand.

Upptäcka vilka metoder som hjälper — och vilka som överraskande nog gör det

För att förstå vilka ingredienser som ger bäst MetaCAM körde forskarna storskaliga experiment där de slog på eller av grupper av CAM-metoder i olika kombinationer. Med högpresterande beräkningar utvärderade de 64 sådana kombinationer över många bilder, klasser och neurala nätverksarkitekturer. De introducerade sedan en sammanfattande statistik kallad Cumulative Residual Effect, som fångar hur mycket varje grupp tenderar att höja eller sänka prestandan i förhållande till medianexperimentet. Överraskande nog kan även ”dåliga” eller brusiga kartor — såsom en CAM som ofta framhäver fel objekt, eller en karta skapad från slumpmässigt brus — ibland förbättra MetaCAM, eftersom deras närvaro tvingar konsensus att tajta till sig kring pixlar som flera metoder är överens om och därigenom minska spurriösa markeringar annorstädes.

Vad detta betyder för säkrare, mer transparent AI

Över ett brett spektrum av testbilder och modeller presterade MetaCAM med adaptiv tröskling konsekvent bättre än alla individuella visualiseringsmetoder enligt ROAD-måttet. I praktiska termer markerar dess värmekartor mer precist de regioner som faktiskt driver ett nätverks beslut, samtidigt som mycket av röran och vilseledningen som ses i enmetodskartor filtreras bort. För områden som medicinsk bildanalys, självkörande fordon eller biometrisk granskning — där förståelsen för varför ett system sa ”ja” eller ”nej” kan vara lika viktigt som svaret i sig — erbjuder MetaCAM ett mer stabilt, evidensbaserat fönster in i AI-resonemang, vilket hjälper experter att bedöma om en modell fokuserar på rätt egenskaper innan de litar på den i verkliga tillämpningar.

Citering: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Nyckelord: förklarbar AI, klassaktiveringskartor, djupinlärning, modelltolkbarhet, ensemblemetoder