Clear Sky Science · it

MetaCAM come framework di class activation mapping basato su ensemble migliora la spiegabilità dei modelli

Perché è importante vedere l’interno delle decisioni dell’IA

L’intelligenza artificiale moderna è in grado di individuare tumori, riconoscere volti e classificare immagini con accuratezza sovrumana, eppure spesso non sa spiegare perché ha preso una determinata decisione. Questo comportamento da “scatola nera” è preoccupante in contesti ad alto rischio come la medicina o i veicoli a guida autonoma, dove è necessario sapere quali parti di un’immagine hanno effettivamente influenzato una previsione. Questo articolo presenta MetaCAM, un nuovo modo di combinare molte tecniche di visualizzazione esistenti in un’unica immagine più chiara di ciò a cui una rete neurale per il riconoscimento di immagini sta prestando attenzione, con l’obiettivo di rendere le decisioni dell’IA più trasparenti e affidabili.

Come le macchine mostrano ciò che “guardano”

Le reti neurali convoluzionali, il cavallo di battaglia del riconoscimento delle immagini, elaborano le foto attraverso molteplici strati e poi restituiscono un’etichetta come “gatto” o “tumore”. Le Class Activation Map (CAM) sono state ideate per poter sbirciare dentro queste reti. Una CAM sovrappone una mappa di calore all’immagine originale, evidenziando le regioni che hanno contribuito maggiormente a una previsione scelta. Nel tempo sono nate molte varianti di CAM, che differiscono nel modo in cui usano gradienti, mappe di feature o perturbazioni dell’immagine per stimare l’importanza. Tuttavia, le loro prestazioni sono incoerenti: un metodo che funziona bene per un’immagine, una classe o un modello può comportarsi male per un altro, e non esiste un consenso universale su quale CAM sia “migliore”.

Un approccio di squadra per mappe di calore più chiare

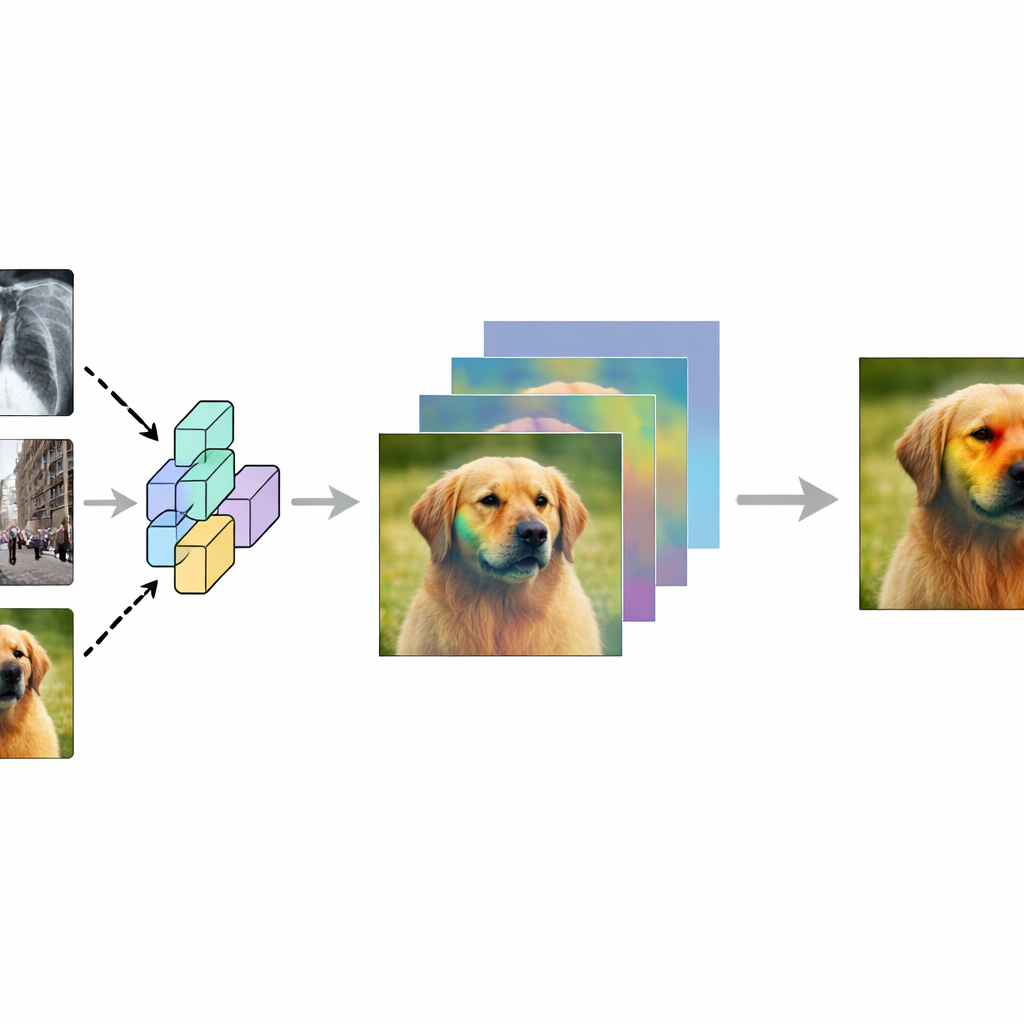

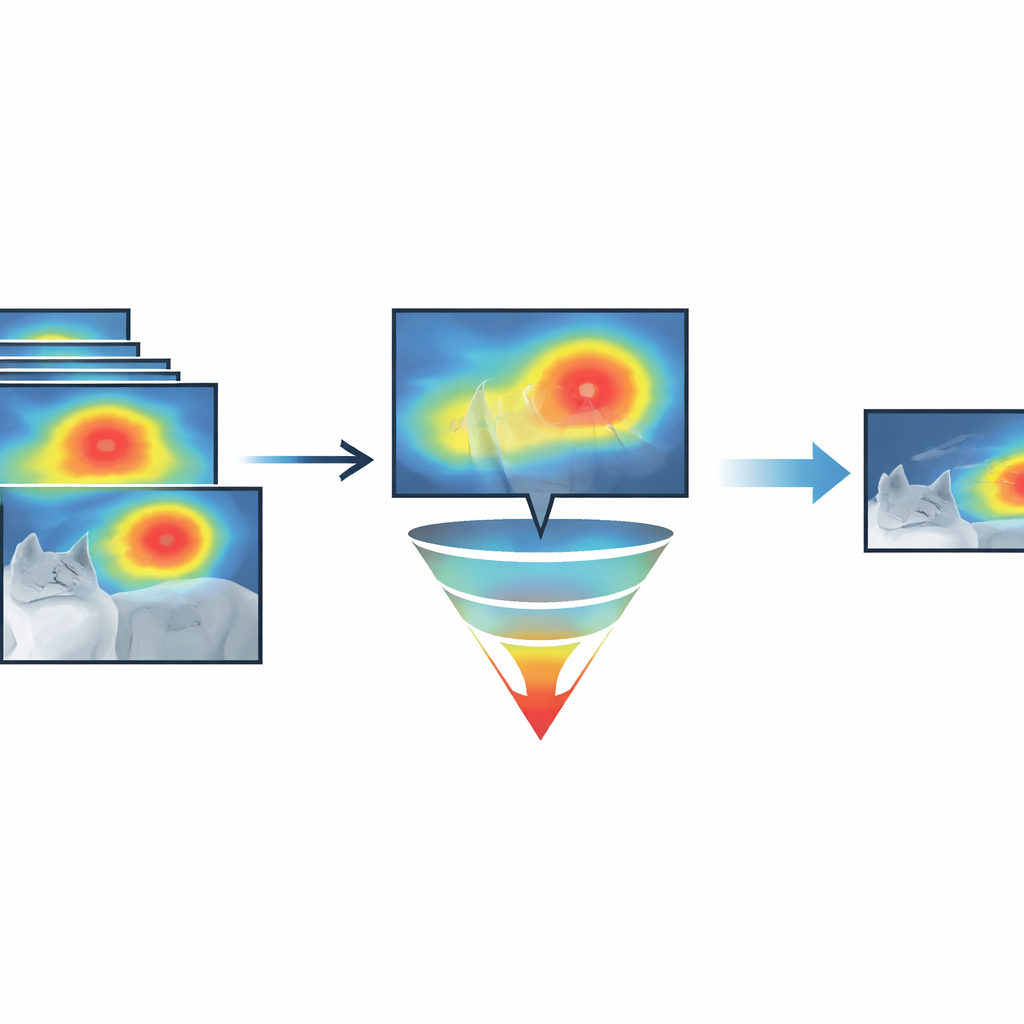

Gli autori propongono MetaCAM, che tratta i diversi metodi CAM come membri di una commissione anziché come rivali. Invece di fidarsi di una singola mappa di calore, MetaCAM inizia generando diverse mappe per la stessa immagine e classe target usando tecniche eterogenee, incluse metodologie basate sui gradienti, sulle perturbazioni e anche strumenti correlati come FullGrad. Cerca quindi il consenso: i pixel che vengono ripetutamente evidenziati dalle varie tecniche sono considerati più affidabili. Trattenendo solo la percentuale più alta di pixel che ricevono l’attenzione più forte e più coerente nell’ensemble, MetaCAM produce una mappa di calore raffinata che è meno influenzata dalle idiosincrasie o dai fallimenti di un singolo metodo.

Scegliere solo i pixel più convincenti

Un’innovazione chiave è il “thresholding adattivo”, che decide quanti dei pixel più attivi mantenere. Piuttosto che evidenziare sempre, per esempio, il 30 percento superiore dei pixel, gli autori testano sistematicamente diversi tagli e scelgono quello che meglio corrisponde a come cambiano le previsioni della rete quando quei pixel vengono lievemente sfocati. Si basano su un test quantitativo chiamato Remove and Debias (ROAD), che misura quanto cala la fiducia del modello quando vengono perturbati i suoi pixel più “importanti” e quanto poco cambia quando vengono disturbati i pixel meno importanti. Scansionando molti soglie, MetaCAM individua il livello che fornisce la separazione più netta tra regioni veramente cruciali e regioni in gran parte irrilevanti; la stessa idea può anche affinare singoli metodi CAM isolatamente.

Scoprire quali metodi aiutano — e inaspettatamente lo fanno

Per capire quali ingredienti producono il miglior MetaCAM, i ricercatori hanno condotto esperimenti su larga scala attivando o disattivando gruppi di metodi CAM in diverse combinazioni. Usando calcolo ad alte prestazioni, hanno valutato 64 combinazioni di questo tipo su molte immagini, classi e architetture di rete neurale. Hanno poi introdotto una statistica riassuntiva chiamata Effetto Residuo Cumulativo (Cumulative Residual Effect), che cattura quanto ciascun gruppo tende ad aumentare o diminuire le prestazioni rispetto all’esperimento mediano. Sorprendentemente, anche mappe “cattive” o rumorose — come una CAM che spesso evidenzia l’oggetto sbagliato, o una mappa generata da rumore casuale — possono talvolta migliorare MetaCAM, perché la loro presenza costringe il consenso a concentrarsi sui pixel su cui più metodi concordano, riducendo evidenziazioni spurie altrove.

Cosa significa questo per un’IA più sicura e trasparente

Su una vasta gamma di immagini di test e modelli, MetaCAM, con il thresholding adattivo, ha costantemente superato tutti i singoli metodi di visualizzazione secondo la metrica ROAD. In termini pratici, le sue mappe di calore marcano in modo più preciso le regioni che effettivamente guidano la decisione di una rete, filtrando gran parte del rumore e delle distrazioni presenti nelle mappe a metodo singolo. Per ambiti come l’imaging medico, i veicoli autonomi o i sistemi di screening biometrici — dove capire perché un sistema ha detto “sì” o “no” può essere importante quanto la risposta stessa — MetaCAM offre una finestra più stabile e fondata su evidenze nel ragionamento dell’IA, aiutando gli esperti a giudicare se un modello si concentra sulle caratteristiche giuste prima di affidarsi ad esso nel mondo reale.

Citazione: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Parole chiave: IA spiegabile, mappe di attivazione di classe, apprendimento profondo, interpretabilità dei modelli, metodi ensemble