Clear Sky Science · pl

MetaCAM jako oparte na zespołach ramy do map aktywacji klas poprawia wyjaśnialność modelu

Dlaczego ważne jest wglądanie w decyzje AI

Współczesna sztuczna inteligencja potrafi wykrywać guzy, rozpoznawać twarze i klasyfikować zdjęcia z nadludzką dokładnością, a mimo to często nie potrafi wyjaśnić, dlaczego podjęła konkretną decyzję. To „czarne pudełko” jest niepokojące w sytuacjach o wysokich stawkach, takich jak medycyna czy samochody autonomiczne, gdzie ludzie muszą wiedzieć, które części obrazu faktycznie wpłynęły na przewidywanie. W niniejszym artykule przedstawiono MetaCAM — nowy sposób łączenia wielu istniejących technik wizualizacji w jedną, bardziej przejrzystą mapę tego, na co patrzy sieć neuronowa rozpoznająca obrazy, z zamiarem uczynienia decyzji AI bardziej transparentnymi i godnymi zaufania.

Jak maszyny pokazują, na co „patrzą”

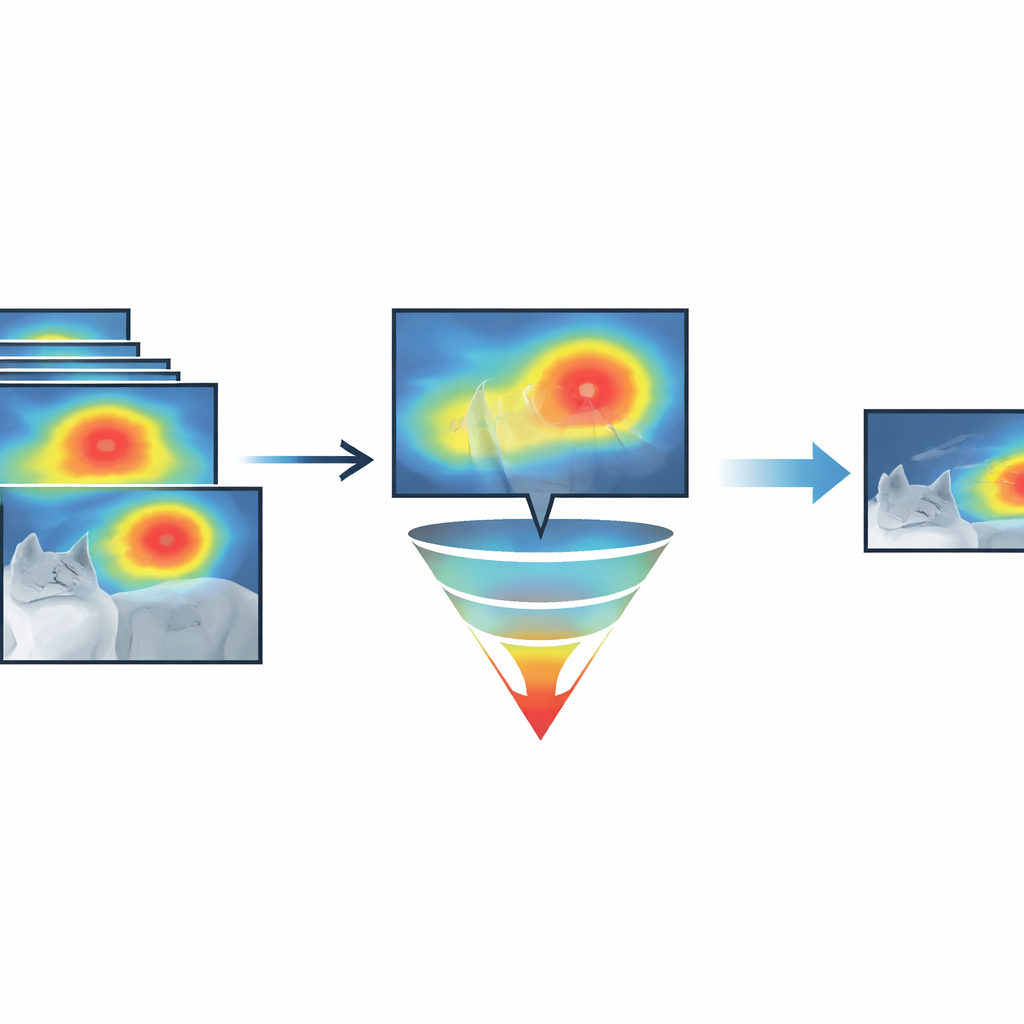

Splotowe sieci neuronowe, główni wykonawcy zadań rozpoznawania obrazów, przetwarzają obrazy przez wiele warstw, a następnie zwracają etykietę, taką jak „kot” czy „guz”. Mapy aktywacji klas (CAM) powstały po to, by móc zajrzeć do wnętrza tych sieci. CAM nakłada mapę cieplną na oryginalny obraz, uwypuklając obszary, które najbardziej przyczyniły się do wybranego przewidywania. Na przestrzeni lat pojawiło się wiele wariantów CAM, różniących się sposobem wykorzystania gradientów, map cech czy zakłóceń obrazu do oszacowania ważności. Ich wydajność jest jednak niejednolita: metoda działająca dobrze dla jednego obrazu, klasy czy modelu może zawodzić dla innego, i nie ma uniwersalnej zgody, która CAM jest „najlepsza”.

Zespołowe podejście do czytelniejszych map cieplnych

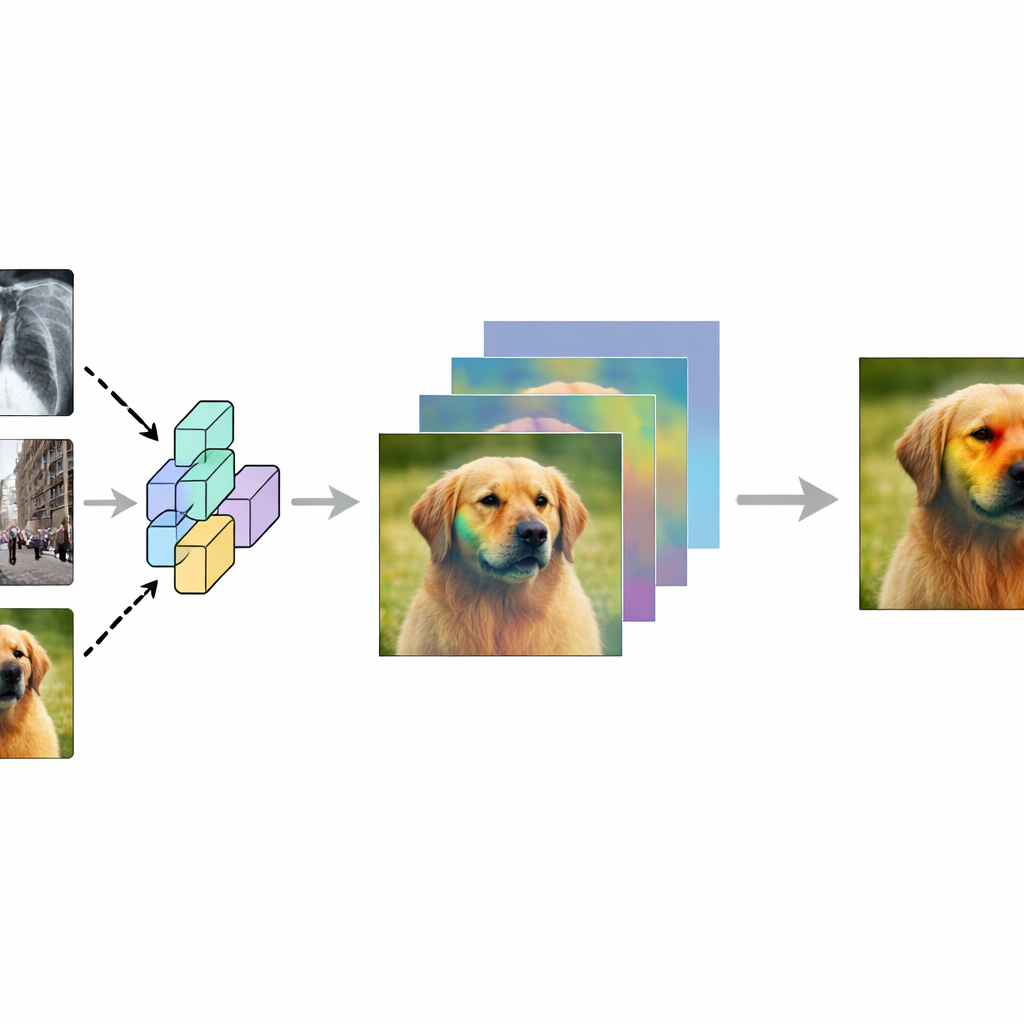

Autorzy proponują MetaCAM, które traktuje różne metody CAM jak członków komisji, a nie rywali. Zamiast polegać na pojedynczej mapie, MetaCAM zaczyna od wygenerowania kilku map dla tego samego obrazu i docelowej klasy przy użyciu różnych technik, w tym metod opartych na gradientach, metod perturbacyjnych, a także powiązanych narzędzi, takich jak FullGrad. Następnie szuka konsensusu: piksele, które są wielokrotnie podkreślane przez różne metody, uznawane są za bardziej wiarygodne. Zachowując jedynie najwyższy procent pikseli, które otrzymują najsilniejszą i najbardziej spójną uwagę w całym zespole, MetaCAM tworzy dopracowaną mapę cieplną mniej podatną na osobliwości czy błędy pojedynczej metody.

Wybieranie tylko najbardziej przekonujących pikseli

Kluczową innowacją jest „adaptacyjne progowanie”, które decyduje, ile z najbardziej aktywnych pikseli należy zachować. Zamiast zawsze podświetlać, powiedzmy, górne 30 procent pikseli, autorzy systematycznie testują różne progi i wybierają ten, który najlepiej odpowiada temu, jak zmieniają się przewidywania sieci, gdy te piksele są delikatnie rozmywane. Polegają na ilościowym teście zwanym Remove and Debias (ROAD), który mierzy, o ile spada ufność modelu, gdy jego najważniejsze piksele zostaną zakłócone, oraz jak niewiele zmienia się, gdy zakłócone zostaną najmniej ważne piksele. Przeszukując wiele progów, MetaCAM znajduje poziom, który daje najsilniejsze rozdzielenie między naprawdę kluczowymi a w dużej mierze nieistotnymi obszarami, a ta sama idea może też wyostrzyć pojedyncze metody CAM samodzielnie.

Odkrywanie, które metody pomagają — i które zaskakująco pomagają

Aby zrozumieć, które składniki tworzą najlepsze MetaCAM, badacze przeprowadzili szeroko zakrojone eksperymenty wyłączając lub włączając grupy metod CAM w różnych kombinacjach. Z wykorzystaniem wysokowydajnych zasobów obliczeniowych ocenili 64 takie kombinacje na wielu obrazach, klasach i architekturach sieci neuronowych. Wprowadzili następnie statystykę podsumowującą zwaną Skumulowanym Efektem Rezydualnym (Cumulative Residual Effect), która odzwierciedla, o ile dana grupa ma tendencję do podnoszenia lub obniżania wydajności względem mediany eksperymentów. Co zaskakujące, nawet „złe” lub hałaśliwe mapy — na przykład CAM, który często podkreśla niewłaściwy obiekt, lub mapa utworzona z losowego szumu — mogą czasem poprawić MetaCAM, ponieważ ich obecność zmusza konsensus do zawężenia się wokół pikseli, co do których zgadza się wiele metod, redukując fałszywe podświetlenia w innych miejscach.

Co to oznacza dla bezpieczniejszej, bardziej przejrzystej AI

W szerokim spektrum testowych obrazów i modeli MetaCAM z adaptacyjnym progowaniem konsekwentnie przewyższał wszystkie pojedyncze metody wizualizacji według miary ROAD. W praktyce jego mapy cieplne precyzyjniej oznaczają obszary, które faktycznie napędzają decyzję sieci, przy jednoczesnym odfiltrowaniu dużej części szumu i wprowadzających w błąd elementów występujących w mapach pojedynczych metod. Dla dziedzin takich jak obrazowanie medyczne, pojazdy autonomiczne czy systemy biometryczne — gdzie zrozumienie, dlaczego system powiedział „tak” lub „nie”, może być równie ważne jak sama odpowiedź — MetaCAM oferuje stabilniejsze, oparte na dowodach okno w rozumowanie AI, pomagając ekspertom ocenić, czy model skupia się na właściwych cechach, zanim zaufają mu w praktyce.

Cytowanie: Dick, K., Kaczmarek, E., Miguel, O.X. et al. MetaCAM as an ensemble-based class activation mapping framework improves model explainability. Sci Rep 16, 10613 (2026). https://doi.org/10.1038/s41598-026-42879-0

Słowa kluczowe: wyjaśnialna sztuczna inteligencja, mapy aktywacji klas, uczenie głębokie, interpretowalność modelu, metody zespołowe