Clear Sky Science · zh

选定大型语言与多模态模型在2023年巴西葡萄牙语医学住院医师考试上的零样本表现

这对医生与患者为何重要

人工智能正在迅速进入医院和诊所,但对这些系统的大多数测试都以英语为主。本研究提出了一个简单但具有重大意义的问题:当面对以巴西葡萄牙语撰写的真实医学考试题(包括使用X光等影像的题目)时,当前的大型人工智能模型表现如何?答案可帮助医生、教育者和政策制定者判断这些工具是否已准备好在非英语为主的国家协助医疗工作。

用真实医学入学考试检验人工智能

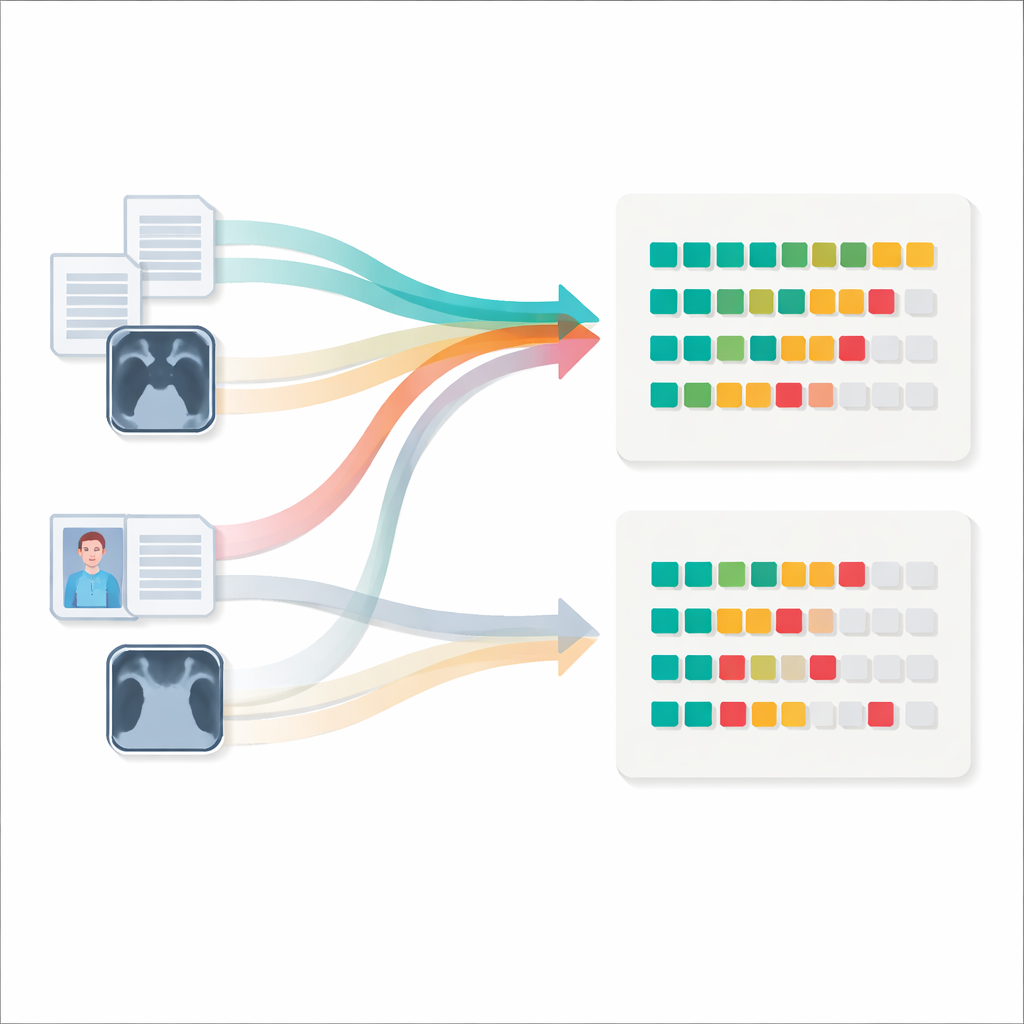

研究人员采用了来自巴西一家顶尖教学医院的2023年医学住院医师入学考试——每年有数千名年轻医生参加。试卷包括117道多项选择题,涵盖内科、外科、儿科、妇产科和公共卫生。多数题目仅为文字,但有三分之一以上包含放射学影像、临床照片和诊断记录等图像。研究挑战了六个仅处理文本的AI模型和四个也能“看见”图像的多模态模型,在“零样本”设置下答题:它们未获提供与该考试相关的先前示例或微调,仅接收标准指令来选择答案并解释其推理。

文本题上模型有多聪明?

在仅含文字的题目上,表现差异很大。最弱的系统仅答对略多于五分之一的问题,而最好的模型约答对七成题目。名为Claude的一系列模型位居前列,得分约为70%,略高于GPT‑4.0 Turbo,并明显领先若干开源与商用竞争者。然而,有一个拥有数十亿参数的开源模型接近领先者,这提示强劲的表现并不必然只属于专有系统。当研究者将这些AI分数与人类考生成绩分布进行比较时,最佳模型集中在考生群体的中间位置:不是顶尖学生,而大致相当于参加考试的平均新晋医生。

图像仍然难住当今的人工智能

加入图像后情况发生了变化。对于测试的四个多模态模型,一旦包含基于图像的题目,准确率就下降,常常低于50%,尤以放射学密集题目为甚。只有最先进的模型在混合文本与图像的问题上保持了几乎与纯文本相同的得分。按领域划分,系统在公共卫生和儿科表现最好,而在放射学及其他以图像为主的问题上表现最差,这表明当前的训练数据与模型设计更偏向书面材料而非医学影像。参与研究的临床医生并不认为这些图像题对人类本质上更难,但可得数据不允许逐题进行直接的人类对比,因此仍不清楚性能差距有多少来自图像推理本身,多少来自题目难度。

透视模型的解释

为了超越简单的对错评分,团队请了三位经验丰富的医师审查一款多模态模型生成的解释。他们评估AI是否正确理解题意、其推理是否与所选答案一致,以及遵循其建议是否可能对病人造成伤害。对于模型答对的问题,其解释通常连贯且被认为相对安全;但对于模型答错的问题,误导性或凭空捏造的推理——常称为“幻觉”——很常见。医生们有时会就哪些解释有问题产生分歧,反映出医学判断本身的灰色地带,但在AI答案明显错误且可能不安全时,他们更容易达成一致。

这对日常医疗中的人工智能意味着什么

总体而言,研究表明当今的大型AI模型在以巴西葡萄牙语编写的高难度医学考试(至少在纯文本题上)能接近人类的平均水平。然而,它们在处理医学影像时仍然吃力,并且可能给出自信却错误的解释,如果不加批判地使用,可能会误导临床医师。研究结果既突显了当前系统的潜力,也提醒其局限:它们可能成为葡萄牙语医疗体系中在阅读与摘要文本等任务上的有价值助手,但尚不足以取代受训医师,或在缺乏严格监管与持续改进的情况下独立处理复杂的多模态诊断。

引用: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

关键词: 医学人工智能, 大型语言模型, 葡萄牙语医学, 多模态诊断, 医学教育