Clear Sky Science · sv

Nollskottsresultat för utvalda stora språk- och multimodala modeller på 2023 års brasilianska läkarstipendieprov på portugisiska

Varför detta är viktigt för läkare och patienter

Artificiell intelligens tar snabbt plats på sjukhus och i kliniker, men de flesta tester av dessa system görs på engelska. Denna studie ställde en enkel men höginsatsfråga: hur väl hanterar dagens stora AI‑modeller verkliga medicinska provfrågor skrivna på brasiliansk portugisiska, inklusive sådana som använder bilder som röntgenbilder? Svaret hjälper läkare, utbildare och beslutsfattare att bedöma om dessa verktyg är redo att assistera vården i länder där engelska inte är huvudspråket.

Att pröva AI på ett verkligt antagningsprov

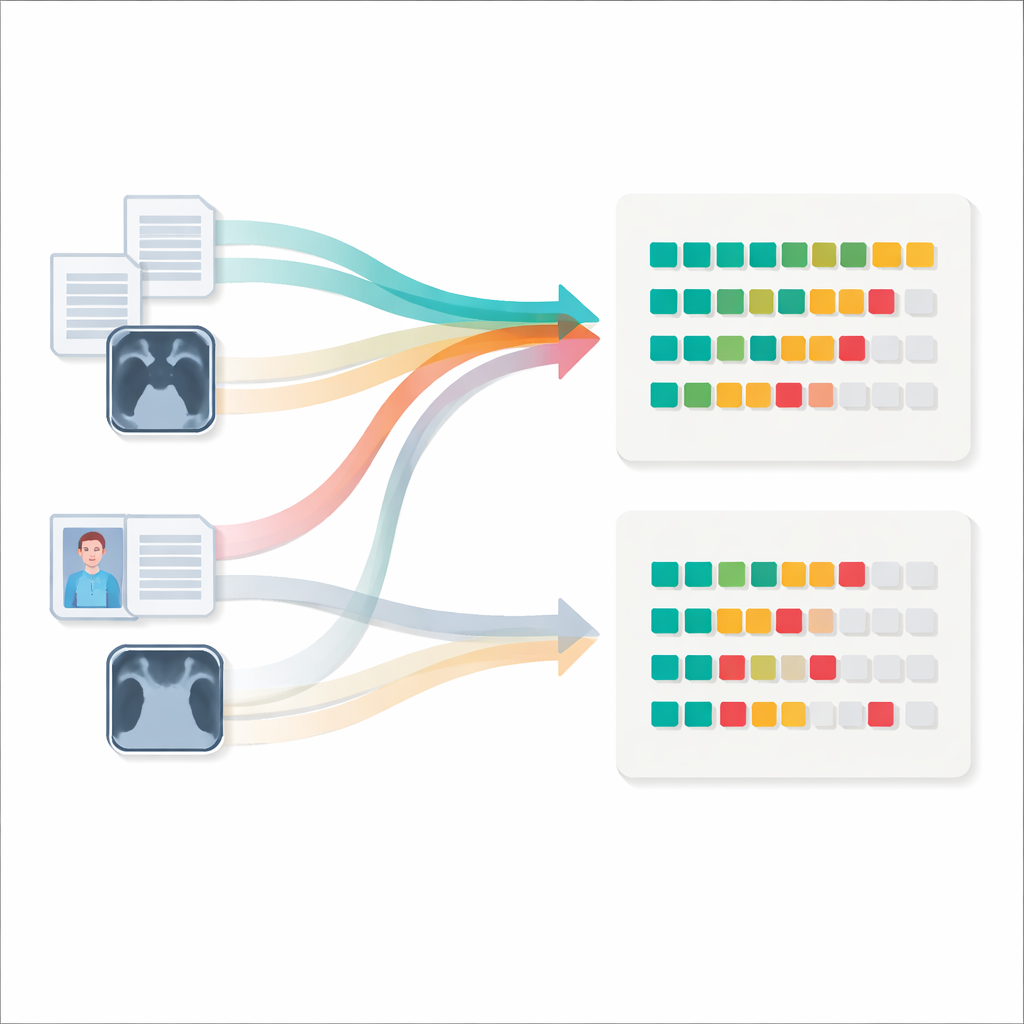

Forskarna använde 2023 års antagningsprov för läkarutbildning från ett av Brasiliens ledande undervisningssjukhus, ett prov som tusentals unga läkare skriver varje år. Det innehåller 117 flervalsfrågor som täcker internmedicin, kirurgi, pediatrik, gynekologi och obstetrik samt folkhälsa. De flesta frågor är textbaserade, men mer än en tredjedel innehåller bilder såsom radiologiska avbildningar, kliniska fotografier och diagnostiska kurvor. Sex text‑endast AI‑modeller och fyra multimodala modeller som också kan tolka bilder utmanades att besvara provet i ett ”nollskotts”-scenario: de fick inga tidigare exempel eller fininställning specifik för detta test, endast standardinstruktioner att välja ett svar och förklara sitt resonemang.

Hur duktiga var modellerna på skriftliga frågor?

På frågor bestående endast av text varierade resultaten stort. Det svagaste systemet fick bara precis över en av fem frågor rätt, medan de bästa modellerna svarade ungefär sju av tio korrekt. En modellfamilj kallad Claude toppade listan, med resultat runt 70 procent, något över GPT‑4.0 Turbo och klart före flera öppna och kommersiella konkurrenter. En öppen modell med många miljarder parametrar kom dock nära ledarna, vilket antyder att stark prestanda inte nödvändigtvis är begränsad till proprietära system. När forskarna jämförde dessa AI‑poäng med fördelningen av människokandidaters betyg klustrade de bästa modellerna nära mitten av sökandepoolen: inte stjärnstudenter, men ungefär i nivå med en genomsnittlig nyutbildad läkare som skriver provet.

Bilder ställer fortfarande till det för dagens AI

Saker förändrades när bilder lades till. För de fyra testade multimodala modellerna sjönk noggrannheten när bild‑baserade frågor inkluderades, ofta till under 50 procent korrekt, särskilt för röntgenintensiva uppgifter. Endast den mest avancerade modellen bibehöll nästan samma poäng på blandade text‑ och bildfrågor som på enbart text. Över ämnesområden gjorde systemen bäst ifrån sig inom folkhälsa och pediatrik, och sämst inom radiologi och andra bildfokuserade frågor, vilket tyder på att nuvarande träningsdata och modelldesign gynnar skriftligt material framför medicinska bilder. Kliniker som deltog i studien upplevde inte att bildfrågorna var inneboende svårare för människor, men de tillgängliga uppgifterna tillät inte en direkt fråga‑för‑fråga‑jämförelse med människor, så det är fortfarande oklart hur stor del av prestandagapet som beror på bildtolkning kontra frågas svårighetsgrad.

En titt in i förklaringarna

För att gå bortom rätt‑eller‑fel‑poäng bad teamet tre erfarna läkare granska förklaringarna som en multimodal modell producerade. De bedömde huruvida AI‑n hade tolkat frågan korrekt, om dess resonemang överensstämde med det valda svaret och om följande av dess råd kunde skada en patient. För frågor modellen svarade rätt på var dess förklaringar vanligtvis koherenta och bedömdes som säkra. För frågor den missade var dock vilseledande eller påhittat resonemang — ofta kallat hallucinationer — vanligt förekommande. Läkare var ibland oense om vilka förklaringar som var problematiska, vilket speglar medicinsk bedömnings gråzoner, men de var mer eniga när AI:ns svar tydligt var felaktigt och potentiellt osäkert.

Vad detta betyder för AI i vardagsvården

Sammanfattningsvis visar studien att dagens stora AI‑modeller kan närma sig genomsnittlig mänsklig prestanda på ett krävande medicinskt prov skrivet på brasiliansk portugisiska, åtminstone för text‑endast‑frågor. Ändå har de fortfarande svårt med medicinska bilder och kan erbjuda självsäkra men felaktiga förklaringar som kan vilseleda kliniker om de används okritiskt. Resultaten understryker både löftet och begränsningarna hos nuvarande system: de kan bli värdefulla assistenter i portugisisktalande vård, särskilt för att läsa och sammanfatta text, men de är inte redo att ersätta utbildade läkare eller hantera komplex multimodal diagnostik utan noggrann tillsyn och fortsatt förbättring.

Citering: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Nyckelord: medicinsk AI, stora språkmodeller, portugisisk medicin, multimodal diagnostik, medicinsk utbildning