Clear Sky Science · es

Rendimiento zero‑shot de modelos grandes de lenguaje y multimodales seleccionados en el examen de residencia médica brasileña 2023

Por qué esto importa para médicos y pacientes

La inteligencia artificial está entrando rápidamente en hospitales y clínicas, pero la mayoría de las pruebas de estos sistemas se realizan en inglés. Este estudio planteó una pregunta simple y de alto impacto: ¿qué tan bien manejan los grandes modelos de IA actuales preguntas reales de un examen médico escritas en portugués brasileño, incluidas aquellas que usan imágenes como radiografías? La respuesta ayuda a médicos, educadores y responsables de políticas a juzgar si estas herramientas están listas para asistir en la atención en países donde el inglés no es el idioma principal.

Poner a prueba la IA con un examen real de ingreso médico

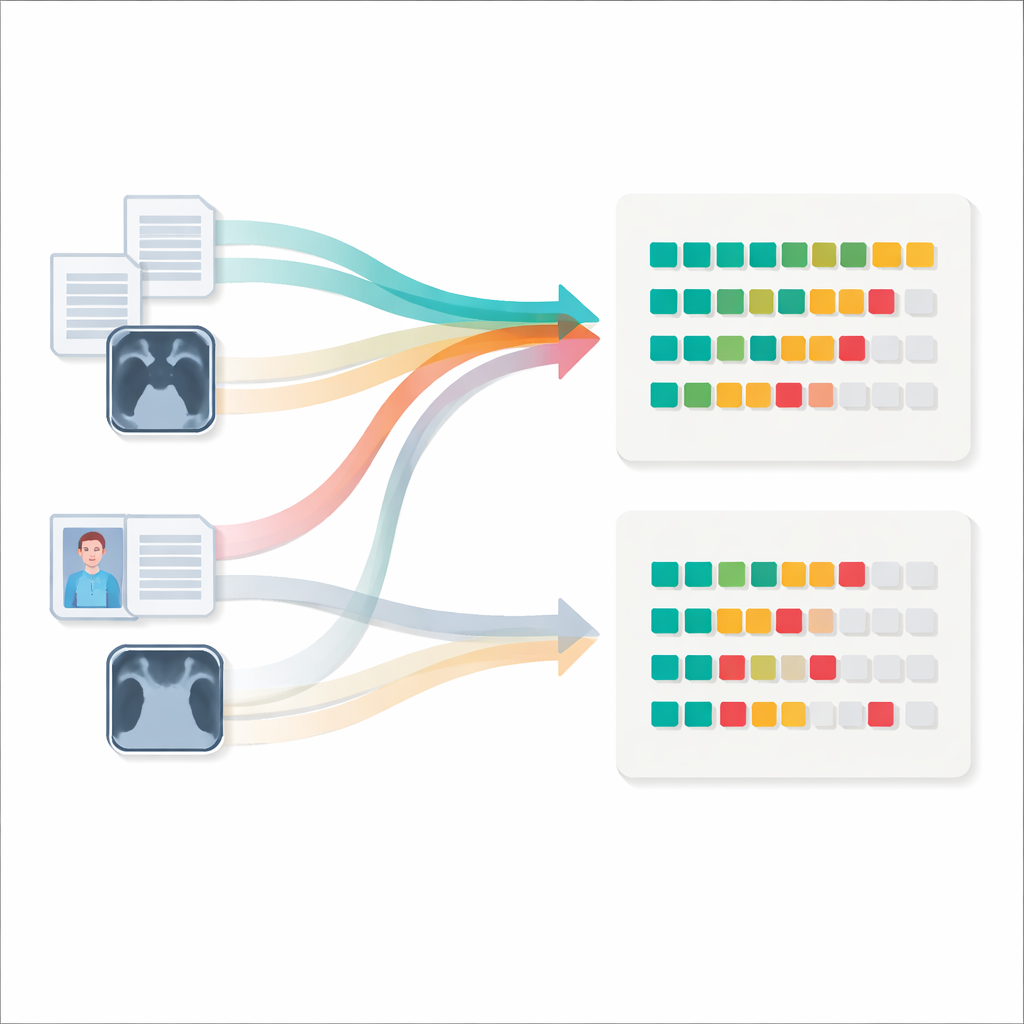

Los investigadores tomaron el examen de ingreso a la residencia médica de 2023 de uno de los principales hospitales docentes de Brasil, un examen al que se presentan miles de jóvenes médicos cada año. Contiene 117 preguntas de opción múltiple que abarcan medicina interna, cirugía, pediatría, ginecología y obstetricia, y salud pública. La mayoría de las preguntas son solo de texto, pero más de un tercio incluyen imágenes como exploraciones radiológicas, fotos clínicas y trazados diagnósticos. Se desafió a seis modelos de IA solo de texto y a cuatro modelos multimodales que también pueden interpretar imágenes para responder el examen en un contexto “zero‑shot”: no se les dio ejemplos previos ni ajuste fino específico para esta prueba, solo instrucciones estándar para elegir una respuesta y explicar su razonamiento.

¿Qué tan inteligentes fueron los modelos en preguntas escritas?

En las preguntas exclusivamente textuales, el desempeño varió ampliamente. El sistema más débil acertó poco más de una de cada cinco preguntas, mientras que los mejores modelos respondieron aproximadamente siete de cada diez correctamente. Una familia de modelos llamada Claude encabezó la tabla, con puntuaciones alrededor del 70 por ciento, ligeramente por encima de GPT‑4.0 Turbo y claramente por delante de varios competidores comerciales y de código abierto. No obstante, un modelo de código abierto con muchos miles de millones de parámetros se acercó a los líderes, lo que sugiere que un rendimiento sólido no tiene por qué limitarse a sistemas propietarios. Cuando los investigadores compararon estas puntuaciones de IA con la distribución de las calificaciones de los candidatos humanos, los mejores modelos se agruparon cerca de la mitad de la cohorte de aspirantes: no estudiantes sobresalientes, pero más o menos al nivel de un médico recién titulado promedio que realiza el examen.

Las imágenes aún confunden a la IA actual

La situación cambió cuando se añadieron imágenes. Para los cuatro modelos multimodales evaluados, la precisión descendió al incluir preguntas basadas en imágenes, a menudo cayendo por debajo del 50 por ciento de aciertos, especialmente en ítems con fuerte carga radiológica. Solo el modelo más avanzado mantuvo casi la misma puntuación en preguntas mixtas de texto e imagen que en texto solo. Por dominios, los sistemas obtuvieron mejores resultados en salud pública y pediatría, y peores en radiología y otras preguntas centradas en imágenes, lo que sugiere que los datos de entrenamiento y el diseño de los modelos actuales favorecen el material escrito sobre las imágenes médicas. Los clínicos participantes en el estudio no consideraron que las preguntas con imágenes fueran intrínsecamente más difíciles para los humanos, pero los datos disponibles no permitieron una comparación humana directa pregunta por pregunta, por lo que sigue sin estar claro cuánto de la brecha de rendimiento se debe al razonamiento sobre imágenes frente a la dificultad de las preguntas.

Una mirada a las explicaciones

Para ir más allá de la calificación correcta‑o‑incorrecta, el equipo pidió a tres médicos experimentados que revisaran las explicaciones producidas por un modelo multimodal. Juzgaron si la IA había interpretado correctamente la pregunta, si su razonamiento se alineaba con la respuesta elegida y si seguir su consejo podría dañar a un paciente. Para las preguntas que el modelo respondió correctamente, sus explicaciones solían ser coherentes y consideradas seguras. Sin embargo, en las preguntas que falló, era común el razonamiento engañoso o inventado—a menudo denominado alucinaciones. Los médicos a veces discreparon sobre qué explicaciones eran problemáticas, reflejando las áreas grises inherentes al juicio médico, pero coincidieron más cuando la respuesta de la IA era claramente errónea y potencialmente insegura.

Qué significa esto para la IA en la atención cotidiana

En conjunto, el estudio muestra que los grandes modelos de IA actuales pueden acercarse al rendimiento humano promedio en un exigente examen médico escrito en portugués brasileño, al menos en preguntas solo textuales. Aun así, siguen teniendo dificultades con las imágenes médicas y pueden ofrecer explicaciones confiadas pero erróneas que podrían inducir a error a los clínicos si se usan sin criterio. Los hallazgos subrayan tanto la promesa como los límites de los sistemas actuales: pueden convertirse en asistentes valiosos en la atención de salud de habla portuguesa, especialmente para leer y resumir texto, pero no están listos para reemplazar a los médicos formados ni para manejar diagnósticos multimodales complejos sin una supervisión cuidadosa y mejoras continuas.

Cita: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Palabras clave: IA médica, modelos grandes de lenguaje, medicina en portugués, diagnóstico multimodal, educación médica