Clear Sky Science · it

Prestazioni zero‑shot di modelli linguistici e multimodali selezionati sull'esame di ammissione alla specialità medica brasiliana 2023

Perché questo è importante per medici e pazienti

L'intelligenza artificiale sta rapidamente entrando in ospedali e ambulatori, ma la maggior parte dei test di questi sistemi viene condotta in inglese. Questo studio ha posto una domanda semplice ma di grande importanza: come se la cavano gli odierni grandi modelli di IA con domande d'esame medico reali scritte in portoghese brasiliano, comprese quelle che utilizzano immagini come radiografie? La risposta aiuta medici, formatori e decisori politici a giudicare se questi strumenti sono pronti ad assistere le cure in paesi in cui l'inglese non è la lingua principale.

Mettere l'IA alla prova con un vero esame d'ammissione

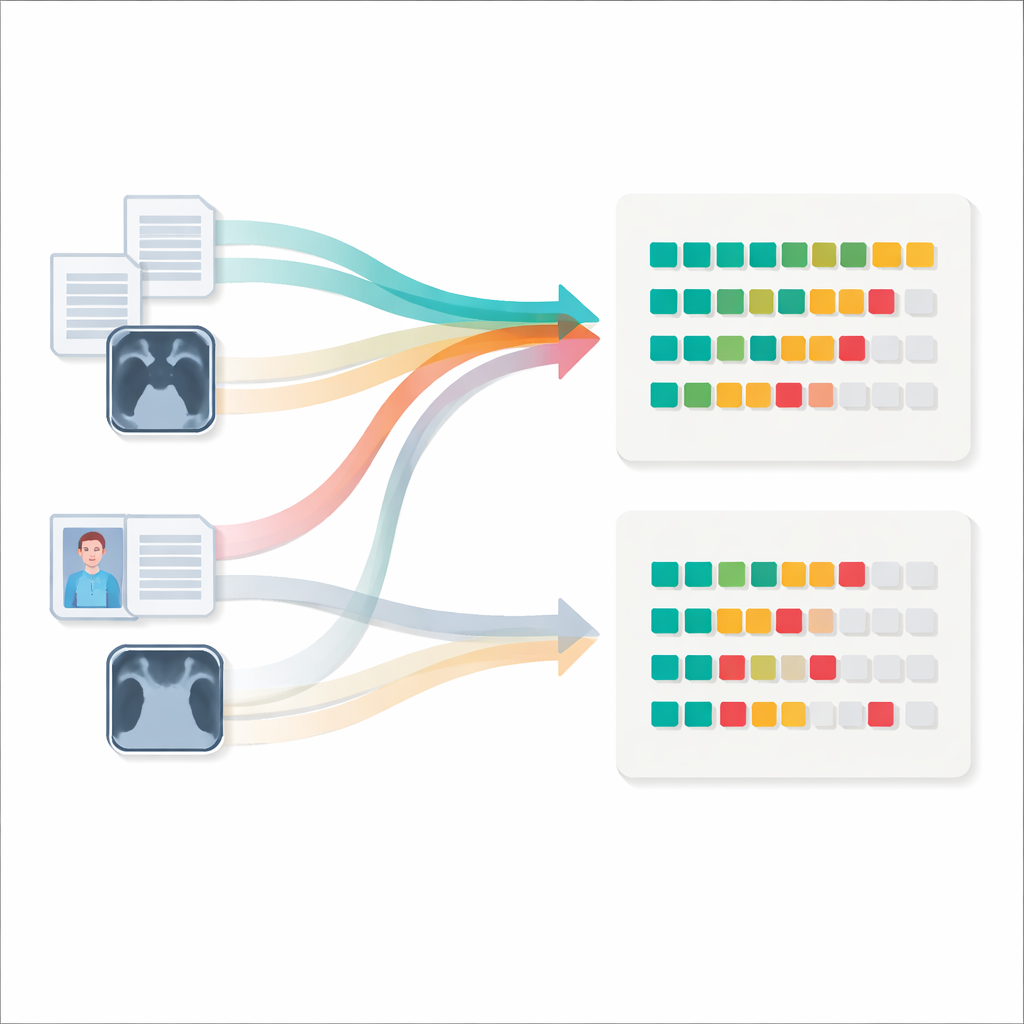

I ricercatori hanno utilizzato l'esame di ammissione alla specialità medica 2023 di uno dei principali ospedali universitari brasiliani, un test che ogni anno affrontano migliaia di giovani medici. Contiene 117 domande a scelta multipla che coprono medicina interna, chirurgia, pediatria, ginecologia e ostetricia e sanità pubblica. La maggior parte delle domande è costituita solo da testo, ma più di un terzo include immagini come esami radiologici, foto cliniche e tracciati diagnostici. Sei modelli di IA testuali e quattro modelli multimodali in grado anche di analizzare immagini sono stati sfidati a rispondere all'esame in modalità “zero‑shot”: non è stato fornito loro alcun esempio precedente né alcun affinamento specifico per questo test, solo istruzioni standard per selezionare una risposta e spiegare il proprio ragionamento.

Quanto erano intelligenti i modelli sulle domande scritte?

Sulle domande costituite solo da testo le prestazioni hanno mostrato ampie differenze. Il sistema più debole ha risposto correttamente a poco più di una domanda su cinque, mentre i migliori modelli hanno azzeccato circa sette domande su dieci. Una famiglia di modelli chiamata Claude ha dominato la classifica, con punteggi intorno al 70 percento, leggermente sopra GPT‑4.0 Turbo e nettamente avanti rispetto a diversi concorrenti open source e commerciali. Tuttavia, un modello open source con decine di miliardi di parametri si è avvicinato ai leader, suggerendo che prestazioni elevate non debbano essere necessariamente appannaggio di sistemi proprietari. Confrontando questi punteggi IA con la distribuzione dei voti dei candidati umani, i migliori modelli si sono collocati vicino al centro della graduatoria: non studenti d'eccellenza, ma all'incirca paragonabili a un medico neo‑laureato medio che sostiene l'esame.

Le immagini ancora mettono in difficoltà l'IA odierna

La situazione è cambiata quando sono state incluse le immagini. Per i quattro modelli multimodali testati, l'accuratezza è diminuita con le domande basate su immagini, spesso scendendo sotto il 50 percento di risposte corrette, specialmente per gli item dominati dalla radiologia. Solo il modello più avanzato ha mantenuto quasi lo stesso punteggio sulle domande miste testo‑e‑immagine rispetto al testo da solo. Per ambito, i sistemi hanno ottenuto i risultati migliori in sanità pubblica e pediatria, e i peggiori in radiologia e in altre domande focalizzate sulle immagini, suggerendo che i dati di addestramento e il design attuali favoriscono il materiale scritto rispetto alle immagini mediche. I clinici coinvolti nello studio non hanno ritenuto che le domande con immagini fossero intrinsecamente più difficili per gli esseri umani, ma i dati disponibili non hanno permesso un confronto diretto domanda per domanda con i soggetti umani, quindi resta incerto quanto del divario di prestazioni derivi dal ragionamento sulle immagini rispetto alla difficoltà intrinseca delle domande.

Dare un'occhiata alle spiegazioni

Per andare oltre una semplice valutazione giusto‑o‑sbagliato, il team ha chiesto a tre medici esperti di rivedere le spiegazioni prodotte da un modello multimodale. Hanno giudicato se l'IA avesse interpretato correttamente la domanda, se il suo ragionamento fosse coerente con la risposta scelta e se seguire il suo consiglio potesse danneggiare un paziente. Per le domande a cui il modello aveva risposto correttamente, le spiegazioni erano di solito coerenti e considerate sicure. Per le domande sbagliate, invece, erano comuni ragionamenti fuorvianti o inventati — spesso definiti allucinazioni. I medici talvolta non erano d'accordo su quali spiegazioni fossero problematiche, riflettendo le aree grigie intrinseche del giudizio medico, ma concordavano maggiormente quando la risposta dell'IA era chiaramente errata e potenzialmente pericolosa.

Cosa significa per l'uso dell'IA nella cura quotidiana

Complessivamente, lo studio mostra che gli odierni grandi modelli di IA possono avvicinarsi alle prestazioni medie umane su un esame medico impegnativo scritto in portoghese brasiliano, almeno per le domande solo testuali. Tuttavia, faticano ancora con le immagini mediche e possono produrre spiegazioni sicure ma errate che potrebbero fuorviare i clinici se usate senza spirito critico. I risultati sottolineano sia le promesse sia i limiti dei sistemi attuali: potrebbero diventare assistenti preziosi nella sanità di lingua portoghese, specialmente per la lettura e la sintesi di testi, ma non sono pronti a sostituire medici formati né a gestire diagnosi multimodali complesse senza attento controllo e miglioramenti continui.

Citazione: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Parole chiave: IA medica, modelli linguistici di grandi dimensioni, medicina in portoghese, diagnostica multimodale, educazione medica