Clear Sky Science · de

Zero‑Shot‑Leistung ausgewählter großer Sprach‑ und multimodaler Modelle bei der brasilianischen Facharztprüfung 2023 (Portugiesisch)

Warum das für Ärztinnen, Ärzte und Patienten wichtig ist

Künstliche Intelligenz dringt schnell in Krankenhäuser und Kliniken vor, doch die meisten Tests solcher Systeme werden auf Englisch durchgeführt. Diese Studie stellte eine einfache, aber folgenschwere Frage: Wie gut bewältigen aktuelle große KI‑Modelle echte Prüfungsfragen aus dem medizinischen Bereich, die auf brasilianischem Portugiesisch verfasst sind — einschließlich solcher mit Bildern wie Röntgenaufnahmen? Die Antwort hilft Ärzten, Ausbildern und politischen Entscheidungsträgern zu beurteilen, ob diese Werkzeuge bereit sind, in Ländern zu unterstützen, in denen Englisch nicht die Hauptsprache ist.

Die KI auf eine echte medizinische Aufnahmeprüfung ansetzen

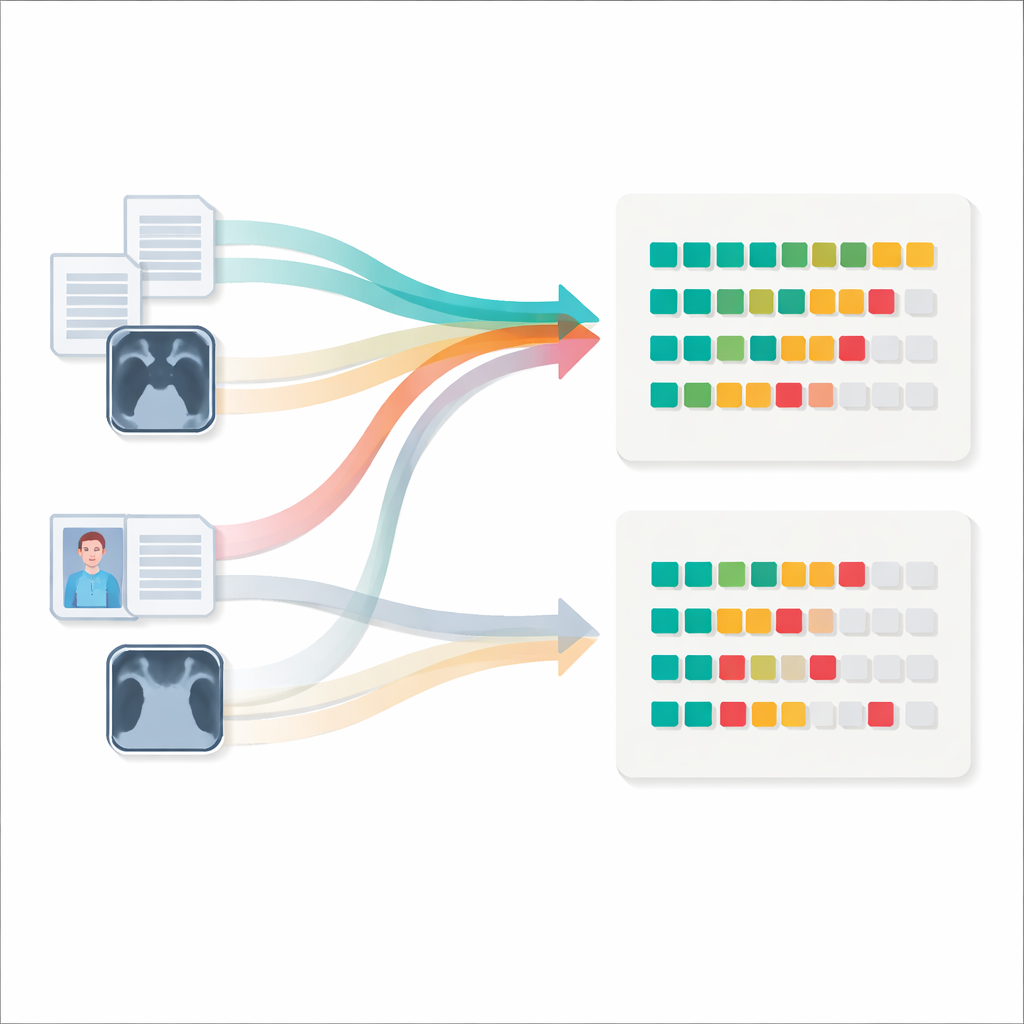

Die Forschenden nutzten die Aufnahmeprüfung für die Facharztweiterbildung 2023 eines der führenden Lehrkrankenhäuser Brasiliens — eine Prüfung, die jährlich von Tausenden junger Ärztinnen und Ärzte abgelegt wird. Sie umfasst 117 Multiple‑Choice‑Fragen zu Innerer Medizin, Chirurgie, Pädiatrie, Gynäkologie und Geburtshilfe sowie öffentlicher Gesundheit. Die meisten Fragen bestehen nur aus Text, mehr als ein Drittel enthalten jedoch Bilder wie radiologische Aufnahmen, klinische Fotos und diagnostische Kurven. Sechs rein textbasierte KI‑Modelle und vier multimodale Modelle, die auch Bilder verarbeiten können, wurden in einem Zero‑Shot‑Szenario getestet: Sie erhielten keine vorherigen Beispiele oder auf die Prüfung zugeschnittenes Fine‑Tuning, nur die üblichen Anweisungen, eine Antwort auszuwählen und ihre Begründung darzulegen.

Wie leistungsfähig waren die Modelle bei schriftlichen Fragen?

Bei rein textbasierten Fragen reichte die Leistung stark auseinander. Das schwächste System beantwortete knapp mehr als jede fünfte Frage richtig, während die besten Modelle etwa sieben von zehn Fragen korrekt lösten. Eine Modellfamilie namens Claude führte die Rangliste an, mit Werten um die 70 Prozent, etwas vor GPT‑4.0 Turbo und deutlich vor mehreren Open‑Source‑ und kommerziellen Konkurrenten. Ein Open‑Source‑Modell mit mehreren Milliarden Parametern kam jedoch den Spitzenreitern nahe, was andeutet, dass starke Leistung nicht zwangsläufig proprietären Systemen vorbehalten sein muss. Verglich man die KI‑Ergebnisse mit der Verteilung der menschlichen Kandidatenbewertungen, so lagen die besten Modelle etwa in der Mitte des Bewerberpools: keine Spitzenleistungen, aber ungefähr auf dem Niveau eines durchschnittlichen jungen Arztes, der die Prüfung schreibt.

Bilder bringen heutige KI noch ins Straucheln

Die Situation änderte sich, sobald Bilder hinzukamen. Bei den vier getesteten multimodalen Modellen sank die Genauigkeit, sobald bildbasierte Fragen einbezogen wurden, häufig auf unter 50 Prozent, besonders bei radiologieintensiven Aufgaben. Nur das fortschrittlichste Modell hielt fast dieselbe Punktzahl bei gemischten Text‑und‑Bild‑Fragen wie bei reinem Text. Über die Fachgebiete hinweg schnitten die Systeme in öffentlicher Gesundheit und Pädiatrie am besten ab und am schlechtesten in Radiologie und anderen bildzentrierten Fragen, was darauf hindeutet, dass aktuelle Trainingsdaten und Modelldesign geschriebene Inhalte gegenüber medizinischen Bildern bevorzugen. Die an der Studie beteiligten Kliniker empfanden die Bildfragen nicht per se als schwerer für Menschen, doch die verfügbaren Daten erlaubten keinen direkten, frage‑für‑frage Vergleich mit menschlichen Teilnehmenden, sodass unklar bleibt, wie groß der Teil der Leistungslücke tatsächlich durch Bildverarbeitung im Gegensatz zur Schwierigkeit der Fragen bedingt ist.

Ein Blick in die Erklärungen

Um über richtig oder falsch hinauszugehen, baten die Forschenden drei erfahrene Ärztinnen und Ärzte, die vom einem multimodalen Modell erzeugten Erklärungen zu prüfen. Sie beurteilten, ob die KI die Frage korrekt interpretiert hatte, ob ihre Argumentation mit der gewählten Antwort übereinstimmte und ob das Befolgen ihres Rats einen Patienten gefährden könnte. Bei korrekt beantworteten Fragen waren die Erklärungen des Modells meist kohärent und als unbedenklich einzustufen. Bei falsch beantworteten Fragen hingegen waren irreführende oder erfundene Erklärungen — oft als Halluzinationen bezeichnet — häufig. Die Mediziner waren sich nicht in allen Fällen einig, welche Erklärungen problematisch waren, was die grauen Bereiche der medizinischen Beurteilung widerspiegelt; bei klar falschen und potenziell unsicheren Antworten stimmten sie jedoch häufiger überein.

Was das für KI in der täglichen Versorgung bedeutet

Insgesamt zeigt die Studie, dass heutige große KI‑Modelle bei einer anspruchsvollen medizinischen Prüfung in brasilianischem Portugiesisch zumindest bei rein textbasierten Fragen annähernd die durchschnittliche menschliche Leistung erreichen können. Dennoch haben sie weiterhin Probleme mit medizinischen Bildern und liefern gelegentlich selbstbewusste, aber fehlerhafte Erklärungen, die Klinikpersonal in die Irre führen könnten, wenn sie unkritisch eingesetzt werden. Die Ergebnisse unterstreichen sowohl das Potenzial als auch die Grenzen der aktuellen Systeme: Sie könnten zu nützlichen Assistenten in portugiesischsprachigen Gesundheitssystemen werden, insbesondere beim Lesen und Zusammenfassen von Texten, sind jedoch nicht bereit, ausgebildete Ärztinnen und Ärzte zu ersetzen oder komplexe multimodale Diagnosen ohne sorgfältige Aufsicht und fortlaufende Verbesserungen zu übernehmen.

Zitation: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Schlüsselwörter: medizinische KI, große Sprachmodelle, portugiesische Medizin, multimodale Diagnostik, medizinische Ausbildung