Clear Sky Science · nl

Zero-shot prestaties van geselecteerde grote taal- en multimodale modellen op het Braziliaanse medisch residentie-examen 2023

Waarom dit belangrijk is voor artsen en patiënten

Kunstmatige intelligentie dringt snel door in ziekenhuizen en klinieken, maar de meeste tests van deze systemen worden in het Engels uitgevoerd. Deze studie stelde een eenvoudige, maar hoogst belangrijke vraag: hoe goed gaan de huidige grote AI-modellen om met echte medische examenvragen opgesteld in Braziliaans Portugees, inclusief vragen met afbeeldingen zoals röntgenfoto’s? Het antwoord helpt artsen, opleiders en beleidsmakers te beoordelen of deze hulpmiddelen klaar zijn om in landen waar Engels geen voertaal is de zorg te ondersteunen.

AI toetsen met een echt toelatingsexamen voor artsen

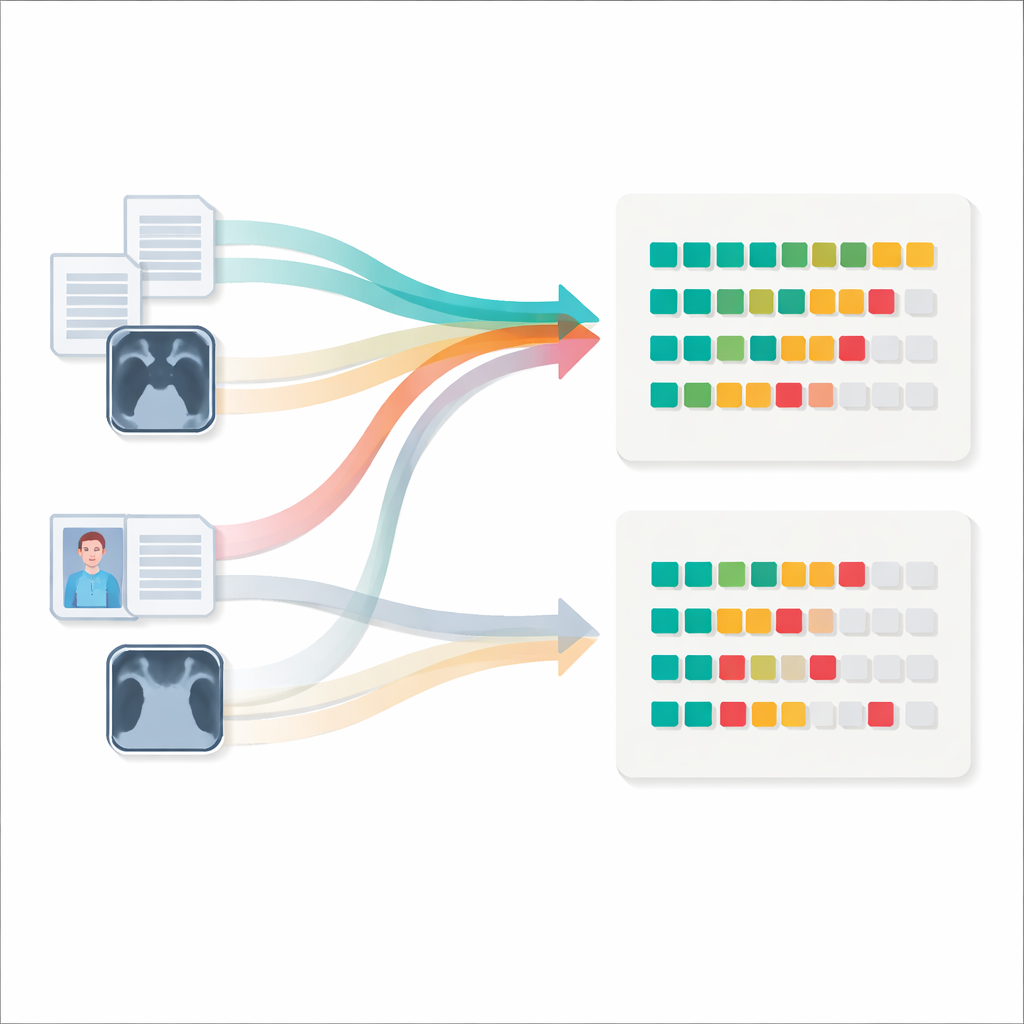

De onderzoekers gebruikten het toelatingsexamen voor medische residentie uit 2023 van een van Brazilië’s leidende opleidingsziekenhuizen, een examen dat jaarlijks door duizenden jonge artsen wordt afgelegd. Het bevat 117 meerkeuzevragen over interne geneeskunde, chirurgie, kindergeneeskunde, gynaecologie en verloskunde en volksgezondheid. De meeste vragen bestaan alleen uit tekst, maar meer dan een derde bevat afbeeldingen zoals radiologische scans, klinische foto’s en diagnostische traceringen. Zes tekst-only AI-modellen en vier multimodale modellen die ook afbeeldingen kunnen analyseren, kregen het examen in een “zero-shot” setting: ze kregen geen voorafgaande voorbeelden of specifieke bijsturing voor deze test, alleen standaardinstructies om een antwoord te kiezen en hun redenering uit te leggen.

Hoe slim waren de modellen op schriftelijke vragen?

Bij vragen die uitsluitend uit tekst bestonden, varieerde de prestatie sterk. Het zwakste systeem had iets meer dan één op de vijf vragen goed, terwijl de beste modellen ongeveer zeven van de tien vragen correct beantwoordden. Een familie modellen genaamd Claude stond bovenaan, met scores rond de 70 procent, iets hoger dan GPT‑4.0 Turbo en duidelijk voor meerdere open-source en commerciële concurrenten. Eén open-sourcemodel met vele miljarden parameters kwam echter dicht in de buurt van de koplopers, wat suggereert dat sterke prestaties niet per se beperkt hoeven te blijven tot propriëtaire systemen. Toen de onderzoekers deze AI-scores vergeleken met de verdeling van menselijk kandidaatresultaten, bevonden de beste modellen zich ongeveer in het midden van de aanmelders: geen sterstudenten, maar ruwweg vergelijkbaar met een gemiddelde beginnende arts die het examen aflegt.

Afbeeldingen vormen nog steeds een struikelblok voor AI van vandaag

Het beeld veranderde toen afbeeldingen werden toegevoegd. Voor de vier geteste multimodale modellen daalde de nauwkeurigheid zodra beeldgebaseerde vragen werden meegenomen, vaak tot onder de 50 procent correct, vooral bij items met veel radiologie. Alleen het meest geavanceerde model hield vrijwel dezelfde score op gemengde tekst‑en‑beeldvragen als op alleen tekst. Over de vakgebieden heen presteerden de systemen het beste in volksgezondheid en kindergeneeskunde, en het slechtst in radiologie en andere beeldgerichte vragen, wat suggereert dat huidige trainingsdata en modelontwerpen tekstueel materiaal bevoordelen boven medische beelden. De clinici die bij de studie betrokken waren, vonden de beeldvragen niet per se moeilijker voor mensen, maar de beschikbare gegevens maakten geen directe, vraag‑voor‑vraag menselijke vergelijking mogelijk, dus het blijft onduidelijk hoeveel van de prestatiekloof toe te schrijven is aan beeldredenering versus de moeilijkheidsgraad van de vragen.

Een blik in de uitleggen

Om verder te gaan dan alleen goed‑of‑fout scores, vroegen de onderzoekers drie ervaren artsen de uitleggen van één multimodaal model te beoordelen. Ze oordeelden of de AI de vraag correct had geïnterpreteerd, of de redenering strookte met het gekozen antwoord, en of het opvolgen van het advies een patiënt zou kunnen schaden. Bij vragen die het model goed beantwoordde, waren de verklaringen meestal coherent en als veilig beoordeeld. Bij fout beantwoorde vragen kwam misleidende of verzonnen redenering—vaak aangeduid als hallucinaties—echter veel voor. De artsen waren het soms oneens over welke verklaringen problematisch waren, wat de inherente grijze gebieden van medische beoordeling weerspiegelt, maar ze waren het vaker eens wanneer het antwoord van de AI duidelijk fout en mogelijk onveilig was.

Wat dit betekent voor AI in de dagelijkse zorg

Samengevat toont de studie aan dat de huidige grote AI‑modellen bij tekst‑alleen vragen een prestatie kunnen bereiken die in de buurt komt van gemiddelde menselijke prestaties op een veeleisend medisch examen geschreven in Braziliaans Portugees. Toch hebben ze nog steeds moeite met medische beelden en kunnen ze zelfverzekerde maar foutieve verklaringen geven die clinici kunnen misleiden als ze onkritisch worden gebruikt. De bevindingen benadrukken zowel de belofte als de beperkingen van huidige systemen: ze kunnen waardevolle assistenten worden in Portugeessprekende gezondheidszorg, vooral voor het lezen en samenvatten van tekst, maar ze zijn nog niet klaar om opgeleide artsen te vervangen of complexe multimodale diagnostiek te behandelen zonder zorgvuldige supervisie en doorlopende verbetering.

Bronvermelding: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Trefwoorden: medische AI, grote taalmodellen, Portugese geneeskunde, multimodale diagnostiek, medisch onderwijs