Clear Sky Science · pt

Desempenho zero-shot de modelos grandes de linguagem e multimodais selecionados no exame de residência médica em português brasileiro de 2023

Por que isso importa para médicos e pacientes

A inteligência artificial está rapidamente entrando em hospitais e clínicas, mas a maioria dos testes desses sistemas é feita em inglês. Este estudo fez uma pergunta simples e de alto impacto: quão bem os grandes modelos de IA atuais lidam com questões reais de exame médico escritas em português brasileiro, incluindo as que usam imagens como radiografias? A resposta ajuda médicos, educadores e formuladores de políticas a avaliar se essas ferramentas estão prontas para auxiliar o atendimento em países onde o inglês não é a língua principal.

Submetendo a IA a um exame real de seleção médica

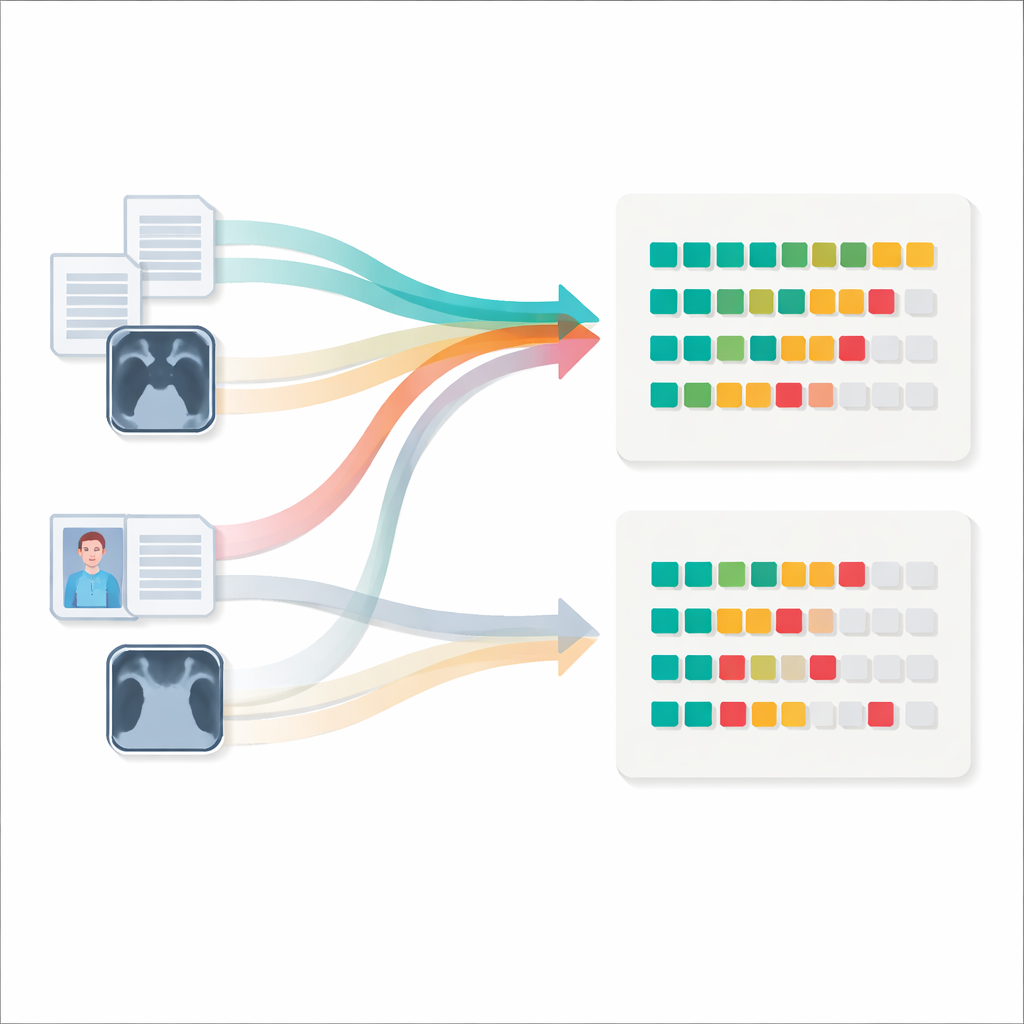

Os pesquisadores tomaram o exame de residência médica de 2023 de um dos principais hospitais de ensino do Brasil, uma prova que milhares de jovens médicos fazem a cada ano. Ele contém 117 questões de múltipla escolha cobrindo clínica médica, cirurgia, pediatria, ginecologia e obstetrícia e saúde pública. A maioria das questões é apenas textual, mas mais de um terço inclui imagens como exames de radiologia, fotos clínicas e traçados diagnósticos. Seis modelos de IA apenas de texto e quatro modelos multimodais capazes também de “ver” imagens foram desafiados a responder ao exame em um cenário “zero-shot”: não receberam exemplos prévios nem ajuste fino específico para este teste, apenas instruções padrão para escolher uma resposta e explicar seu raciocínio.

Quão inteligentes foram os modelos nas questões escritas?

Nas questões compostas apenas por texto, o desempenho variou amplamente. O sistema mais fraco acertou pouco mais de uma em cada cinco questões, enquanto os melhores modelos responderam cerca de sete em cada dez corretamente. Uma família de modelos chamada Claude liderou o ranking, com pontuações em torno de 70%, ligeiramente acima do GPT‑4.0 Turbo e claramente à frente de vários concorrentes de código aberto e comerciais. Um modelo de código aberto com muitos bilhões de parâmetros, porém, aproximou‑se dos líderes, sugerindo que desempenho forte não precisa ser exclusivo de sistemas proprietários. Quando os pesquisadores compararam essas pontuações de IA com a distribuição das notas dos candidatos humanos, os melhores modelos se agruparam perto do meio da bancada de candidatos: não eram estudantes excepcionais, mas estavam aproximadamente no patamar de um médico recém‑formado médio que realiza o exame.

As imagens ainda derrubam as IAs atuais

As coisas mudaram quando imagens foram incluídas. Para os quatro modelos multimodais testados, a acurácia caiu quando questões baseadas em imagens foram adicionadas, frequentemente ficando abaixo de 50% de acertos, especialmente em itens com forte demanda por radiologia. Apenas o modelo mais avançado manteve quase a mesma pontuação em questões mistas de texto e imagem do que em texto isolado. Por áreas, os sistemas se saíram melhor em saúde pública e pediatria, e pior em radiologia e outras questões centradas em imagens, sugerindo que os dados de treinamento e o design atuais favorecem material escrito em detrimento de imagens médicas. Os clínicos envolvidos no estudo não sentiram que as questões com imagem fossem inerentemente mais difíceis para humanos, mas os dados disponíveis não permitiram uma comparação direta, questão por questão, com humanos; portanto, permanece incerto quanto da lacuna de desempenho decorre do raciocínio sobre imagens versus da dificuldade das próprias questões.

Espiando as explicações

Para ir além da pontuação de certo ou errado, a equipe pediu a três médicos experientes que revisassem as explicações produzidas por um modelo multimodal. Eles avaliaram se a IA interpretou a questão corretamente, se seu raciocínio coincidia com a resposta escolhida e se seguir seu conselho poderia prejudicar um paciente. Para as questões que o modelo respondeu corretamente, suas explicações geralmente eram coerentes e consideradas seguras. Para as questões que errou, contudo, raciocínios enganosos ou inventados — frequentemente chamados de alucinações — foram comuns. Os médicos às vezes discordaram sobre quais explicações eram problemáticas, refletindo as áreas cinzentas inerentes ao julgamento médico, mas concordaram mais quando a resposta da IA era claramente errada e potencialmente insegura.

O que isso significa para a IA no cuidado cotidiano

No geral, o estudo mostra que os grandes modelos de IA atuais podem se aproximar do desempenho humano médio em um exigente exame médico escrito em português brasileiro, pelo menos para questões apenas textuais. Ainda assim, eles têm dificuldade com imagens médicas e podem oferecer explicações confiantes porém equivocadas que podem induzir erro nos clínicos se usados sem crítica. Os achados ressaltam tanto a promessa quanto os limites dos sistemas atuais: podem tornar‑se assistentes valiosos na saúde de língua portuguesa, especialmente para leitura e sumarização de texto, mas não estão prontos para substituir médicos treinados nem para lidar com diagnóstico multimodal complexo sem supervisão cuidadosa e aprimoramentos contínuos.

Citação: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Palavras-chave: IA médica, grandes modelos de linguagem, medicina em português, diagnósticos multimodais, educação médica