Clear Sky Science · ar

الأداء بدون تدريب مسبق لنماذج اللغة الكبيرة والنماذج متعددة الوسائط المختارة في امتحان الزمالة الطبية البرازيلي لعام 2023

لماذا هذا مهم للأطباء والمرضى

يتقدّم الذكاء الاصطناعي بسرعة إلى المستشفيات والعيادات، لكن معظم اختبارات هذه الأنظمة تُجرى بالإنجليزية. طرحت هذه الدراسة سؤالاً بسيطاً لكنه ذو تداعيات كبيرة: ما مدى قدرة نماذج الذكاء الاصطناعي الكبيرة الحالية على التعامل مع أسئلة امتحانات طبية حقيقية مكتوبة بالبرتغالية البرازيلية، بما في ذلك الأسئلة التي تتضمن صوراً مثل الأشعة السينية؟ تساعد الإجابة الأطباء والمعلمين وصانعي السياسات على تقييم ما إذا كانت هذه الأدوات جاهزة لمساعدة الرعاية الصحية في بلدان ليست الإنجليزية لغتها الرئيسية.

تعريض الذكاء الاصطناعي لامتحان قبول طبي حقيقي

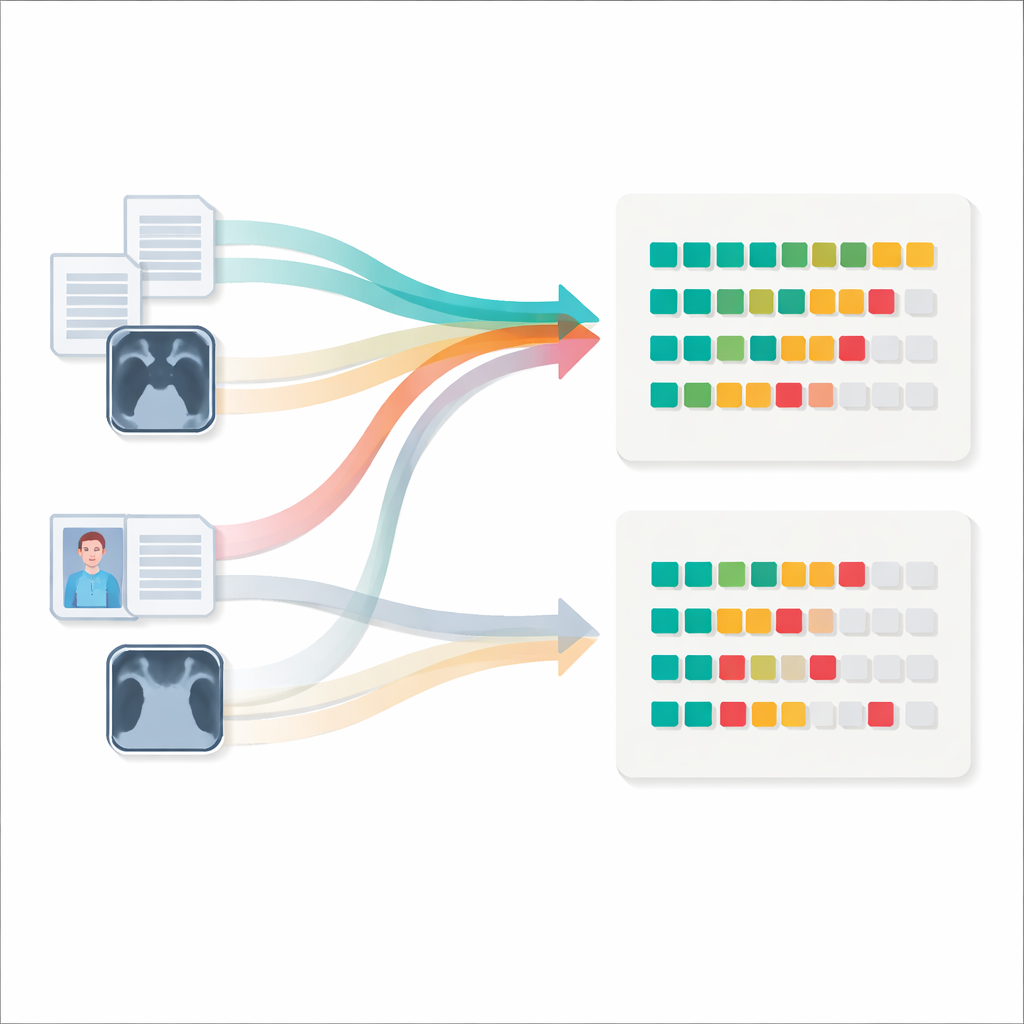

استخدم الباحثون امتحان قبول الزمالة الطبية لعام 2023 من أحد المستشفيات التعليمية الرائدة في البرازيل، وهو امتحان يجريه آلاف الأطباء الشباب سنوياً. يحتوي الامتحان على 117 سؤالاً اختيارياً يغطي الطب الباطني، الجراحة، طب الأطفال، النساء والتوليد، والصحة العامة. معظم الأسئلة نصية فقط، لكن أكثر من ثلثها يتضمن صوراً مثل صور الأشعة، وصور سريرية، وتتبع تشخيصي. طُلب من ستة نماذج نصية فقط وأربعة نماذج متعددة الوسائط قادرة على رؤية الصور الإجابة على الامتحان في إعداد "بدون تدريب مسبق": لم تُعرض عليها أمثلة سابقة أو تعديل خاص لهذا الاختبار، بل فقط تعليمات قياسية لاختيار إجابة وشرح مبرراتها.

ما مدى ذكاء النماذج في الأسئلة المكتوبة؟

في الأسئلة النصية فقط، تفاوت الأداء بشكل كبير. أضعف نظام أجاب بشكل صحيح على قليل أكثر من سؤال واحد من كل خمسة، بينما أجابت أفضل النماذج بنحو سبعة من كل عشرة صحيحة. تصدرت عائلة نماذج تُدعى Claude النتائج، بدرجات تقارب 70 بالمئة، متفوقة قليلاً على GPT‑4.0 Turbo وبفارق واضح عن عدة منافسين مفتوحي ومملوكين. ومع ذلك، اقترب أحد النماذج مفتوحة المصدر ذات المليارات من المعاملات من المتصدّرين، ما يوحي بأن الأداء القوي لا يقتصر بالضرورة على الأنظمة الاحتكارية. عندما قارن الباحثون هذه الدرجات بتوزيع درجات المرشحين البشر، تركزت أفضل النماذج بالقرب من منتصف تجمع المتقدمين: ليست طلاباً متميزين، بل تقارب مستوى طبيب جديد متوسط يأدي الامتحان.

الصور لا تزال تعقّد أداء الذكاء الاصطناعي اليوم

تغيرت النتيجة عند إضافة الصور. بالنسبة للنماذج المتعددة الوسائط الأربعة المختبرة، انخفضت الدقة عند إدراج الأسئلة القائمة على الصور، وغالباً ما هبطت تحت 50 بالمئة صحيحة، لا سيما في البنود التي تعتمد على الأشعة. حافظ نموذج واحد فقط متقدم على درجة تقارب نفس مستوى الأسئلة المختلطة نص‑وصور كما في النص فقط. عبر التخصصات، كان أداء النماذج أفضل في الصحة العامة وطب الأطفال، وأسوأ في الأشعة والأسئلة الأخرى التي تركز على الصور، ما يوحي أن بيانات التدريب وتصميم النماذج الحالية تُفضّل المواد المكتوبة على الصور الطبية. لم يشعر الأطباء المشاركون في الدراسة أن أسئلة الصور أصعب بطبيعتها للبشر، لكن البيانات المتاحة لم تسمح بمقارنة بشرية مباشرة سؤالاً بسؤال، لذا يبقى من غير الواضح كم من الفجوة في الأداء ناتج عن استدلال الصور مقابل صعوبة الأسئلة.

نظرة داخل التفسيرات

للتجاوز عن مجرد التقييم الصحيح/الخاطئ، طلب الفريق من ثلاثة أطباء ذوي خبرة مراجعة التفسيرات التي أَنتجَها نموذج متعدد الوسائط واحد. قيّموا ما إذا كان الذكاء الاصطناعي قد فسر السؤال بشكل صحيح، وما إذا كان تعليله يتماشى مع الإجابة المختارة، وما إذا كان اتباع نصيحته قد يضر المريض. بالنسبة للأسئلة التي أجاب عنها النموذج بشكل صحيح، كانت تفسيراتُه عادة متماسكة ويُعتَبر اتّباعها آمناً. أما في الأسئلة التي أخفق فيها، فكان التعليل المضلل أو المخترع—الذي يُطلق عليه غالباً هلوسات—شائعاً. أحياناً اختلف الأطباء بشأن أي التفسيرات كانت إشكالية، مما يعكس مناطق الرمادي المتأصلة في الحكم الطبي، لكنهم اتّفقوا أكثر عندما كانت إجابة الذكاء الاصطناعي خاطئة بوضوح وقد تكون غير آمنة.

ماذا يعني هذا للذكاء الاصطناعي في الرعاية اليومية

بشكل عام، تُظهر الدراسة أن نماذج الذكاء الاصطناعي الكبيرة الحالية قادرة على الاقتراب من أداء إنساني متوسط في امتحان طبي صعب مكتوب بالبرتغالية البرازيلية، على الأقل في الأسئلة النصية فقط. ومع ذلك، لا تزال تكافح مع الصور الطبية ويمكنها أن تقدم تفسيرات واثقة لكنها خاطئة قد تضلل الأطباء إذا استُخدمت دون نقد. تؤكد النتائج كلا من الوعد والحدود للأنظمة الحالية: فقد تصبح مساعدين قيمين في الرعاية الصحية الناطقة بالبرتغالية، لا سيما في قراءة وتلخيص النصوص، لكنها ليست جاهزة لاستبدال الأطباء المدربين أو للتعامل مع التشخيصات المعقدة متعددة الوسائط دون إشراف دقيق وتحسين مستمر.

الاستشهاد: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

الكلمات المفتاحية: الذكاء الاصطناعي الطبي, نماذج اللغة الكبيرة, الطب بالبرتغالية, التشخيص متعدد الوسائط, التعليم الطبي