Clear Sky Science · pl

Wydajność zero-shot wybranych dużych modeli językowych i multimodalnych na egzaminie rezydenckim z medycyny w języku portugalskim (Brazylia) 2023

Dlaczego to ma znaczenie dla lekarzy i pacjentów

Sztuczna inteligencja szybko wkracza do szpitali i przychodni, lecz większość testów tych systemów przeprowadza się po angielsku. Badanie postawiło proste, o wysoką stawkę pytanie: jak dobrze dzisiejsze duże modele AI radzą sobie z rzeczywistymi pytaniami egzaminacyjnymi napisanymi po portugalsku (brazylijskim), w tym z pytaniami wykorzystującymi obrazy, np. zdjęcia rentgenowskie? Odpowiedź pomaga lekarzom, edukatorom i decydentom ocenić, czy narzędzia te są gotowe do wspierania opieki w krajach, gdzie angielski nie jest językiem dominującym.

Poddanie AI prawdziwemu egzaminowi wstępnemu do rezydentury

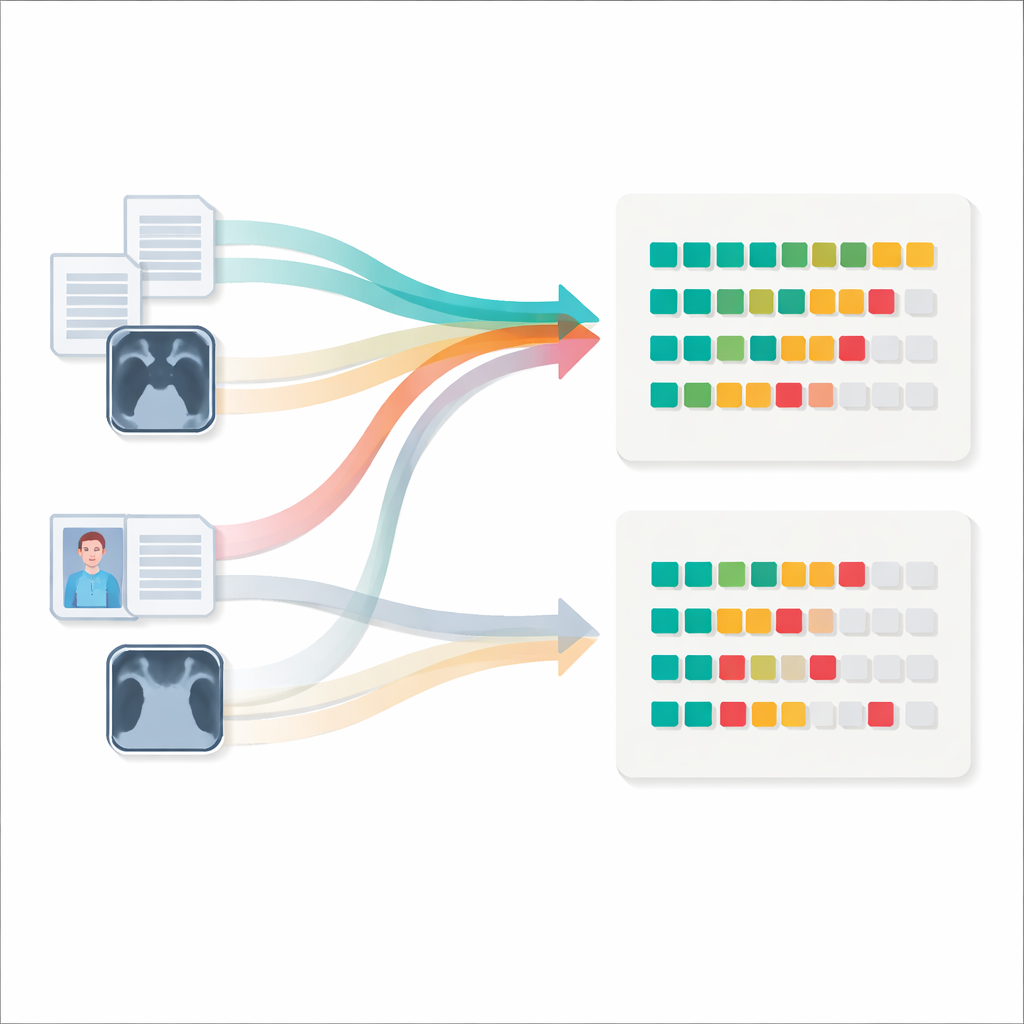

Naukowcy wzięli egzamin wstępny na rezydenturę medyczną z 2023 roku przeprowadzony w jednym z czołowych szpitali akademickich Brazylii — egzamin, który co roku zdaje tysiące młodych lekarzy. Zawierał 117 pytań wielokrotnego wyboru obejmujących medycynę wewnętrzną, chirurgię, pediatrię, ginekologię i położnictwo oraz zdrowie publiczne. Większość pytań była tekstowa, ale ponad jedna trzecia zawierała obrazy, takie jak skany radiologiczne, fotografie kliniczne i zapis diagnostyczny. Sześć modeli AI pracujących tylko na tekście oraz cztery modele multimodalne zdolne także „widzieć” obrazy zostały poproszone o rozwiązanie egzaminu w trybie „zero-shot”: nie otrzymały żadnych wcześniejszych przykładów ani dopasowania pod ten test, jedynie standardowe instrukcje, aby wybrać odpowiedź i uzasadnić rozumowanie.

Jak inteligentne były modele w pytaniach pisemnych?

W pytaniach składających się wyłącznie z tekstu wyniki wahały się w szerokim zakresie. Najsłabszy system poprawnie odpowiadał nieco ponad jedno na pięć pytań, podczas gdy najlepsze modele odpowiadały prawidłowo w około siedmiu na dziesięć przypadków. Rodzina modeli nazwana Claude zajęła czołowe miejsce, z wynikami na poziomie około 70 procent, nieco powyżej GPT‑4.0 Turbo i wyraźnie przed kilkoma konkurentami open‑source i komercyjnymi. Jeden model open‑source z wieloma miliardami parametrów jednak niemal dorównał liderom, co sugeruje, że silna wydajność nie musi być zarezerwowana dla systemów własnościowych. Porównując wyniki AI z rozkładem ocen ludzkich kandydatów, najlepsze modele skupiały się w pobliżu środka puli aplikantów: nie były to gwiazdy, lecz poziom zbliżony do przeciętnego młodego lekarza przystępującego do egzaminu.

Obrazy wciąż sprawiają problemy współczesnej AI

Sytuacja zmieniała się po dodaniu obrazów. W przypadku czterech testowanych modeli multimodalnych dokładność spadała po uwzględnieniu pytań z obrazami, często poniżej 50 procent poprawnych odpowiedzi, szczególnie przy zadaniach z dużą zawartością radiologii. Tylko najbardziej zaawansowany model utrzymywał niemal tę samą skuteczność w pytaniach mieszanych (tekst i obraz) co w samych pytaniach tekstowych. W przekrojach tematycznych systemy radziły sobie najlepiej w zdrowiu publicznym i pediatrii, a najsłabiej w radiologii i innych zadaniach skoncentrowanych na obrazach, co sugeruje, że obecne dane treningowe i konstrukcja modeli faworyzują materiały pisane nad obrazami medycznymi. Lekarze zaangażowani w badanie nie stwierdzili, aby pytania obrazowe były z natury trudniejsze dla ludzi, ale dostępne dane nie pozwalały na bezpośrednie, pytanie‑po‑pytaniu porównanie z ludźmi, więc nadal nie jest jasne, ile luki w wydajności wynika z rozumowania obrazowego, a ile z trudności samych pytań.

Rzut oka do wnętrza wyjaśnień

Aby pójść dalej niż tylko ocena poprawne/niepoprawne, zespół poprosił trzech doświadczonych lekarzy o ocenę wyjaśnień wygenerowanych przez jeden model multimodalny. Oceniali, czy AI prawidłowo zinterpretowało pytanie, czy jego rozumowanie zgadza się z wybraną odpowiedzią i czy podążanie za jego radą mogłoby zaszkodzić pacjentowi. Dla pytań, na które model odpowiedział poprawnie, jego wyjaśnienia były zwykle spójne i uznane za względnie bezpieczne. W przypadku pytań, których model nie rozwiązał poprawnie, częste były wprowadzające w błąd lub zmyślone rozumowania — tzw. halucynacje. Lekarze czasami nie zgadzali się co do tego, które wyjaśnienia były problematyczne, co odzwierciedla inherentne szarości w osądach medycznych, lecz częściej osiągali zgodę, gdy odpowiedź AI była wyraźnie błędna i potencjalnie niebezpieczna.

Co to oznacza dla AI w codziennej opiece

Podsumowując, badanie pokazuje, że dzisiejsze duże modele AI mogą zbliżyć się do średniej ludzkiej wydajności na wymagającym egzaminie medycznym napisanym po portugalsku brazylijskim, przynajmniej w pytaniach tekstowych. Jednak nadal mają trudności z obrazami medycznymi i potrafią generować pewne, lecz błędne wyjaśnienia, które mogą wprowadzać w błąd klinicystów, jeśli będą używane bezkrytycznie. Wyniki podkreślają zarówno obietnicę, jak i ograniczenia obecnych systemów: mogą stać się wartościowymi asystentami w opiece zdrowotnej w krajach portugalsko‑języcznych, szczególnie w zakresie czytania i streszczania tekstów, ale nie są gotowe, by zastąpić wykwalifikowanych lekarzy ani prowadzić skomplikowaną diagnozę multimodalną bez uważnego nadzoru i dalszych udoskonaleń.

Cytowanie: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Słowa kluczowe: sztuczna inteligencja w medycynie, duże modele językowe, medycyna po portugalsku, diagnostyka multimodalna, kształcenie medyczne