Clear Sky Science · ru

Нулевой (zero-shot) результат выбранных крупных языковых и мультимодальных моделей на экзамене по медицинской резидентуре Бразилии 2023 года

Почему это важно для врачей и пациентов

Искусственный интеллект быстро проникает в больницы и клиники, но большинство испытаний таких систем проводится на английском языке. В этом исследовании поставили простой, но важный вопрос: как хорошо современные крупные ИИ‑модели справляются с реальными медицинскими экзаменационными вопросами, написанными на бразильском португальском, включая задачи с изображениями, такими как рентгеновские снимки? Ответ помогает врачам, преподавателям и политикам оценить, готовы ли эти инструменты помогать лечению в странах, где английский не является основным языком.

Проверка ИИ на реальном вступительном экзамене в ординатуру

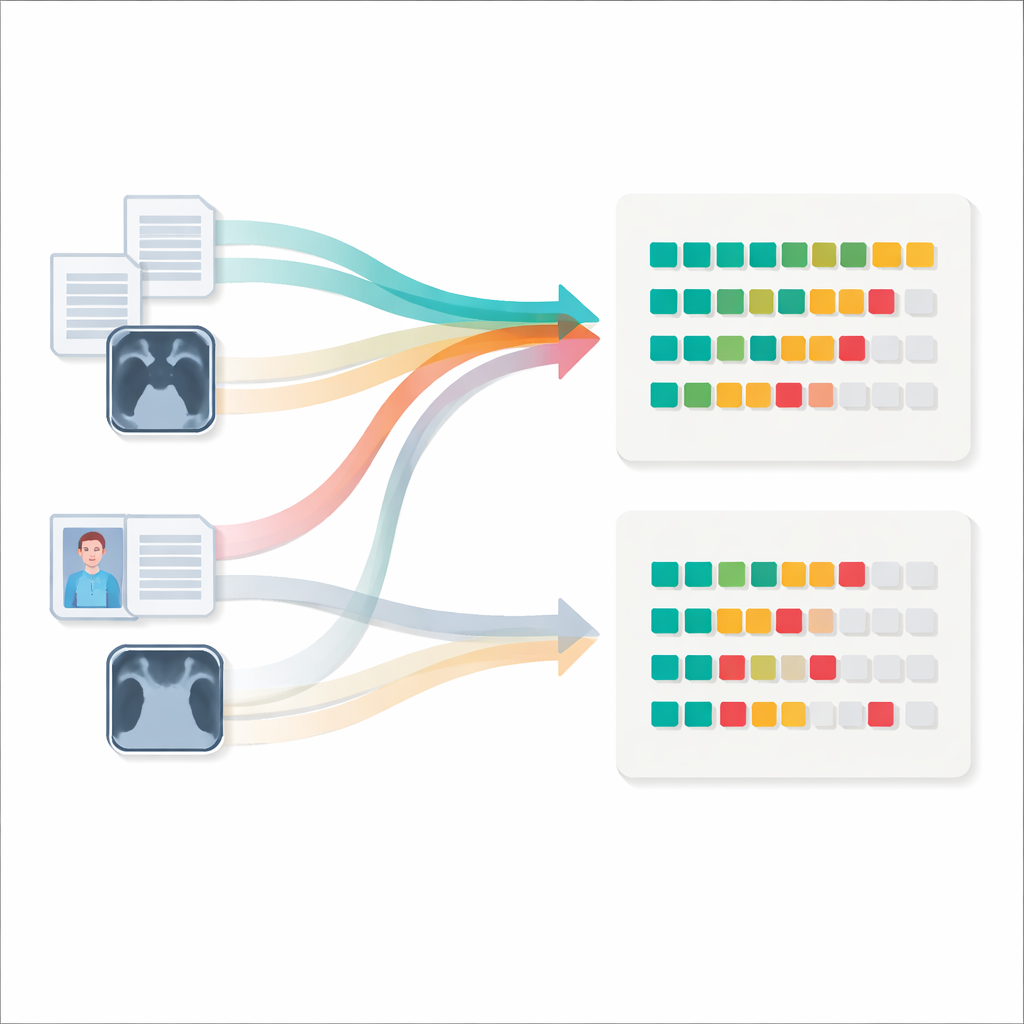

Исследователи взяли экзамен 2023 года для поступления в медицинскую резидентуру одного из ведущих учебных госпиталей Бразилии — экзамен, который ежегодно проходит несколько тысяч молодых врачей. Он содержит 117 вопросов с несколькими вариантами ответов по внутренней медицине, хирургии, педиатрии, гинекологии и акушерству, а также общественному здоровью. Большинство вопросов — только текстовые, но более трети включают изображения, такие как радиологические сканы, клинические фотографии и диагностические кривые. Шести текстовым моделям ИИ и четырем мультимодальным моделям, которые также «видят» изображения, было предложено ответить на экзамен в режиме «zero‑shot»: им не давали примеров или дообучения, специфичного для этого теста, только стандартные инструкции выбрать ответ и объяснить своё рассуждение.

Насколько умны модели на письменных вопросах?

На чисто текстовых вопросах результаты сильно варьировали. Худшая система верно ответила чуть более чем на одну пятую вопросов, тогда как лучшие модели ответили примерно на семь из десяти вопросов правильно. Лидирующая группа моделей под названием Claude показала наилучшие результаты, около 70 процентов, немного впереди GPT‑4.0 Turbo и заметно опережая несколько открытых и коммерческих конкурентов. Однако одна открытая модель с десятками миллиардов параметров приблизилась к лидерам, что указывает на то, что сильная производительность необязательно ограничена проприетарными системами. При сравнении этих результатов ИИ с распределением оценок человеческих кандидатов лучшие модели оказались в районе середины пула соискателей: не выдающиеся студенты, но примерно на уровне среднего молодого врача, сдающего экзамен.

Изображения по‑прежнему ставят ИИ в тупик

Ситуация изменилась после добавления изображений. Для четырех протестированных мультимодальных моделей точность снизилась при включении визуальных вопросов, часто опускаясь ниже 50 процентов правильных ответов, особенно для задач с преобладанием радиологии. Только наиболее продвинутая модель сохранила почти тот же результат для смешанных текстово‑изображенческих вопросов, что и для чисто текстовых. По предметным областям системы показывали лучшие результаты в общественном здравоохранении и педиатрии, и худшие — в радиологии и других задачах, ориентированных на изображения, что говорит о том, что текущие тренировочные данные и архитектуры моделей в большей степени благоприятствуют письменному материалу, а не медицинским изображениям. Клинические эксперты, участвовавшие в исследовании, не считали, что вопросы с изображениями сами по себе сложнее для людей, но доступные данные не позволяли провести прямое поквопросное сравнение с участием людей, поэтому остается неясным, насколько разрыв в производительности связан непосредственно с визуальным рассуждением, а насколько — с общей сложностью вопросов.

Взгляд внутрь объяснений

Чтобы выйти за рамки простой оценки «правильно/неправильно», команда попросила троих опытных врачей просмотреть объяснения, сгенерированные одной мультимодальной моделью. Они оценивали, правильно ли модель интерпретировала вопрос, согласуется ли её рассуждение с выбранным ответом и могло ли следование её совету навредить пациенту. Для вопросов, на которые модель ответила верно, её объяснения обычно были связными и считались безопасными. Для пропущенных вопросов же вводящие в заблуждение или вымышленные рассуждения — часто называемые галлюцинациями — встречались часто. Врачи иногда расходились во мнениях относительно того, какие объяснения проблематичны, что отражает неясные зоны медицинского суждения, но они больше соглашались, когда ответ ИИ был явно неверным и потенциально небезопасным.

Что это значит для повседневной медицины

В целом исследование показывает, что современные крупные модели ИИ могут приближаться к среднему человеческому уровню на требовательном медицинском экзамене, написанном на бразильском португальском, по крайней мере для текстовых вопросов. Тем не менее они по‑прежнему испытывают трудности с медицинскими изображениями и могут давать уверенные, но ошибочные объяснения, которые в случае некритичного использования могут вводить врачей в заблуждение. Полученные результаты подчеркивают и потенциал, и ограничения современных систем: они могут стать ценными помощниками в португалоязычном здравоохранении, особенно для чтения и суммирования текстов, но пока не готовы заменить обученных врачей или самостоятельно решать сложные мультимодальные диагностические задачи без тщательного надзора и дальнейшего совершенствования.

Цитирование: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Ключевые слова: медицинский ИИ, крупные языковые модели, медицина на португальском, мультимодальная диагностика, медицинское образование