Clear Sky Science · tr

2023 Brezilya Portekizcesi tıp uzmanlık sınavında seçilmiş büyük dil ve çok modlu modellerin sıfır atış performansı

Bu doktorlar ve hastalar için neden önemli

Yapay zeka hızla hastanelere ve kliniklere giriyor, ancak bu sistemlerin çoğu testi İngilizce yapılıyor. Bu çalışma basit ama yüksek riskli bir soruyu yöneltti: günümüzün büyük yapay zeka modelleri, röntgen gibi görüntüler içerenler de dahil olmak üzere Brezilya Portekizcesiyle yazılmış gerçek tıp sınavı sorularını ne kadar iyi çözebiliyor? Bu cevap, doktorların, eğitimcilerin ve politika yapıcıların bu araçların İngilizcenin ana dil olmadığı ülkelerde bakımda yardımcı olmaya hazır olup olmadığını değerlendirmesine yardımcı oluyor.

Yapay zekâyı gerçek bir tıp giriş sınavından geçirmek

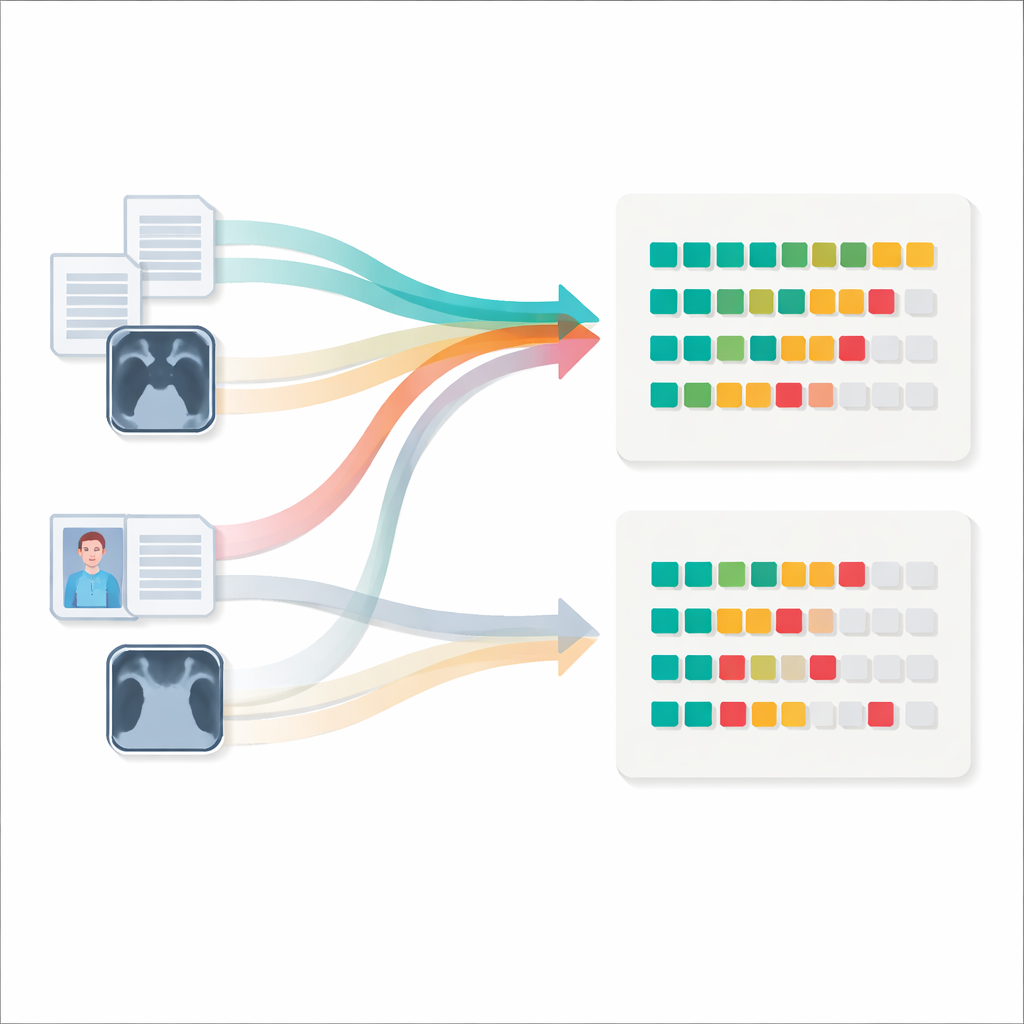

Araştırmacılar, Brezilya’nın önde gelen öğretim hastanelerinden birine ait 2023 tıp uzmanlık giriş sınavını aldılar; bu sınava her yıl binlerce genç doktor giriyor. Sınav iç hastalıkları, cerrahi, pediatri, jinekoloji‑obstetrik ve halk sağlığı konularını kapsayan 117 çoktan seçmeli soru içeriyor. Soruların çoğu yalnızca metin, ancak üçte birinden fazlası radyoloji taramaları, klinik fotoğraflar ve tanısal izlemeler gibi görüntüler içeriyor. Altı metin‑tabanlı yapay zeka modeli ve görüntüleri de görebilen dört çok modlu model, "sıfır atış" koşulunda sınava tabi tutuldu: bu teste özgü önceden örnek veya ince ayar verilmedi, yalnızca bir yanıt seçmeleri ve gerekçelerini açıklamaları için standart talimatlar verildi.

Yazılı sorularda modeller ne kadar akıllıydı?

Sadece metinden oluşan sorularda performans geniş bir yelpazede değişti. En zayıf sistem soruların biraz üzerinde doğru yaparken, en iyi modeller yaklaşık on sorudan yedisine doğru yanıt verdi. Claude adlı bir model ailesi yüzde 70 civarında puanlarla listede başı çekti; bu, GPT‑4.0 Turbo’nun biraz üstünde ve birkaç açık kaynaklı ile ticari rakibin açıkça önündeydi. Bununla birlikte, milyarlarca parametreye sahip bir açık kaynak modeli liderlere yaklaşarak güçlü performansın zorunlu olarak tescilli sistemlerle sınırlı olmadığını ima etti. Araştırmacılar bu yapay zeka skorlarını insan adayların not dağılımlarıyla karşılaştırdıklarında, en iyi modeller başvuru havuzunun ortalarına yakın kümelendi: yıldız öğrenciler değil, sınava giren ortalama yeni bir doktorla kabaca aynı düzeydeydiler.

Görüntüler hâlâ bugünün yapay zekâsını tökezletiyor

Görüntüler eklendiğinde işler değişti. Test edilen dört çok modlu model için, görüntüye dayalı sorular dahil edildiğinde doğruluk düştü; özellikle radyoloji ağırlıklı sorularda genellikle yüzde 50’nin altına indi. Sadece en gelişmiş model, karışık metin ve görüntü sorularında metintekine neredeyse eşit puanı korudu. Alanlar arasında, sistemler en iyi halk sağlığı ve pediatri sorularında, en kötü ise radyoloji ve diğer görüntü odaklı sorularda performans gösterdi; bu da mevcut eğitim verileri ve model tasarımının yazılı materyali tıbbi görsellere tercih ettiğini düşündürüyor. Çalışmaya katılan klinisyenler görüntülü soruların insanlara doğası gereği daha zor gelmediğini düşünürken, mevcut veriler soru‑soru insan karşılaştırmasına izin vermiyordu; bu nedenle performans farkının ne kadarının görüntü akıl yürütmesinden ne kadarının soru zorluğundan kaynaklandığı belirsizliğini koruyor.

Açıklamaların içini incelemek

Doğru‑yanlış puanlamasının ötesine geçmek için ekip, üç deneyimli hekimi bir çok modlu modelin ürettiği açıklamaları gözden geçirmeye davet etti. Doktorlar yapay zekânın soruyu doğru yorumlayıp yorumlamadığını, akıl yürütmesinin seçilen yanıtla uyumlu olup olmadığını ve önerilerine uyulmasının bir hastaya zarar verip vermeyeceğini değerlendirdi. Modelin doğru yanıtladığı sorularda açıklamalar genellikle tutarlı ve güvenli kabul edildi. Ancak modelin kaçırdığı sorularda yanıltıcı veya uydurma akıl yürütme — sıklıkla halüsinasyon denilen — yaygındı. Doktorlar hangi açıklamaların sorunlu olduğu konusunda bazen anlaşmazlığa düştü; bu, tıbbi yargının doğasında olan gri alanları yansıtıyordu. Ancak yapay zekânın cevabı açıkça yanlış ve potansiyel olarak tehlikeliyse doktorlar daha fazla hemfikirdi.

Günlük bakımda yapay zekâ için bunun anlamı

Genel olarak çalışma, günümüzün büyük yapay zeka modellerinin en azından yalnızca metin içeren sorularda Brezilya Portekizcesiyle yazılmış zorlu bir tıp sınavında ortalama insan performansına yaklaşabileceğini gösteriyor. Yine de tıbbi görüntülerle hâlâ zorlanıyorlar ve eleştirel olmayan kullanımda klinisyenleri yanıltabilecek kendinden emin ama hatalı açıklamalar sunabiliyorlar. Bulgular mevcut sistemlerin hem vaatlerini hem de sınırlarını vurguluyor: Özellikle metin okuma ve özetlemede Portekizce konuşan sağlık hizmetlerinde değerli yardımcılar olabilirler, ancak eğitimli doktorların yerini almak veya dikkatli denetim ve sürekli iyileştirme olmadan karmaşık çok modlu tanıyı üstlenmek için hazır değiller.

Atıf: Truyts, C.A.M., Rabelo, A.G., Souza, G.M.d. et al. Zero-shot performance of selected large language and multimodal models on the 2023 Brazilian Portuguese medical residency exam. Sci Rep 16, 11756 (2026). https://doi.org/10.1038/s41598-026-42829-w

Anahtar kelimeler: tıbbi yapay zeka, büyük dil modelleri, Portekizce tıp, çok modlu tanı, tıp eğitimi