Clear Sky Science · zh

作为口腔病理决策支持工具的大型语言模型比较分析

为何口腔医学中的智能聊天机器人重要

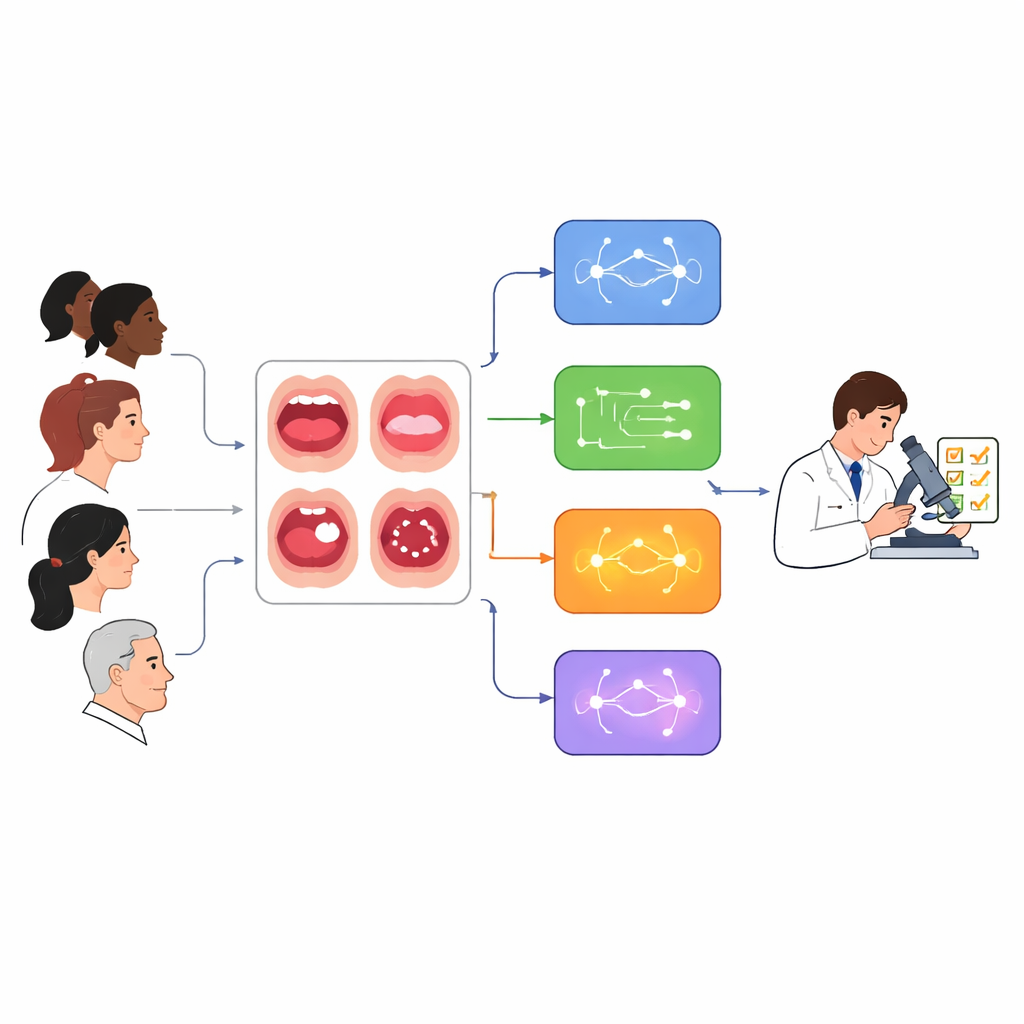

如今大多数人随身携带功能强大的人工智能,以友好的聊天机器人的形式在几秒钟内回答问题。但这些工具能否安全地帮助医生解读那些揭示口腔病灶是良性还是可能发展为严重问题的微小组织变化?本研究正是为此而设,比较了四种广泛使用的聊天机器人,评估它们在根据口腔组织的显微镜描述支持专科医生诊断时的表现。

研究如何检验聊天机器人

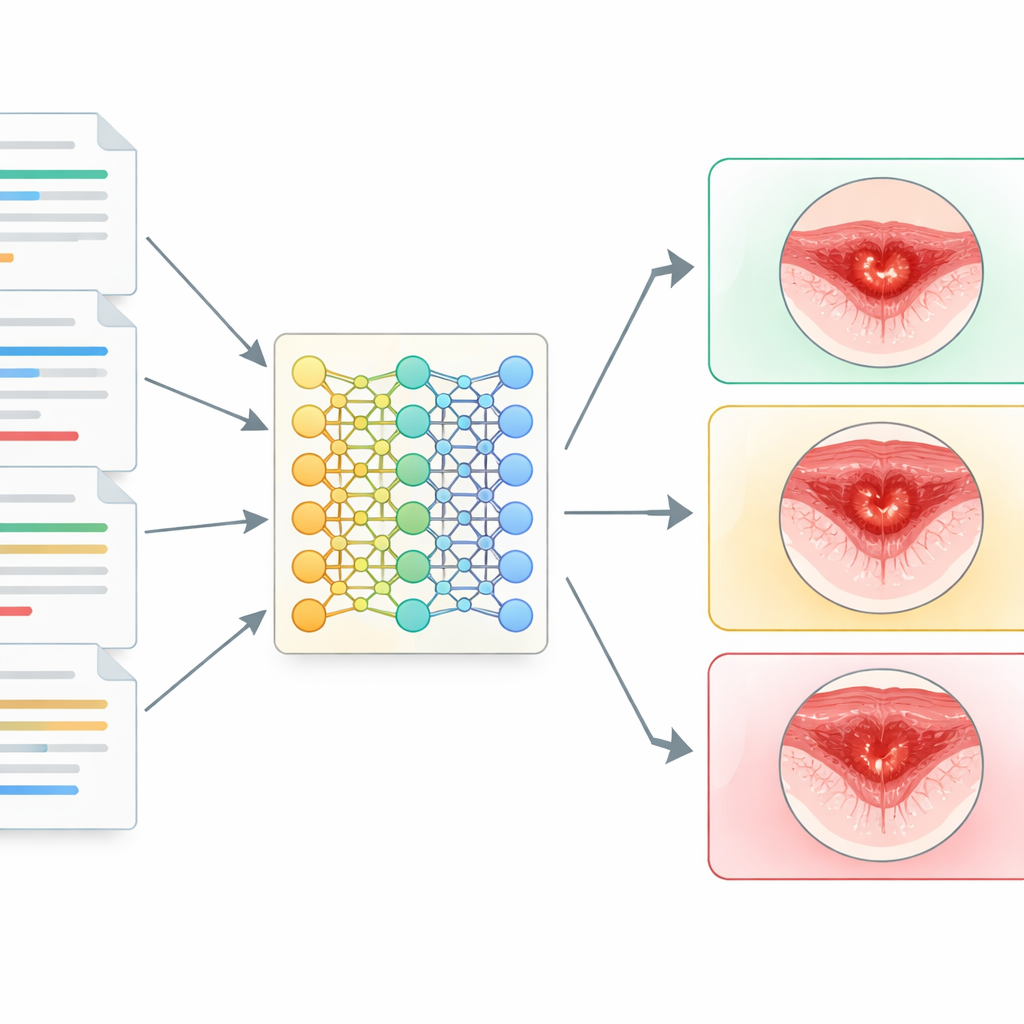

研究人员收集了102份真实世界的报告,描述病理学家在口腔和颌骨活检的显微镜下所见。这些报告涵盖了广泛的问题,从简单的黏液囊肿和纤维瘤到可能致癌的变化,如口腔上皮发育异常和鳞状细胞癌。对每个病例,团队将相同的文字报告以及患者的基本信息(如年龄、性别和病变部位)输入四个聊天机器人:ChatGPT‑4.0、一款侧重推理的ChatGPT o1‑preview、基于LLaMA‑3的Meta AI和谷歌的Gemini。每个机器人被要求给出一个主要诊断和三个可能的备选诊断,模拟临床医生寻求快速第二意见的情形。

将答案与人类专家评分对比

两位经认证的口腔病理学家先独立然后达成共识,将每个聊天机器人的主要建议与医院记录中的原始诊断进行比对。他们把答案分为三类:明显错误;相似或部分正确(例如仅捕捉到组合诊断的一部分或使用不同但临床等效的表述);或完全正确。团队还检查了当聊天机器人未命中主要诊断时,是否仍在其三个备选诊断中列出了正确答案。研究采用标准统计方法比较各系统与人类专家的一致率,并考察结果是否随患者年龄或性别而变化。

哪款聊天机器人最接近专家水平

侧重推理的ChatGPT o1‑preview提供了最可靠的支持:其主要诊断与专家一致的比例约为三分之二(68.6%),Meta AI紧随其后(65.7%)。ChatGPT‑4.0表现中等(59.8%),而Gemini落后,仅在约四分之一的病例中给出正确答案(27.5%)。在更严格的一致性测量下,ChatGPT o1‑preview和Meta AI与口腔病理学家达到了统计学上所谓的“显著”一致,ChatGPT‑4.0达到了“中等”一致,而Gemini显示为“差”。所有聊天机器人在常见且定义清晰的良性问题(如黏液囊肿和纤维瘤)上表现更好,但在更棘手的病变如口腔上皮发育异常或罕见病变上持续表现较差。

机器仍然不足之处

即便允许聊天机器人列出三个备选诊断,它们也常常未能包含正确答案,尤其是Gemini和Meta AI。研究还发现,大多数模型在老年患者中的表现略有下降,可能是因为与年龄相关的组织改变使显微镜下的图像更为复杂。相比之下,模型在男女之间未显示出差异。作者强调了若干应谨慎的原因:商业人工智能的“黑箱”特性、训练数据不明、对罕见疾病的代表性不均以及聊天机器人仅见到文本描述而未看到病理学家常用的显微镜图像等。

这对未来护理意味着什么

对普通读者而言,关键的信息是:现有的对话式人工智能有时能反映口腔病理学专家的判断,但远不足以独立承担诊断责任。表现最好的聊天机器人大约在三分之二的病例中与专家相当,并且在错误代价最高的情形——罕见或早期疾病——表现更差。作者得出结论:目前这些工具应仅作为辅助工具,用于支持教育、减轻工作负担并提供初步复核,而绝不可取代受过训练的病理学家。通过更好的数据、更清晰的监管和谨慎的测试,这类系统未来可能成为更安全的诊断伙伴,但目前仍须倚重人的专业判断。

引用: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

关键词: 口腔病理, 人工智能, 临床决策支持, 大型语言模型, 数字牙科