Clear Sky Science · ru

Сравнительный анализ больших языковых моделей как инструментов поддержки принятия решений в оральной патологии

Почему умные чат‑боты важны в стоматологической медицине

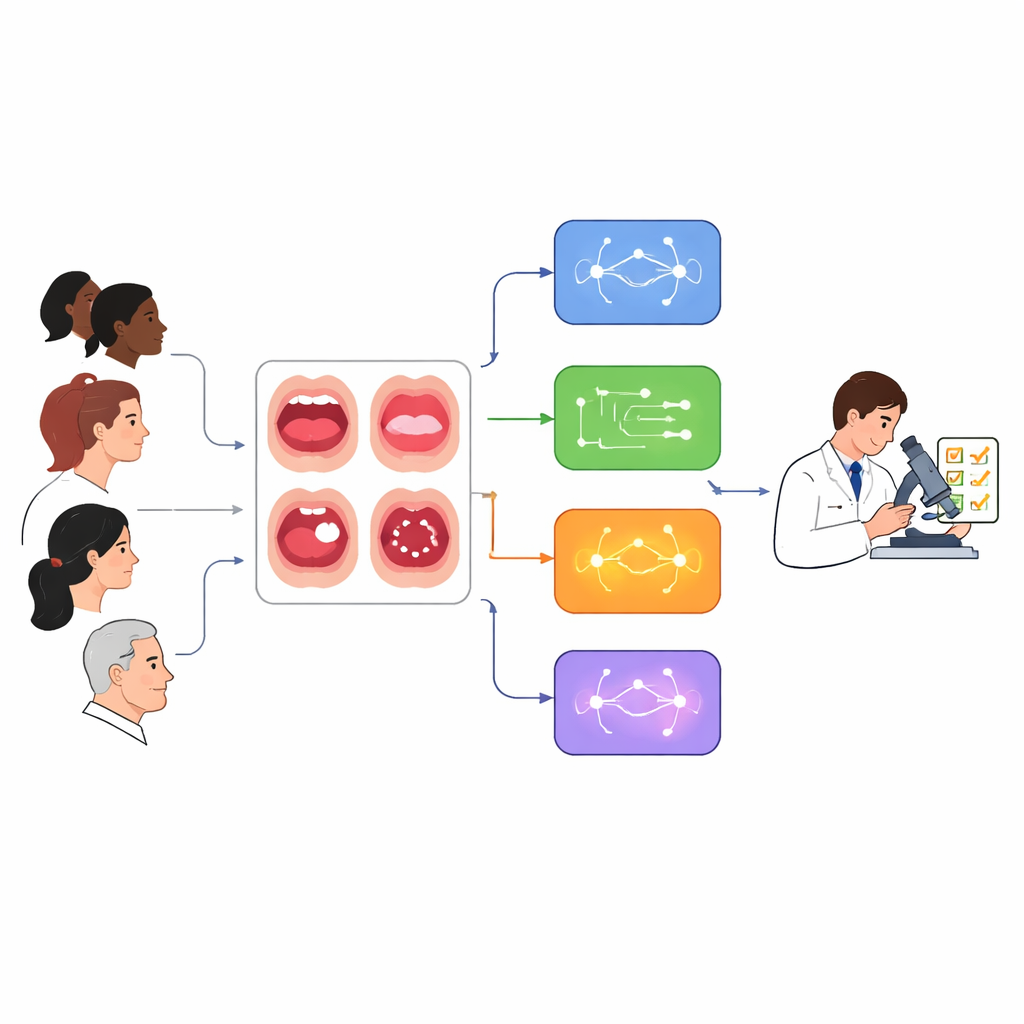

Сегодня у большинства людей в кармане есть мощный искусственный интеллект в виде дружелюбных чат‑ботов, которые отвечают на вопросы за секунды. Но могут ли эти инструменты безопасно помогать врачам интерпретировать тонкие изменения тканей, которые показывают, является ли образование в полости рта безвредным или это начало чего‑то серьёзного? В этом исследовании задают именно такой вопрос, сравнивая четыре широко используемых чат‑бота, чтобы выяснить, насколько хорошо они поддерживают специалистов, диагностирующих заболевания по описаниям под микроскопом оральных тканей.

Как исследование испытывало чат‑ботов

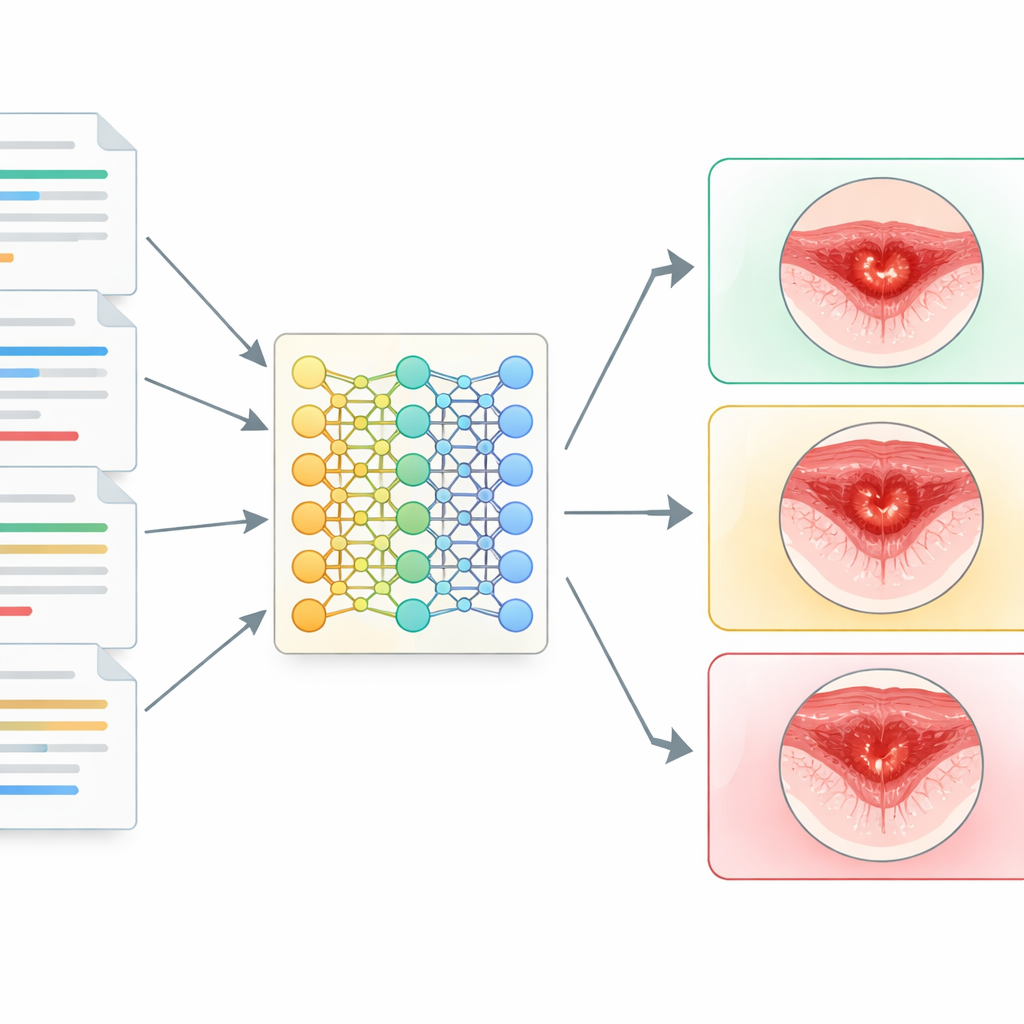

Исследователи собрали 102 реальных отчёта с описанием того, что патологи видели под микроскопом в биоптатах полости рта и челюстей. Эти отчёты охватывали широкий спектр проблем — от простых скоплений слизи и фибром до потенциально злокачественных изменений, таких как дисплазия эпителия полости рта и плоскоклеточный рак. Для каждого случая команда вводила в четыре чат‑бота одинаковый текст отчёта и базовые данные пациента (возраст, пол, локализация поражения): ChatGPT‑4.0, ориентированный на рассуждение ChatGPT o1‑preview, Meta AI на базе LLaMA‑3 и Gemini от Google. Каждому боту просили назвать один основной диагноз и три возможных альтернативы, имитируя ситуацию, когда клиницист ищет быстрое второе мнение.

Оценка ответов по сравнению с экспертами‑людьми

Два сертифицированных врача‑оральных патолога независимо друг от друга, а затем в консенсусе, сравнивали основное предположение каждого чат‑бота с исходным диагнозом в больничной документации. Они распределяли ответы по трём категориям: явно неверно; схоже или частично верно (например, указана только часть комбинированного диагноза или использована иная, но клинически эквивалентная формулировка); или полностью верно. Команда также проверяла, мог ли чат‑бот, пропустив основной диагноз, всё же перечислить правильный вариант среди трёх альтернатив. С помощью стандартных статистических методов сравнивали, как часто каждая система совпадала с экспертами, и изучали, менялись ли результаты в зависимости от возраста или пола пациента.

Какой чат‑бот подошёл ближе всего к специалистам

Лучшей по надёжности поддержки оказался ориентированный на рассуждение ChatGPT o1‑preview: его основной диагноз совпадал с экспертами примерно в двух случаях из трёх (68,6 %), Meta AI шла почти вровень (65,7 %). ChatGPT‑4.0 показал средние результаты (59,8 %), тогда как Gemini отставал — правильные ответы в примерно каждой четвёртой ситуации (27,5 %). При более строгой оценке согласованности ChatGPT o1‑preview и Meta AI достигали того, что статистики называют «существенной» согласованностью с оральными патологами, ChatGPT‑4.0 демонстрировал «умеренную» согласованность, а Gemini — «плохую». Все чат‑боты лучше справлялись с распространёнными, чётко определёнными доброкачественными проблемами, такими как мукоцеле и фибромы, и стабильно испытывали трудности со сложными состояниями — например, дисплазией эпителия полости рта или редкими опухолями.

Где машины всё ещё уступают

Даже когда чат‑ботам давали список из трёх альтернативных диагнозов, они часто не включали правильный вариант, особенно Gemini и Meta AI. Исследование также показало, что у большинства моделей точность слегка снижалась у пожилых пациентов, возможно, потому что возраст‑связанные изменения тканей усложняют микроскопическую картину. При этом ни одна система не показала различий в зависимости от пола пациента. Авторы подчёркивают несколько причин для осторожности: «чёрный ящик» коммерческих ИИ, неизвестные тренировочные данные, неравномерное представление редких заболеваний и то, что чат‑боты видели только текстовые описания без микроскопических изображений, которыми обычно пользуются человеческие патологи.

Что это значит для будущей медицины

Для непрофессионального читателя главный вывод таков: современные разговорные ИИ иногда могут воспроизводить мнение эксперта в оральной патологии, но они далеки от того, чтобы быть достаточно надёжными в одиночку. Лучший из протестированных чат‑ботов примерно в двух случаях из трёх совпадал с экспертами и давал худшие результаты именно в тех ситуациях, где ошибка особенно критична — при необычных или ранних стадиях болезни. Авторы заключают, что на текущем этапе эти инструменты следует использовать лишь как вспомогательные: для обучения, уменьшения нагрузки и быстрой вторичной оценки, но ни в коем случае не как замену обученным патологам. При наличии лучших данных, чёткого регулирования и тщательной проверки такие системы могут со временем стать безопасными помощниками в диагностике, но пока человеческая экспертиза остаётся решающей.

Цитирование: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Ключевые слова: оральная патология, искусственный интеллект, клиническая поддержка принятия решений, большие языковые модели, цифровая стоматология