Clear Sky Science · de

Vergleichende Analyse großer Sprachmodelle als Entscheidungsunterstützung in der oralen Pathologie

Warum intelligente Chatbots in der Mundmedizin wichtig sind

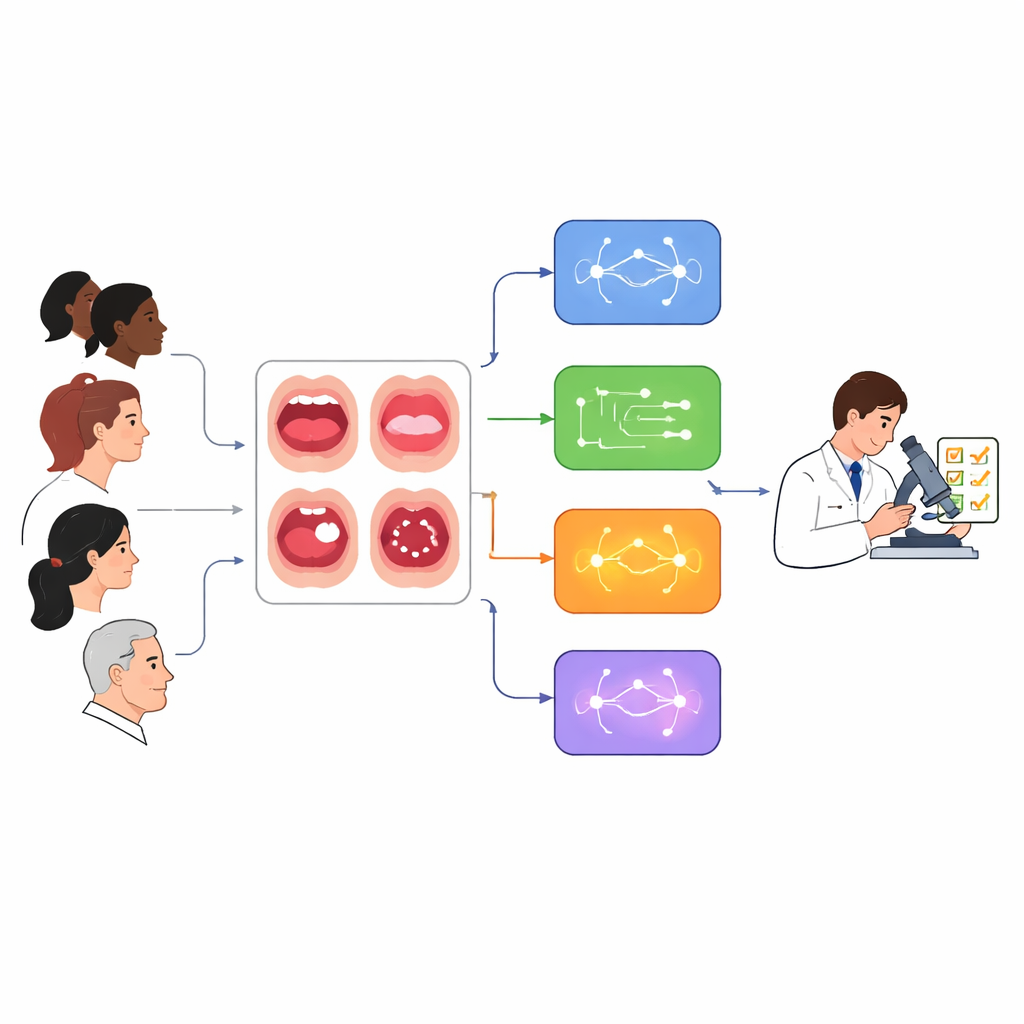

Die meisten Menschen tragen heute leistungsfähige künstliche Intelligenz in der Tasche, verpackt als freundliche Chatbots, die Fragen in Sekunden beantworten. Aber können diese Werkzeuge Ärzten sicher dabei helfen, die winzigen Gewebeveränderungen zu interpretieren, die verraten, ob eine Stelle im Mund harmlos ist oder der Beginn von etwas Ernsthaftem? Diese Studie geht genau dieser Frage nach und vergleicht vier weit verbreitete Chatbots, um zu prüfen, wie gut sie Fachleute unterstützen, die Krankheiten anhand mikroskopischer Beschreibungen oraler Gewebe diagnostizieren.

Wie die Studie die Chatbots testete

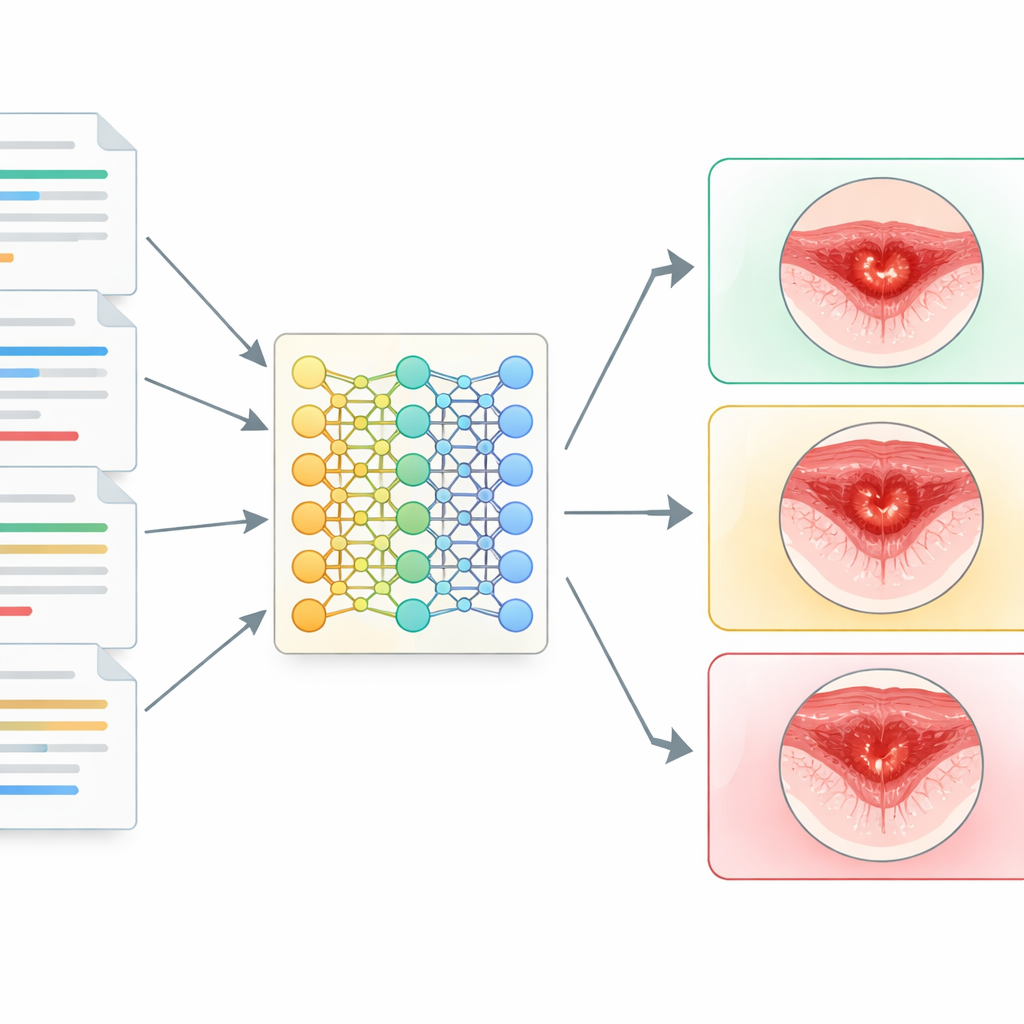

Die Forschenden sammelten 102 Berichte aus der Praxis, in denen beschrieben wurde, was Pathologen unter dem Mikroskop in Biopsien von Mund und Kiefer sahen. Diese Berichte deckten ein breites Spektrum ab, von einfachen schleimgefüllten Schwellungen und Fibromen bis hin zu potenziell krebsvorläuflichen Veränderungen wie oraler epithelialer Dysplasie und manifestem Plattenepithelkarzinom. Für jeden Fall fütterte das Team denselben Textbericht sowie grundlegende Patientendaten wie Alter, Geschlecht und Lokalisation der Läsion in vier Chatbots: ChatGPT-4.0, ein auf Schlussfolgern fokussiertes ChatGPT o1-preview, Meta AI basierend auf LLaMA-3 und Googles Gemini. Jeder Chatbot wurde um eine Hauptdiagnose und drei mögliche Alternativen gebeten, ähnlich wie ein Kliniker, der eine schnelle Zweitmeinung einholt.

Bewertung der Antworten gegen menschliche Expert:innen

Zwei zertifizierte orale Patholog:innen verglichen unabhängig und anschließend im Konsens die Hauptvorschläge der Chatbots mit der ursprünglichen Diagnose aus der Krankenakte. Sie ordneten die Antworten in drei Gruppen ein: klar falsch; ähnlich oder teilweise richtig (beispielsweise nur einen Teil einer kombinierten Diagnose erkennend oder andere, aber klinisch gleichwertige Formulierungen verwendend); oder vollständig korrekt. Das Team prüfte außerdem, ob ein Chatbot, der die Hauptdiagnose verfehlte, die richtige Antwort dennoch unter seinen drei Alternativen aufführte. Mithilfe standardmäßiger statistischer Methoden verglichen sie, wie oft jedes System mit den menschlichen Expert:innen übereinstimmte und untersuchten, ob sich die Ergebnisse mit dem Alter oder Geschlecht der Patient:innen veränderten.

Welcher Chatbot den Spezialist:innen am nächsten kam

Der auf Schlussfolgern ausgerichtete ChatGPT o1-preview lieferte die zuverlässigste Unterstützung: Seine Hauptdiagnose stimmte in etwa zwei von drei Fällen mit den Expert:innen überein (68,6 Prozent), dicht gefolgt von Meta AI (65,7 Prozent). ChatGPT-4.0 schnitt moderat ab (59,8 Prozent), während Gemini mit korrekten Antworten in nur etwa einem Viertel der Fälle zurückblieb (27,5 Prozent). Gemessen an strengeren Kriterien erreichten ChatGPT o1-preview und Meta AI das, was Statistikern als „substantielle“ Übereinstimmung mit oralen Patholog:innen gilt, ChatGPT-4.0 erzielte eine „moderate“ Übereinstimmung, und Gemini zeigte eine „schwache“ Übereinstimmung. Alle Chatbots waren bei häufigen, klar definierten gutartigen Problemen wie Mukozele und Fibrom besser und hatten durchgehend Schwierigkeiten mit komplizierteren Zuständen wie oraler epithelialer Dysplasie oder seltenen Läsionen.

Wo die Maschinen noch nachlassen

Selbst wenn den Chatbots eine Liste mit drei alternativen Diagnosen erlaubt wurde, gelang es ihnen oft nicht, die korrekte zu nennen — besonders Gemini und Meta AI. Die Studie zeigte außerdem, dass die Leistung der meisten Modelle bei älteren Patient:innen leicht abnahm, möglicherweise weil altersbedingte Gewebeveränderungen das mikroskopische Bild komplexer machen. Demgegenüber zeigten keine der Systemvarianten Unterschiede zwischen Männern und Frauen. Die Autor:innen heben mehrere Gründe für Vorsicht hervor: die „Black-Box“-Natur kommerzieller KI, unbekannte Trainingsdaten, ungleichmäßige Repräsentation seltener Krankheiten und die Tatsache, dass die Chatbots nur Textbeschreibungen sahen, ohne die Mikroskopbilder, die menschliche Patholog:innen routinemäßig nutzen.

Was das für die zukünftige Versorgung bedeutet

Für interessierte Laien ist die Kernbotschaft: Die heutigen konversationellen AIs können gelegentlich fachliche Urteile in der oralen Pathologie wiedergeben, sind aber bei Weitem nicht zuverlässig genug, um eigenständig zu arbeiten. Der bestplatzierte Chatbot lag ungefähr in zwei von drei Fällen auf Linie mit Spezialist:innen und schnitt in genau jenen Situationen schlechter ab, in denen Fehler besonders gravierend wären — bei ungewöhnlichen oder frühen Krankheitsstadien. Die Autor:innen kommen zu dem Schluss, dass diese Werkzeuge derzeit nur als Hilfsmittel dienen sollten, die Ausbildung unterstützen, Arbeitslast reduzieren und einen groben zweiten Blick bieten können, niemals jedoch ausgebildete Patholog:innen ersetzen. Mit besseren Daten, klarerer Aufsicht und sorgfältigen Tests könnten solche Systeme eines Tages sicherere Partner in der Diagnostik werden, aber vorerst bleibt menschliche Expertise unverzichtbar.

Zitation: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Schlüsselwörter: orale Pathologie, künstliche Intelligenz, klinische Entscheidungsunterstützung, große Sprachmodelle, digitale Zahnmedizin