Clear Sky Science · sv

Jämförande analys av stora språkmodeller som beslutsstöd inom oral patologi

Varför smarta chattbotar inom munmedicin spelar roll

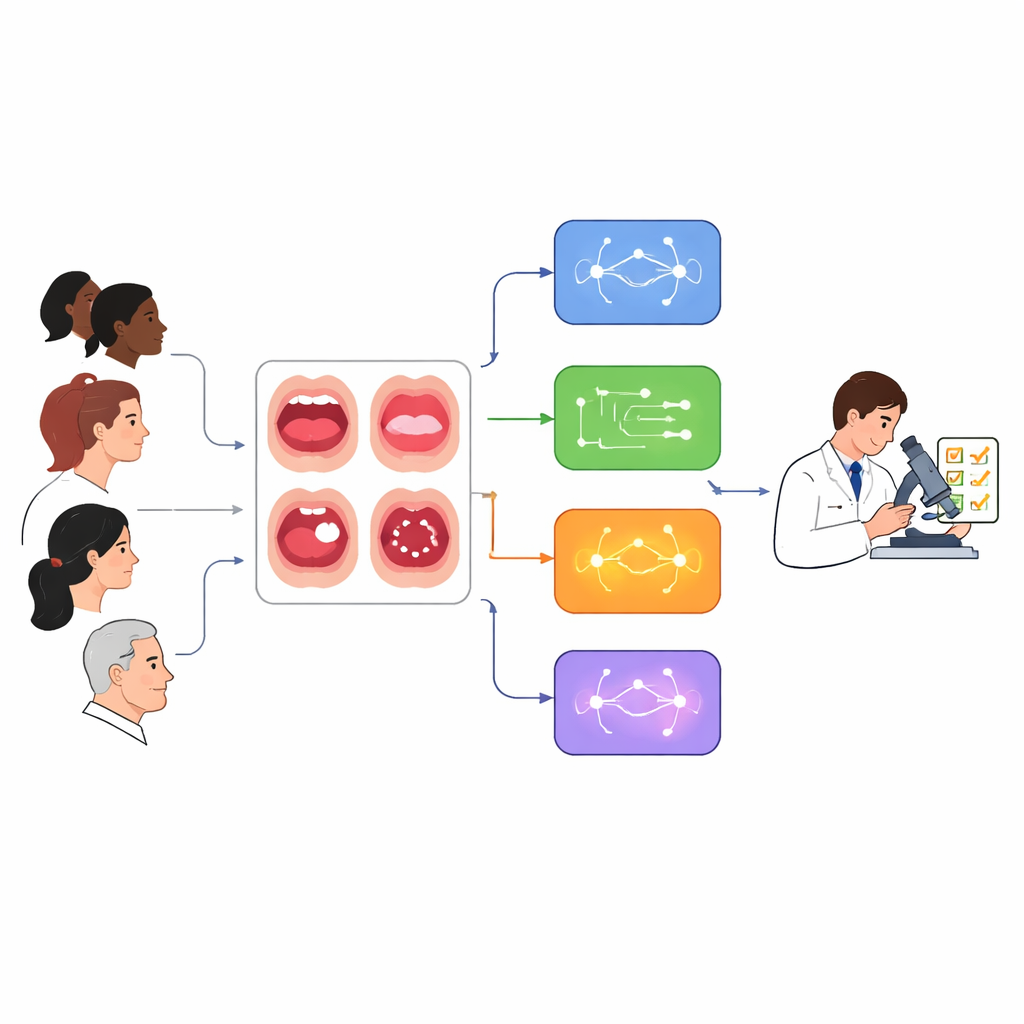

De flesta människor bär idag kraftfull artificiell intelligens i fickan, förpackad som vänliga chattbotar som svarar på frågor på sekunder. Men kan dessa verktyg säkert hjälpa läkare att tolka de små vävnadsförändringar som avslöjar om en fläck i munnen är ofarlig eller början på något allvarligt? Denna studie ställer just den frågan och jämför fyra vida använda chattbotar för att se hur väl de stödjer specialister som ställer diagnoser utifrån mikroskopiska beskrivningar av orala vävnader.

Så testade studien chattbotarna

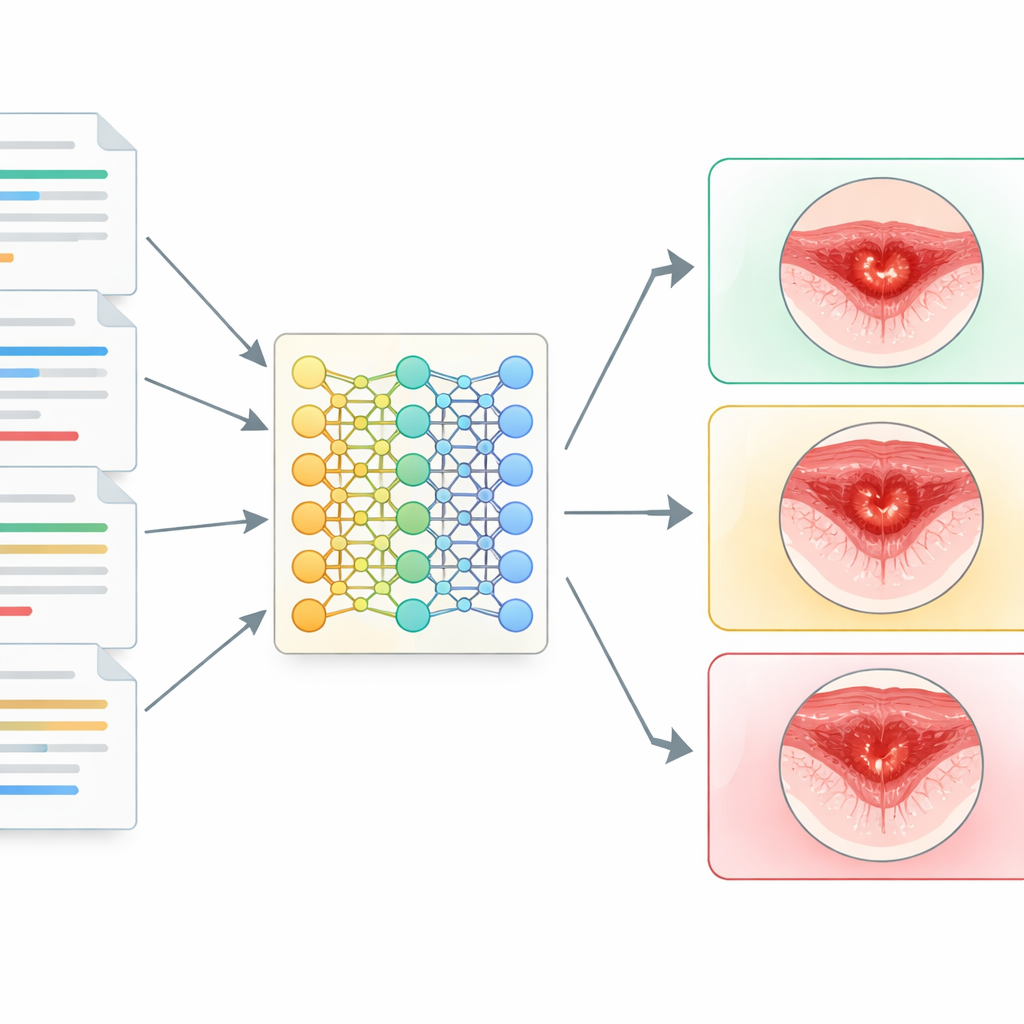

Forskarna samlade 102 verkliga rapporter som beskriver vad patologer såg i mikroskopet i biopsier från mun och käkar. Rapporterna täckte ett brett spektrum av problem, från enkla slemfyllda svullnader och fibrom till potentiellt cancerösa förändringar såsom oral epitelial dysplasi och fullt utvecklad skivepitelkarcinom. För varje fall matade teamet in samma textrapport, plus grundläggande patientuppgifter som ålder, kön och lesionens placering, i fyra chattbotar: ChatGPT-4.0, en resonemangsfokuserad ChatGPT o1-preview, Meta AI baserad på LLaMA-3 och Googles Gemini. Varje chattbot ombads ange en huvuddiagnos och tre möjliga alternativ, i likhet med hur en kliniker kan söka en snabb second opinion.

Poängsättning av svar mot mänskliga experter

Två certifierade orala patologer arbetade självständigt och sedan i konsensus för att jämföra varje chattbots huvudsakliga förslag med den ursprungliga diagnosen i sjukhusjournalen. De sorterade svaren i tre grupper: klart felaktiga; liknande eller delvis korrekta (till exempel att fånga endast en del av en kombinerad diagnos eller använda annan men kliniskt ekvivalent terminologi); eller helt korrekta. Teamet kontrollerade också om en chattbot som missade huvuddiagnosen ändå kunde lista rätt svar bland sina tre alternativ. Med vanliga statistiska metoder jämförde de hur ofta varje system överensstämde med de mänskliga experterna och undersökte om resultaten förändrades med patientens ålder eller kön.

Vilken chattbot kom närmast specialisterna

Den resonemangsfokuserade ChatGPT o1-preview gav det mest tillförlitliga stödet: dess huvuddiagnos matchade experterna i ungefär två av tre fall (68,6 procent), med Meta AI tätt bakom (65,7 procent). ChatGPT-4.0 presterade måttligt bra (59,8 procent), medan Gemini kom på efterkälken med korrekta svar i bara omkring en fjärdedel av fallen (27,5 procent). När överenskommelsen mättes striktare uppnådde ChatGPT o1-preview och Meta AI vad statistiker kallar ”substantiell” överensstämmelse med orala patologer, ChatGPT-4.0 nådde ”måttlig” överensstämmelse, och Gemini visade ”dålig” överensstämmelse. Alla chattbotar presterade bättre på vanliga, klart definierade benigna problem som mucoceler och fibrom, och hade konsekvent svårare med mer komplicerade tillstånd såsom oral epitelial dysplasi eller sällsynta lesioner.

Var maskinerna fortfarande brast

Även när chattbotarna tilläts lista tre alternativa diagnoser misslyckades de ofta med att inkludera den korrekta, särskilt Gemini och Meta AI. Studien fann också att prestandan för de flesta modeller sjönk något hos äldre patienter, möjligen eftersom åldersrelaterade vävnadsförändringar gör det mikroskopiska bilden mer komplex. Däremot visade inget av systemen skillnader mellan män och kvinnor. Författarna framhäver flera skäl till försiktighet: den kommersiella AI:ns ”svarta låda”-karaktär, okända träningsdata, ojämn representation av sällsynta sjukdomar och att chattbotarna endast såg textbeskrivningar utan de mikroskopbilder som mänskliga patologer rutinmässigt använder.

Vad detta betyder för framtida vård

För lekman är huvudbudskapet att dagens konversationella AI ibland kan återspegla experternas bedömning inom oral patologi, men att de är långt ifrån tillförlitliga nog att fungera självständigt. Den bäst presterande chattboten matchade ungefär specialisterna i två fall av tre och presterade sämre i de situationer där fel har störst konsekvenser — ovanliga eller tidiga sjukdomsfall. Författarna drar slutsatsen att dessa verktyg i nuläget bör användas endast som hjälpmedel som kan stödja utbildning, minska arbetsbördan och erbjuda en grov andra bedömning, aldrig som ersättare för utbildade patologer. Med bättre data, tydligare tillsyn och noggrann testning kan sådana system en dag bli säkrare partners i diagnostik, men för nu förblir mänsklig expertis avgörande.

Citering: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Nyckelord: oral patologi, artificiell intelligens, kliniskt beslutsstöd, stora språkmodeller, digital tandvård