Clear Sky Science · pl

Analiza porównawcza dużych modeli językowych jako narzędzi wspomagania decyzji w patologii jamy ustnej

Dlaczego inteligentne chatboty w medycynie jamy ustnej są ważne

Większość osób nosi dziś w kieszeni potężną sztuczną inteligencję w formie przyjaznych chatbotów, które odpowiadają na pytania w kilka sekund. Czy jednak narzędzia te mogą bezpiecznie pomagać lekarzom w interpretacji drobnych zmian tkankowych, które wskazują, czy zmiana w jamie ustnej jest niegroźna, czy może początek czegoś poważnego? To badanie bada właśnie to zagadnienie, porównując cztery szeroko stosowane chatboty, by sprawdzić, jak dobrze wspierają specjalistów diagnozujących choroby na podstawie opisów mikroskopowych tkanek jamy ustnej.

Jak badanie wystawiło chatboty na próbę

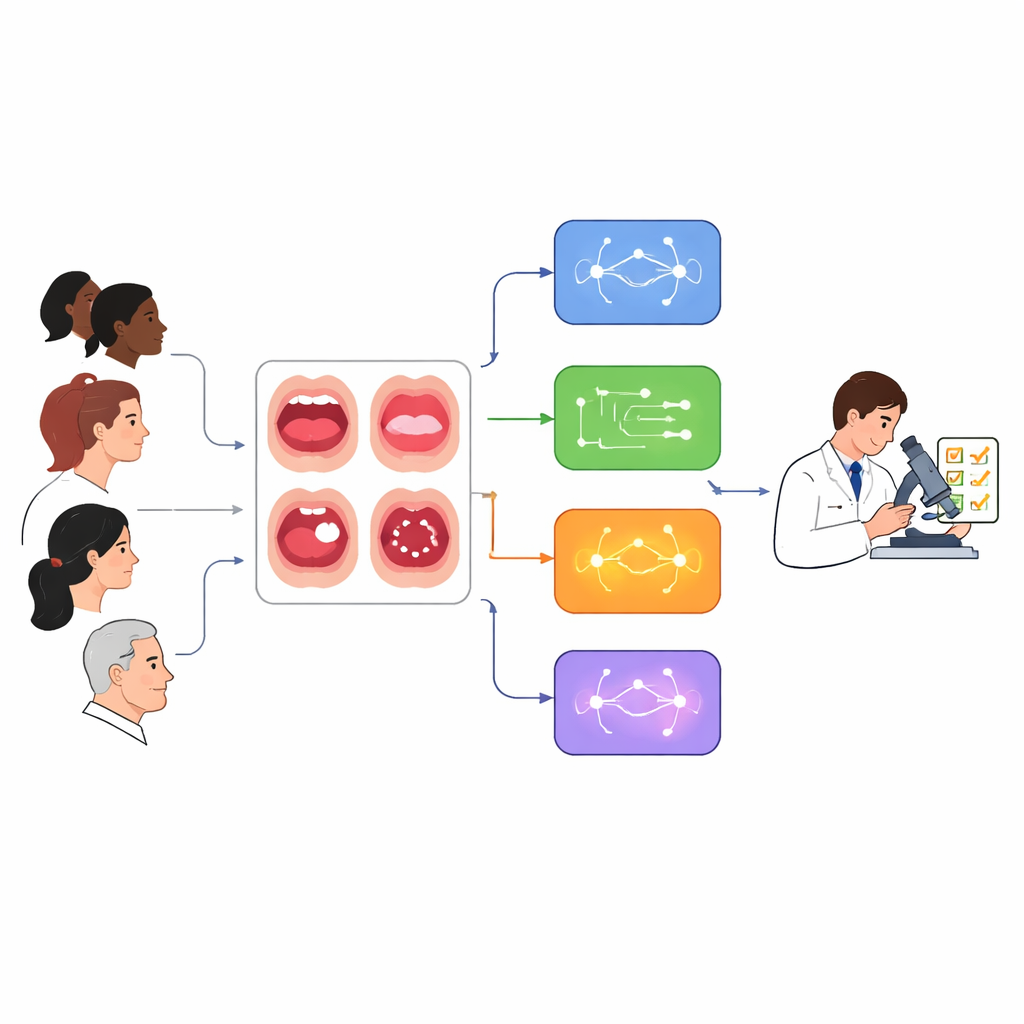

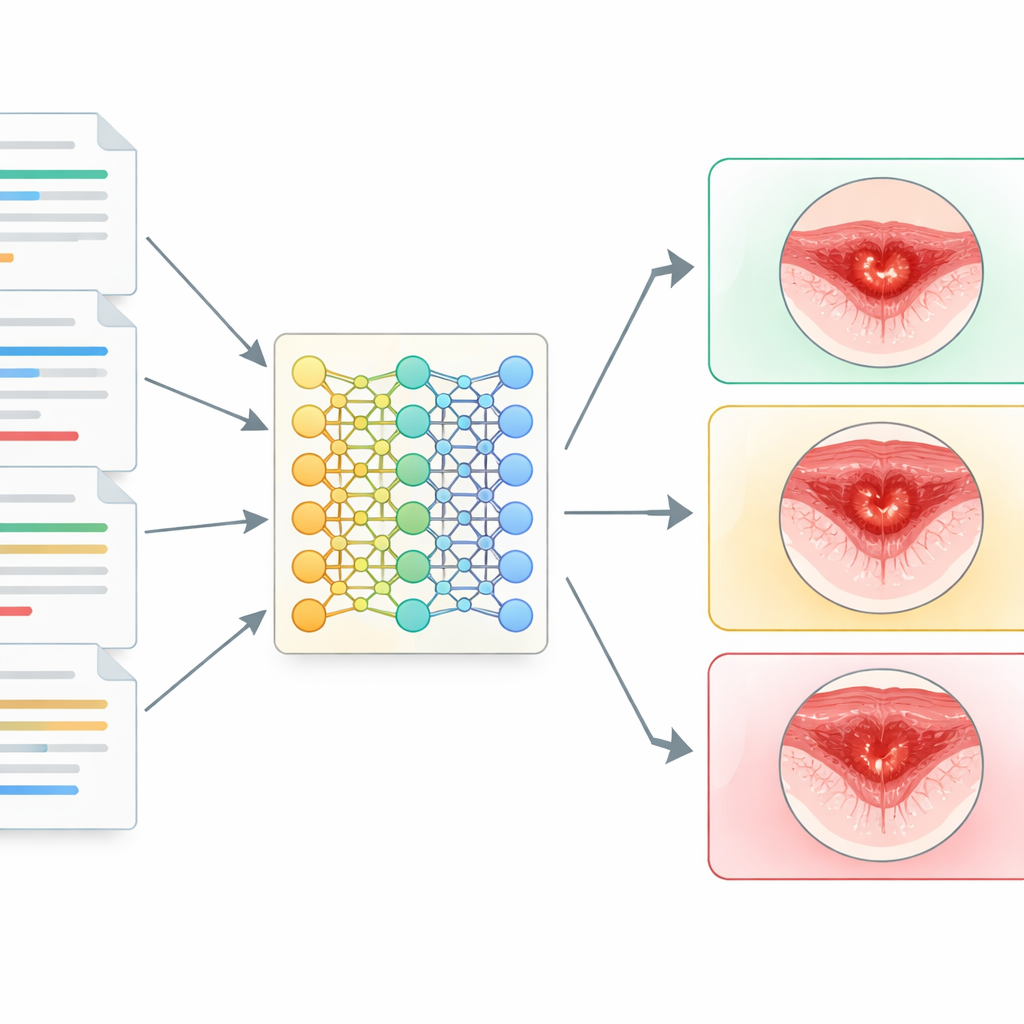

Naukowcy zgromadzili 102 raporty z praktyki klinicznej opisujące to, co patolodzy obserwowali pod mikroskopem w wycinkach z jamy ustnej i szczęk. Raporty obejmowały szerokie spektrum zmian, od prostych torbieli śluzowych i włókniaków po potencjalnie złośliwe przemiany, takie jak dysplazja nabłonka jamy ustnej czy inwazyjny rak płaskonabłonkowy. Dla każdego przypadku zespół wprowadził ten sam tekst raportu oraz podstawowe dane pacjenta, takie jak wiek, płeć i lokalizacja zmiany, do czterech chatbotów: ChatGPT-4.0, skupionego na rozumowaniu ChatGPT o1-preview, Meta AI opartego na LLaMA-3 oraz Google’a Gemini. Każdy chatbot poproszono o wskazanie jednej głównej diagnozy i trzech możliwych alternatyw, naśladując sposób, w jaki klinicysta mógłby zasięgnąć szybkiej drugiej opinii.

Ocenianie odpowiedzi względem ekspertów

Dwóch certyfikowanych patologów jamy ustnej, pracujących najpierw niezależnie, a potem wspólnie osiągając konsensus, porównało każdą główną sugestię chatbota z pierwotną diagnozą w dokumentacji szpitalnej. Odpowiedzi sklasyfikowano w trzech grupach: wyraźnie błędne; podobne lub częściowo poprawne (na przykład obejmujące tylko część złożonej diagnozy lub używające innego, klinicznie równoważnego sformułowania); lub w pełni poprawne. Zespół sprawdził także, czy chatbot, który nie trafił główną diagnozą, mógłby wymienić prawidłową odpowiedź wśród trzech alternatyw. Przy użyciu standardowych metod statystycznych porównano, jak często każdy system zgadzał się z ekspertami oraz czy wyniki zmieniały się w zależności od wieku lub płci pacjenta.

Który chatbot zbliżył się najbardziej do specjalistów

Najbardziej wiarygodne wsparcie zapewnił model skupiony na rozumowaniu, ChatGPT o1-preview: jego główna diagnoza zgadzała się z oceną ekspertów w około dwóch przypadkach na trzy (68,6 procent), a Meta AI była nieznacznie gorsza (65,7 procent). ChatGPT-4.0 wypadał umiarkowanie dobrze (59,8 procent), natomiast Gemini pozostawał w tyle, trafiając jedynie w około jednej czwartej przypadków (27,5 procent). Przy surowszej interpretacji zgodności ChatGPT o1-preview i Meta AI osiągnęły to, co statystycy nazywają „znaczną” zgodnością z patologami jamy ustnej, ChatGPT-4.0 uzyskał „umiarkowaną” zgodność, a Gemini wykazał „słabą” zgodność. Wszystkie chatboty radziły sobie lepiej z powszechnymi, wyraźnie zdefiniowanymi zmianami łagodnymi, takimi jak torbiele śluzowe i włókniaki, i systematycznie miały trudności z bardziej złożonymi jednostkami, takimi jak dysplazja nabłonka jamy ustnej czy rzadkie zmiany.

Gdzie maszyny nadal zawodzą

Nawet gdy chatbotom pozwolono podać listę trzech alternatywnych diagnoz, często nie zawierały one poprawnej odpowiedzi, szczególnie w przypadku Gemini i Meta AI. Badanie wykazało także, że w większości modeli wydajność nieco spadała u starszych pacjentów, prawdopodobnie dlatego, że zmiany związane z wiekiem komplikują obraz mikroskopowy. Natomiast żaden z systemów nie wykazał różnic między mężczyznami a kobietami. Autorzy podkreślają kilka przesłanek do ostrożności: „czarna skrzynka” komercyjnej SI, nieznane dane treningowe, nierównomierna reprezentacja rzadkich chorób oraz fakt, że chatboty otrzymywały jedynie opisy tekstowe, bez obrazów mikroskopowych, które patolodzy rutynowo wykorzystują.

Co to oznacza dla przyszłej opieki

Dla czytelników niebędących specjalistami kluczowym przesłaniem jest to, że współczesne konwersacyjne SI czasem potrafią odzwierciedlić opinię eksperta w patologii jamy ustnej, ale daleko im do niezawodności umożliwiającej samodzielne działanie. Najlepszy model zbliżał się do ekspertyzy specjalistów w dwóch przypadkach na trzy i radził sobie gorzej w tych sytuacjach, gdzie błędy mają największe znaczenie — przy nietypowych lub wczesnych stadiach choroby. Autorzy wnioskują, że obecnie narzędzia te powinny służyć jedynie jako pomocnicy wspierający edukację, zmniejszający obciążenie pracą i oferujący przybliżoną drugą opinię, nigdy jako zastępstwo wykwalifikowanych patologów. Przy lepszych danych, wyraźniejszym nadzorze i starannych testach takie systemy mogłyby kiedyś stać się bezpieczniejszymi partnerami w diagnostyce, lecz na razie niezbędna pozostaje ludzka ekspertyza.

Cytowanie: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Słowa kluczowe: patologia jamy ustnej, sztuczna inteligencja, wspomaganie decyzji klinicznych, duże modele językowe, cyfrowa stomatologia