Clear Sky Science · it

Analisi comparativa dei grandi modelli linguistici come strumenti di supporto decisionale in patologia orale

Perché i chatbot intelligenti in medicina orale sono importanti

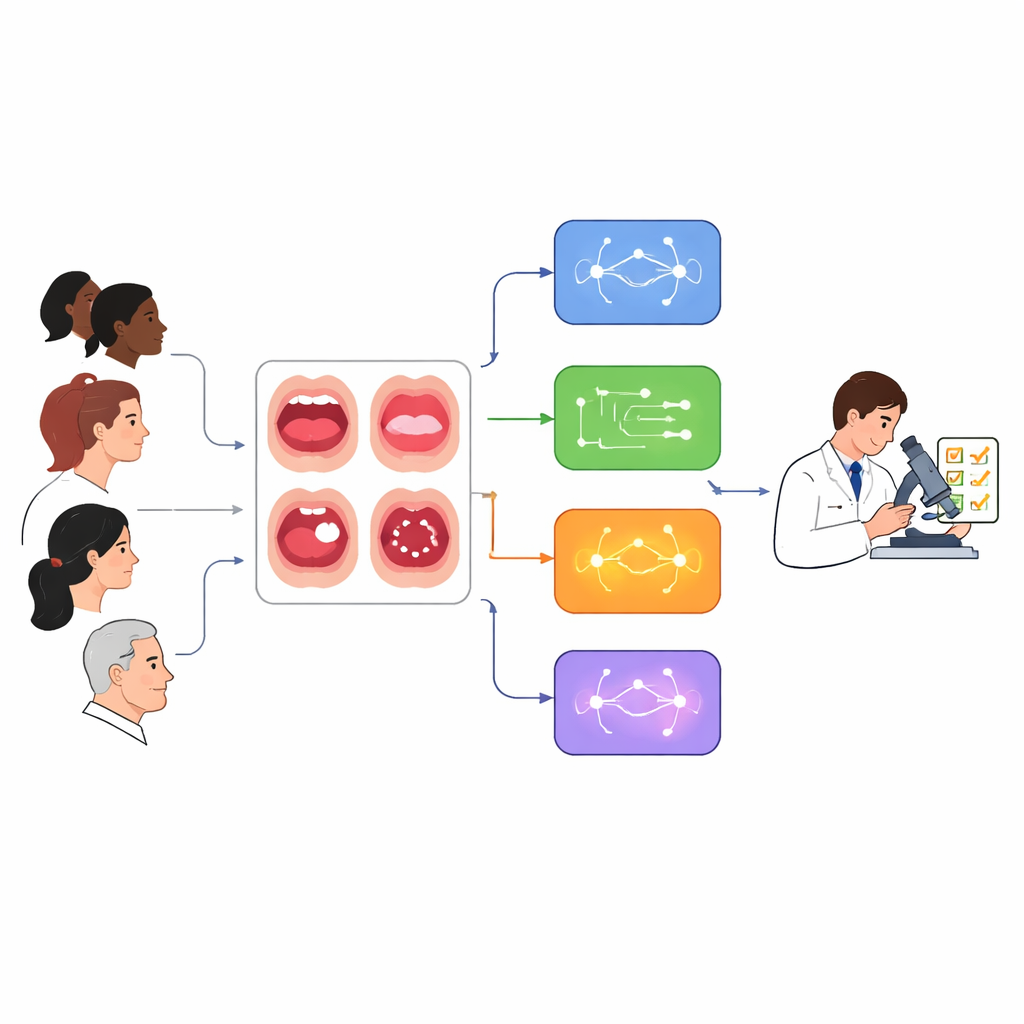

La maggior parte delle persone porta oggi in tasca potenti sistemi di intelligenza artificiale, confezionati come chatbot amichevoli capaci di rispondere in pochi secondi. Ma questi strumenti possono aiutare in modo sicuro i medici a interpretare le piccole alterazioni tissutali che rivelano se una lesione in bocca è innocua o l’inizio di qualcosa di grave? Questo studio pone esattamente questa domanda, confrontando quattro chatbot ampiamente usati per valutare quanto bene supportino gli specialisti che diagnosticano malattie a partire da descrizioni microscopiche dei tessuti orali.

Come lo studio ha messo alla prova i chatbot

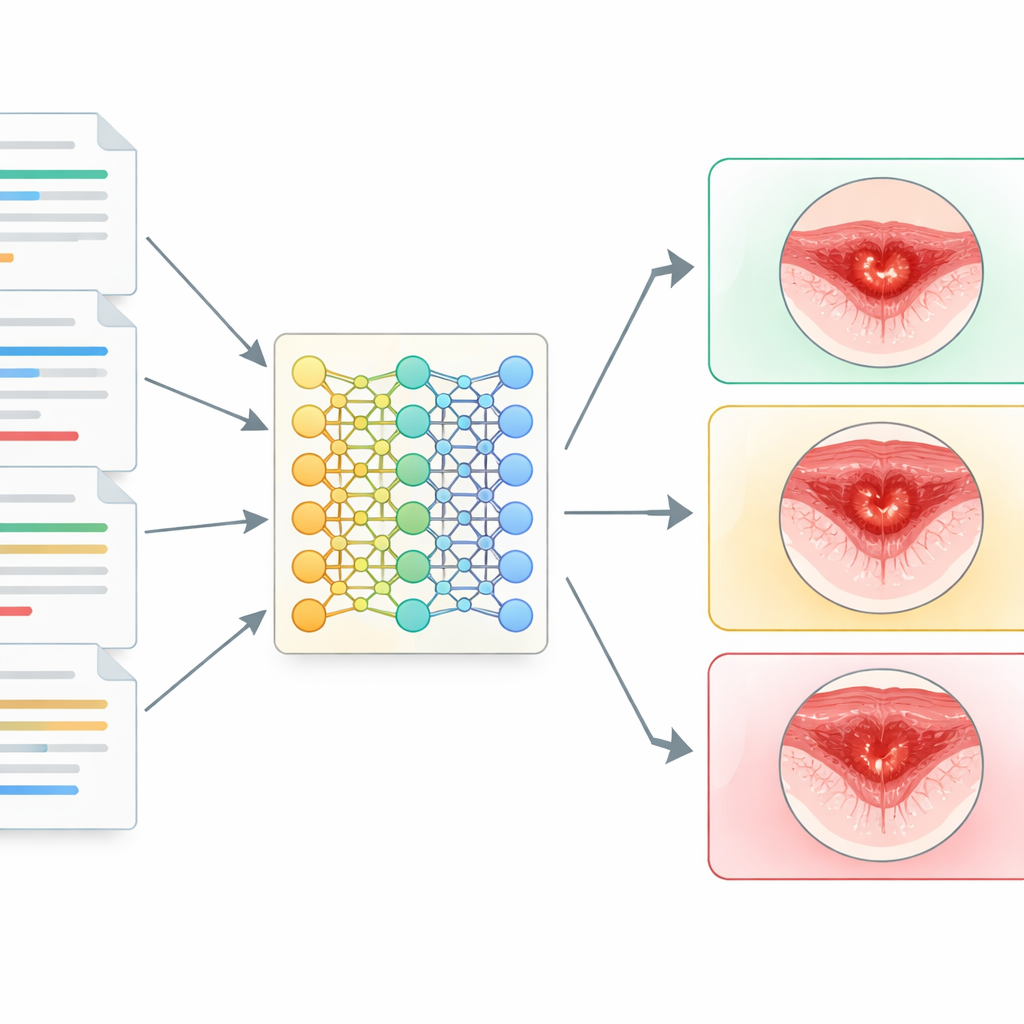

I ricercatori hanno raccolto 102 referti del mondo reale che descrivono ciò che i patologi hanno osservato al microscopio in biopsie di bocca e mascelle. Questi referti coprivano una vasta gamma di problemi, dalle semplici tumefazioni piene di muco e dai fibromi fino a cambiamenti potenzialmente cancerosi come la displasia epiteliale orale e il carcinoma squamoso conclamato. Per ogni caso il team ha inserito lo stesso referto testuale, insieme a informazioni di base sul paziente come età, sesso e sede della lesione, in quattro chatbot: ChatGPT-4.0, una versione orientata al ragionamento ChatGPT o1-preview, Meta AI basata su LLaMA-3 e Gemini di Google. A ciascun chatbot è stato chiesto una diagnosi principale e tre possibili alternative, imitando il modo in cui un clinico potrebbe cercare un rapido secondo parere.

Valutare le risposte rispetto agli esperti umani

Due patologi orali certificati, prima in modo indipendente e poi in consenso, hanno confrontato il suggerimento principale di ciascun chatbot con la diagnosi originale nel referto ospedaliero. Hanno classificato le risposte in tre gruppi: chiaramente errate; simili o parzialmente corrette (ad esempio cogliendo solo una parte di una diagnosi combinata o usando una terminologia diversa ma clinicamente equivalente); o pienamente corrette. Il team ha inoltre verificato se un chatbot che non individuava la diagnosi principale potesse comunque elencarla tra le tre alternative. Usando metodi statistici standard, hanno confrontato quanto spesso ciascun sistema concordava con gli esperti umani ed esaminato se i risultati cambiassero in funzione dell’età o del sesso dei pazienti.

Quale chatbot si è avvicinato di più agli specialisti

La versione orientata al ragionamento ChatGPT o1-preview ha fornito il supporto più affidabile: la sua diagnosi principale coincideva con gli esperti in circa due casi su tre (68,6 percento), con Meta AI appena dietro (65,7 percento). ChatGPT-4.0 ha mostrato prestazioni moderate (59,8 percento), mentre Gemini è rimasto indietro con risposte corrette in solo circa un quarto dei casi (27,5 percento). Con una misurazione più rigorosa dell’accordo, ChatGPT o1-preview e Meta AI hanno raggiunto ciò che gli statistici definiscono un accordo “sostanziale” con i patologi orali, ChatGPT-4.0 ha ottenuto un accordo “moderato” e Gemini ha mostrato un accordo “scarso”. Tutti i chatbot hanno funzionato meglio su problemi benigni comuni e ben definiti come mucoceli e fibromi, e hanno incontrato difficoltà costanti con condizioni più insidiose come la displasia epiteliale orale o lesioni rare.

Dove le macchine sono ancora carenti

Anche quando ai chatbot è stata concessa una lista di tre diagnosi alternative, spesso non includevano quella corretta, in particolare Gemini e Meta AI. Lo studio ha inoltre rilevato che, per la maggior parte dei modelli, le prestazioni calavano leggermente nei pazienti più anziani, probabilmente perché i cambiamenti tissutali legati all’età rendono il quadro microscopico più complesso. Al contrario, nessuno dei sistemi ha mostrato differenze tra uomini e donne. Gli autori sottolineano diversi motivi di cautela: la natura “scatola nera” delle IA commerciali, dati di addestramento non noti, la rappresentazione disomogenea delle malattie rare e il fatto che i chatbot hanno visto solo descrizioni testuali senza le immagini microscopiche che i patologi umani usano normalmente.

Cosa significa per le cure future

Per i lettori non specialisti, il messaggio chiave è che le attuali IA conversazionali possono talvolta riflettere il giudizio esperto in patologia orale, ma sono lontane dall’essere abbastanza affidabili per sostituire gli specialisti. Il chatbot con le migliori prestazioni ha approssimativamente eguagliato gli specialisti in due casi su tre e ha fatto peggio proprio nelle situazioni in cui gli errori contano di più — malattie insolite o in fase iniziale. Gli autori concludono che, al momento, questi strumenti dovrebbero essere usati solo come ausili che possono supportare la formazione, ridurre il carico di lavoro e offrire un controllo sommario, mai come sostituti dei patologi qualificati. Con dati migliori, supervisione più chiara e test accurati, tali sistemi potrebbero un giorno diventare partner diagnostici più sicuri, ma per ora l’esperienza umana rimane essenziale.

Citazione: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Parole chiave: patologia orale, intelligenza artificiale, supporto decisionale clinico, grandi modelli linguistici, odontoiatria digitale