Clear Sky Science · he

ניתוח השוואתי של מודלים לשוניים גדולים ככלי תמיכה בקבלת החלטות בפתולוגיה אורלית

מדוע צ׳אטבוטים חכמים ברפואת הפה חשובים

כיום רוב האנשים נושאים בכיסם יכולות בינה מלאכותית מתקדמות, בדרך כלל בצורת צ׳אטבוטים ידידותיים שמגבישים תשובות תוך שניות. אך האם כלים אלה יכולים לסייע בבטחה לרופאים לפרש שינויים זעירים ברקמות שמצביעים אם נגע בפה הוא שולי או תחילתו של מצב חמור יותר? המחקר הזה בודק בדיוק זאת, ומשווה ארבעה צ׳אטבוטים נפוצים כדי לראות עד כמה הם תומכים במומחים שמאבחנים מחלות מתיאורי מיקרוסקופ של רקמות אוראליות.

איך המחקר בחן את הצ׳אטבוטים

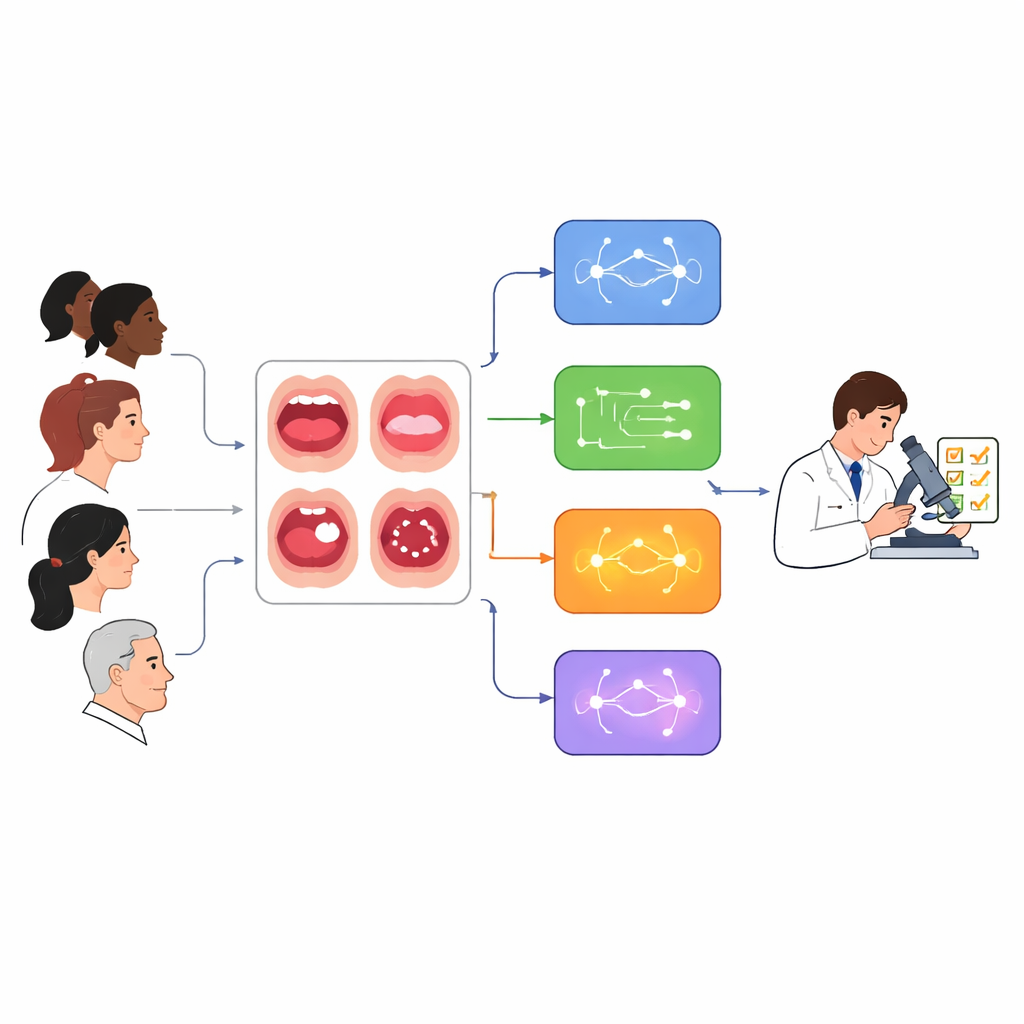

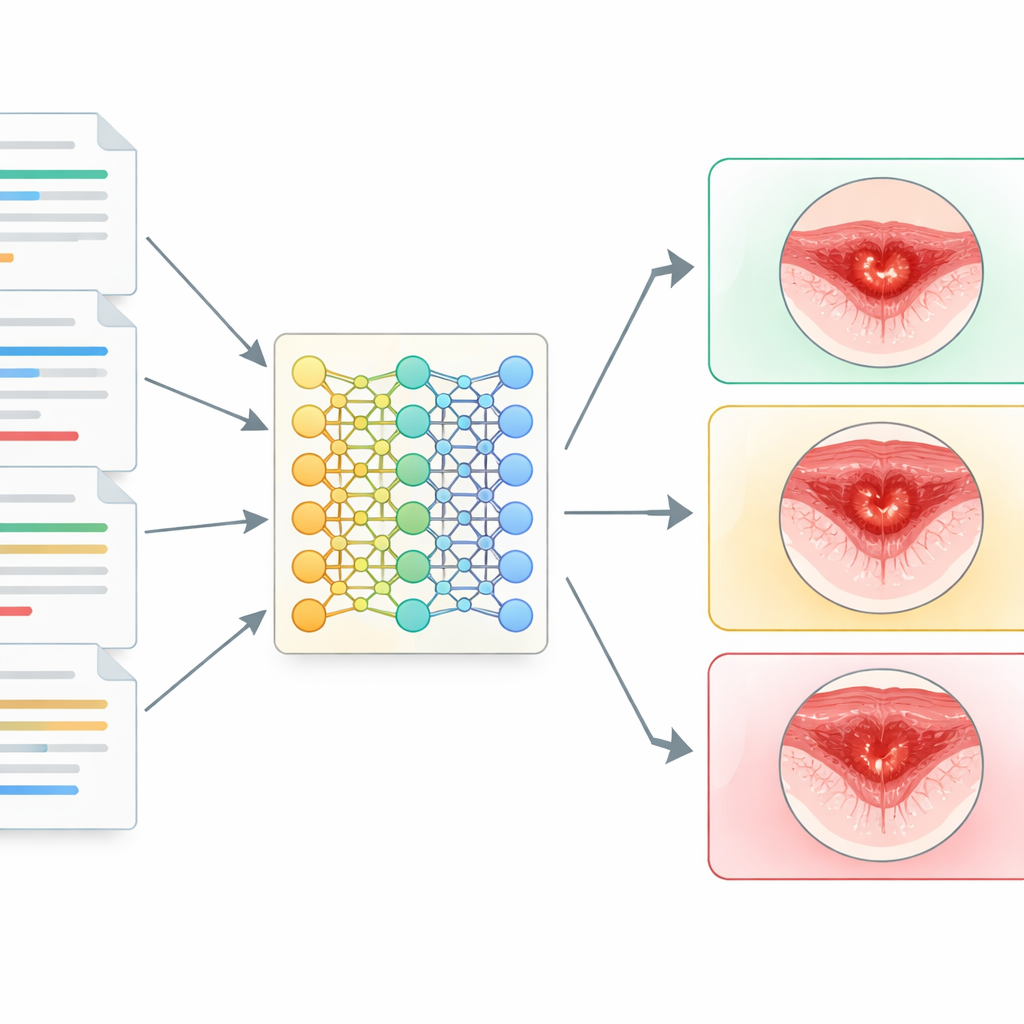

החוקרים אספו 102 דוחות מהעולם האמיתי שתיארו מה הפתולוגים ראו במיקרוסקופ בביצוע ביופסיות מהפה והלסתות. דוחות אלה כיסו מגוון רחב של מצבים, מתנפחויות מלאות ליחה ופיברומות פשוטות ועד שינויים פוטנציאליים סרטניים כמו דיספלזיה אפיתליאלית של הפה וסרטן תאי קשקש מתקדם. עבור כל מקרה הצוות הזין את אותו טקסט דוח, בנוסף לפרטי מטופל בסיסיים כמו גיל, מין ומיקום הנגע, לארבעה צ׳אטבוטים: ChatGPT-4.0, ChatGPT o1-preview הממוקד בהיסק, Meta AI מבוסס LLaMA-3 ו-Google Gemini. בכל פעם התבקש הצ׳אטבוט לתת אבחנה ראשית ושלוש חלופות אפשריות, בחיקוי האופן שבו קלינאי עשוי לבקש חוות דעת שנייה מהירה.

ניקוד התשובות מול מומחים אנושיים

שני פתולוגים אוראליים מוסמכים, שעבדו באופן עצמאי ואז בהסכמה משותפת, השוו כל הצעה עיקרית של הצ׳אטבוט לאבחנה המקורית במסמכי בית החולים. הם מיינו את התשובות לשלוש קבוצות: שגויות לחלוטין; דומות או נכונות באופן חלקי (למשל, תפסו רק חלק מאבחנה משולבת או השתמשו בניסוח שונה אך שקול מבחינה קלינית); או נכונות לגמרי. הצוות בדק גם האם צ׳אטבוט שפספס את האבחנה הראשית עדיין כלל את התשובה הנכונה בין שלוש החלופות. באמצעות שיטות סטטיסטיות סטנדרטיות השוו החוקרים באיזו תדירות כל מערכת הסכימה עם המומחים האנושיים ובחנו האם התוצאות השתנו בהתאם לגיל או למין המטופל.

איזה צ׳אטבוט התקרב ביותר למומחים

ה-ChatGPT o1-preview הממוקד בהיסק נתן את התמיכה האמינה ביותר: האבחנה הראשית שלו תאמה את המומחים בכמעט שניים מתוך שלושה מקרים (68.6 אחוז), כאשר Meta AI התמקמה קרוב מאחור (65.7 אחוז). ChatGPT-4.0 הציג ביצועים בינוניים (59.8 אחוז), בעוד Gemini נשאר מאחור עם תשובות נכונות בכ־27.5 אחוז מהמקרים בלבד. כאשר המדידה נעשתה באופן מחמיר יותר, ChatGPT o1-preview ו-Meta AI הגיעו להסכמה שסטטיסטיקאים מכנים "משמעותית" עם הפתולוגים האוראליים, ChatGPT-4.0 הגיע להסכמה "בינונית", ו-Gemini הראה "דלילה" בהסכמה. כל הצ׳אטבוטים הופיעו טוב יותר במקרים נפוצים ומוגדרים היטב כמו מוקוצלות ופיברומות, ובאופן עקבי התקשו עם מצבים מורכבים יותר כמו דיספלזיה אפיתליאלית או נגעים נדירים.

איפה המכונות עדיין מאכזבות

גם כאשר הוצעו לצ׳אטבוטים שלוש אבחנות חלופיות, לעתים קרובות הם לא כללו את האבחנה הנכונה, במיוחד Gemini ו-Meta AI. המחקר גם מצא שעבור רוב המודלים הביצועים ירדו מעט במטופלים מבוגרים, ככל הנראה מפני שתהליכים הקשורים לגיל מקשים על התמונה המיקרוסקופית. לעומת זאת, אף אחד מהמערכות לא הראה הבדלים בין גברים לנשים. המחברים מדגישים מספר סיבות זהירות: טבע ה"קופסה השחורה" של מערכות מסחריות, נתוני אימון לא ידועים, ייצוג בלתי אחיד של מחלות נדירות, ועובדת היות הצ׳אטבוטים מבוססים רק על תיאורי טקסט ללא תמונות מיקרוסקופיות שבהן פתולוגים אנושיים משתמשים שגרתית.

מה משמעות הדבר לטיפול עתידי

לקוראים שאינם מומחים, המסר המרכזי הוא שמערכות השיחה המתקדמות של היום יכולות לעתים לשקף שיקול דעת מומחה בפתולוגיה אוראלית, אך אינן אמינות דיים כדי להחליף את האדם. הצ׳אטבוט הכי מוצלח התיישב בקירוב עם המומחים בשני מקרים מתוך שלושה והיה גרוע יותר בדיוק במצבים שבהם שגיאות מסוכנות במיוחד—מחלות נדירות או בשלבי התחלתי. המחברים מסכמים שהיום יש להשתמש בכלים אלה רק כסייעים שעשויים לתמוך בחינוך, להקטין עומס עבודה ולהציע בחינה שנייה ראשונית, אך לא כתחליף לפתולוגים מיומנים. עם נתונים טובים יותר, פיקוח ברור ובדיקות זהירות, מערכות כאלה עשויות בעתיד להפוך לשותפים בטוחים יותר באבחון, אך נכון לעכשיו המומחיות האנושית נשארת חיונית.

ציטוט: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

מילות מפתח: פתולוגיה אורלית, בינה מלאכותית, תמיכה קלינית בהחלטה, מודלים לשוניים גדולים, רוקחות דיגיטלית