Clear Sky Science · fr

Analyse comparative des grands modèles de langage comme outils d’aide à la décision en pathologie buccale

Pourquoi les chatbots intelligents en médecine buccale comptent

La plupart des gens portent désormais dans leur poche une intelligence artificielle puissante, présentée sous la forme de chatbots conviviaux qui répondent aux questions en quelques secondes. Mais ces outils peuvent-ils aider les médecins en toute sécurité à interpréter les minuscules modifications tissulaires qui indiquent si une lésion buccale est bénigne ou le début de quelque chose de sérieux ? Cette étude pose précisément cette question, en comparant quatre chatbots largement utilisés pour évaluer dans quelle mesure ils soutiennent les spécialistes qui diagnostiquent des maladies à partir de descriptions microscopiques de tissus buccaux.

Comment l’étude a mis les chatbots à l’épreuve

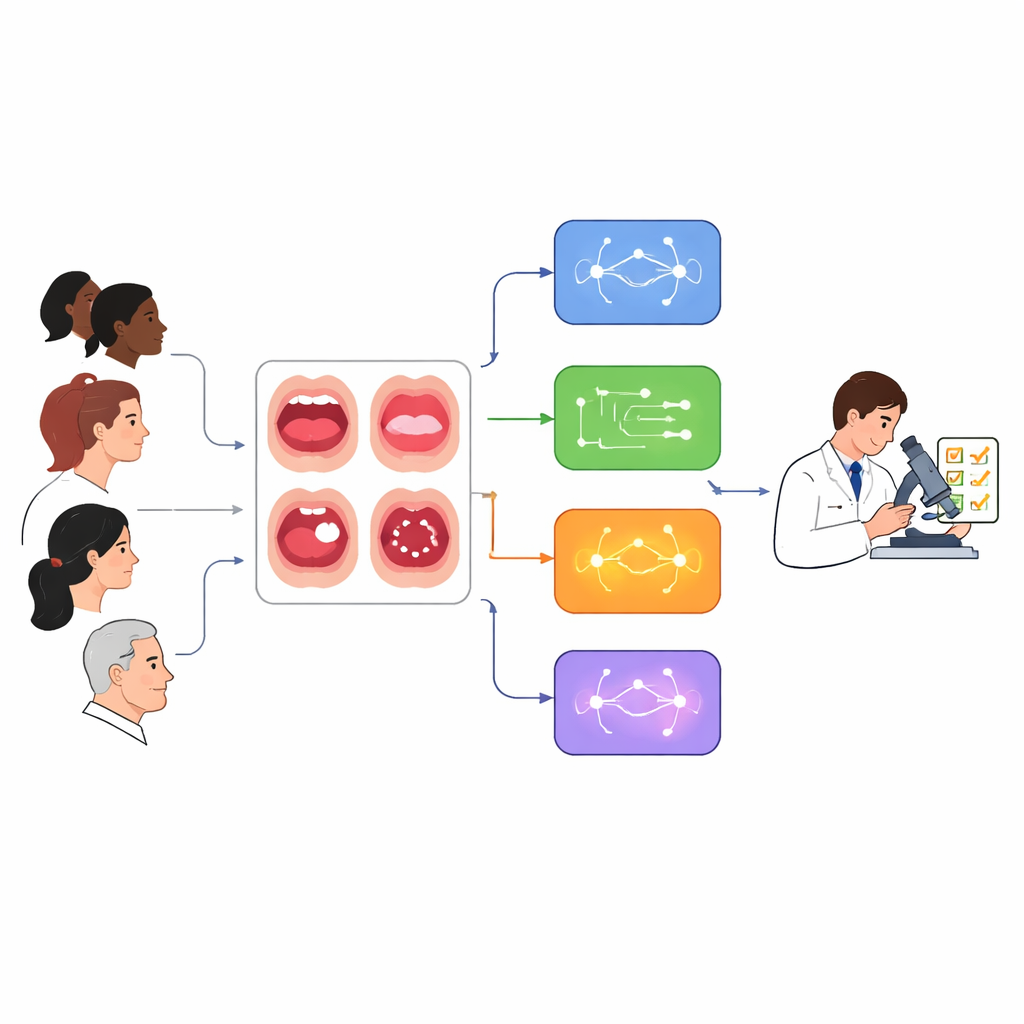

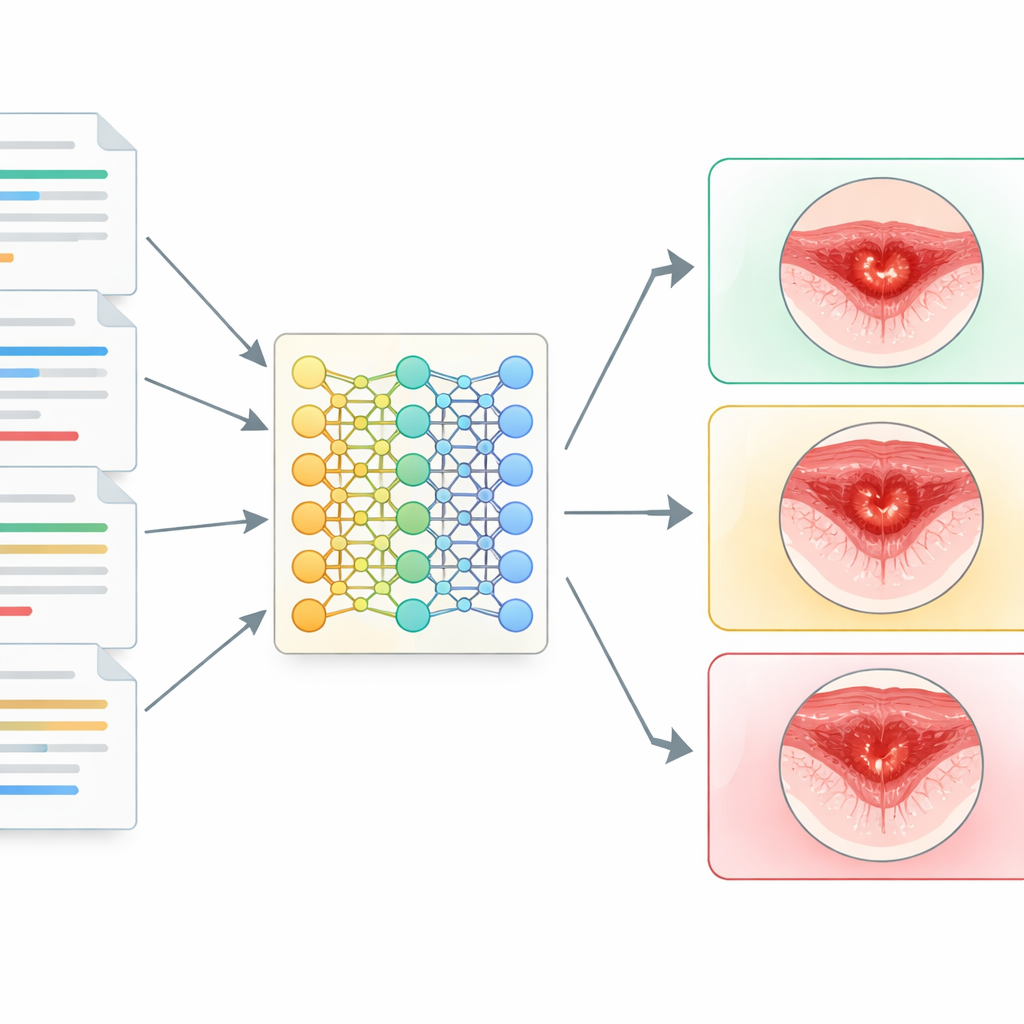

Les chercheurs ont rassemblé 102 comptes rendus réels décrivant ce que les pathologistes ont observé au microscope sur des biopsies de la bouche et des mâchoires. Ces rapports couvraient un large éventail de problèmes, depuis des tuméfactions muqueuses simples et des fibromes jusqu’à des modifications potentiellement cancéreuses telles que la dysplasie épithéliale buccale et le carcinome épidermoïde établi. Pour chaque cas, l’équipe a soumis le même rapport textuel, ainsi que des données patient de base comme l’âge, le sexe et la localisation de la lésion, à quatre chatbots : ChatGPT‑4.0, un ChatGPT o1‑preview orienté raisonnement, Meta AI basé sur LLaMA‑3, et Gemini de Google. Chaque chatbot a été invité à fournir un diagnostic principal et trois alternatives possibles, imitant la manière dont un clinicien pourrait demander un avis rapide.

Évaluation des réponses par rapport aux experts humains

Deux pathologistes bucco‑dentaires certifiés, travaillant indépendamment puis en consensus, ont comparé la suggestion principale de chaque chatbot avec le diagnostic initial inscrit dans le dossier hospitalier. Ils ont classé les réponses en trois catégories : manifestement erronée ; similaire ou partiellement correcte (par exemple, ne captant qu’une partie d’un diagnostic combiné ou utilisant un libellé différent mais cliniquement équivalent) ; ou parfaitement correcte. L’équipe a aussi vérifié si un chatbot qui manquait le diagnostic principal pouvait tout de même le citer parmi ses trois alternatives. À l’aide de méthodes statistiques standard, ils ont comparé la fréquence d’accord de chaque système avec les experts et examené si les résultats variaient selon l’âge ou le sexe des patients.

Quel chatbot s’est le plus rapproché des spécialistes

Le ChatGPT o1‑preview, axé sur le raisonnement, a fourni le soutien le plus fiable : son diagnostic principal correspondait à celui des experts dans environ deux cas sur trois (68,6 %), Meta AI arrivant juste derrière (65,7 %). ChatGPT‑4.0 a obtenu des performances modérées (59,8 %), tandis que Gemini était à la traîne avec des réponses correctes dans seulement environ un quart des cas (27,5 %). Lorsqu’on a appliqué une mesure d’accord plus stricte, ChatGPT o1‑preview et Meta AI ont atteint ce que les statisticiens qualifient d’« accord substantiel » avec les pathologistes buccaux, ChatGPT‑4.0 un « accord modéré », et Gemini a montré un « accord faible ». Tous les chatbots se sont mieux comportés sur des problèmes bénins fréquents et bien définis comme les mucocèles et les fibromes, et ont systématiquement eu du mal avec des affections plus complexes comme la dysplasie épithéliale buccale ou des lésions rares.

Où les machines restent en deçà

Même lorsque les chatbots pouvaient fournir une liste de trois diagnostics alternatifs, ils omettaient fréquemment le bon diagnostic, notamment Gemini et Meta AI. L’étude a également montré que, pour la plupart des modèles, les performances déclinaient légèrement chez les patients plus âgés, peut‑être parce que les modifications tissulaires liées à l’âge compliquent l’aspect microscopique. En revanche, aucun des systèmes n’a montré de différence de performance entre hommes et femmes. Les auteurs soulignent plusieurs raisons de prudence : la nature « boîte noire » des IA commerciales, les données d’entraînement inconnues, la représentation inégale des maladies rares, et le fait que les chatbots n’ont vu que des descriptions textuelles sans les images microscopiques que les pathologistes humains utilisent couramment.

Ce que cela signifie pour les soins futurs

Pour le grand public, le message clé est que les IA conversationnelles d’aujourd’hui peuvent parfois refléter le jugement d’experts en pathologie buccale, mais elles sont loin d’être suffisamment fiables pour se substituer aux humains. Le chatbot le plus performant correspondait à peu près aux spécialistes dans deux cas sur trois et a donné de moins bons résultats précisément dans les situations où les erreurs ont le plus de conséquences : les maladies rares ou au stade précoce. Les auteurs concluent qu’à l’heure actuelle, ces outils ne devraient être utilisés qu’en tant qu’aides pouvant soutenir la formation, réduire la charge de travail et fournir un second avis approximatif, jamais comme remplaçants des pathologistes formés. Avec de meilleures données, une supervision plus claire et des tests rigoureux, ces systèmes pourraient un jour devenir des partenaires de diagnostic plus sûrs, mais pour l’instant l’expertise humaine reste essentielle.

Citation: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Mots-clés: pathologie buccale, intelligence artificielle, aide à la décision clinique, grands modèles de langage, dentisterie numérique