Clear Sky Science · nl

Vergelijkende analyse van grote taalmodellen als besluitvormingsondersteuning in de orale pathologie

Waarom slimme chatbots in mondgeneeskunde ertoe doen

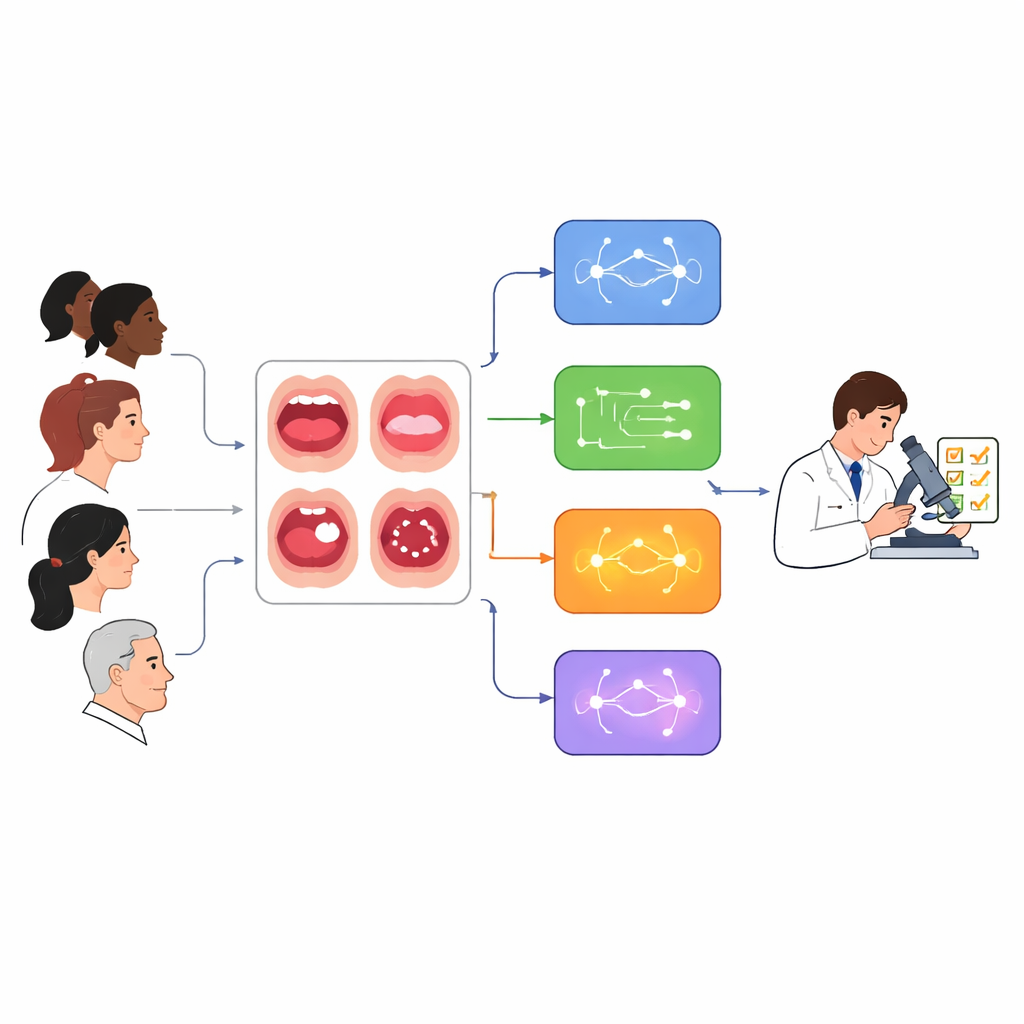

De meeste mensen dragen tegenwoordig krachtige kunstmatige intelligentie bij zich, verpakt als vriendelijke chatbots die vragen binnen enkele seconden beantwoorden. Maar kunnen deze hulpmiddelen artsen op een veilige manier helpen bij het interpreteren van de kleine weefselveranderingen die onthullen of een plek in de mond onschadelijk is of het begin van iets ernstigers? Deze studie onderzoekt precies dat en vergelijkt vier veelgebruikte chatbots om te zien hoe goed ze specialisten ondersteunen die ziekten diagnosticeren aan de hand van microscoopbeschrijvingen van mondweefsel.

Hoe de studie de chatbots testte

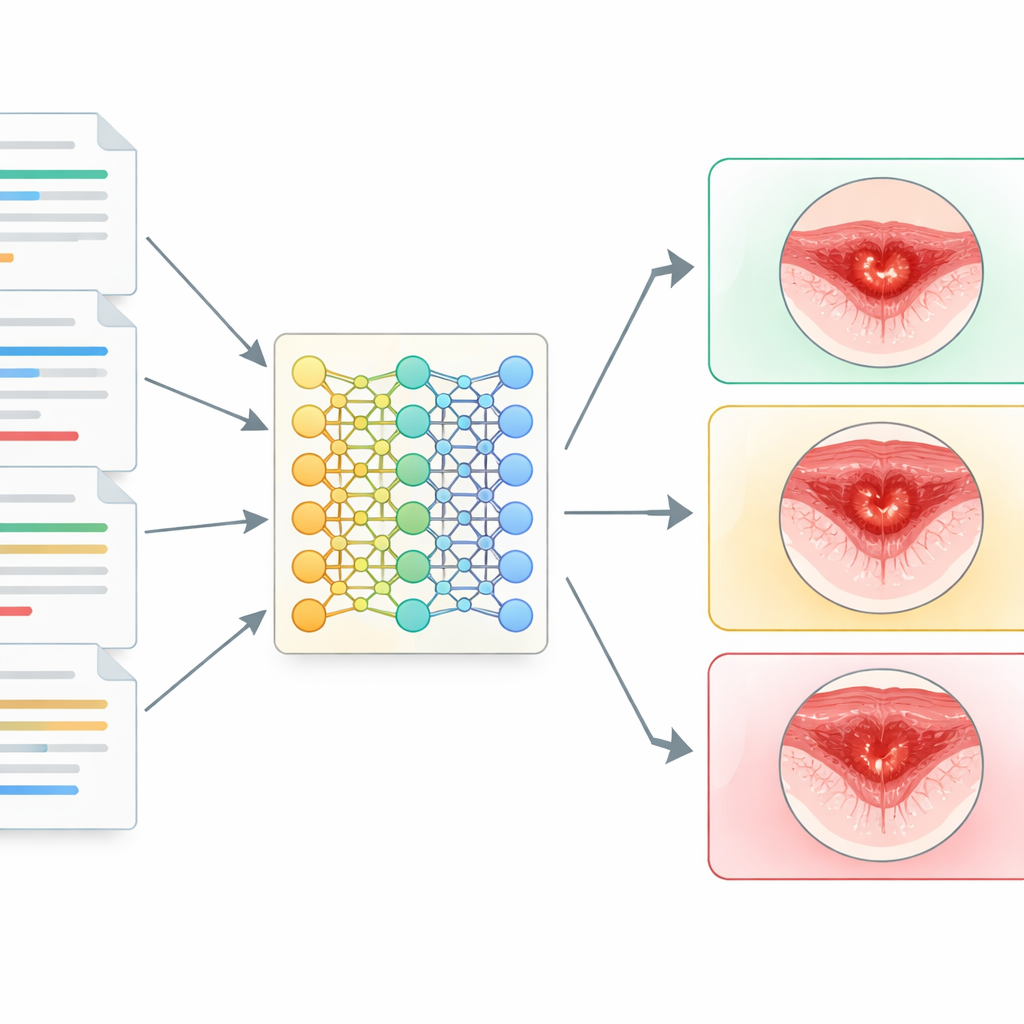

De onderzoekers verzamelden 102 rapporten uit de praktijk die beschreven wat pathologen onder de microscoop zagen in biopten uit de mond en kaak. Deze rapporten besloegen een breed scala aan problemen, van eenvoudige met slijm gevulde zwellingen en fibromen tot potentieel kankerverwekkende veranderingen zoals orale epitheliale dysplasie en uitgegroeide plaveiselcelcarcinomen. Voor elk geval voegde het team hetzelfde tekstrapport, plus basisgegevens van de patiënt zoals leeftijd, geslacht en locatie van de laesie, in vier chatbots: ChatGPT-4.0, een redeneergestuurde ChatGPT o1-preview, Meta AI gebaseerd op LLaMA-3 en Google’s Gemini. Elke chatbot werd gevraagd om één hoofddiagnose en drie mogelijke alternatieven te geven, in navolging van hoe een clinicus snel een second opinion zou kunnen zoeken.

Beoordeling van antwoorden tegenover menselijke experts

Twee gecertificeerde orale pathologen vergeleken elk voor zichzelf en daarna in consensus de hoofdaanbeveling van elke chatbot met de oorspronkelijke diagnose in het ziekenhuisdossier. Ze sorteerden de antwoorden in drie groepen: duidelijk fout; vergelijkbaar of gedeeltelijk juist (bijvoorbeeld slechts een deel van een gecombineerde diagnose vangen of andere maar klinisch gelijkwaardige bewoording gebruiken); of volledig correct. Het team controleerde ook of een chatbot die de hoofddiagnose miste, het juiste antwoord wellicht wel als een van de drie alternatieven noemde. Met standaardstatistische methoden vergeleken ze hoe vaak elk systeem overeenstemde met de menselijke experts en onderzochten of de resultaten verschilden met leeftijd of geslacht van de patiënt.

Welke chatbot het dichtst bij de specialisten kwam

De redeneergestuurde ChatGPT o1-preview leverde de meest betrouwbare ondersteuning: zijn hoofddiagnose kwam ongeveer twee van de drie gevallen overeen met de experts (68,6 procent), met Meta AI op de hielen (65,7 procent). ChatGPT-4.0 presteerde redelijk goed (59,8 procent), terwijl Gemini achterbleef met correcte antwoorden in slechts ongeveer een kwart van de gevallen (27,5 procent). Wanneer overeenkomst strikter werd gemeten, bereikten ChatGPT o1-preview en Meta AI wat statistici “substantiële” overeenstemming noemen met orale pathologen, behaalde ChatGPT-4.0 een “matige” overeenstemming en toonde Gemini een “zwakke” overeenstemming. Alle chatbots waren beter in veelvoorkomende, duidelijk afgebakende goedaardige aandoeningen zoals mucoceles en fibromen, en hadden consequent moeite met lastigere aandoeningen zoals orale epitheliale dysplasie of zeldzame laesies.

Waar de machines nog tekortschieten

Zelfs wanneer de chatbots een lijst van drie alternatieve diagnoses mochten geven, slaagden ze er vaak niet in het juiste antwoord te noemen, vooral Gemini en Meta AI. De studie vond ook dat de prestaties voor de meeste modellen iets afnamen bij oudere patiënten, mogelijk omdat leeftijdsgerelateerde weefselveranderingen het microscopische beeld complexer maken. Daarentegen toonde geen van de systemen verschillen tussen mannen en vrouwen. De auteurs benadrukken meerdere redenen tot voorzichtigheid: de “black box”-aard van commerciële AI, onbekende trainingsgegevens, ongelijke representatie van zeldzame ziekten en het feit dat de chatbots alleen tekstbeschrijvingen zagen zonder de microscoopbeelden die menselijke pathologen routinematig gebruiken.

Wat dit betekent voor toekomstige zorg

Voor niet-specialisten is de kernboodschap dat de huidige converserende AI soms het oordeel van experts in de orale pathologie kan weergeven, maar dat ze verre van betrouwbaar genoeg is om zelfstandig te werken. De best presterende chatbot kwam ruwweg in twee van de drie gevallen overeen met specialisten en deed het slechter juist in de situaties waar fouten het meest ertoe doen—ongebruikelijke of vroege stadia van ziekte. De auteurs concluderen dat deze hulpmiddelen voorlopig alleen gebruikt zouden moeten worden als ondersteuners die educatie kunnen bevorderen, de werklast kunnen verminderen en een ruwe tweede blik kunnen bieden, nooit als vervanging van opgeleide pathologen. Met betere data, duidelijker toezicht en zorgvuldige testen kunnen dergelijke systemen op termijn veiligere partners in diagnose worden, maar vooralsnog blijft menselijke expertise essentieel.

Bronvermelding: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Trefwoorden: orale pathologie, kunstmatige intelligentie, klinische besluitvormingsondersteuning, grote taalmodellen, digitale tandheelkunde