Clear Sky Science · es

Análisis comparativo de grandes modelos de lenguaje como herramientas de apoyo a la decisión en patología oral

Por qué importan los chatbots inteligentes en medicina bucal

Hoy en día la mayoría de las personas lleva en el bolsillo potentes sistemas de inteligencia artificial, presentados como chatbots amigables que responden preguntas en segundos. Pero, ¿pueden estas herramientas ayudar de forma segura a los médicos a interpretar los pequeños cambios tisulares que indican si una lesión en la boca es inofensiva o el inicio de algo serio? Este estudio plantea exactamente esa pregunta, comparando cuatro chatbots de uso extendido para evaluar cuánto pueden apoyar a los especialistas que diagnostican enfermedades a partir de descripciones microscópicas de tejidos orales.

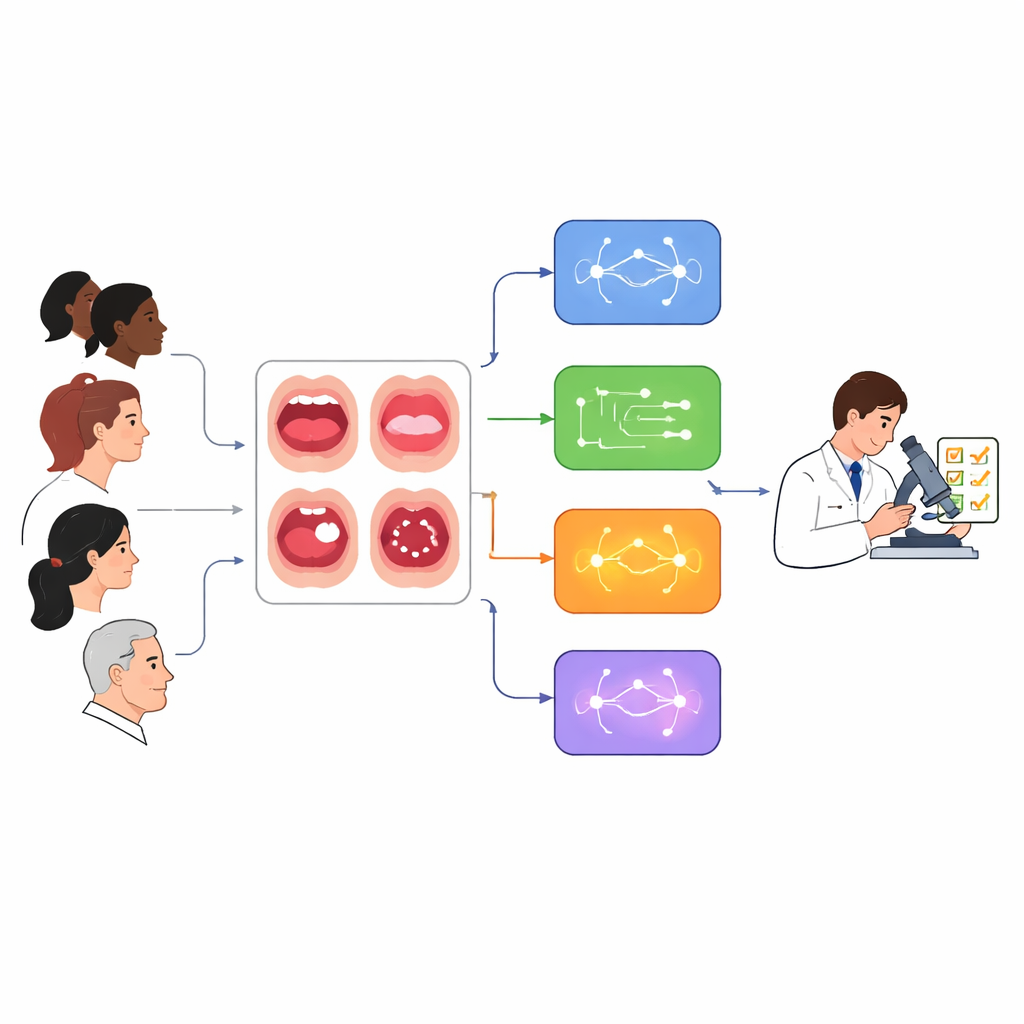

Cómo se evaluaron los chatbots

Los investigadores reunieron 102 informes del mundo real que describían lo que los patólogos vieron al microscopio en biopsias de la boca y los maxilares. Estos informes abarcaron una amplia gama de problemas, desde quistes mucosos y fibromas hasta cambios potencialmente cancerosos como la displasia epitelial oral y el carcinoma escamoso invasivo. Para cada caso, el equipo ingresó el mismo texto del informe, además de datos básicos del paciente como edad, sexo y localización de la lesión, en cuatro chatbots: ChatGPT-4.0, un ChatGPT o1-preview orientado al razonamiento, Meta AI basado en LLaMA-3 y Gemini de Google. A cada chatbot se le solicitó un diagnóstico principal y tres alternativas posibles, imitando cómo un clínico podría pedir una segunda opinión rápida.

Calificación de las respuestas frente a expertos humanos

Dos patólogos orales certificados, que trabajaron de forma independiente y luego en consenso, compararon la sugerencia principal de cada chatbot con el diagnóstico original del historial hospitalario. Clasificaron las respuestas en tres grupos: claramente erróneas; similares o parcialmente correctas (por ejemplo, acertando solo parte de un diagnóstico combinado o usando términos distintos pero clínicamente equivalentes); o completamente correctas. El equipo también verificó si un chatbot que falló en el diagnóstico principal podía aun así enumerar la respuesta correcta entre sus tres alternativas. Empleando métodos estadísticos estándar, compararon con qué frecuencia cada sistema coincidía con los expertos humanos y examinaron si los resultados variaban según la edad o el sexo del paciente.

Qué chatbot se acercó más a los especialistas

El ChatGPT o1-preview, centrado en el razonamiento, ofreció el apoyo más fiable: su diagnóstico principal coincidió con los expertos en aproximadamente dos de cada tres casos (68,6 por ciento), con Meta AI muy cerca (65,7 por ciento). ChatGPT-4.0 tuvo un rendimiento moderado (59,8 por ciento), mientras que Gemini quedó rezagado con respuestas correctas en solo alrededor de una cuarta parte de los casos (27,5 por ciento). Cuando la concordancia se midió de forma más estricta, ChatGPT o1-preview y Meta AI alcanzaron lo que los estadísticos llaman una concordancia “sustancial” con los patólogos orales; ChatGPT-4.0 obtuvo una concordancia “moderada”; y Gemini mostró una concordancia “pobre”. Todos los chatbots funcionaron mejor con problemas benignos comunes y bien definidos, como mucoceles y fibromas, y tuvieron dificultades constantes con condiciones más complejas como la displasia epitelial oral o lesiones raras.

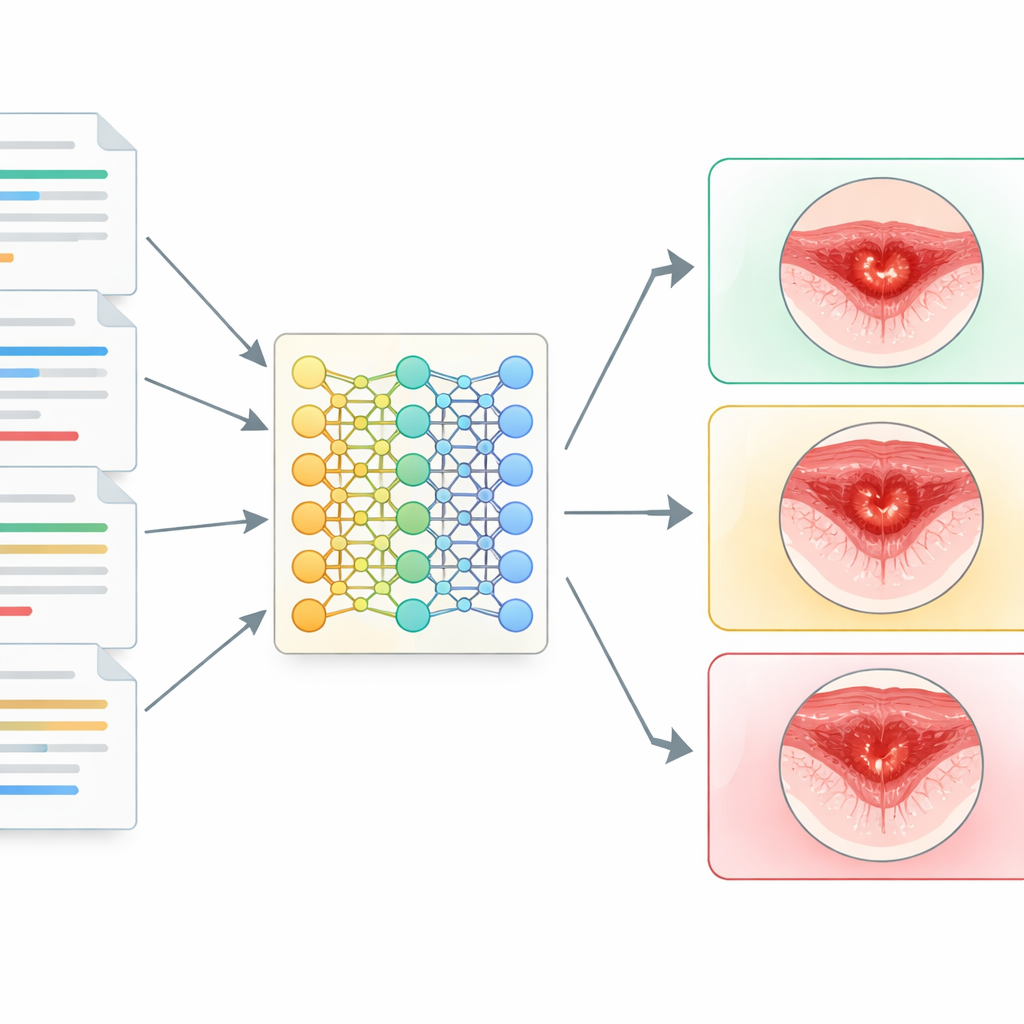

Dónde todavía fallan las máquinas

Incluso cuando a los chatbots se les permitía listar tres diagnósticos alternativos, a menudo no incluían el correcto, especialmente Gemini y Meta AI. El estudio también encontró que, para la mayoría de los modelos, el rendimiento bajaba ligeramente en pacientes de mayor edad, posiblemente porque los cambios tisulares asociados a la edad complican más la imagen microscópica. En cambio, ninguno de los sistemas mostró diferencias según el sexo. Los autores señalan varias razones para la precaución: la naturaleza de “caja negra” de la IA comercial, datos de entrenamiento desconocidos, representación desigual de enfermedades raras y el hecho de que los chatbots solo vieron descripciones textuales sin las imágenes microscópicas que los patólogos humanos utilizan de forma rutinaria.

Qué significa esto para la atención futura

Para los lectores no especialistas, el mensaje clave es que las IAs conversacionales actuales pueden a veces reproducir el juicio experto en patología oral, pero están lejos de ser lo bastante fiables como para funcionar de forma independiente. El chatbot con mejor rendimiento coincidió aproximadamente con los especialistas en dos de cada tres casos y rindió peor en las situaciones en que los errores importan más: enfermedades inusuales o en estadios tempranos. Los autores concluyen que, hoy por hoy, estas herramientas solo deben emplearse como asistentes que pueden apoyar la educación, reducir carga de trabajo y ofrecer una revisión aproximada, nunca como sustitutos de patólogos entrenados. Con mejores datos, supervisión más clara y pruebas exhaustivas, dichos sistemas podrían algún día convertirse en socios diagnósticos más seguros, pero por ahora la experiencia humana sigue siendo esencial.

Cita: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Palabras clave: patología oral, inteligencia artificial, apoyo a la decisión clínica, grandes modelos de lenguaje, odontología digital