Clear Sky Science · pt

Análise comparativa de grandes modelos de linguagem como ferramentas de suporte à decisão em patologia oral

Por que chatbots inteligentes importam na medicina bucal

A maioria das pessoas agora carrega no bolso poderosas inteligências artificiais, apresentadas como chatbots amigáveis que respondem perguntas em segundos. Mas essas ferramentas podem ajudar médicos com segurança a interpretar as pequenas alterações teciduais que revelam se uma lesão na boca é inofensiva ou o início de algo sério? Este estudo faz exatamente essa pergunta, comparando quatro chatbots amplamente usados para avaliar o quanto eles apoiam especialistas que diagnosticam doenças a partir de descrições microscópicas de tecidos orais.

Como o estudo testou os chatbots

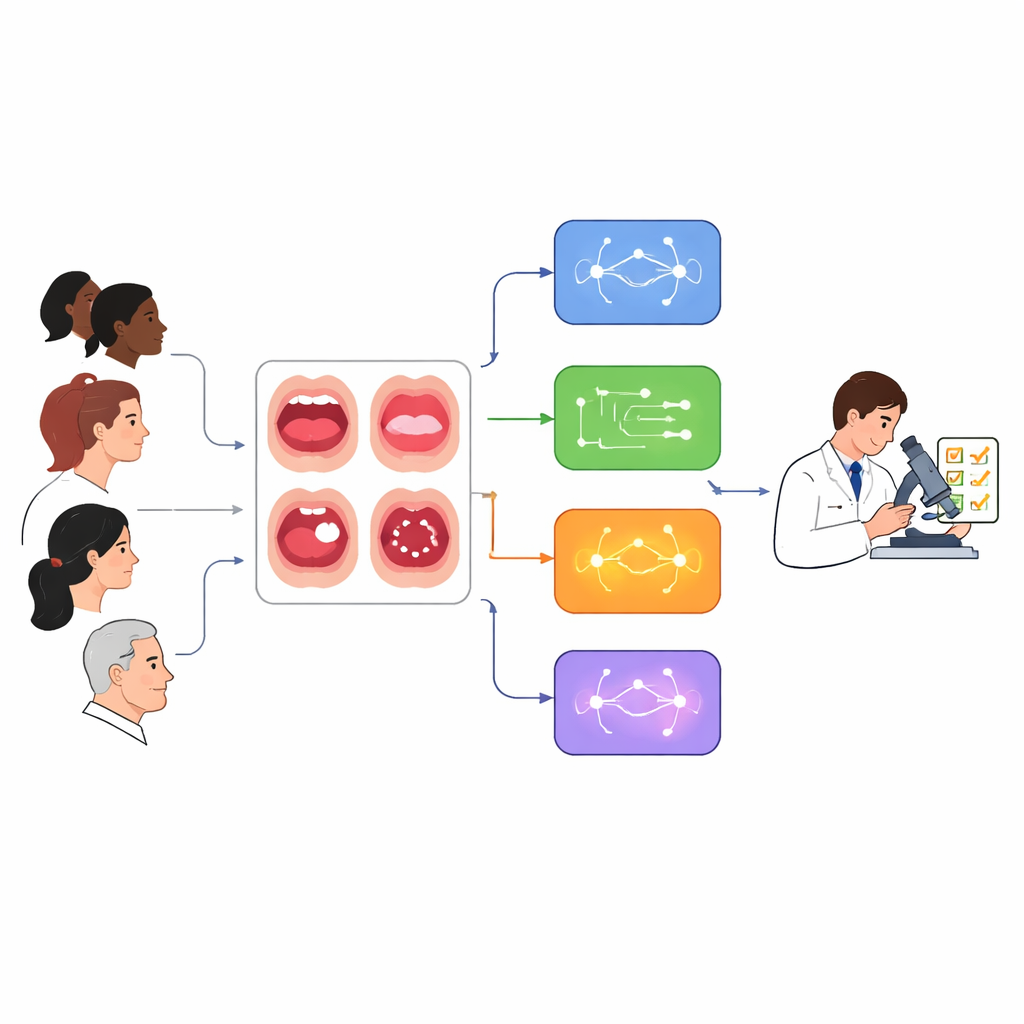

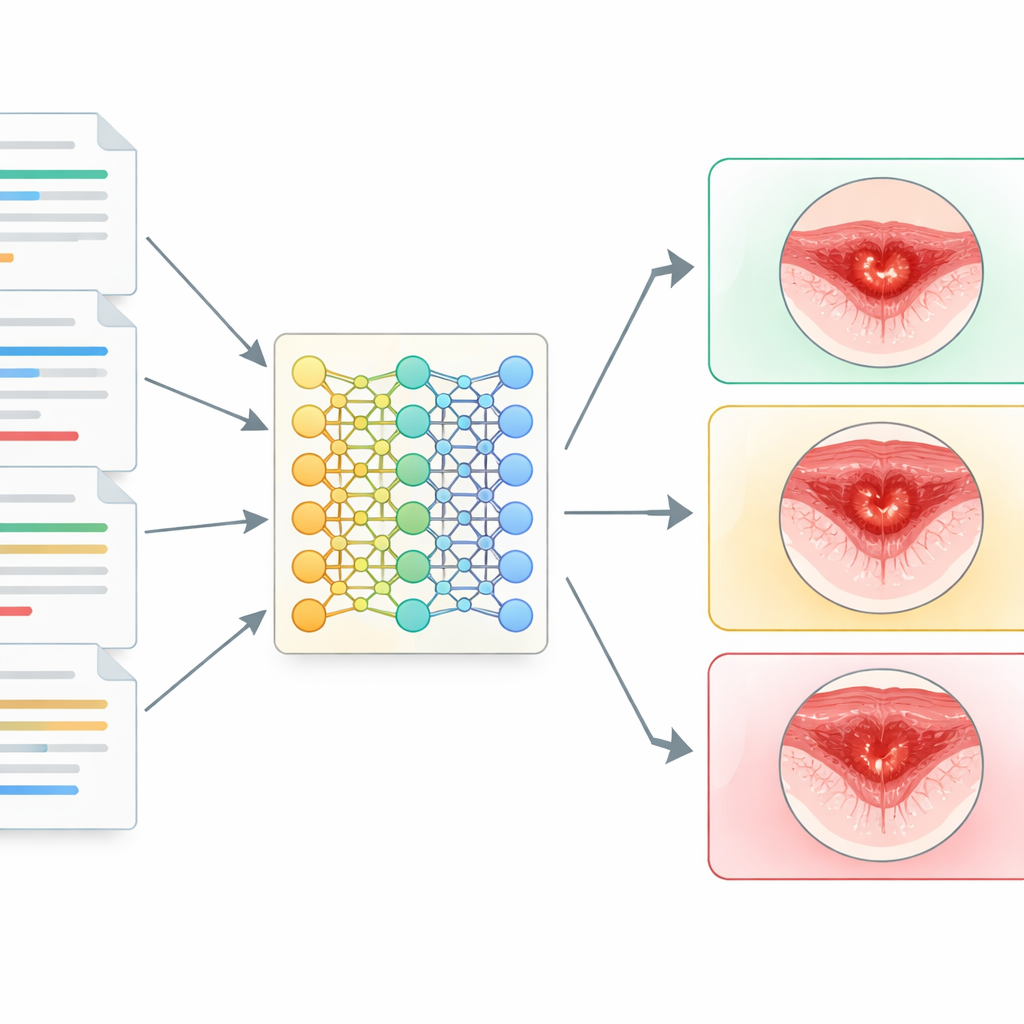

Os pesquisadores reuniram 102 laudos do mundo real descrevendo o que os patologistas viram ao microscópio em biópsias da boca e dos maxilares. Esses laudos cobriam uma ampla gama de problemas, desde simples tumefações preenchidas por muco e fibromas até alterações potencialmente cancerosas, como displasia epitelial oral e carcinoma espinocelular avançado. Para cada caso, a equipe inseriu o mesmo texto do laudo, além de dados básicos do paciente como idade, sexo e localização da lesão, em quatro chatbots: ChatGPT-4.0, um ChatGPT o1-preview focado em raciocínio, Meta AI baseado em LLaMA-3 e o Gemini do Google. Cada chatbot foi solicitado a fornecer um diagnóstico principal e três alternativas possíveis, imitando como um clínico poderia pedir uma segunda opinião rápida.

Avaliação das respostas comparadas a especialistas humanos

Dois patologistas orais certificados, trabalhando de forma independente e depois em consenso, compararam a sugestão principal de cada chatbot com o diagnóstico original registrado no hospital. Eles classificaram as respostas em três grupos: claramente erradas; semelhantes ou parcialmente corretas (por exemplo, identificando apenas parte de um diagnóstico combinado ou usando termos diferentes mas clinicamente equivalentes); ou totalmente corretas. A equipe também verificou se um chatbot que perdeu o diagnóstico principal poderia ainda listar a resposta correta entre suas três alternativas. Usando métodos estatísticos padrão, compararam com que frequência cada sistema concordava com os especialistas humanos e examinaram se os resultados variavam com a idade ou o sexo do paciente.

Qual chatbot chegou mais perto dos especialistas

O ChatGPT o1-preview, focado em raciocínio, ofereceu o suporte mais confiável: seu diagnóstico principal coincidiu com os especialistas em cerca de dois terços dos casos (68,6 por cento), com a Meta AI logo atrás (65,7 por cento). O ChatGPT-4.0 apresentou desempenho moderado (59,8 por cento), enquanto o Gemini ficou atrás, com acertos em apenas cerca de um quarto dos casos (27,5 por cento). Quando a concordância foi medida de forma mais estrita, o ChatGPT o1-preview e a Meta AI alcançaram o que estatísticos chamam de concordância “substancial” com os patologistas orais, o ChatGPT-4.0 alcançou concordância “moderada” e o Gemini mostrou concordância “fraca”. Todos os chatbots foram melhores em problemas benignos comuns e bem definidos, como mucoceles e fibromas, e tiveram dificuldades consistentes com condições mais complexas, como displasia epitelial oral ou lesões raras.

Onde as máquinas ainda ficam aquém

Mesmo quando os chatbots podiam fornecer uma lista de três diagnósticos alternativos, frequentemente não incluíam o correto, especialmente o Gemini e a Meta AI. O estudo também mostrou que, para a maioria dos modelos, o desempenho caiu ligeiramente em pacientes mais velhos, possivelmente porque alterações teciduais relacionadas à idade tornam o quadro microscópico mais complexo. Em contraste, nenhum dos sistemas mostrou diferença entre homens e mulheres. Os autores destacam várias razões para cautela: a natureza de “caixa-preta” das IAs comerciais, dados de treinamento desconhecidos, representação desigual de doenças raras e o fato de que os chatbots viram apenas descrições textuais, sem as imagens microscópicas que patologistas humanos usam rotineiramente.

O que isso significa para o cuidado futuro

Para leitores leigos, a mensagem principal é que as IAs conversacionais de hoje às vezes podem reproduzir o julgamento de especialistas em patologia oral, mas estão longe de ser confiáveis o suficiente para atuar sozinhas. O chatbot com melhor desempenho igualou aproximadamente os especialistas em dois terços dos casos e se saiu pior justamente nas situações em que erros têm maior impacto — doenças incomuns ou em estágio inicial. Os autores concluem que, no momento, essas ferramentas devem ser usadas apenas como auxiliares que podem apoiar a educação, reduzir carga de trabalho e oferecer uma segunda opinião aproximada, nunca como substitutos de patologistas treinados. Com dados melhores, supervisão mais clara e testes cuidadosos, esses sistemas poderão um dia se tornar parceiros diagnósticos mais seguros, mas, por ora, a expertise humana permanece essencial.

Citação: Alvarez-Silberberg, V.I., Alvarez-Silberberg, C.P., Galletti, C. et al. Comparative analysis of large language models as decision support tools in oral pathology. Sci Rep 16, 11272 (2026). https://doi.org/10.1038/s41598-026-41533-z

Palavras-chave: patologia oral, inteligência artificial, suporte à decisão clínica, grandes modelos de linguagem, odontologia digital