Clear Sky Science · zh

突触可塑性的内在稳定性提升了人工神经网络的学习能力与鲁棒性

大脑如何启发更稳健的机器学习

当我们学习一项新技能时,大脑既能保持足够的可塑性以吸收新信息,又能保持足够的稳定性以不忘既有知识。现代人工智能常在这两者之间挣扎:学习速度快,但有时变得脆弱或不稳定。这项研究从大脑的反馈信号中汲取灵感,设计出一种新方法,使人工神经网络在面对噪声、任务变化和误导性示例时能更高效地学习并保持鲁棒性。

学习机器中的一种新型引导信号

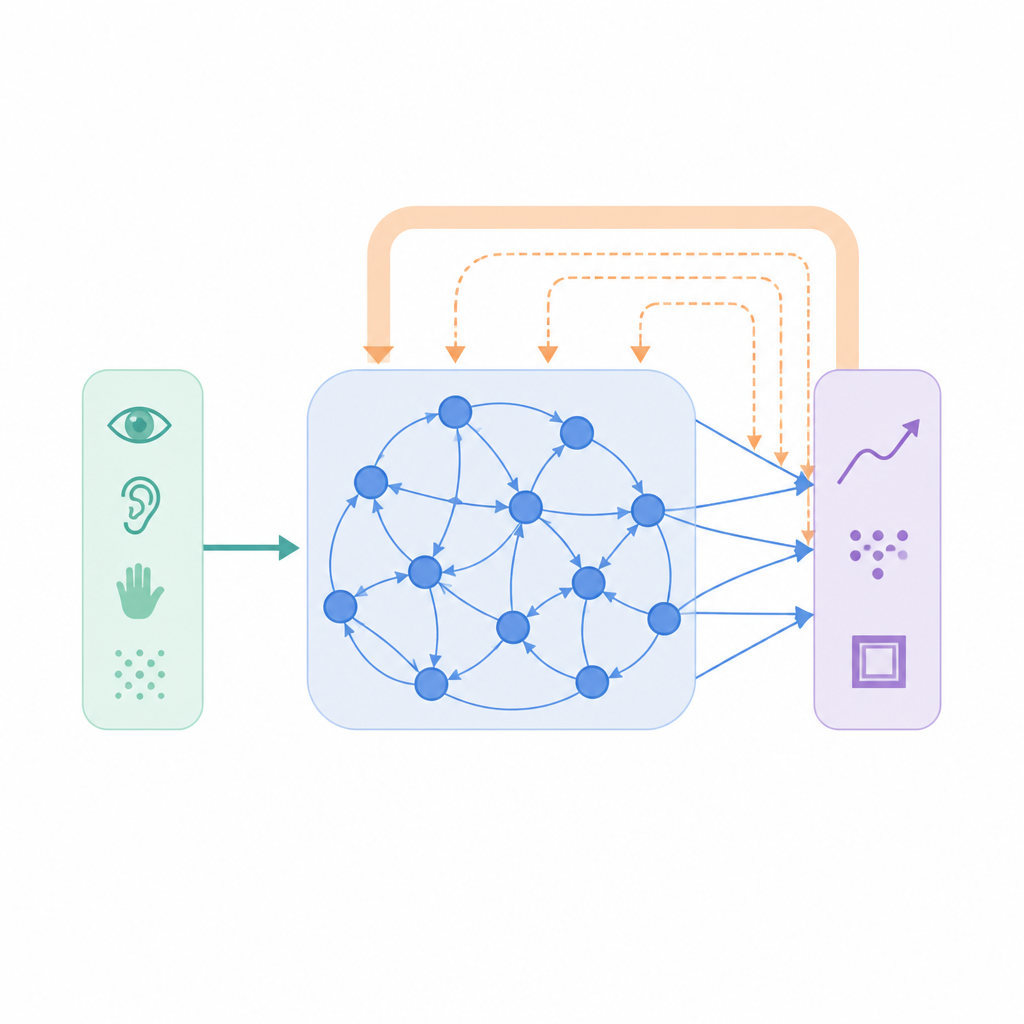

大多数机器学习系统依赖一个简单配方:比较网络的预测与正确答案,并微调连接以缩小差距。这种自下而上的方法有效,但忽视了真实大脑中流动的丰富自上而下信号,这些信号承载期望、上下文和预测。作者引入了一种称为内在自上而下稳定化(iTDS)的额外成分。网络不仅追逐正确答案,还学习一种更慢的内部信号,该信号追踪其自身的过去输出。这个缓慢变化的信号被反馈回学习规则,因此每个连接不仅受外部误差影响,还受网络随时间表现出的行为影响。

教会网络记住自身的习性

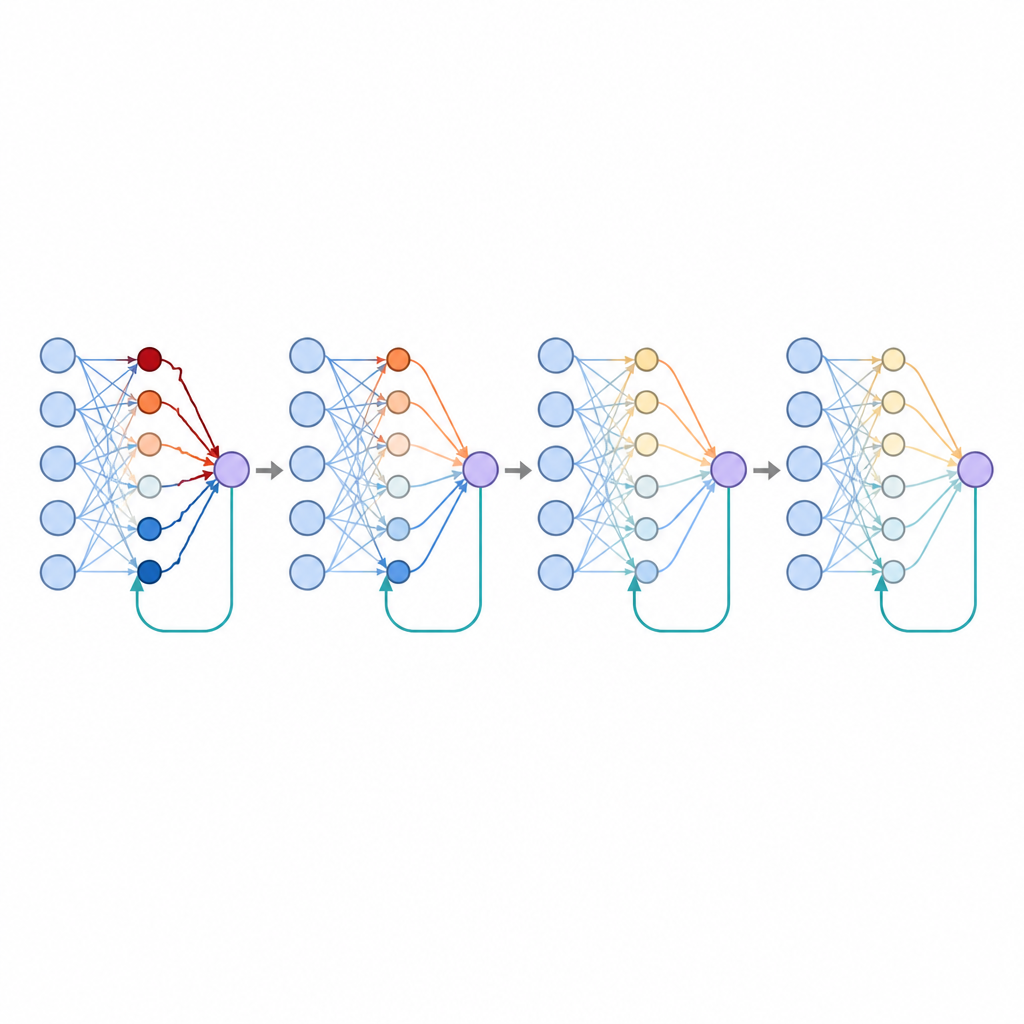

在 iTDS 中,网络保持一条关于其近期输出活动的平滑记录。这个内部痕迹并不试图预测未来数据或原始感官输入;它只是网络已产生输出的过滤回声。在训练过程中,常规的误差项推动连接朝正确目标调整,而自上而下项则将当前输出与该回声进行比较。当网络活动高度可变时,这两种影响往往指向相似方向,相互强化并加速学习。随着训练推进并且网络趋于更一致的模式,自上而下的影响逐渐减弱,更像是稳定器而非变革的驱动力。

更好的时序、分类和应对混乱

研究人员在多种神经网络(包括递归、前馈和水库模型)及十六项任务上测试了 iTDS。这些任务从跟踪时间上平滑信号,到识别手写数字,再到解决简单逻辑问题不等。在许多情况下,加入 iTDS 比仅用标准监督学习能更快训练并获得更低误差,即便底层网络动力学处于混沌状态。该方法在网络中活跃单元众多或输出信号剧烈波动时尤为有效,这些情形在生物与人工系统中都很常见。

从嘈杂与误导示例中学习

现实世界的数据很少是干净的。为测试鲁棒性,作者有意向输入添加噪声、将图像旋转离开常见方向,甚至加入与错误答案配对的“反向试验”。在这些压力条件下,仅使用标准学习的网络往往过度反应,以无益的方式重塑连接。使用 iTDS 时,缓慢的自上而下信号像刹车一样:当出现令人惊讶或相互矛盾的示例时,两种学习影响部分抵消,减少权重变化幅度。因此,带有 iTDS 的网络对随机畸变和那些通常会欺骗分类器的精心设计扰动更具抵抗力。

为何区分正负反馈很重要

研究还探讨了当某些连接专门只跟踪正误差而其他连接只跟踪负误差时会发生什么,这与大脑中某些细胞对奖励和挫折反应不同的现象类似。这种分离自然产生更稀疏的连通模式:许多连接接近零,而少数连接承担大部分影响。已知这种稀疏性有助于提高泛化能力,在这里它进一步降低了误差率。作者表明,仅仅强制许多权重保持为零即可模仿这一大部分好处,表明专门化的反馈可能是大脑实现稀疏高效表征的一条途径。

这对未来大脑与机器意味着什么

总体而言,iTDS 框架表明,赋予学习机器一种对其近期行为缓慢变化的自我感知,可以使它们成为更快的学习者和更稳定的问题解决者。与仅依赖与正确答案的即时不匹配不同,结合快速修正与温和自上而下稳定化的网络能更优雅地处理噪声、困惑和变化。对脑科学而言,该模型提供了关于反馈通路如何塑造学习的具体预测;对人工智能而言,它暗示在多重时间尺度上构建自我监控信号,可能是通向更像我们学习且在复杂环境中更少失败的系统的可行路径。

引用: Pilzak, A., Pennington, B. & Thivierge, JP. Intrinsic stabilization of synaptic plasticity improves learning and robustness in artificial neural networks. Nat Commun 17, 4164 (2026). https://doi.org/10.1038/s41467-026-70920-3

关键词: 突触可塑性, 自上而下反馈, 递归神经网络, 稳健学习, 抗噪能力