Clear Sky Science · ja

シナプス可塑性の内在的安定化が人工ニューラルネットワークの学習と頑健性を向上させる

脳に触発された、より安定した機械学習

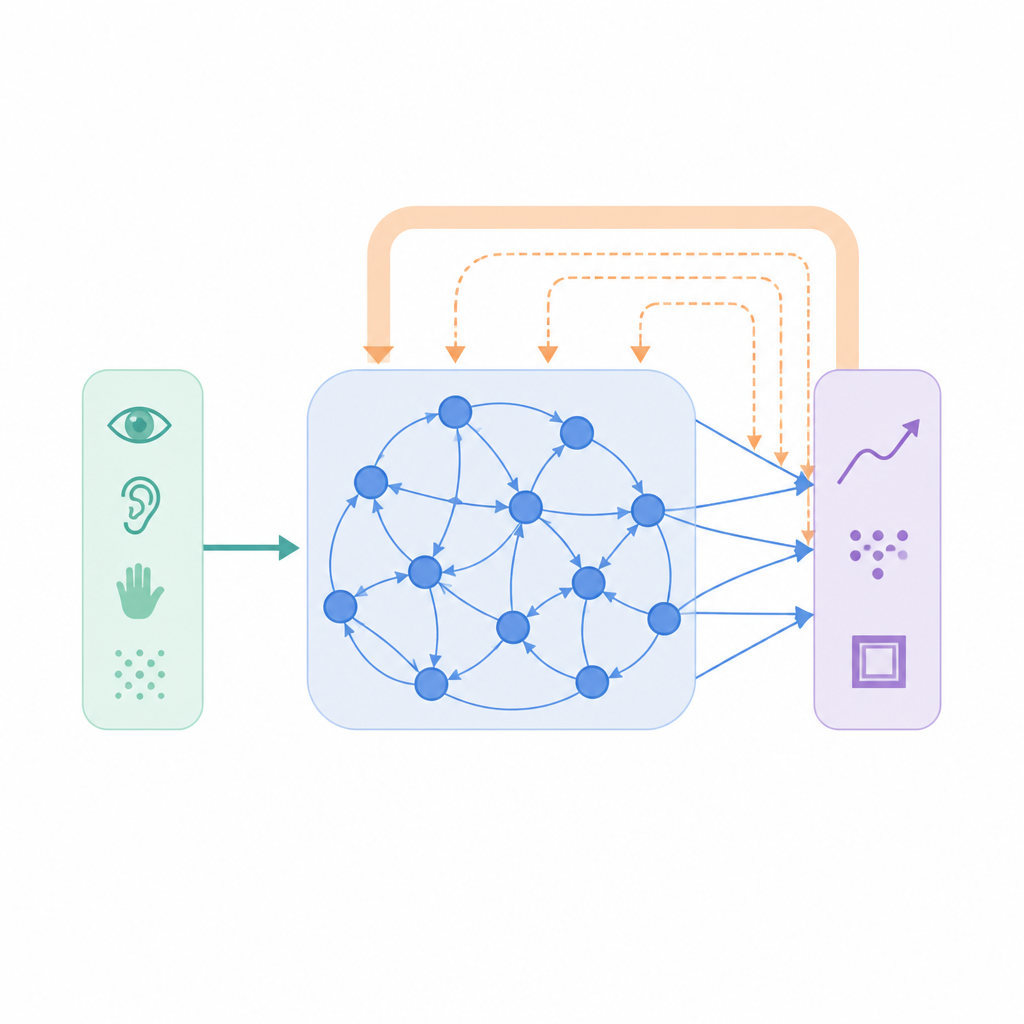

新しい技能を学ぶとき、脳は新情報を取り入れる柔軟さと、既に知っていることを忘れない安定性を不思議なほど両立させます。現代の人工知能はこのバランスに悩みがちで、素早く学習する反面、脆弱になったり不安定になったりすることがあります。本研究は脳のフィードバック信号に着想を得て、人工ニューラルネットワークがノイズや変化する課題、誤誘導に直面しても、より効率的に学習し頑健でいられる新たな学習法を設計します。

学習マシン内部の新たな指導信号

多くの機械学習システムは単純な手順に依拠しています:ネットワークの予測を正解と比較し、その差を縮めるように結合を微調整する。こうしたボトムアップの手法は有効ですが、期待や文脈、予測を運ぶ脳内の豊かなトップダウン信号を無視しています。著者らは内在的トップダウン安定化(iTDS)という要素を導入しました。正解だけを追いかけるのではなく、ネットワーク自身の過去の出力を追跡する遅い内部信号も学習します。このゆっくり変化する信号を学習規則にフィードバックすることで、各結合は外部の誤差だけでなく、時間を通じたネットワークの振る舞いにも影響されるようになります。

自分の習慣を記憶するようにネットワークを教える

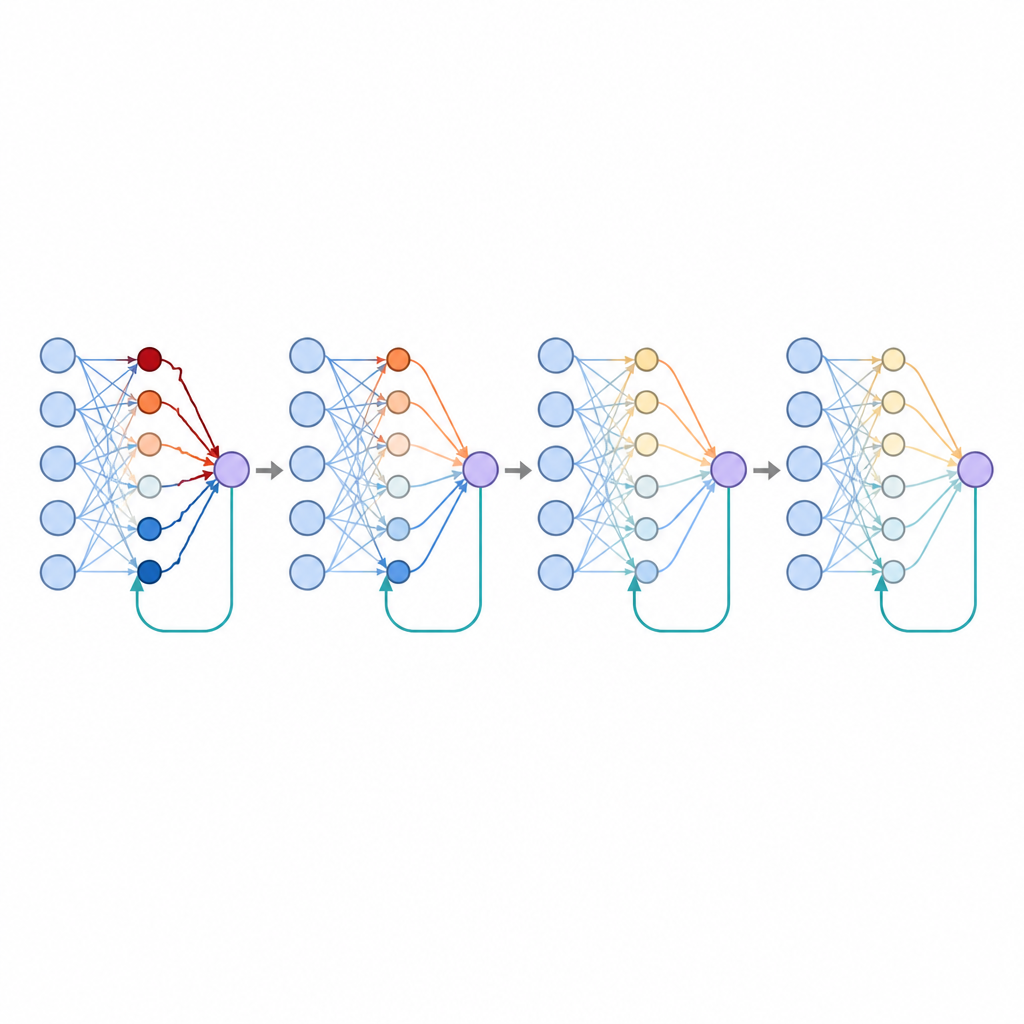

iTDSでは、ネットワークは最近の出力活動の滑らかな履歴を保持します。この内部トレースは将来のデータや生の感覚入力を予測しようとはせず、単にネットワークが既に出した出力のフィルタされた反響になります。訓練中は通常の誤差項が結合を正解へと押し上げる一方で、トップダウン項は現在の出力とこの反響を比較します。ネットワークの活動が大きく変動しているとき、これら二つの影響は同じ方向を向きやすく、相互に強化して学習を加速します。訓練が進みネットワークがより一貫したパターンに落ち着くと、トップダウンの影響は徐々に弱まり、変化の駆動よりも安定化の役割を果たすようになります。

タイミング、分類、そして混沌への対処の改善

研究者たちは再帰型、フィードフォワード、リザバー型モデルを含む複数のニューラルネットワークでiTDSを検証し、16種類の課題で試しました。これらは時系列の滑らかな信号追跡、手書き数字の認識、簡単な論理問題の解決などに及びます。多くの場合、iTDSを加えることで標準的な教師あり学習よりも訓練が速く誤差が低くなり、基礎となるネットワーク動的が混沌的であっても成果が見られました。特に多数の活性ユニットを持つ場合や出力信号が大きく変動する場合に有効であり、これは生物学的にも人工的にも一般的な条件です。

ノイズや誤誘導例から学ぶ

現実世界のデータはめったにきれいではありません。頑健性を試すために、著者らは入力にノイズを加え、画像を通常の向きから回転させ、さらには例が誤った答えと結びつく“逆試行”を混入させました。こうした厳しい条件下では、標準学習のみを使うネットワークは過剰反応し、結合を有害な方向に変えてしまう傾向がありました。iTDSでは、遅いトップダウン信号がブレーキのように働きます:驚くべきまたは矛盾する例が現れると、二つの学習影響は部分的に打ち消し合い、重み変化の大きさが減少します。その結果、iTDSを用いるネットワークはランダムな歪みや分類器を騙すように巧妙に選ばれた摂動に対してもより耐性を示しました。

正負のフィードバックを分けることの意義

研究では、いくつかの結合が正の誤差のみを追跡し、他が負の誤差のみを追跡するように分化させた場合の効果も探りました。これは報酬や挫折に対して特定の脳細胞が異なる応答を示す様子を反映します。この分離は自然に疎な接続パターンを生み、多くの結合がゼロ付近に留まる一方で、より小さなサブセットが影響の大部分を担います。こうした疎性は汎化を改善することが知られており、本研究でも誤差率をさらに下げました。著者らは、多くの重みをゼロに保つよう強制するだけでもこの利点の多くを再現できることを示し、特殊化したフィードバックは疎で効率的な表現を実現する生物学的経路の一つである可能性を示唆しました。

今後の脳と機械への示唆

全体として、iTDSフレームワークは、学習マシンに最近の自身の振る舞いをゆっくりと変化する形で持たせることで、学習を速め問題解決をより安定させ得ることを示します。正解との即時の不一致にのみ依存する代わりに、迅速な修正と穏やかなトップダウン安定化を融合させるネットワークは、ノイズや混乱、変化をよりしなやかに扱います。脳科学にとっては、フィードバック経路が学習をどのように形作るかについて具体的な予測を提供します。人工知能にとっては、複数の時間スケールにわたる自己監視信号を組み込むことが、我々のように学習し、世界が混沌としても失敗しにくいシステムを作る実践的な道筋になり得ることを示唆します。

引用: Pilzak, A., Pennington, B. & Thivierge, JP. Intrinsic stabilization of synaptic plasticity improves learning and robustness in artificial neural networks. Nat Commun 17, 4164 (2026). https://doi.org/10.1038/s41467-026-70920-3

キーワード: シナプス可塑性, トップダウンフィードバック, 再帰型ニューラルネットワーク, 頑健な学習, ノイズ耐性