Clear Sky Science · pl

Wewnętrzna stabilizacja plastyczności synaptycznej poprawia uczenie się i odporność w sztucznych sieciach neuronowych

Jak mózgi inspirują stabilniejsze uczenie maszyn

Kiedy uczymy się nowej umiejętności, nasz mózg zachowuje wystarczającą elastyczność, by przyswajać nowe informacje, a jednocześnie wystarczającą stabilność, by nie zapominać tego, co już wiemy. Współczesna sztuczna inteligencja często ma trudności z tym wyważeniem: uczy się szybko, ale bywa krucha lub niestabilna. To badanie czerpie inspirację z sygnałów zwrotnych mózgu, projektując nowy sposób, w jaki sztuczne sieci neuronowe mogą uczyć się wydajniej, zachowując odporność wobec szumu, zmieniających się zadań i mylących przykładów.

Nowy sygnał przewodniczący wewnątrz maszyn uczących się

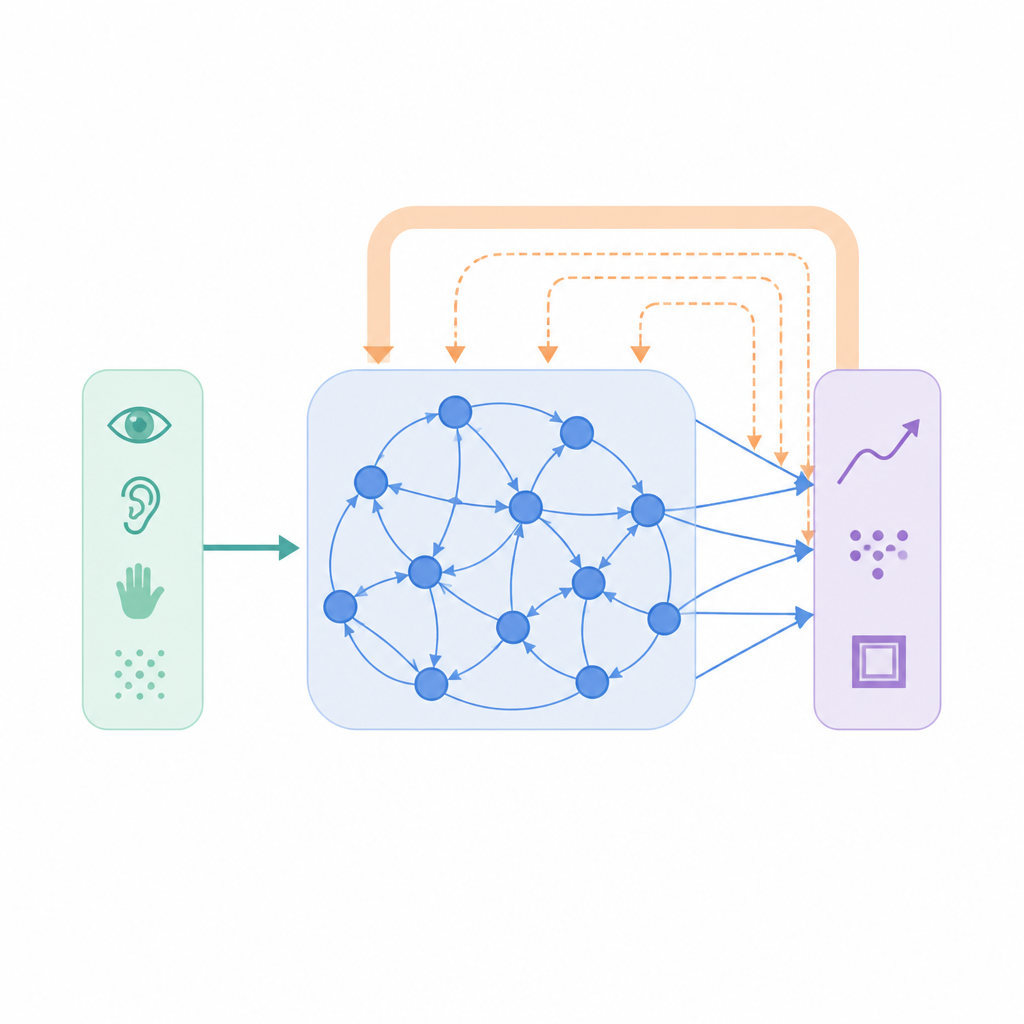

Większość systemów uczenia maszynowego opiera się na prostym przepisie: porównaj przewidywanie sieci z poprawną odpowiedzią i skoryguj połączenia, by zmniejszyć tę różnicę. To podejście oddolne działa dobrze, ale pomija bogate sygnały z góry, które przepływają w prawdziwych mózgach, niosąc oczekiwania, kontekst i przewidywania. Autorzy wprowadzają dodatkowy składnik nazwany wewnętrzną Top-Down Stabilizacją (iTDS). Zamiast jedynie ścigać poprawną odpowiedź, sieć uczy się także wolniejszego, wewnętrznego sygnału śledzącego jej własne wcześniejsze wyjście. Ten powoli zmieniający się sygnał jest włączany do reguły uczenia, więc każde połączenie kształtowane jest nie tylko przez zewnętrzny błąd, lecz także przez to, jak sieć zachowuje się w czasie.

Nauczanie sieci pamiętania własnych nawyków

W iTDS sieć utrzymuje bieżący, wygładzony zapis swojej niedawnej aktywności wyjściowej. Ten wewnętrzny ślad nie próbuje przewidywać przyszłych danych ani surowego wejścia sensorycznego; staje się po prostu filtrowanym echo tego, co sieć już wygenerowała. Podczas treningu zwykły składnik błędu przesuwa połączenia w stronę poprawnego celu, podczas gdy term z góry porównuje bieżące wyjście z tym echem. Gdy aktywność sieci jest bardzo zmienna, oba wpływy zwykle wskazują podobny kierunek, wzmacniając się nawzajem i przyspieszając naukę. W miarę postępu treningu i ustalania się bardziej spójnego wzorca, wpływ top-down stopniowo słabnie, działając bardziej jak stabilizator niż siła napędowa zmian.

Lepsze wyczucie czasu, kategoryzacja i radzenie sobie z chaosem

Badacze testowali iTDS w kilku rodzajach sieci neuronowych, w tym rekurencyjnych, feedforward i rezerwuarowych, na szesnastu zadaniach. Obejmowały one śledzenie gładkich sygnałów w czasie, rozpoznawanie ręcznie pisanych cyfr oraz rozwiązywanie prostych problemów logicznych. W wielu przypadkach dodanie iTDS prowadziło do szybszego treningu i niższego błędu niż samo standardowe uczenie nadzorowane, nawet gdy dynamika sieci była chaotyczna. Metoda była szczególnie skuteczna, gdy sieci miały wiele aktywnych jednostek lub gdy sygnały wyjściowe silnie się wahały — warunki powszechne zarówno w układach biologicznych, jak i sztucznych.

Uczenie się z zaszumionych i mylących przykładów

Dane rzeczywiste rzadko są czyste. Aby przetestować odporność, autorzy celowo dodali szum do wejść, obracali obrazy poza ich zwykłą orientację, a nawet wprowadzali "kontra-próby", w których przykłady parowano z nieprawidłową odpowiedzią. W tych stresujących warunkach sieci używające tylko standardowego uczenia miały tendencję do nadreakcji, przekształcając połączenia w niekorzystny sposób. Dzięki iTDS wolny sygnał top-down działał jak hamulec: gdy pojawiał się zaskakujący lub sprzeczny przykład, oba wpływy uczenia częściowo się znosiły, zmniejszając wielkość zmiany wag. W rezultacie sieci z iTDS były bardziej odporne zarówno na losowe zniekształcenia, jak i na celowe perturbacje, które zwykle wprowadzają klasyfikatory w błąd.

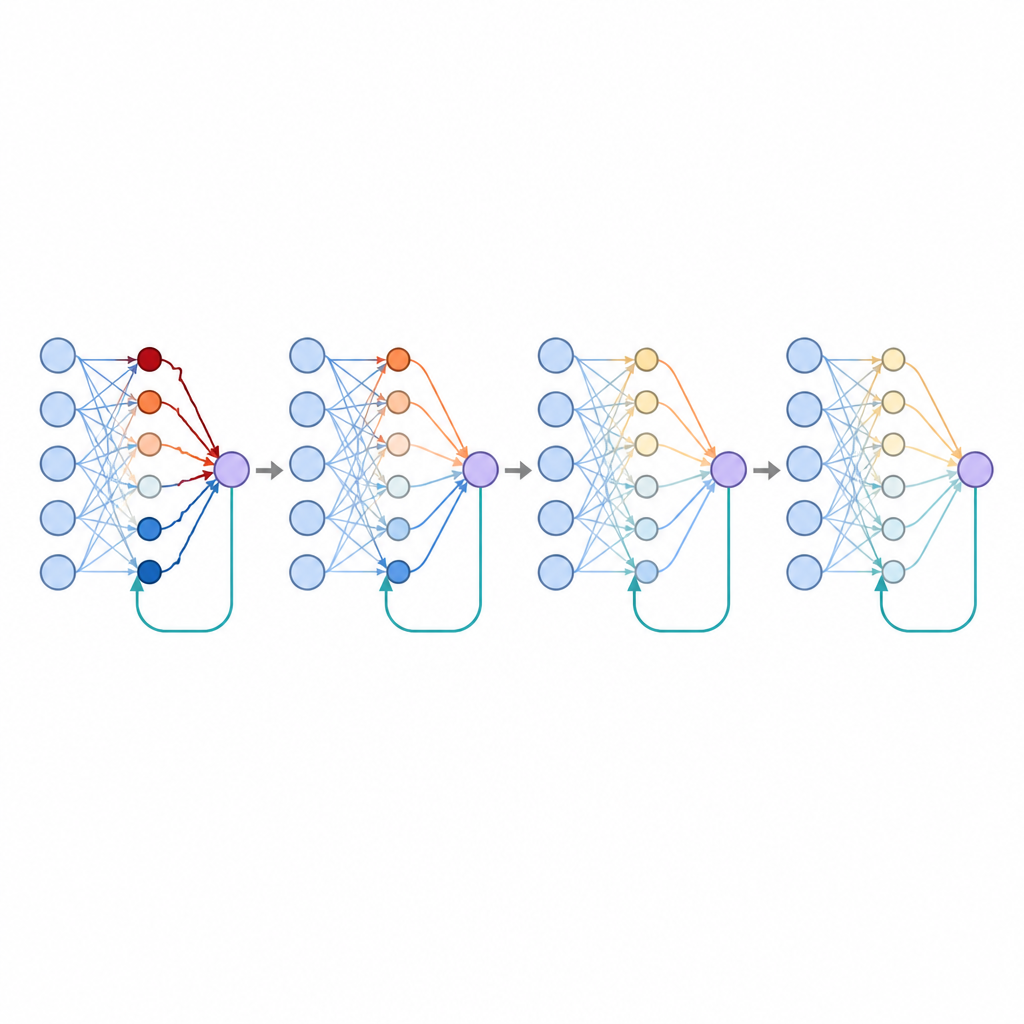

Dlaczego rozdzielenie sprzężenia pozytywnego i negatywnego ma znaczenie

Badanie zbadało także, co się dzieje, gdy niektóre połączenia wyspecjalizują się w śledzeniu tylko błędów pozytywnych, a inne tylko negatywnych, naśladując sposób, w jaki niektóre komórki mózgowe odpowiadają odmiennie na nagrody i porażki. Takie rozdzielenie naturalnie generowało bardziej rzadkie wzory połączeń, gdzie wiele połączeń pozostawało w pobliżu zera, podczas gdy mniejszy podzbiór przenosił większość wpływu. Taka rzadkość jest znana z poprawy uogólniania i tutaj dodatkowo obniżała wskaźniki błędów. Autorzy pokazali, że proste wymuszenie, by wiele wag pozostawało zerowych, naśladowało dużą część tego efektu, sugerując, że wyspecjalizowane sprzężenie zwrotne może być jedną z biologicznych dróg do osiągnięcia rzadkich, efektywnych reprezentacji.

Co to oznacza dla przyszłych mózgów i maszyn

Podsumowując, ramy iTDS pokazują, że wyposażenie maszyn uczących się w powoli zmieniające się poczucie własnego niedawnego zachowania może uczynić je szybszymi uczniami i stabilniejszymi rozwiązywaczami problemów. Zamiast polegać wyłącznie na natychmiastowej rozbieżności z poprawną odpowiedzią, sieci łączące szybkie korekty z łagodną, z góry nastawioną stabilizacją lepiej radzą sobie z szumem, dezorientacją i zmianą. Dla nauk o mózgu model daje konkretne przewidywania, jak ścieżki sprzężenia zwrotnego mogą kształtować uczenie. Dla sztucznej inteligencji sugeruje, że wbudowanie sygnałów samonadzoru, działających na wielu skalach czasowych, może być praktyczną drogą do systemów uczących się bardziej podobnie do nas i rzadziej zawodzących, gdy świat robi się nieuporządkowany.

Cytowanie: Pilzak, A., Pennington, B. & Thivierge, JP. Intrinsic stabilization of synaptic plasticity improves learning and robustness in artificial neural networks. Nat Commun 17, 4164 (2026). https://doi.org/10.1038/s41467-026-70920-3

Słowa kluczowe: plastyczność synaptyczna, sprzężenie zwrotne z góry, recurrent neural networks, odporne uczenie, odporność na szum