Clear Sky Science · fr

Stabilisation intrinsèque de la plasticité synaptique améliorant l’apprentissage et la robustesse dans les réseaux de neurones artificiels

Comment le cerveau inspire un apprentissage plus stable chez les machines

Lorsque nous apprenons une nouvelle compétence, notre cerveau reste à la fois suffisamment flexible pour intégrer de nouvelles informations et suffisamment stable pour ne pas oublier ce que nous savons déjà. L’intelligence artificielle moderne peine souvent à maintenir cet équilibre : elle apprend rapidement mais devient parfois fragile ou instable. Cette étude s’inspire des signaux de rétroaction cérébraux pour concevoir une nouvelle manière permettant aux réseaux de neurones artificiels d’apprendre plus efficacement tout en restant robustes face au bruit, aux tâches changeantes et aux exemples trompeurs.

Un nouveau signal directeur à l’intérieur des machines d’apprentissage

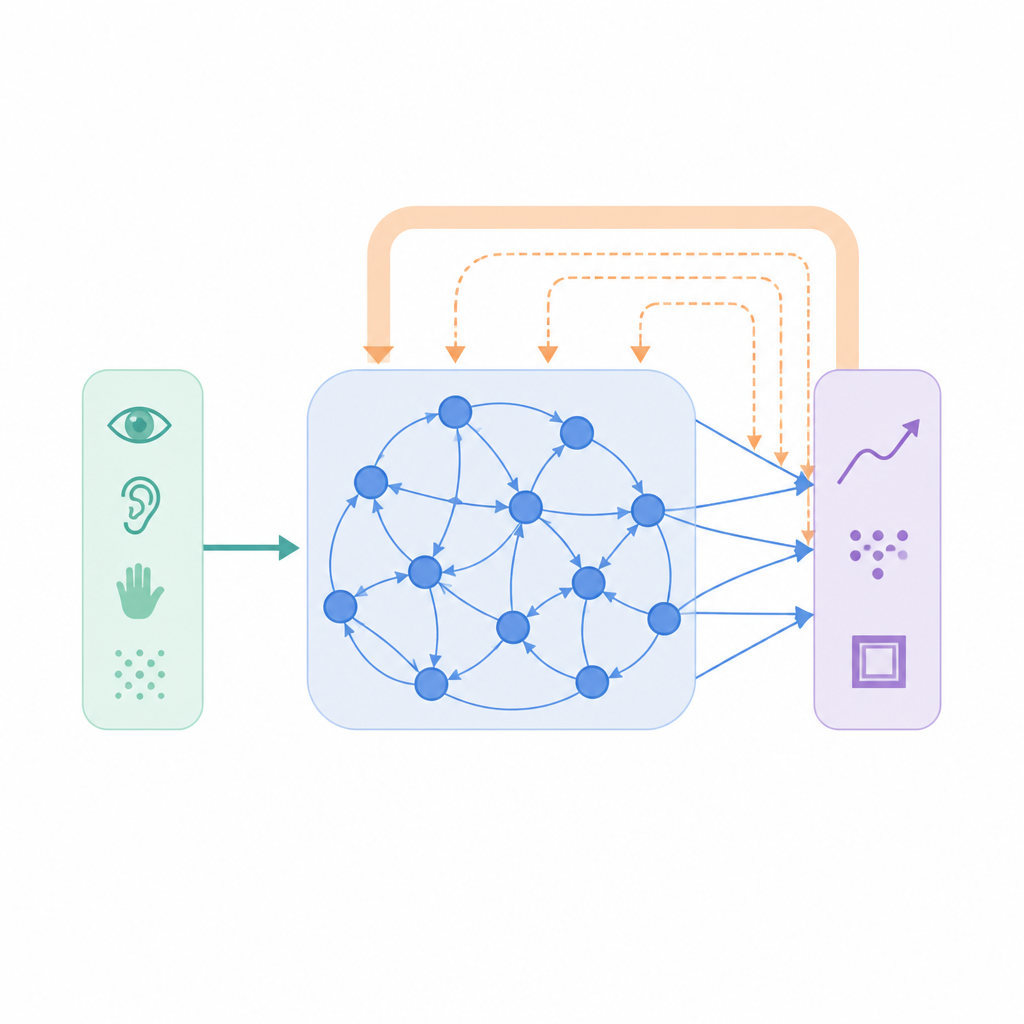

La plupart des systèmes d’apprentissage automatique reposent sur une recette simple : comparer la prédiction du réseau à la réponse correcte et ajuster ses connexions pour réduire cet écart. Cette approche ascendante fonctionne bien mais ignore les riches signaux descendants qui circulent dans les cerveaux réels, porteurs d’attentes, de contexte et de prédictions. Les auteurs introduisent un ingrédient supplémentaire appelé stabilisation top-down intrinsèque (iTDS). Plutôt que de poursuivre uniquement la réponse correcte, le réseau apprend aussi un signal interne plus lent qui suit sa propre sortie passée. Ce signal, qui évolue lentement, est renvoyé dans la règle d’apprentissage ; chaque connexion est ainsi façonnée non seulement par l’erreur externe, mais aussi par la tendance du réseau à se comporter d’une certaine manière au fil du temps.

Apprendre aux réseaux à se souvenir de leurs habitudes

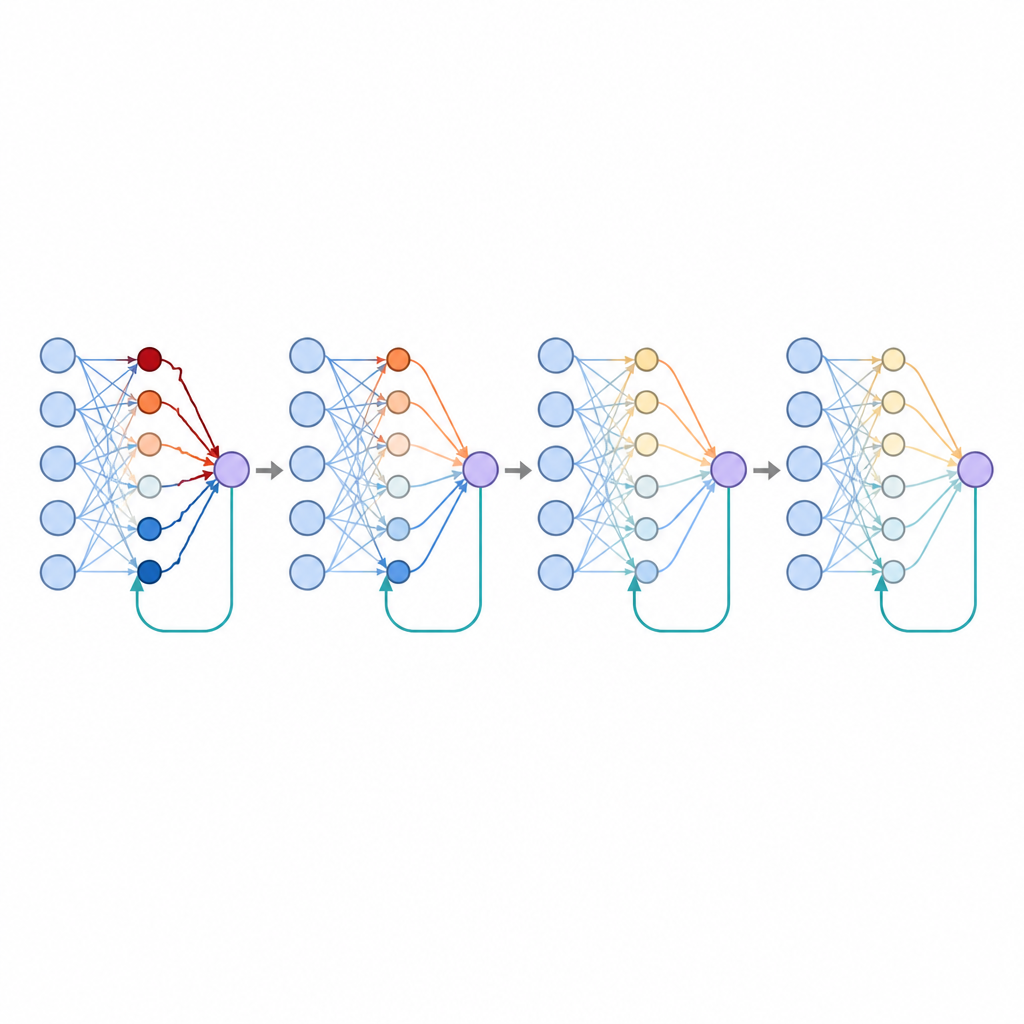

Avec l’iTDS, le réseau conserve un relevé lissé et continu de son activité de sortie récente. Cette trace interne ne cherche pas à prédire les données futures ni l’entrée sensorielle brute ; elle devient simplement un écho filtré de ce que le réseau a déjà produit. Pendant l’entraînement, le terme d’erreur habituel pousse les connexions vers la cible correcte, tandis que le terme top-down compare la sortie actuelle à cet écho. Lorsque l’activité du réseau est très variable, ces deux influences tendent à converger, se renforçant mutuellement et accélérant l’apprentissage. À mesure que l’entraînement progresse et que le réseau s’établit dans un schéma d’activité plus cohérent, l’influence top-down faiblit progressivement, jouant davantage le rôle d’un stabilisateur que d’un moteur de changement.

Meilleur timing, meilleure catégorisation et meilleure gestion du chaos

Les chercheurs ont testé l’iTDS sur plusieurs types de réseaux neuronaux, y compris récurrents, feedforward et modèles de réservoir, à travers seize tâches. Celles-ci allaient du suivi de signaux lisses dans le temps à la reconnaissance de chiffres manuscrits, en passant par la résolution de problèmes logiques simples. Dans de nombreux cas, l’ajout de l’iTDS a conduit à un entraînement plus rapide et à des erreurs plus faibles que l’apprentissage supervisé standard, même lorsque la dynamique sous-jacente du réseau était chaotique. La méthode s’est révélée particulièrement efficace lorsque les réseaux comportaient de nombreuses unités actives ou lorsque les signaux de sortie fluctuaient fortement, des conditions courantes en biologie comme en artificiel.

Apprendre à partir d’exemples bruités et trompeurs

Les données réelles sont rarement propres. Pour tester la robustesse, les auteurs ont délibérément ajouté du bruit aux entrées, fait pivoter des images hors de leur orientation habituelle, et même inséré des « contre‑essais » où des exemples étaient associés à la mauvaise réponse. Dans ces conditions stressantes, les réseaux utilisant seulement l’apprentissage standard ont tendance à sur‑réagir, remodelant leurs connexions de manière non souhaitable. Avec l’iTDS, le signal top-down lent a joué le rôle d’un frein : lorsqu’un exemple surprenant ou contradictoire apparaissait, les deux influences d’apprentissage s’annulaient partiellement, réduisant l’amplitude du changement de poids. En conséquence, les réseaux dotés d’iTDS étaient plus résistants tant aux distorsions aléatoires qu’aux perturbations intentionnellement conçues pour tromper les classificateurs.

Pourquoi la séparation des rétroactions positives et négatives compte

L’étude a aussi exploré ce qui se passe lorsque certaines connexions se spécialisent dans le suivi uniquement des erreurs positives et d’autres uniquement des erreurs négatives, rappelant comment certaines cellules cérébrales répondent différemment aux récompenses et aux revers. Cette séparation a naturellement produit des schémas de connectivité plus clairsemés, où de nombreuses connexions restent proches de zéro tandis qu’un petit sous‑ensemble porte la majeure partie de l’influence. Une telle parcimonie est connue pour améliorer la généralisation et, ici, elle a encore réduit les taux d’erreur. Les auteurs montrent que le simple fait de contraindre de nombreux poids à rester nuls reproduisait une grande partie de ce bénéfice, ce qui suggère que la rétroaction spécialisée peut être une voie biologique pour obtenir des représentations éparses et efficaces.

Ce que cela implique pour les cerveaux et les machines de demain

Globalement, le cadre iTDS montre que fournir aux machines d’apprentissage une perception lente de leur comportement récent peut les rendre plus rapides à apprendre et plus stables dans la résolution de problèmes. Plutôt que de se reposer uniquement sur le décalage immédiat avec la réponse correcte, des réseaux qui combinent corrections rapides et stabilisation top‑down douce gèrent mieux le bruit, la confusion et le changement. Pour les neurosciences, le modèle propose des prédictions concrètes sur la façon dont les voies de rétroaction pourraient façonner l’apprentissage. Pour l’intelligence artificielle, il suggère qu’intégrer des signaux d’auto‑surveillance sur plusieurs échelles de temps pourrait être une voie pratique vers des systèmes qui apprennent davantage comme nous et échouent moins souvent lorsque le monde devient chaotique.

Citation: Pilzak, A., Pennington, B. & Thivierge, JP. Intrinsic stabilization of synaptic plasticity improves learning and robustness in artificial neural networks. Nat Commun 17, 4164 (2026). https://doi.org/10.1038/s41467-026-70920-3

Mots-clés: plasticité synaptique, rétroaction top-down, réseaux neuronaux récurrents, apprentissage robuste, résilience au bruit